Perspectiva para 2026: Mientras 81 000 muestras de usuarios interactúan con el Índice Económico, ¿de qué manera las narrativas sobre la productividad impulsada por IA coexisten con las inquietudes sobre la seguridad laboral?

I. Antecedentes de la investigación e integración de datos: de la evidencia de tráfico a 81 000 relatos subjetivos

Las discusiones públicas sobre la IA generativa han dependido tradicionalmente de dos tipos de evidencia: estadísticas macro del sector y registros de uso y comportamiento a nivel de producto. Las primeras se actualizan lentamente y no logran captar los mecanismos a nivel de puesto, mientras que las segundas son auténticas pero suelen carecer de la perspectiva de “cómo interpretan las personas su propia situación”.

Fuente de la imagen: Anthropic Official Report

En abril de 2026, Anthropic publicó “Lo que 81 000 personas nos contaron sobre la economía de la IA”. El valor de este informe no está en dar una “respuesta final”, sino en conectar dos tipos clave de información:

- Datos observables desde la plataforma: qué tareas profesionales usan Claude y cómo varía la intensidad de uso.

- Opiniones subjetivas de usuarios: si las personas se sienten más eficientes y si aumenta su preocupación por ser reemplazadas.

Históricamente, los debates han tendido a lo macro (tasas de empleo, crecimiento del sector) o se han centrado en la experiencia de usuario (“me siento más rápido”). Este informe une ambas perspectivas, pasando del “opinión contra opinión” a una síntesis de “datos más percepción”.

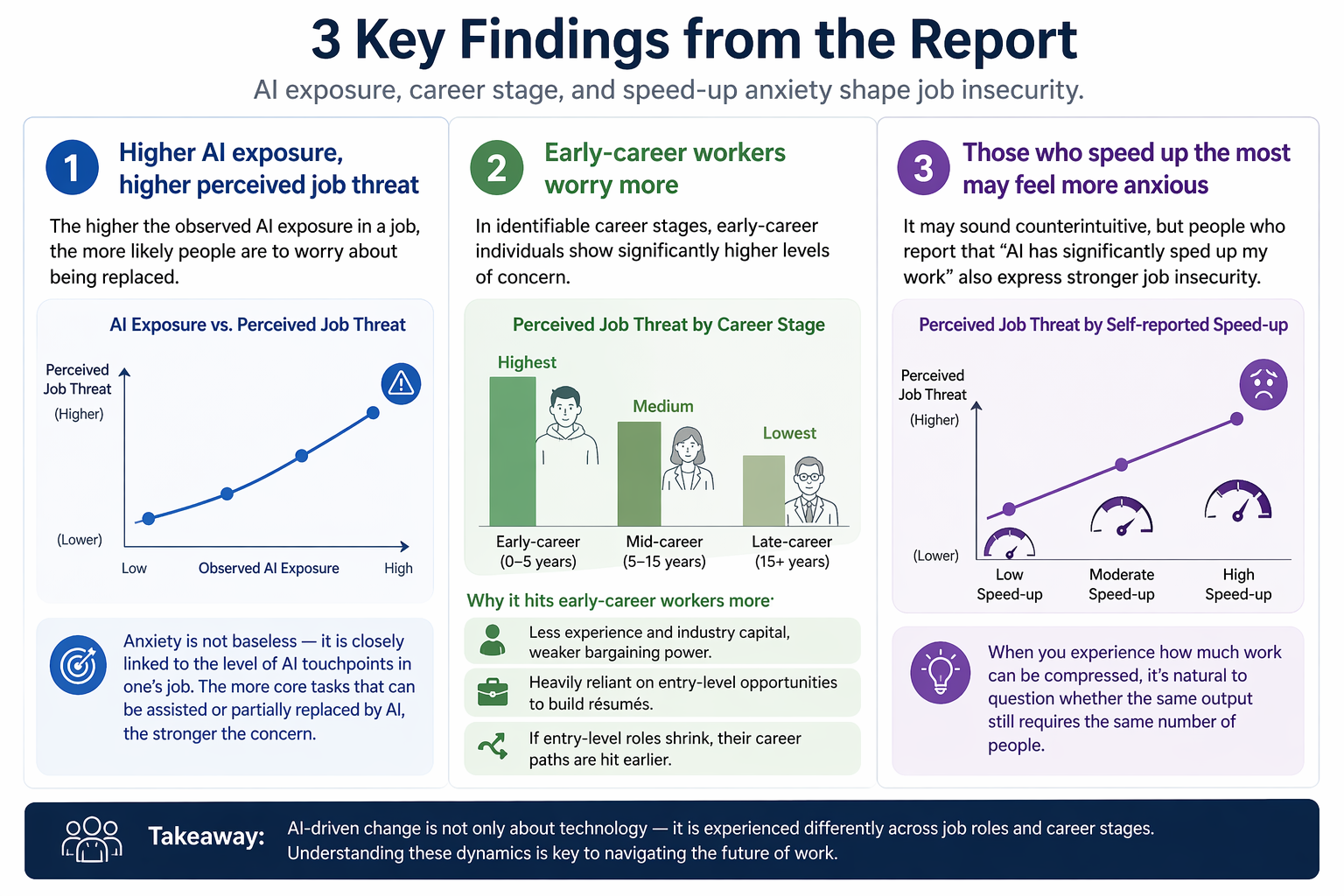

Tres hallazgos clave: exposición, etapa profesional, ansiedad por aceleración

Hallazgo 1: mayor exposición a la IA incrementa la percepción de amenaza laboral

El informe identifica una relación clara: cuanto mayor es la exposición observada a la IA en una profesión, más probable es que los encuestados expresen preocupación por la posibilidad de que sus empleos sean reemplazados.

Esto indica que la ansiedad de muchas personas no es infundada, sino que está relacionada con el alcance tecnológico de sus funciones. Si un puesto ya tiene varias tareas principales que la IA puede apoyar o reemplazar parcialmente, quienes ocupan ese puesto tienden a preocuparse más por cambios futuros, reflejando una conciencia racional del riesgo.

Hallazgo 2: los trabajadores en etapas iniciales muestran mayor preocupación

El informe señala que, entre las muestras con etapa profesional identificable, los trabajadores en etapas iniciales presentan inquietudes más pronunciadas.

Esto coincide con las observaciones del mercado laboral de 2026, como el aumento de la presión sobre el empleo juvenil.

¿Por qué ocurre esto con más frecuencia en los grupos en etapas iniciales?

- Menos experiencia y recursos en el sector, lo que reduce el poder de negociación.

- Mayor dependencia de oportunidades de entrada para construir el currículum.

- Si los puestos de entrada se reducen, las trayectorias profesionales se ven afectadas antes.

Hallazgo 3: quienes experimentan mayor aceleración también pueden sentirse más ansiosos

Aunque parezca contradictorio, esto es relevante:

Algunos que afirman que “la IA ha incrementado significativamente mi velocidad” también expresan mayor inseguridad laboral.

La lógica es sencilla:

Al ver que la eficiencia puede aumentar radicalmente, se percibe con mayor claridad si para el mismo resultado se necesita el mismo número de personas.

¿Dónde se refleja realmente la productividad? Expansión del alcance frente a velocidad

Muchos suponen que el valor de la IA es simplemente “ser más rápido”. Sin embargo, este informe resalta otra dimensión, quizás más importante: la “expansión del alcance”.

- Expansión del alcance: tareas que antes eran inabordables ahora son posibles.

- Velocidad: tareas que ya eran factibles ahora se completan más rápido.

La expansión del alcance es un tema recurrente en el informe.

Esto significa que la IA no es solo una herramienta de eficiencia, sino un multiplicador de capacidades.

Implicaciones diferenciadas según el grupo

- Para roles de alta cualificación: permite abordar tareas complejas de forma más profunda y sistemática.

- Para algunos empleos de baja remuneración: puede facilitar actividades paralelas, exploración de nuevas habilidades y mayor autonomía en la entrega.

- Para la gestión organizacional: los límites de los puestos pueden redefinirse y la división del trabajo cambiar más rápido.

Por qué “más eficiente” no significa “más seguro”

Este es uno de los puntos más ignorados en los debates actuales.

Muchos informes destacan:

“La eficiencia de los empleados ha aumentado, por lo tanto, la tecnología es inclusiva.”

Sin embargo, en realidad, la eficiencia solo responde a “cuánto ha cambiado la producción”, no a “cómo se distribuyen los beneficios”.

El mismo dividendo de eficiencia puede tener cuatro destinos

- Para los empleados: mayor ingreso, menos tareas repetitivas, más autonomía.

- Para las empresas: mayor producción con el mismo personal o menores costes para la misma producción.

- Para los clientes: precios más bajos, entregas más rápidas.

- Absorbido por el sistema: mejoran los indicadores, pero en primera línea se vive como “más tareas, mayor ritmo”.

El informe también recoge que los encuestados afirman:

Después de usar IA, supervisores y clientes esperan “más, más rápido”.

Esto explica por qué muchas personas reportan ser “más eficientes” y a la vez “más ansiosas”.

Integración de la información pública más reciente: lo que se puede y no se puede confirmar

A partir de los materiales del Índice Económico de Anthropic de 2026 (incluidos los informes de enero y marzo y el framework de encuestas), las conclusiones más fiables actualmente son:

Lo que se puede confirmar razonablemente

- La IA ha logrado una penetración real en algunas tareas profesionales, superando la etapa conceptual.

- Las preocupaciones laborales subjetivas están alineadas con la exposición a tareas.

- Las mejoras de productividad son reales y se reflejan no solo en la “velocidad”, sino también en el “alcance”.

Lo que no se puede extrapolar en exceso

- Esta muestra no sirve para inferir el impacto neto en el empleo nacional.

- Las experiencias de usuarios individuales no equivalen a las de todos los empleados de una empresa.

- “Mayor preocupación” no equivale directamente a “desempleo”.

Por qué es necesaria la cautela

Esta encuesta utilizó respuestas abiertas y clasificación por modelos, no un cuestionario estructurado estrictamente.

Es muy valiosa como referencia, pero resulta más útil para “identificar tendencias e hipótesis” que como “conclusión definitiva”.

Recomendaciones prácticas para empresas, individuos y responsables de políticas

Para avanzar, las conclusiones deben convertirse en acciones.

Para empresas: actualizar los “KPI de eficiencia” a “métricas duales”

Supervisa ambas categorías de métricas:

- Métricas de producción: tiempo invertido, volumen de entrega, tasa de errores, tasa de retrabajo.

- Métricas sostenibles de efectividad de personas: carga de trabajo percibida, riesgo de rotación, cobertura de formación, tasa de éxito en transición de roles.

Evita hacer solo una cosa:

No implementes herramientas sin ajustar el diseño de los puestos y los mecanismos de formación.

De lo contrario, la eficiencia puede aumentar a corto plazo, pero la estabilidad organizacional a largo plazo puede verse comprometida.

Para individuos: convertir el uso de IA en “construcción de activos profesionales”

Prioriza tres líneas de acción:

- Usar IA para métodos reutilizables, no solo para impulsos puntuales de velocidad.

- Fortalecer habilidades en definición de problemas, colaboración interequipos y responsabilidad por resultados.

- Construir un historial de logros verificables (proyectos, casos, análisis sectoriales) para incrementar la irremplazabilidad.

Para responsables de políticas e instituciones: centrarse en zonas de amortiguamiento para etapas iniciales

Si los grupos en etapas iniciales son más sensibles, el apoyo público debe ser más proactivo:

- Cupones para transición y recualificación profesional.

- Programas de coformación en IA para roles de entrada.

- Publicación de datos más detallados sobre transiciones laborales.

Conclusión

Este estudio, basado en 81 000 muestras, demuestra que el impacto económico de la IA abarca al menos dos dimensiones que deben evaluarse en paralelo: las mejoras de eficiencia a nivel de tarea y los cambios en las expectativas laborales y la distribución de beneficios. Centrarse solo en la primera conlleva el riesgo de sobreestimar la inclusividad; definir el riesgo solo por la segunda subestima los verdaderos avances en la ampliación de capacidades.

Un framework analítico sólido debe reconocer que la mejora de la productividad y la incertidumbre laboral pueden coexistir, con una heterogeneidad significativa según la exposición laboral, la etapa profesional y la gestión organizacional. Por ello, el foco de los debates futuros debe pasar de “si adoptar IA” a “cómo optimizar los mecanismos de distribución, mitigar los costes de transición y garantizar la movilidad profesional sostenible mientras se incrementa la producción”.

Tras 2026, el núcleo de la investigación y la gobernanza económica de la IA no es buscar una única conclusión, sino construir un sistema de evaluación integral que permita supervisar la eficiencia, la distribución y la estabilidad laboral de forma simultánea.

Artículos relacionados

GateClaw y habilidades de IA: análisis detallado del marco de capacidades para agentes de IA en Web3

La aplicación de Render en IA: cómo el hashrate descentralizado impulsa la inteligencia artificial

¿Qué es HyperGPT? Todo lo que necesitas saber sobre HGPT

Tokenómica de RENDER: suministro, incentivos y captura de valor

Características clave de GateClaw: análisis detallado de las capacidades de la estación de trabajo de agentes de IA Web3