Perspectives 2026 : alors que 81 000 échantillons d’utilisateurs interagissent avec l’Index économique, comment les discours sur la productivité générée par l’IA s’articulent-ils avec les inquiétudes liées à la sécurité de l’emploi ?

I. Contexte de la recherche et intégration des données : des preuves de trafic à 81 000 récits subjectifs

Les débats publics sur l’IA générative se sont longtemps appuyés sur deux types de preuves : les statistiques macroéconomiques sectorielles et les journaux d’utilisation et de comportement au niveau des produits. Les premières évoluent lentement et peinent à saisir les mécanismes au niveau des métiers, tandis que les secondes sont authentiques mais manquent souvent de la perspective « comment les individus interprètent-ils leur propre situation ».

Source de l’image : Anthropic Official Report

En avril 2026, Anthropic a publié « What 81,000 People Told Us About the Economics of AI ». L’intérêt de ce rapport ne réside pas dans la recherche d’une « réponse définitive », mais dans la mise en relation de deux types d’informations clés :

- Données observables côté plateforme : quelles tâches professionnelles utilisent Claude et comment évolue l’intensité d’utilisation.

- Retours subjectifs côté utilisateur : les utilisateurs se sentent-ils plus efficaces et sont-ils plus préoccupés par le risque de remplacement.

Historiquement, les discussions se sont soit concentrées sur l’aspect macro (taux d’emploi, croissance sectorielle), soit sur l’expérience utilisateur (« je me sens plus rapide »). Ce rapport combine les deux, faisant évoluer le débat d’une « opinion contre opinion » vers une synthèse « données et perception ».

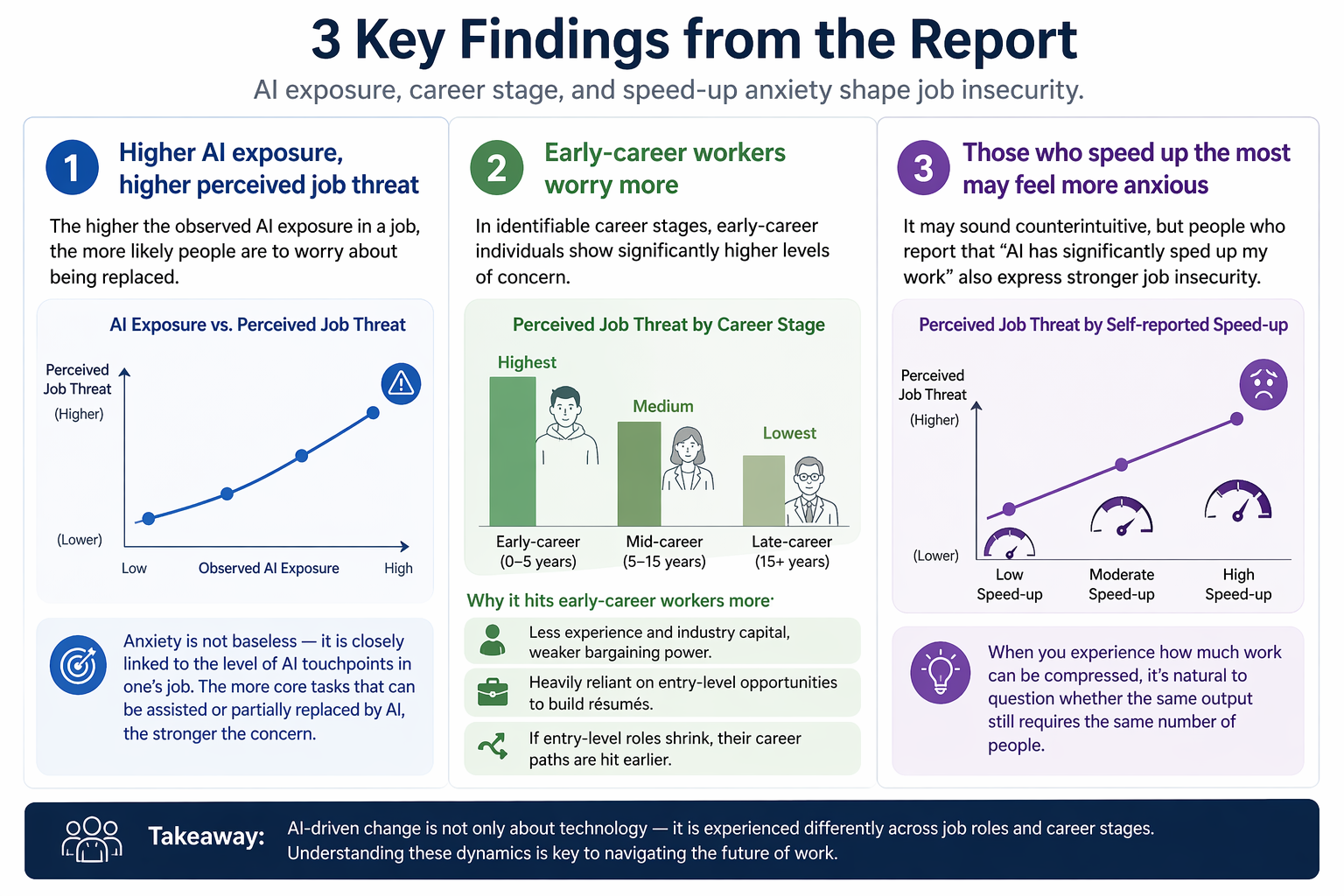

Trois constats clés : exposition, stade de carrière, anxiété d’accélération

Constat 1 : une exposition accrue à l’IA accroît le sentiment de menace sur l’emploi

Le rapport met en évidence une relation claire : plus l’exposition observée à l’IA dans une profession est forte, plus les répondants expriment des craintes quant au remplacement de leur emploi.

Cela indique que les inquiétudes de nombreux individus ne sont pas infondées, mais liées à la pénétration technologique de leur poste. Si une fonction comporte déjà plusieurs tâches principales que l’IA peut assister ou remplacer partiellement, les personnes concernées sont plus susceptibles de redouter les évolutions à venir, ce qui révèle une prise de risque rationnelle.

Constat 2 : les personnes en début de carrière sont plus préoccupées

Le rapport note que, parmi les échantillons dont le stade de carrière est identifiable, les personnes en début de carrière affichent des inquiétudes plus marquées.

Cela rejoint les observations du marché du travail en 2026, comme la pression accrue sur l’emploi des jeunes.

Pourquoi ce phénomène est-il plus fréquent chez les débutants ?

- Moins d’expérience et de ressources, donc un pouvoir de négociation plus faible.

- Une plus grande dépendance aux postes d’entrée pour construire un CV.

- Si ces postes se réduisent, les parcours professionnels sont perturbés plus tôt.

Constat 3 : ceux qui vivent la plus forte accélération ressentent aussi plus d’anxiété

Bien que contre-intuitif, ce constat est significatif :

Certaines personnes déclarant que « l’IA a considérablement augmenté ma rapidité » expriment également une insécurité professionnelle plus forte.

La logique est simple :

Constater que l’efficacité au travail peut être fortement accrue rend plus attentif à la nécessité ou non du même nombre de personnes pour obtenir le même résultat.

Où la productivité se manifeste vraiment : élargissement du champ d’action vs vitesse

Beaucoup supposent que la valeur de l’IA se résume à « aller plus vite ». Pourtant, ce rapport met en avant une autre dimension, souvent plus importante : « l’élargissement du champ d’action ».

- Élargissement du champ d’action : des tâches auparavant impossibles deviennent réalisables.

- Vitesse : des tâches déjà faisables sont accomplies plus rapidement.

L’élargissement du champ d’action est un thème central du rapport.

Cela signifie que l’IA n’est pas seulement un outil d’efficacité, mais un multiplicateur de capacités.

Des implications différentes selon les groupes

- Pour les postes à haute qualification : approfondir et systématiser des tâches complexes.

- Pour certains emplois faiblement rémunérés : permettre des activités complémentaires, l’exploration de compétences transversales et une plus grande autonomie.

- Pour le management : redéfinition des contours des postes et évolution plus rapide de la division du travail.

Pourquoi « plus efficace » ne signifie pas « plus sécurisé »

C’est l’un des points les plus sous-estimés dans les débats actuels.

De nombreux rapports affirment :

« L’efficacité des salariés a augmenté, donc la technologie est inclusive. »

Mais en réalité, les gains d’efficacité répondent à « combien la production a changé », pas à « comment les rendements sont répartis ».

Un même dividende d’efficacité peut être réparti de quatre façons

- Aux salariés : hausse des revenus, moins de tâches répétitives, plus d’autonomie.

- Aux entreprises : production accrue à effectif constant ou baisse des coûts pour un même volume.

- Aux clients : prix plus bas, livraisons plus rapides.

- Absorbé par le système : les indicateurs s’améliorent, mais l’expérience terrain devient « plus de tâches, rythme plus soutenu ».

Le rapport cite aussi des répondants :

Après l’adoption de l’IA, responsables et clients attendent « plus, plus vite ».

Cela explique pourquoi nombre de personnes se disent « plus efficaces » mais aussi « plus anxieuses » en même temps.

Intégrer les dernières informations publiques : ce que l’on peut et ne peut pas confirmer

En s’appuyant sur les matériaux de l’Economic Index d’Anthropic de 2026 (rapports de janvier et mars, cadre d’enquête), les conclusions les plus fiables à ce jour sont :

Ce que l’on peut raisonnablement confirmer

- L’IA a une réelle pénétration dans certaines tâches professionnelles, au-delà du stade conceptuel.

- Les préoccupations subjectives sur l’emploi sont alignées sur l’exposition aux tâches.

- Les gains de productivité sont réels, visibles en « vitesse » et en « champ d’action ».

Ce qui ne peut pas être extrapolé

- Cet échantillon ne permet pas de déduire l’impact net sur l’emploi national.

- L’expérience utilisateur individuelle ne reflète pas celle de tous les employés d’une entreprise.

- « Préoccupation accrue » ne signifie pas directement « chômage ».

Pourquoi la prudence s’impose

Cette enquête reposait sur des réponses ouvertes et une classification par modèle, et non sur un questionnaire structuré.

Elle est précieuse comme référence, mais sert surtout à « identifier des tendances et hypothèses » plutôt qu’à tirer une « conclusion définitive ».

Recommandations opérationnelles pour entreprises, individus et décideurs

Pour dépasser le débat, il faut traduire les conclusions en actions concrètes.

Pour les entreprises : faire évoluer les « KPI d’efficacité » vers des « indicateurs doubles »

Suivre deux catégories d’indicateurs :

- Indicateurs de production : temps passé, volume livré, taux d’erreur, taux de reprise.

- Indicateurs humains durables : charge de travail perçue, risque de rotation, couverture de formation, taux de réussite des transitions de poste.

Éviter de se limiter à l’implémentation d’outils sans adapter la conception des postes et les dispositifs de formation.

Sinon, l’efficacité à court terme progresse, mais la stabilité organisationnelle à long terme peut en pâtir.

Pour les individus : faire de l’IA un levier de construction de carrière

Prioriser trois axes :

- Utiliser l’IA pour des méthodes réutilisables, pas seulement pour des accélérations ponctuelles.

- Renforcer les compétences en définition de problème, collaboration interéquipes et responsabilité sur les résultats.

- Constituer un historique de réalisations vérifiables (projets, cas, analyses sectorielles) pour renforcer son irremplaçabilité.

Pour les décideurs et institutions : cibler les zones tampons en début de carrière

Si les débutants sont plus sensibles, le soutien public doit être plus proactif :

- Vouchers de transition professionnelle et de reconversion.

- Programmes de co-formation à l’IA pour les postes d’entrée.

- Publication de données plus fines sur les transitions d’emploi.

Conclusion

Cette étude, basée sur 81 000 échantillons, prouve que l’impact économique de l’IA comporte au moins deux dimensions à évaluer conjointement : les gains d’efficacité au niveau des tâches et l’évolution des attentes professionnelles ainsi que de la répartition des rendements. Se concentrer sur la première conduit à surestimer l’inclusivité ; définir le risque uniquement par la seconde sous-estime les gains liés à l’élargissement des capacités.

Un cadre d’analyse robuste doit reconnaître que l’amélioration de la productivité et l’incertitude sur l’emploi peuvent coexister, avec de fortes disparités selon l’exposition des postes, le stade de carrière et le management. Les débats futurs devraient donc passer de « faut-il adopter l’IA » à « comment optimiser la répartition, atténuer les coûts de transition et garantir la mobilité professionnelle durable tout en augmentant la production ».

Après 2026, le cœur de la recherche et de la gouvernance économiques de l’IA n’est plus de trancher, mais de bâtir un système d’évaluation global permettant de suivre simultanément efficacité, répartition et stabilité de l’emploi.

Articles Connexes

Qu'est-ce que Fartcoin ? Tout ce qu'il faut savoir sur FARTCOIN

Comment trader grâce à des compétences en crypto : de la conception de la stratégie à l’exécution automatisée

Render, io.net et Akash : analyse comparative des réseaux DePIN de taux de hachage

L’application de Render dans l’IA : comment le taux de hachage décentralisé dynamise l’intelligence artificielle

Analyse approfondie d’Audiera GameFi : la combinaison du Dance-to-Earn, de l’IA et des jeux de rythme