Les agents IA ont déjà capté plus de la moitié du trafic en ligne, mais la confiance chute en flèche : découverte, identité, réputation, les trois grands obstacles à la mise à l'échelle

L’IA a dépassé le trafic humain, représentant 51 % de l’activité en ligne, mais la confiance dans les agents entièrement autonomes est passée de 43 % à 22 %. Pour que l’économie des agents fonctionne réellement, trois infrastructures fondamentales sont indispensables : la découvrabilité, l’authentification et le système de réputation. Cet article est basé sur le texte de Vaidik Mandloi « Know your Agent », édité et traduit par Dongqu.

(Précédent : La Russie prévoit de lancer une « loi sur les stablecoins » dès juillet, avec un fort potentiel pour les paiements transfrontaliers)

(Contexte supplémentaire : Le FBI américain a arrêté John Daghita ! Après avoir volé 46 millions de dollars en crypto-monnaies, il a exhibé sa richesse de manière ostentatoire.)

Les promesses de transformation de l’internet par les agents sont en train de devenir réalité. Ils ne sont plus de simples outils expérimentaux dans les fenêtres de chat, mais deviennent une partie essentielle de nos opérations quotidiennes — du nettoyage de la boîte mail, à la planification de réunions, en passant par la réponse aux tickets de support. Ils améliorent silencieusement la productivité, souvent sans que l’on s’en rende compte.

Mais cette croissance n’est pas qu’une rumeur.

D’ici 2025, le trafic automatisé dépassera celui des humains, représentant 51 % de l’activité totale en ligne. Sur les sites de vente au détail américains, le trafic alimenté par l’IA a augmenté de 4700 % en un an. Les agents IA opèrent désormais à travers plusieurs systèmes, avec la capacité d’accéder aux données, de déclencher des workflows, voire d’initier des transactions.

Cependant, la confiance dans les agents entièrement autonomes a chuté de 43 % à 22 % en un an, principalement en raison de l’augmentation des incidents de sécurité. Près de la moitié des entreprises utilisent encore des clés API partagées pour authentifier leurs agents, une méthode jamais conçue pour permettre à des systèmes autonomes de transférer de la valeur ou d’agir de façon indépendante.

Le problème est que la vitesse d’expansion des agents dépasse celle des infrastructures de gouvernance.

En réponse, de nouvelles couches de protocoles émergent. Les stablecoins, l’intégration des réseaux de cartes, et des standards natifs comme x402 permettent d’effectuer des transactions initiées par des machines. Parallèlement, de nouvelles couches d’identité et d’authentification sont en développement pour aider les agents à s’identifier et à opérer dans des environnements structurés.

Mais réaliser un paiement ne suffit pas pour créer une économie. Lorsqu’un agent peut transférer de la valeur, des questions plus fondamentales surgissent : comment découvre-t-il les services appropriés de manière machine-lisible ? Comment prouve-t-il son identité et son autorisation ? Comment vérifier que les opérations qu’il affirme avoir effectuées ont bien eu lieu ?

Cet article explore les infrastructures nécessaires à l’exécution à grande échelle d’une économie pilotée par des agents, et évalue si ces couches sont suffisamment matures pour soutenir des participants autonomes, durables et rapides.

Les agents ne peuvent pas acheter ce qu’ils ne voient pas

Avant de payer pour un service, un agent doit d’abord le découvrir. Cela paraît simple, mais c’est actuellement la étape la plus problématique.

L’internet est conçu pour la lecture humaine. Lorsqu’un humain recherche du contenu, le moteur de recherche renvoie des liens classés. Ces pages sont optimisées pour la persuasion. Elles regorgent de mises en page, de trackers, de publicités, de menus de navigation et d’éléments stylistiques, qui ont du sens pour l’humain, mais ne sont que « bruit » pour une machine.

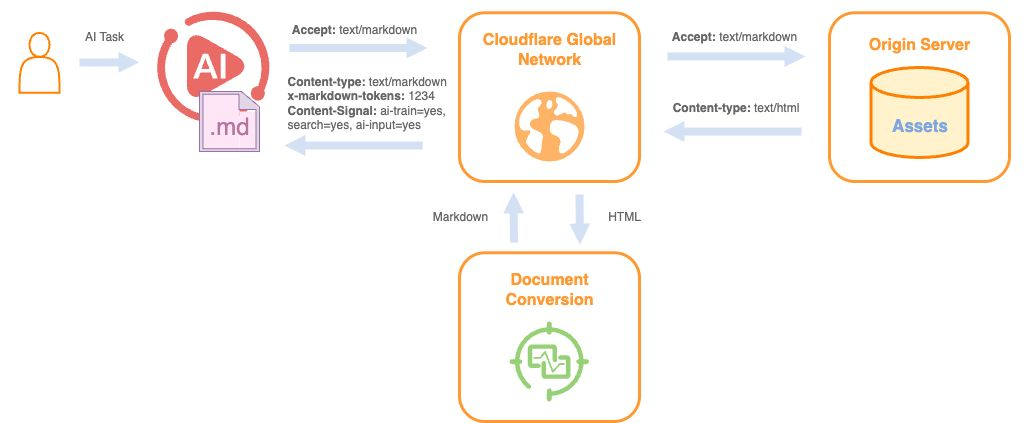

Lorsque l’agent demande la même page, il reçoit le HTML brut. Un article de blog ou une fiche produit peut contenir environ 16 000 tokens dans cette forme. Converti en Markdown propre, le nombre de tokens tombe à environ 3 000. Cela signifie que le contenu que le modèle doit traiter est réduit de 80 %. Pour une seule requête, cette différence peut être négligeable. Mais lorsque l’agent envoie des milliers de telles requêtes à travers plusieurs services, cette surcharge devient un facteur de latence, de coût et de complexité de raisonnement accru.

@Cloudflare

Finalement, les agents dépensent énormément de ressources pour éliminer les éléments d’interface, afin d’accéder à l’information essentielle pour agir. Cet effort n’améliore pas la qualité de la sortie, il compense un réseau qui n’a jamais été conçu pour eux.

Avec la croissance du trafic piloté par les agents, cette inefficacité devient plus flagrante. Les crawlers IA des sites de commerce et de logiciels ont considérablement augmenté l’année dernière, représentant aujourd’hui une grande partie de l’activité en ligne.

Par ailleurs, environ 79 % des principaux sites d’actualités et de contenu bloquent au moins un crawler IA. De leur point de vue, cette réaction est compréhensible. Lorsqu’un agent extrait du contenu, il n’interagit pas avec la publicité, les abonnements ou les entonnoirs de conversion traditionnels. Le bloquer protège leurs revenus.

Le problème est que le web ne dispose pas de méthodes fiables pour distinguer les crawlers malveillants des agents légitimes. Les deux apparaissent comme du trafic automatique, issus d’infrastructures cloud. Pour le système, ils sont indiscernables.

Plus profondément, les agents ne cherchent pas à « consommer » la page, mais à découvrir les possibilités d’action.

Lorsque l’humain recherche « billets d’avion à moins de 500 dollars », une simple liste de liens suffit. Il compare, décide. Mais pour un agent, il faut tout autre chose : connaître quels services acceptent les réservations, quels formats d’entrée ils requièrent, comment sont calculés les prix, si le paiement peut être automatisé. Très peu de services publient ces informations de façon claire.

@TowardsAI

C’est pourquoi la recherche évolue vers la découvrabilité orientée agent (Agent-Oriented Discoverability, AEO). Si l’utilisateur final est un agent, le classement dans la page de recherche devient moins crucial. L’essentiel est que le service décrive ses capacités dans un langage que l’agent peut comprendre sans deviner. Sinon, il risque de devenir « invisible » dans une économie en pleine croissance.

Les agents ont besoin d’identité

@Hackernoon

Une fois qu’un agent peut découvrir un service et initier une transaction, la question suivante est : comment l’autre côté sait-il avec qui il interagit ? En d’autres termes : l’identité.

Aujourd’hui, dans le système financier, les identités machine sont bien plus nombreuses que les identités humaines. Sur ce secteur, le ratio est d’environ 96 à 1. API, comptes de service, scripts d’automatisation, agents internes dominent l’infrastructure des institutions. La plupart n’ont jamais été conçus pour détenir du capital ou négocier. Ils exécutent des instructions prédéfinies, sans capacité de négociation, de choix de fournisseur ou de paiement sur open web.

Les agents autonomes changent cette donne. Si un agent peut déplacer directement des stablecoins ou déclencher un processus de paiement sans confirmation manuelle, la question centrale devient : « Qui l’a autorisé à payer ? »

C’est là que l’identité devient fondamentale, d’où le concept de « Know Your Agent » (Connaître votre agent).

Comme dans la finance où la vérification préalable est essentielle avant de permettre une transaction, les services avec lesquels l’agent interagit doivent vérifier trois choses avant d’accorder un accès au capital ou d’autoriser des opérations sensibles :

- Authenticité cryptographique : cet agent contrôle-t-il vraiment la clé qu’il prétend utiliser ?

- Autorisation : qui a accordé cette permission, et quelles sont ses limites ?

- Lien avec le monde réel : cet agent est-il associé à une entité légale responsable ?

Ces vérifications forment une pile d’identité :

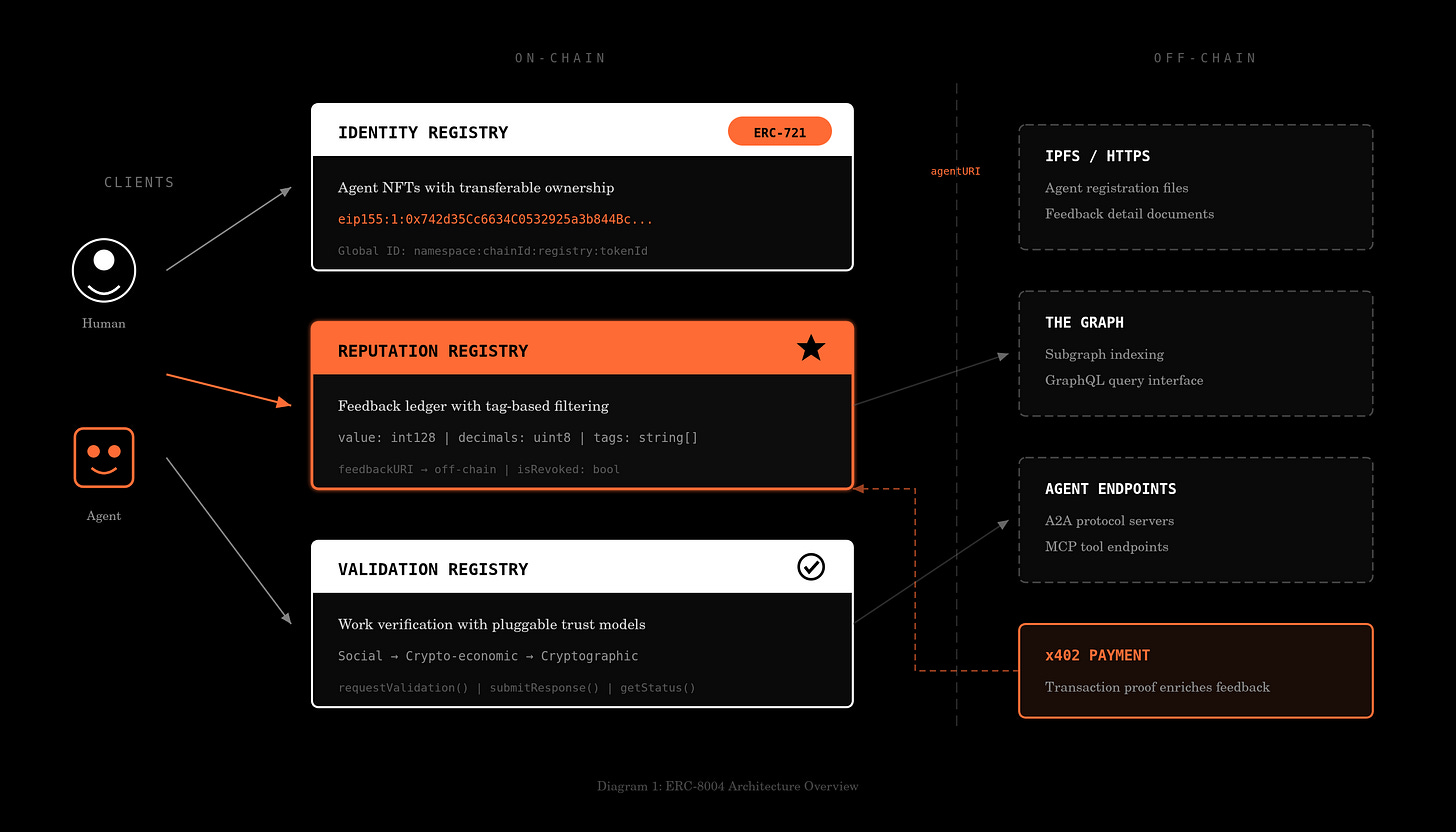

- La base est la cryptographie : génération et signature de clés. Des standards comme ERC-8004 tentent de formaliser la façon dont un agent peut s’enregistrer de façon vérifiable sur la blockchain.

- La couche intermédiaire est celle des fournisseurs d’identité. Elle relie la clé à une entité réelle — société enregistrée, institution financière ou personne vérifiée. Sans cette liaison, la signature ne prouve que le contrôle, pas la responsabilité.

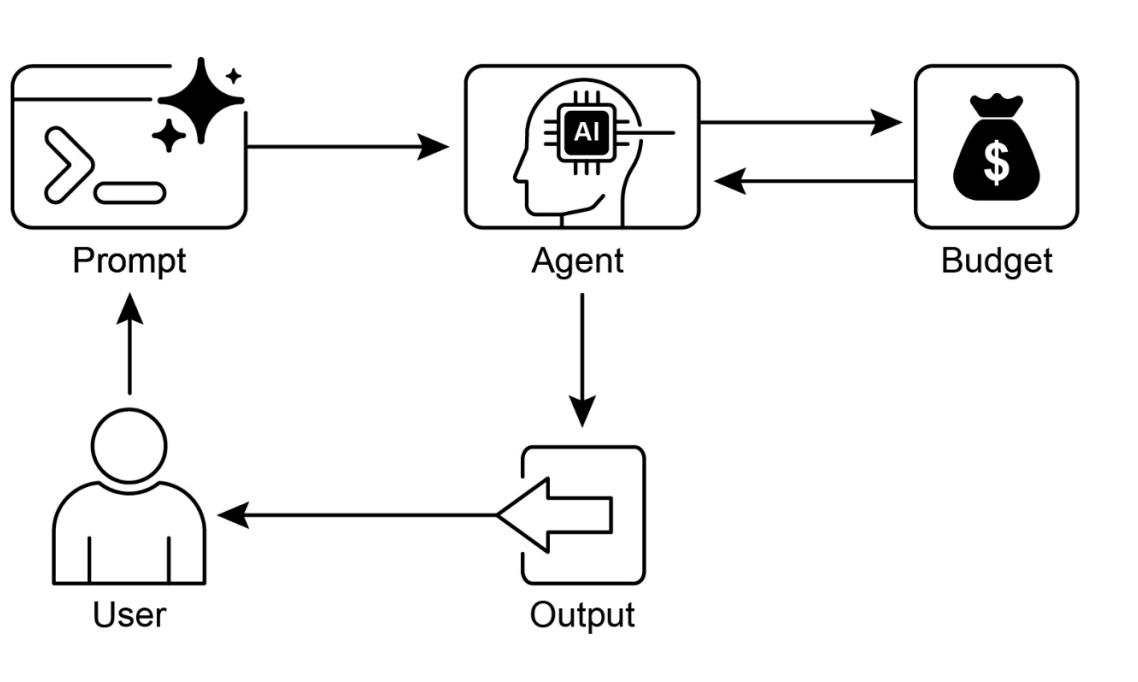

- La couche périphérique est celle de l’infrastructure de vérification : processeurs de paiement, CDN ou serveurs d’applications qui vérifient en temps réel la signature, contrôlent les certificats et appliquent les limites d’autorisation. Le Trusted Agent Protocol de Visa en est un exemple, permettant aux commerçants de vérifier si un agent est autorisé à agir pour un utilisateur spécifique. Le protocole ACP de Stripe pousse ces vérifications vers la facturation programmable et les flux de stablecoins.

Par ailleurs, des standards comme l’Universal Commerce Protocol (UCP), piloté par Google et Shopify, permettent aux commerçants de publier des « listes de capacités » que les agents peuvent découvrir et négocier. Ils servent de couche d’orchestration, intégrée potentiellement à Google Search et Gemini.

@FintechBrainfood

Une nuance importante : les systèmes sans permission et avec permission coexistent.

Sur la blockchain publique, un agent peut effectuer des transactions sans seuil centralisé. Cela augmente la rapidité et la composabilité, mais intensifie aussi la pression réglementaire. La récente acquisition de Bridge par Stripe illustre cette tension. Les stablecoins permettent des transferts transfrontaliers instantanés, mais les obligations réglementaires ne disparaissent pas parce que la transaction se fait sur la chaîne.

Cette tension implique inévitablement une implication réglementaire. Lorsqu’un agent autonome peut initier des transactions financières sans supervision humaine directe, la responsabilité devient incontournable. Le système financier ne peut pas laisser circuler du capital par des acteurs non identifiés ou non autorisés, même s’il s’agit de fragments logiciels.

Les cadres réglementaires sont en cours d’adoption. La loi sur l’IA du Colorado, entrée en vigueur le 1er février 2026, impose des exigences de responsabilité pour les systèmes automatisés à haut risque, et des législations similaires avancent dans le monde entier. À mesure que les agents prennent en charge des décisions financières à grande échelle, l’identité ne sera plus optionnelle. Si la découvrabilité permet de voir les agents, l’identité leur donne la légitimité.

Vérifier l’exécution des agents et leur réputation

Une fois qu’un agent commence à exécuter des tâches impliquant de l’argent, des contrats ou des données sensibles, la simple possession d’une identité ne suffit pas. Un agent vérifié peut toujours produire des illusions, déformer son travail, divulguer des informations ou mal fonctionner.

La question cruciale est donc : comment prouver que l’agent a bien accompli ce qu’il prétend ?

Si un agent affirme avoir analysé 1 000 fichiers, détecté des fraudes ou exécuté une stratégie de trading, il faut une méthode pour vérifier que ce calcul a bien été effectué, et que le résultat n’a pas été falsifié ou corrompu. Pour cela, nous avons besoin d’une couche de performance.

Trois approches existent actuellement :

- Environnements d’exécution fiables (Trusted Execution Environments, TEE) : la première repose sur des preuves matérielles via des technologies comme AWS Nitro ou Intel SGX. Dans ce mode, l’agent s’exécute dans une enclave sécurisée, qui émet un certificat cryptographique attestant que le code spécifique a été exécuté sur des données données, sans modification. La surcharge est généralement faible (5-10 % de latence supplémentaire), ce qui est acceptable pour des cas d’usage financiers ou d’entreprise où la confiance prime sur la vitesse.

- ZKML (Zero-Knowledge Machine Learning) : la deuxième méthode est mathématique. ZKML permet à l’agent de produire une preuve cryptographique que le résultat provient d’un modèle spécifique, sans révéler ses poids ou ses entrées privées. DeepProve-1 de Lagrange Labs a récemment démontré une preuve à connaissance zéro pour l’inférence GPT-2, avec une vitesse 54 à 158 fois plus rapide que les méthodes précédentes.

- Sécurité par staking (Restake Security) : la troisième approche repose sur des mécanismes économiques plutôt que computationnels. Des protocoles comme EigenLayer introduisent une sécurité basée sur le staking : les validateurs mettent en gage du capital derrière la sortie de l’agent. Si la sortie est contestée et prouvée fausse, le staking est slashed. Le système ne prouve pas chaque calcul, mais rend la mauvaise conduite économiquement irrationnelle.

Ces mécanismes abordent le même problème sous différents angles. Mais la preuve d’exécution est souvent ponctuelle. Elle vérifie une tâche unique, alors que le marché a besoin d’un historique cumulatif. C’est là que la réputation devient cruciale.

La réputation transforme une preuve ponctuelle en un historique de performance à long terme. Les systèmes émergents visent à rendre la performance des agents portable et enracinée cryptographiquement, plutôt que dépendante d’évaluations spécifiques à une plateforme ou de tableaux de bord opaques.

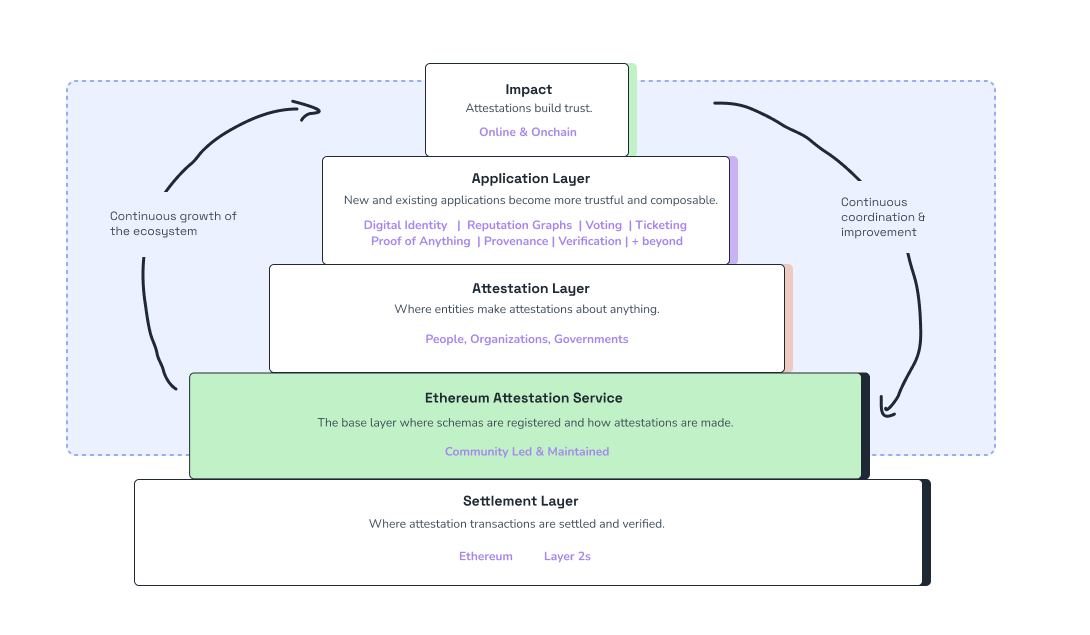

Ethereum Attestation Service (EAS) permet aux utilisateurs ou aux services de publier des attestations signées, enregistrées sur la blockchain, concernant le comportement d’un agent. Une tâche réussie, une prédiction précise ou une transaction conforme peuvent ainsi être enregistrées de façon inviolable, et suivies à travers différentes applications.

@EAS

Des environnements de référence compétitifs se forment également. Les Agent Arenas évaluent les agents selon des tâches standardisées, utilisant des systèmes de classement comme Elo. Recall Network rapporte que plus de 110 000 participants ont généré 5,88 millions de prédictions, créant des données de performance mesurables. Avec l’expansion de ces systèmes, ils ressemblent à de véritables marchés de notation pour les agents IA.

Cela permet à la réputation d’être transférée entre plateformes.

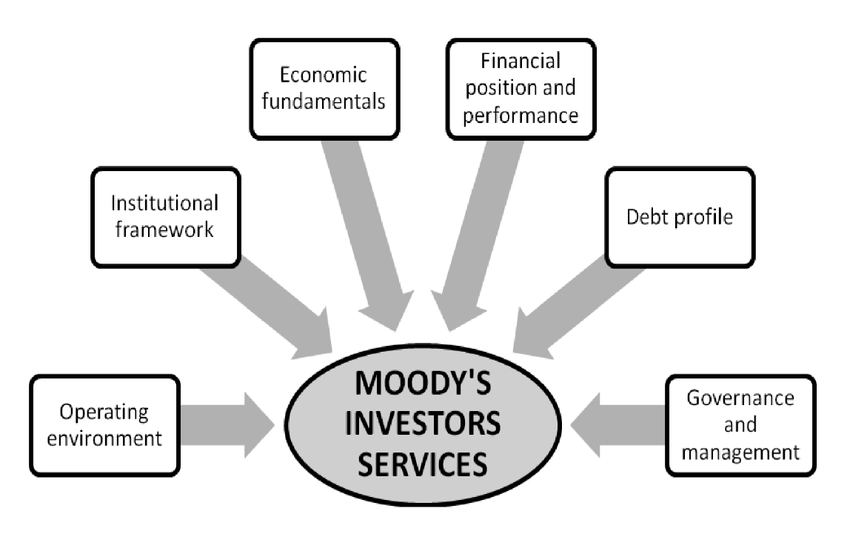

Dans la finance traditionnelle, des agences comme Moody’s émettent des notations de crédit pour donner des signaux de confiance. L’économie des agents nécessitera une couche équivalente pour évaluer la fiabilité des acteurs non humains. Le marché devra juger si un agent est suffisamment fiable pour engager du capital, si ses résultats sont statistiquement cohérents, et si son comportement peut rester stable à long terme.

Conclusion

À mesure que les agents acquièrent une véritable autorité, le marché aura besoin d’un moyen clair d’évaluer leur fiabilité. Les agents porteront des enregistrements vérifiables d’exécution et de performance, avec des scores ajustés en fonction de la qualité, et une traçabilité claire de leur autorisation. Les assureurs, les commerçants et les systèmes de conformité s’appuieront sur ces données pour décider quels agents peuvent accéder au capital, aux données ou à des workflows réglementés.

En résumé, ces couches constituent l’infrastructure de l’économie des agents :

- Découvrabilité (Discoverability) : les agents doivent pouvoir découvrir les services de façon machine-lisible, sinon ils ne pourront pas saisir d’opportunités.

- Identité (Identity) : ils doivent prouver qui ils sont et qui les a autorisés, sinon ils ne peuvent pas entrer dans le système.

- Réputation (Reputation) : ils doivent construire un historique vérifiable de fiabilité, pour gagner une confiance économique durable.