Anthropic poursuit le gouvernement de Trump : l'étiquette « risque de chaîne d'approvisionnement » constitue une représaille illégale

L’entreprise d’intelligence artificielle Claude, développée par Anthropic, a intenté lundi une action en justice contre le gouvernement Trump en Californie, l’accusant d’avoir lancé une « action de représailles illégale » parce qu’Anthropic refuse de permettre à l’armée d’utiliser ses technologies sans restriction — y compris pour des armes autonomes létales et la surveillance intérieure à grande échelle. C’est la première fois dans l’histoire des États-Unis qu’une entreprise locale est reconnue comme un risque dans la chaîne d’approvisionnement militaire.

Étiquette de risque dans la chaîne d’approvisionnement : reconnaissance sans précédent du Pentagone

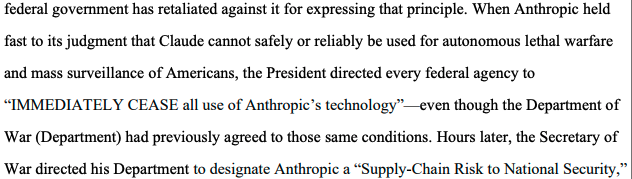

Le point de départ de cette bataille juridique est une décision finale du 3 mars 2026 du secrétaire à la Défense Pete Hegseth : classer Anthropic comme une entreprise à risque dans la chaîne d’approvisionnement militaire. Les conséquences légales de cette reconnaissance sont directes et graves — toute personne ou entreprise ayant des relations avec l’armée ne pourra plus faire de transactions avec Anthropic, ce qui revient à l’exclure complètement du marché des achats fédéraux.

Il est important de noter que cette reconnaissance de risque dans la chaîne d’approvisionnement a été jusqu’ici réservée aux entreprises soupçonnées d’être liées à des forces étrangères hostiles, et n’a jamais été appliquée à une entreprise américaine locale. Anthropic qualifie cette pratique d’« inédite et illégale » dans sa plainte, affirmant que « la Constitution n’autorise pas le gouvernement à utiliser son immense pouvoir pour punir une entreprise pour ses discours protégés. »

Le recours juridique vise un large éventail de défendeurs, comprenant Pete Hegseth (secrétaire à la Défense), Scott Bessent (secrétaire au Trésor), Marco Rubio (secrétaire d’État) et 17 autres agences et responsables gouvernementaux, couvrant plusieurs secteurs clés du gouvernement fédéral américain.

La ligne rouge d’Anthropic : armes létales et surveillance de masse

(Source : CourtListener)

(Source : CourtListener)

Selon les déclarations d’Anthropic dans la plainte, Hegseth aurait exigé que l’entreprise « abandonne complètement ses restrictions d’utilisation » — ce à quoi Anthropic a refusé, car ces restrictions font partie intégrante de ses contrats avec le gouvernement, visant à empêcher que Claude soit utilisé pour deux usages spécifiques :

Systèmes d’armes autonomes létales : des systèmes de décision de frappe automatisés sans confirmation humaine finale

Surveillance de masse des citoyens américains : collecte et analyse à grande échelle des données personnelles des citoyens à l’aide de l’IA

Anthropic indique clairement dans la plainte : « Anthropic n’a jamais testé Claude pour ces usages. Actuellement, Anthropic n’est pas convaincu que Claude puisse fonctionner de manière fiable ou sûre si utilisé pour soutenir une guerre autonome létale. »

Cette position est cohérente avec la priorité d’Anthropic en matière de sécurité de l’IA, mais entre en conflit fondamental avec la politique du gouvernement Trump d’étendre l’utilisation militaire de l’IA. Il est à noter que depuis 2024, le gouvernement américain et le Pentagone utilisent la technologie d’Anthropic, et Claude est le premier IA déployée dans un environnement confidentiel. La reconnaissance de cette étiquette s’accompagne également d’un ordre direct de Trump aux employés fédéraux de cesser d’utiliser Claude.

Soutien collectif de l’industrie : ingénieurs d’OpenAI et Google en appui

Après le déclenchement de cette bataille juridique, la réaction dans le secteur de l’IA a été rapide et large. Lundi, plus de 30 ingénieurs et scientifiques d’OpenAI et Google, dont le scientifique en chef de Google Jeff Dean, ont soumis un mémoire d’amicus en soutien à Anthropic.

Ces professionnels avertissent dans leur document : « Permettre la poursuite de telles actions de punition contre l’un des leaders américains de l’IA nuirait sans doute à la compétitivité industrielle et scientifique des États-Unis dans l’intelligence artificielle et d’autres domaines. » Leur message reflète une inquiétude plus large : si le gouvernement américain utilise la chaîne d’approvisionnement comme prétexte pour réprimer les entreprises d’IA nationales, cela pourrait affaiblir l’avantage stratégique des États-Unis face à la Chine dans la course mondiale à l’IA.

Questions fréquentes

Quel est l’impact concret de l’étiquette de risque dans la chaîne d’approvisionnement pour Anthropic ?

Selon la loi américaine, être classé comme entreprise à risque dans la chaîne d’approvisionnement signifie que toute personne ou entité ayant des relations avec l’armée ne peut pas faire de transactions avec cette entreprise. Cela revient à exclure Anthropic de tout le marché des achats fédéraux, affectant non seulement ses contrats militaires directs, mais aussi tous ses fournisseurs et partenaires ayant des relations avec le gouvernement.

Pourquoi Anthropic refuse-t-elle d’autoriser l’utilisation pour des armes létales ?

Anthropic affirme que Claude n’a jamais été testé ni évalué pour ces usages. La société ne peut pas garantir la fiabilité ou la sécurité dans ces scénarios. De plus, ses principes de sécurité de l’IA s’opposent à la mise en œuvre de systèmes de décision autonomes à haut risque sans tests approfondis, surtout dans des contextes militaires où des vies sont en jeu.

Que signifie le soutien des ingénieurs d’OpenAI et Google à Anthropic ?

Le soutien de plus de 30 ingénieurs et scientifiques issus de concurrents montre l’inquiétude de l’industrie de l’IA face à l’intervention du gouvernement via l’étiquette de chaîne d’approvisionnement. Leur message souligne un intérêt commun : si le gouvernement peut utiliser cet outil pour réprimer des entreprises d’IA qui ne se plient pas, toute société refusant de lever ses restrictions techniques pourrait faire face au même sort.