Anthropic Gugat Pemerintah Trump: Label "Risiko Rantai Pasokan" adalah Balas Dendam Ilegal

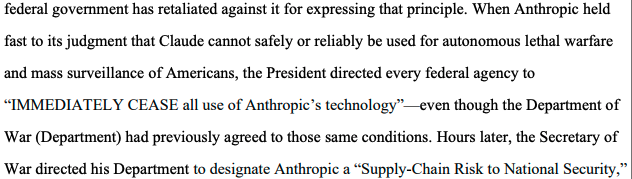

Perangkat lunak kecerdasan buatan Claude dikembangkan oleh Anthropic pada hari Senin mengajukan gugatan di pengadilan federal California terhadap pemerintahan Trump, menuduh pemerintah melakukan “tindakan balas dendam ilegal” karena Anthropic menolak mengizinkan militer menggunakan teknologinya tanpa batas—termasuk untuk senjata otonom mematikan dan pengawasan domestik massal. Ini adalah kali pertama dalam sejarah AS sebuah perusahaan domestik diakui sebagai risiko rantai pasokan militer.

Label Risiko Rantai Pasokan: Pengakuan Tak Terbantahkan dari Pentagon

Awal dari perang hukum ini adalah keputusan Menteri Pertahanan Pete Hegseth pada 3 Maret 2026 yang akhirnya menetapkan Anthropic sebagai perusahaan risiko rantai pasokan militer. Konsekuensi hukum dari pengakuan ini sangat langsung dan serius—setiap individu atau perusahaan yang berbisnis dengan militer tidak boleh melakukan transaksi dengan Anthropic, yang secara efektif mengeluarkannya dari pasar pengadaan federal.

Perlu dicatat bahwa pengakuan risiko rantai pasokan ini sebelumnya hanya digunakan untuk perusahaan yang diduga terkait dengan kekuatan asing musuh, dan belum pernah berlaku untuk perusahaan domestik AS. Dalam gugatan, Anthropic menyebut tindakan ini sebagai “tak terduga dan ilegal,” dan berpendapat: “Konstitusi tidak mengizinkan pemerintah menggunakan kekuasaan besar untuk menghukum perusahaan atas ucapan yang dilindungi.”

Daftar tergugat dalam gugatan ini sangat besar, termasuk Pete Hegseth (Menteri Pertahanan), Scott Bessent (Menteri Keuangan), Marco Rubio (Menteri Luar Negeri), dan 17 lembaga serta pejabat pemerintah lainnya, mencakup beberapa departemen inti dari pemerintah federal AS.

Garis Merah Inti Anthropic: Senjata Mematikan dan Pengawasan Massal

(Sumber: CourtListener)

(Sumber: CourtListener)

Menurut pernyataan Anthropic dalam gugatan, Hegseth menuntut perusahaan tersebut “sepenuhnya melepaskan batasan penggunaannya”—yang ditolak oleh Anthropic karena batasan tersebut merupakan bagian dari kontrak pemerintah mereka, yang bertujuan mencegah Claude digunakan untuk dua tujuan tertentu:

Sistem senjata otonom mematikan: sistem keputusan pembunuhan otomatis yang tidak memerlukan konfirmasi akhir dari manusia

Pengawasan massal terhadap warga AS: menggunakan teknologi AI untuk pengumpulan dan analisis data pribadi warga secara besar-besaran

Dalam gugatan, Anthropic secara tegas menyatakan: “Anthropic belum pernah menguji Claude untuk tujuan ini. Saat ini, Anthropic tidak yakin apakah Claude dapat berjalan secara andal atau aman jika digunakan untuk mendukung perang otonom yang mematikan.”

Pernyataan ini sejalan dengan prinsip prioritas keamanan AI jangka panjang yang dianut Anthropic, tetapi bertentangan secara mendasar dengan kebijakan ekspansi aplikasi militer AI oleh pemerintahan Trump. Perlu dicatat bahwa sejak 2024, pemerintah AS dan Pentagon telah menggunakan teknologi Anthropic, dan Claude adalah AI pertama yang diterapkan di lingkungan kerja rahasia. Pengakuan label ini juga disertai perintah langsung dari Trump kepada pegawai federal untuk berhenti menggunakan Claude melalui instruksi eksekutif.

Dukungan Bersama dari Insinyur OpenAI dan Google: Respons Kolektif Industri AI

Setelah perang hukum ini pecah, respons dari industri AI sangat cepat dan luas. Pada hari Senin, lebih dari 30 insinyur dan ilmuwan dari OpenAI dan Google, termasuk Kepala Ilmuwan Google Jeff Dean, mengajukan dokumen pendukung hukum (amicus brief) yang secara terbuka mendukung Anthropic.

Para profesional ini dalam dokumen memperingatkan: “Jika tindakan menghukum salah satu perusahaan AI terkemuka di AS ini terus berlanjut, tentu akan berdampak negatif terhadap daya saing industri dan ilmu pengetahuan AS di bidang kecerdasan buatan dan bidang lainnya.” Pernyataan ini mengarah pada kekhawatiran yang lebih besar—jika pemerintah AS menggunakan risiko rantai pasokan sebagai alasan untuk menekan perusahaan AI domestik, hal ini dapat melemahkan keunggulan utama AS dalam kompetisi AI global melawan China.

Pertanyaan Umum

Apa dampak spesifik dari label risiko rantai pasokan terhadap Anthropic?

Menurut hukum AS, perusahaan yang diklasifikasikan sebagai risiko rantai pasokan berarti setiap individu atau entitas yang berbisnis dengan militer tidak boleh melakukan transaksi dengan perusahaan tersebut. Ini secara efektif memutus Anthropic dari seluruh ekosistem pengadaan federal, mempengaruhi tidak hanya kontrak militer langsung, tetapi juga semua pemasok dan mitra yang berurusan dengan pemerintah.

Mengapa Anthropic menolak membuka penggunaan terkait senjata mematikan?

Posisi Anthropic adalah bahwa Claude belum pernah diuji atau dievaluasi keamanannya untuk skenario senjata mematikan. Perusahaan saat ini tidak dapat memastikan keandalan dan keamanan penggunaannya dalam aplikasi tersebut. Selain itu, prinsip keamanan AI yang dianut Anthropic menentang penerapan sistem keputusan otonom berisiko tinggi tanpa pengujian yang memadai, terutama yang melibatkan nyawa manusia dalam konteks militer.

Apa arti dukungan dari insinyur Google dan OpenAI terhadap Anthropic?

Dukungan dari 30 insinyur dan ilmuwan dari perusahaan pesaing ini mencerminkan kekhawatiran industri AI terhadap intervensi pemerintah melalui label risiko rantai pasokan. Mereka menyoroti bahwa jika pemerintah dapat menggunakan alat ini untuk menekan perusahaan AI yang tidak patuh, perusahaan lain yang menolak membuka batasan teknologi juga bisa menghadapi nasib yang sama.