Huang Renxun GTC Pidato Lengkap: Era Penalaran Tiba, Lobster adalah Sistem Operasi Baru

Sumber: Wall Street Journal

16 Maret 2026, konferensi GTC 2026 NVIDIA resmi dibuka, pendiri sekaligus CEO NVIDIA Huang Renxun menyampaikan pidato utama.

Dalam konferensi yang dianggap sebagai “Ziarah Tahunan Industri AI”, Huang menjelaskan transformasi NVIDIA dari sebuah “perusahaan chip” menjadi “perusahaan infrastruktur dan pabrik AI”. Menghadapi kekhawatiran pasar tentang keberlanjutan kinerja dan ruang pertumbuhan, Huang secara rinci menguraikan logika bisnis dasar yang mendorong pertumbuhan masa depan—“Token Factory Economics”.

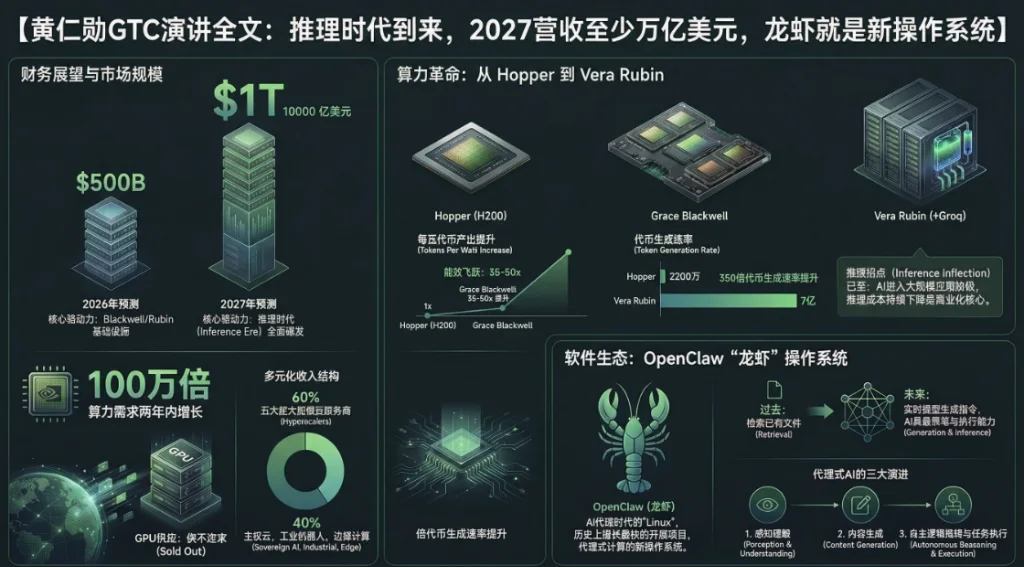

Panduan kinerja sangat optimis, “permintaan minimal 1 triliun dolar AS pada 2027”

Dua tahun terakhir, permintaan komputasi AI global melonjak secara eksponensial. Seiring model besar berkembang dari “persepsi”, “generasi” ke “penalaran” dan “tindakan (pelaksanaan tugas)”, konsumsi daya komputasi meningkat tajam. Menanggapi kekhawatiran pasar tentang batas pesanan dan pendapatan, Huang memberikan prediksi yang sangat kuat.

Dalam pidatonya, Huang secara langsung menyatakan:

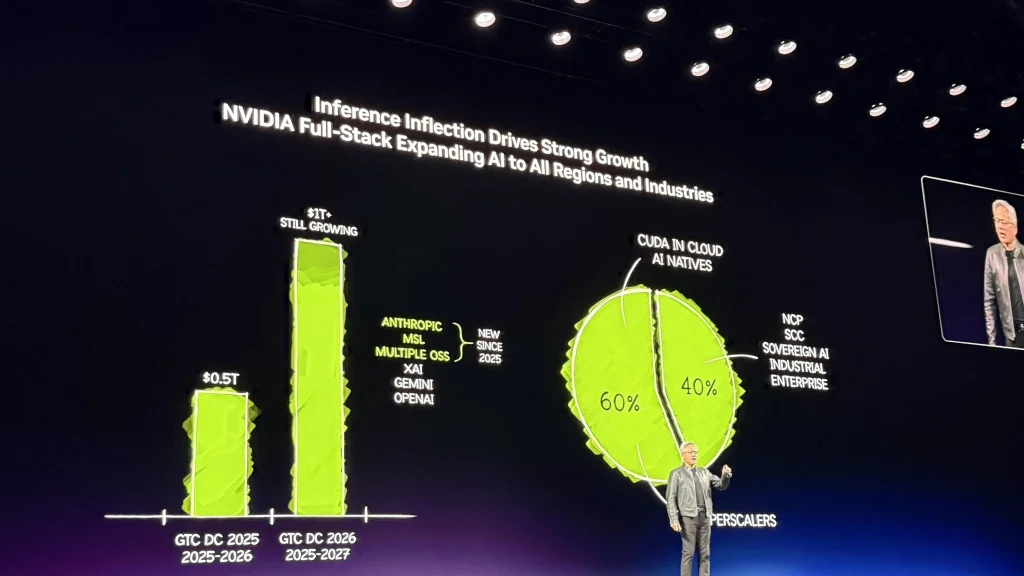

Tahun lalu saat ini, saya mengatakan bahwa kami melihat permintaan sebesar 500 miliar dolar AS dengan tingkat kepercayaan tinggi, mencakup Blackwell dan Rubin hingga 2026. Sekarang, tepat di sini dan saat ini, saya melihat permintaan minimal 1 triliun dolar AS pada 2027.

Prediksi Huang tentang triliun dolar ini sempat mendorong harga saham NVIDIA naik lebih dari 4.3%.

Lebih dari itu, dia menambahkan angka tersebut:

Apakah ini masuk akal? Itu yang akan saya bahas selanjutnya. Faktanya, kita bahkan akan kekurangan pasokan. Saya yakin, kebutuhan komputasi nyata akan jauh lebih tinggi dari ini.

Huang menunjukkan bahwa sistem NVIDIA saat ini telah membuktikan dirinya sebagai “infrastruktur termurah di dunia”. Karena NVIDIA dapat menjalankan hampir semua model AI di berbagai bidang, fleksibilitas ini memungkinkan pelanggan memanfaatkan penuh triliun dolar yang diinvestasikan dan menjaga siklus hidup yang panjang.

Saat ini, 60% bisnis NVIDIA berasal dari lima penyedia layanan cloud terbesar, sementara 40% lainnya tersebar luas di cloud berdaulat, perusahaan, industri, robot, dan komputasi tepi.

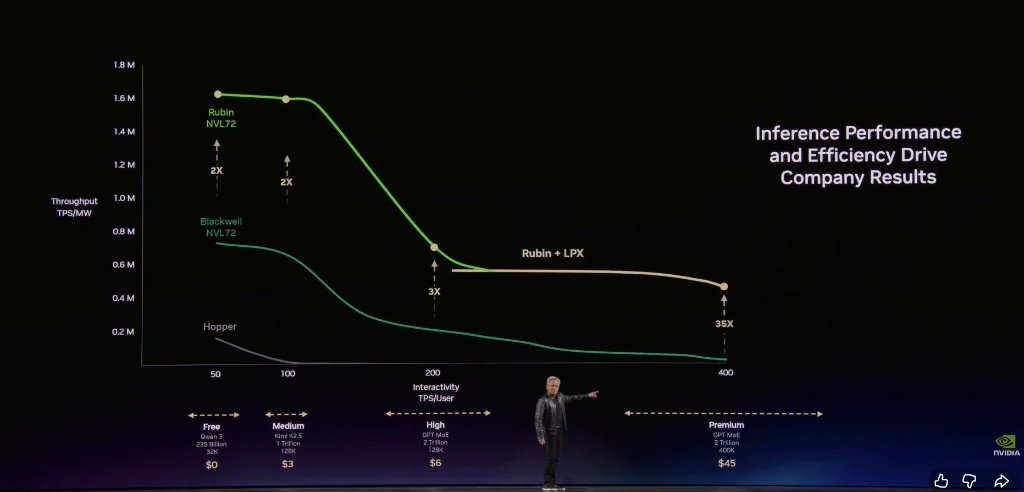

Token Factory Economics, performa per watt menentukan nyawa bisnis

Untuk menjelaskan rasionalitas permintaan sebesar 1 triliun dolar ini, Huang memperkenalkan pola pikir bisnis baru kepada CEO perusahaan global. Dia menunjukkan bahwa pusat data masa depan tidak lagi menjadi gudang penyimpanan file, melainkan “pabrik” yang memproduksi Token (unit dasar yang dihasilkan AI).

Huang menegaskan:

Setiap pusat data, setiap pabrik, secara definisi dibatasi oleh listrik. Sebuah pabrik 1GW (gigawatt) tidak akan pernah menjadi 2GW, itu hukum fisika dan atom. Dengan daya tetap, siapa yang mampu menghasilkan throughput Token per watt tertinggi, biaya produksi mereka paling rendah.

Huang membagi layanan AI masa depan ke dalam tingkatan bisnis berikut:

Layer Gratis (tinggi throughput, kecepatan rendah)

Layer Menengah (~$3 per juta token)

Layer Tinggi (~$6 per juta token)

Layer Kecepatan Tinggi (~$45 per juta token)

Layer Super Kecepatan (~$150 per juta token)

Dia menunjukkan bahwa semakin besar model dan semakin panjang konteksnya, AI akan menjadi lebih pintar, tetapi kecepatan pembuatan Token akan menurun. Huang menyatakan:

Dalam pabrik Token ini, throughput dan kecepatan pembuatan Token Anda akan langsung mengubah pendapatan akurat tahun depan.

Huang menegaskan bahwa arsitektur NVIDIA memungkinkan pelanggan mencapai throughput sangat tinggi di layer gratis, sementara di layer inferensi bernilai tertinggi, performa dapat ditingkatkan hingga 35 kali lipat.

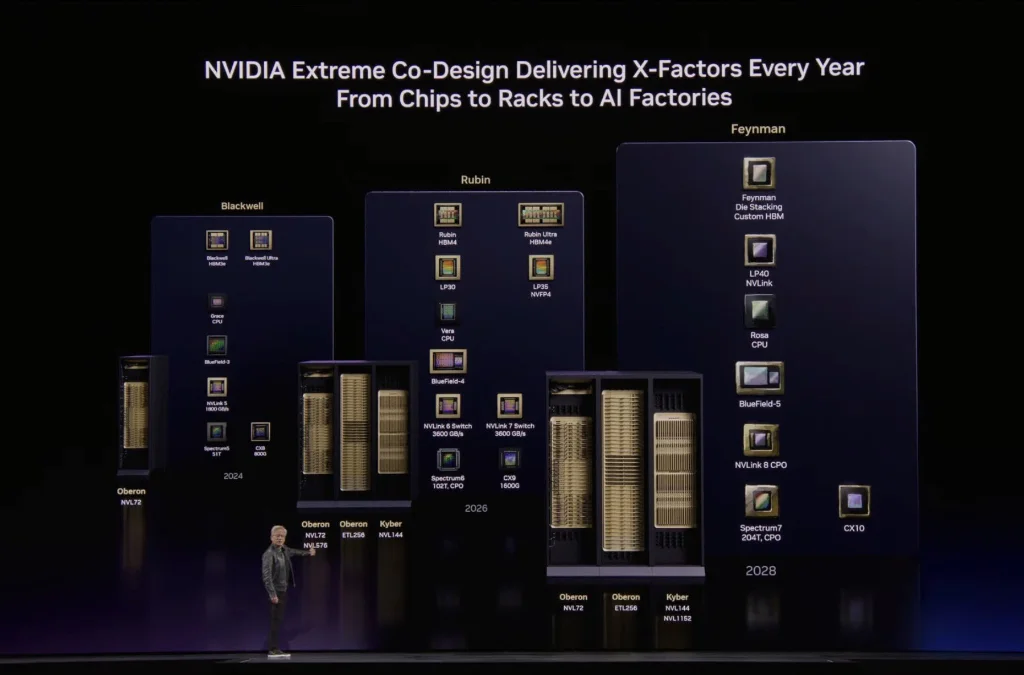

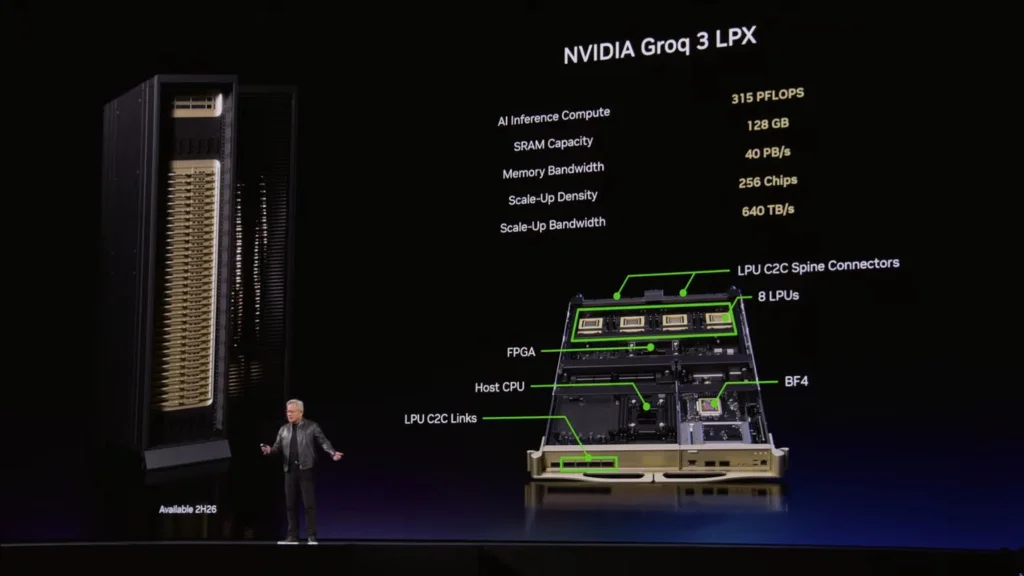

Vera Rubin dalam dua tahun mencapai percepatan 350 kali, Groq mengisi celah inferensi super cepat

Dalam batasan batas fisik ini, NVIDIA memperkenalkan sistem komputasi AI paling kompleks yang pernah ada, Vera Rubin. Huang menyatakan:

Dulu saya menunjukkan Hopper, saya angkat sebuah chip, itu lucu. Tapi saat menyebut Vera Rubin, yang terbayang adalah seluruh sistem. Dalam sistem ini yang 100% cair pendingin, yang menghilangkan kabel tradisional, rak yang dulu membutuhkan dua hari pemasangan, sekarang hanya dua jam.

Huang menunjukkan bahwa melalui desain kolaboratif perangkat lunak dan perangkat keras yang ekstrem, Vera Rubin mampu menciptakan lonjakan data yang mengagumkan di pusat data 1GW yang sama:

Dalam dua tahun singkat, kami meningkatkan kecepatan pembuatan Token dari 22 juta menjadi 700 juta per detik, meningkat 350 kali lipat. Hukum Moore hanya mampu memberi peningkatan sekitar 1,5 kali selama periode yang sama.

Untuk mengatasi bottleneck bandwidth dalam inferensi super cepat (misalnya 1000 Token/detik), NVIDIA mengintegrasikan solusi akhir dari akuisisi perusahaan Groq: inferensi terpisah secara asimetris. Huang menjelaskan:

Karakteristik kedua prosesor ini sangat berbeda. Chip Groq memiliki 500MB SRAM, sedangkan satu Rubin memiliki 288GB memori.

Huang menunjukkan bahwa melalui sistem perangkat lunak Dynamo, NVIDIA membagi tahap pre-fill (pengisian awal) dan decoding (penafsiran) yang sangat sensitif terhadap latensi ke Vera Rubin, sementara tahap decoding yang sangat bergantung bandwidth dan latensi rendah diserahkan ke Groq. Huang juga memberi saran konfigurasi kapasitas komputasi:

Jika pekerjaan utama Anda adalah throughput tinggi, gunakan 100% Vera Rubin; jika Anda membutuhkan banyak token bernilai tinggi, alokasikan sekitar 25% pusat data ke Groq.

Diketahui bahwa chip Groq LP30 yang diproduksi Samsung sudah dalam produksi massal dan diperkirakan akan dikirimkan kuartal ketiga, sementara rak Vera Rubin pertama sudah berjalan di cloud Microsoft Azure.

Selain itu, terkait teknologi koneksi optik, Huang menampilkan switch optik terkemuka dunia Spectrum X yang sudah massal, dan menenangkan kekhawatiran pasar tentang “kabel tembaga mundur, optik maju”:

Kami membutuhkan kapasitas kabel tembaga lebih banyak, kapasitas chip optik lebih banyak, dan kapasitas CPO lebih banyak.

Agent mengakhiri era SaaS tradisional, “gaji tahunan + Token” jadi standar Silicon Valley

Selain hambatan perangkat keras, Huang banyak membahas revolusi perangkat lunak dan ekosistem AI, terutama ledakan Agent (agen cerdas).

Dia menyebut proyek open source OpenClaw sebagai “proyek open source paling populer dalam sejarah manusia”, yang dalam beberapa minggu melampaui pencapaian Linux selama 30 tahun. Huang secara tegas menyatakan bahwa OpenClaw pada dasarnya adalah “sistem operasi” untuk komputer agen.

Huang menyatakan:

Setiap perusahaan SaaS akan berubah menjadi perusahaan AaaS (Agent-as-a-Service, agen sebagai layanan). Tidak diragukan lagi, untuk memastikan agen yang mampu mengakses data sensitif dan menjalankan kode secara aman, NVIDIA meluncurkan desain referensi NeMo Claw tingkat perusahaan, menambahkan mesin kebijakan dan router privasi.

Bagi pekerja biasa, revolusi ini juga sangat dekat. Huang menggambarkan bentuk baru tempat kerja di masa depan:

Di masa depan, setiap insinyur perusahaan kita akan memiliki anggaran Token tahunan. Gaji dasar mereka mungkin puluhan ribu dolar, dan saya akan menyediakan sekitar separuh dari jumlah itu sebagai kuota Token mereka, agar mereka dapat meningkatkan efisiensi 10 kali lipat. Ini sudah menjadi alat rekrutmen baru di Silicon Valley: berapa banyak Token dalam tawaran kerja Anda?

Di akhir pidato, Huang membocorkan arsitektur komputasi generasi berikutnya, Feynman, yang akan pertama kali mencapai skala bersama antara kabel tembaga dan CPO. Lebih menarik lagi, NVIDIA sedang mengembangkan dan menempatkan pusat data di luar angkasa, “Vera Rubin Space-1”, membuka ruang imajinasi tentang perluasan kekuatan AI ke luar bumi.

Teks lengkap pidato Huang di GTC 2026, diterjemahkan secara lengkap (dengan bantuan alat AI):

Pembawa acara: Selamat datang CEO dan pendiri NVIDIA Huang Renxun ke panggung.

Huang Renxun, Pendiri dan CEO:

Selamat datang di GTC. Saya ingin mengingatkan bahwa ini adalah konferensi teknologi. Sangat menyenangkan melihat begitu banyak orang antre sejak pagi, dan melihat kehadiran Anda semua di sini.

Di GTC, kita akan fokus pada tiga tema utama: teknologi, platform, dan ekosistem. NVIDIA saat ini memiliki tiga platform utama: platform CUDA-X, platform sistem, dan platform pabrik AI terbaru kami.

Sebelum memulai, saya ingin berterima kasih kepada pembawa acara sesi pemanasan kita—Sarah Guo dari Conviction, Alfred Lin dari Sequoia Capital (investor ventura pertama NVIDIA), dan Gavin Baker, investor utama pertama NVIDIA. Ketiganya memiliki wawasan mendalam tentang teknologi dan pengaruh luas dalam ekosistem teknologi. Tentu, saya juga berterima kasih kepada semua tamu undangan yang saya undang secara pribadi hari ini. Terima kasih kepada tim bintang ini.

Saya juga berterima kasih kepada semua perusahaan yang hadir hari ini. NVIDIA adalah perusahaan platform, dengan teknologi, platform, dan ekosistem yang kaya. Perwakilan perusahaan yang hadir mewakili hampir seluruh peserta industri bernilai 100 triliun dolar AS, sebanyak 450 perusahaan mensponsori acara ini, dan saya mengucapkan terima kasih.

Konferensi ini akan menampilkan 1.000 forum teknologi dan 2.000 pembicara, mencakup setiap lapisan dari arsitektur “lima lapisan kue” AI—dari infrastruktur dasar seperti tanah, listrik, dan data center, hingga chip, platform, model, dan berbagai aplikasi yang mendorong industri ini melesat.

CUDA: Dua puluh tahun akumulasi teknologi

Semua berawal dari sini. Tahun ini adalah ulang tahun kedua puluh CUDA.

Selama dua dekade, kami terus mengembangkan arsitektur ini. CUDA adalah inovasi revolusioner—teknologi SIMT (Single Instruction Multiple Thread) memungkinkan pengembang menulis kode skalar dan memperluasnya ke aplikasi multi-thread, jauh lebih mudah daripada arsitektur SIMD sebelumnya. Baru-baru ini, kami menambahkan fitur Tiles untuk memudahkan pemrograman Tensor Core dan berbagai struktur matematika yang menjadi dasar AI saat ini. Saat ini, CUDA memiliki ribuan alat, compiler, kerangka kerja, dan pustaka, serta ratusan ribu proyek terbuka di komunitas open source, dan telah terintegrasi secara mendalam ke dalam setiap ekosistem teknologi.

Diagram ini mengungkapkan logika strategi NVIDIA 100%, yang selalu saya sampaikan sejak awal. Elemen paling sulit dan paling inti adalah “volume instalasi” di bagian bawah diagram. Setelah dua puluh tahun, kami telah mengumpulkan ratusan juta GPU dan sistem komputasi yang menjalankan CUDA di seluruh dunia.

GPU kami meliputi semua cloud, melayani hampir semua produsen komputer dan industri. Volume instalasi GPU ini adalah mesin penggerak utama dari roda ekonomi ini. Volume menarik pengembang, mereka menciptakan algoritma baru dan melakukan inovasi, inovasi menciptakan pasar baru, pasar baru membangun ekosistem baru dan menarik lebih banyak perusahaan, sehingga volume instalasi terus bertambah—roda ini terus mempercepat.

Unduhan CUDA dari NVIDIA meningkat pesat, besar dan terus bertumbuh. Roda ini mendukung platform komputasi kami untuk menampung aplikasi dalam jumlah besar dan inovasi tak henti.

Lebih dari itu, ini memberi umur panjang pada infrastruktur dasar ini. Sebab, aplikasi yang berjalan di CUDA sangat beragam—menyangkut setiap tahap siklus hidup AI, berbagai platform data, dan berbagai solver ilmiah. Jadi, begitu GPU NVIDIA terpasang, nilai penggunaannya sangat tinggi. Itulah sebabnya GPU arsitektur Ampere yang kami rilis enam tahun lalu malah harganya di cloud meningkat.

Semua ini karena volume instalasi besar, roda penggerak yang kuat, dan ekosistem pengembang yang luas. Ketika faktor-faktor ini bekerja sama, ditambah pembaruan perangkat lunak secara berkelanjutan, biaya komputasi akan terus menurun. Percepatan komputasi meningkatkan kinerja aplikasi secara besar-besaran, dan dengan pemeliharaan serta iterasi perangkat lunak jangka panjang, pengguna tidak hanya mendapatkan lonjakan kinerja awal, tetapi juga penurunan biaya komputasi secara berkelanjutan. Kami berkomitmen mendukung GPU global secara jangka panjang karena arsitekturnya sepenuhnya kompatibel.

Kami bersedia melakukan ini karena volume instalasi sangat besar—setiap kali kami melakukan optimisasi baru, jutaan pengguna akan merasakan manfaatnya. Kombinasi dinamis ini memperluas jangkauan NVIDIA, mempercepat pertumbuhan kami sendiri, dan secara bersamaan menurunkan biaya komputasi, mendorong pertumbuhan baru. CUDA adalah inti dari semua ini.

Dari GeForce ke CUDA: perjalanan 25 tahun

Perjalanan kami bersama CUDA sebenarnya sudah dimulai 25 tahun lalu.

GeForce—saya yakin banyak di sini yang tumbuh bersama GeForce. GeForce adalah proyek pemasaran paling sukses NVIDIA. Kami mulai membangun basis pelanggan masa depan saat kalian belum mampu membeli produk—orang tua kalian yang menjadi pengguna awal NVIDIA, membeli produk kami tahun demi tahun, sampai akhirnya kalian tumbuh menjadi ilmuwan komputer yang hebat, dan menjadi pelanggan serta pengembang sejati.

Ini adalah fondasi yang didirikan GeForce 25 tahun lalu. Lima tahun setelahnya, kami menciptakan shader yang dapat diprogram—penemuan yang jelas dan berpengaruh besar untuk membuat akselerator dapat diprogram, dan merupakan akselerator pertama di dunia yang dapat diprogram, yaitu pixel shader. Lima tahun kemudian, kami meluncurkan CUDA—investasi terpenting kami sepanjang sejarah. Saat itu, perusahaan memiliki sumber daya terbatas, tetapi kami menginvestasikan sebagian besar keuntungan untuk memperluas CUDA dari GeForce ke setiap komputer. Keyakinan ini didasarkan pada potensi besar CUDA. Meski awalnya penuh tantangan, kami bertahan selama 13 generasi, selama dua puluh tahun, dan kini CUDA ada di mana-mana.

Pixel shader mendorong revolusi GeForce. Sekitar delapan tahun lalu, kami meluncurkan RTX—yang merevolusi arsitektur grafis komputer modern. GeForce membawa CUDA ke seluruh dunia, dan berkat itu, banyak ilmuwan seperti Alex Krizhevsky, Ilya Sutskever, Geoffrey Hinton, dan Andrew Ng menyadari bahwa GPU bisa menjadi alat percepat pembelajaran mendalam, memicu ledakan AI sepuluh tahun lalu.

Sepuluh tahun lalu, kami memutuskan menggabungkan shader yang dapat diprogram dengan dua ide baru: pertama, hardware ray tracing (Pelacakan Sinar), yang secara teknologi sangat menantang; kedua, gagasan visioner sekitar sepuluh tahun lalu—kami sudah memprediksi AI akan mengubah total cara kerja grafis komputer. Seperti GeForce membawa AI ke seluruh dunia, AI kini akan membalikkan proses tersebut dan mengubah seluruh cara pencapaian grafis komputer.

Hari ini, saya ingin menunjukkan masa depan. Ini adalah generasi berikutnya dari teknologi grafis kami, yang kami sebut Neural Rendering—integrasi mendalam antara 3D dan AI. Ini adalah DLSS 5, silakan lihat.

Neural Rendering: Penggabungan data terstruktur dan AI generatif

Bukankah ini menakjubkan? Grafis komputer menjadi hidup kembali.

Apa yang kami lakukan? Kami menggabungkan 3D yang dapat dikendalikan (fondasi nyata dunia virtual) dengan data terstruktur, lalu mengintegrasikan AI generatif dan probabilistik. Satu bersifat pasti, yang lain sangat realistis—kami menyatukan kedua ide ini, menggunakan data terstruktur untuk akurasi dan kendali, sekaligus melakukan generasi real-time. Akhirnya, konten yang dihasilkan tidak hanya indah dan menakjubkan, tetapi juga sepenuhnya dapat dikendalikan.

Penggabungan data terstruktur dan AI generatif ini akan terus berulang di berbagai industri. Data terstruktur adalah fondasi AI yang terpercaya.

Platform percepatan data terstruktur dan tidak terstruktur

Sekarang, saya tunjukkan diagram arsitektur teknologi.

Data terstruktur—yang sudah akrab di telinga: SQL, Spark, Pandas, Velox, serta platform penting seperti Snowflake, Databricks, Amazon EMR, Azure Fabric, Google BigQuery—semuanya memproses Data Frame. Data frame ini seperti spreadsheet besar, memuat seluruh informasi dunia bisnis, menjadi fakta dasar (Ground Truth) perusahaan.

Di era AI, kita perlu membuat AI menggunakan data terstruktur ini dan mempercepatnya secara ekstrem. Dulu, percepatan pengolahan data terstruktur bertujuan agar perusahaan lebih efisien. Tapi di masa depan, AI akan menggunakan data ini dengan kecepatan jauh melampaui manusia, dan agen AI akan sering mengakses basis data terstruktur.

Di sisi data tidak terstruktur, basis data vektor, PDF, video, audio membentuk sebagian besar data dunia—sekitar 90% data yang dihasilkan setiap tahun adalah data tidak terstruktur. Dulu, data ini hampir tidak bisa dimanfaatkan: kita membacanya, menyimpannya di sistem file, dan selesai. Kita tidak bisa melakukan query, sulit melakukan pencarian, karena data tidak terstruktur tidak memiliki indeks sederhana dan harus dipahami maknanya dan konteksnya. Sekarang, AI mampu melakukan ini—berkat teknologi multimodal sensing dan understanding, AI bisa membaca dokumen PDF, memahami maknanya, dan mengubahnya menjadi struktur yang bisa dicari.

NVIDIA menciptakan dua pustaka dasar untuk ini:

- cuDF: percepatan pengolahan Data Frame dan data terstruktur

- cuVS: pengolahan basis data vektor, data semantik, dan data AI tidak terstruktur

Dua platform ini akan menjadi salah satu fondasi utama masa depan.

Hari ini, kami umumkan kerjasama dengan banyak perusahaan. IBM—penemu bahasa SQL—akan menggunakan cuDF untuk mempercepat platform WatsonX Data. Dell bekerja sama membangun platform data AI Dell, mengintegrasikan cuDF dan cuVS, dan meningkatkan performa secara signifikan di proyek nyata NTT Data. Google Cloud, selain mempercepat Vertex AI, juga mempercepat BigQuery, dan bekerja sama dengan Snapchat menurunkan biaya komputasi hampir 80%.

Manfaat percepatan komputasi adalah tiga aspek: kecepatan, skala, dan biaya. Ini sejalan dengan logika Hukum Moore—melalui percepatan, kinerja meningkat pesat, dan biaya menurun secara berkelanjutan.

NVIDIA membangun platform percepatan komputasi yang mengintegrasikan banyak pustaka: RTX, cuDF, cuVS, dan lain-lain. Pustaka ini terintegrasi ke dalam layanan cloud global dan OEM, menjangkau pengguna di seluruh dunia.

Kerja sama mendalam dengan penyedia cloud utama

Kerja sama dengan penyedia cloud utama:

Google Cloud: kami mempercepat Vertex AI dan BigQuery, terintegrasi mendalam dengan JAX/XLA, dan unggul di PyTorch—NVIDIA adalah satu-satunya akselerator yang unggul di keduanya. Kami membawa pelanggan seperti Base10, CrowdStrike, Puma, Salesforce ke ekosistem Google Cloud.

AWS: kami mempercepat EMR, SageMaker, dan Bedrock, dengan integrasi mendalam. Tahun ini, yang sangat membanggakan, kami akan membawa OpenAI ke AWS, yang akan secara besar-besaran meningkatkan konsumsi cloud AWS dan membantu OpenAI memperluas deployment regional dan skala komputasi.

Microsoft Azure: superkomputer 100 PFLOPS yang kami bangun adalah yang pertama yang di-deploy di Azure, menjadi fondasi penting kerja sama dengan OpenAI. Kami mempercepat layanan cloud Azure dan AI Foundry, mendukung ekspansi wilayah Azure, dan bekerja sama di Bing Search. Kemampuan “confidential computing” kami—yang memastikan operator tidak bisa melihat data dan model pengguna—adalah GPU pertama di dunia yang mendukung confidential computing, memungkinkan deployment model OpenAI dan Anthropic secara aman di cloud global. Contohnya, kami mempercepat seluruh workflow EDA dan CAD dari Synopsys, dan menempatkannya di Microsoft Azure.

Oracle: kami adalah pelanggan AI pertama Oracle, dan bangga bisa memperkenalkan konsep cloud AI kepada mereka. Sejak itu, mereka berkembang pesat, dan kami memperkenalkan banyak mitra seperti Cohere, Fireworks, OpenAI.

CoreWeave: cloud AI native pertama di dunia, khusus untuk hosting GPU dan layanan cloud AI, dengan basis pelanggan yang kuat dan pertumbuhan pesat.

Palantir + Dell: membangun platform AI baru berbasis platform Ontology dari Palantir dan platform AI, yang dapat di-deploy secara lokal di berbagai negara dan lingkungan isolasi, lengkap dari pengolahan data (vektorisasi atau terstruktur) hingga seluruh stack percepatan AI.

NVIDIA telah membangun hubungan khusus ini dengan penyedia cloud global—mengintegrasikan pelanggan ke cloud, menciptakan ekosistem yang saling menguntungkan.

Strategi inti: integrasi vertikal dan keterbukaan horizontal

NVIDIA adalah perusahaan pertama di dunia yang mengadopsi model integrasi vertikal dan keterbukaan horizontal.

Model ini sangat sederhana: percepatan komputasi bukan hanya soal chip atau sistem, melainkan soal percepatan aplikasi. CPU bisa mempercepat keseluruhan komputer, tapi jalan ini sudah mencapai batas. Ke depan, satu-satunya cara untuk terus meningkatkan kinerja dan menurunkan biaya adalah melalui percepatan khusus bidang atau aplikasi tertentu.

Inilah sebabnya kami harus mendalami satu per satu pustaka, satu bidang demi bidang, satu industri demi industri. Kami adalah perusahaan komputasi yang terintegrasi secara vertikal—tidak ada jalan lain. Kami harus memahami aplikasi, memahami bidang, memahami algoritma secara mendalam, dan mampu menempatkannya di semua skenario—data center, cloud, lokal, tepi, bahkan robot.

Pada saat yang sama, NVIDIA tetap terbuka secara horizontal, bersedia mengintegrasikan teknologi ke platform mitra, agar semua orang dapat menikmati manfaat percepatan komputasi.

Struktur peserta GTC kali ini mencerminkan hal ini. Di antara peserta, industri jasa keuangan paling banyak—yang datang adalah pengembang, bukan trader. Ekosistem kami mencakup seluruh rantai pasok hulu dan hilir. Perusahaan yang sudah 50, 70, bahkan 150 tahun berdiri, tahun lalu mencatat tahun terbaik dalam sejarah. Kita berada di awal sesuatu yang sangat, sangat besar.

CUDA-X: mesin percepatan komputasi di berbagai industri

Di setiap bidang vertikal, NVIDIA telah melakukan penetrasi mendalam:

- Kendaraan otonom: cakupan luas dan dampak besar

- Jasa keuangan: investasi kuantitatif beralih dari fitur buatan manusia ke deep learning yang didorong superkomputer, memasuki “momen Transformer”

- Kesehatan: memasuki “momen ChatGPT”-nya sendiri, termasuk AI untuk penemuan obat, diagnosis berbantuan AI, layanan pelanggan medis

- Industri: gelombang pembangunan terbesar di dunia, pabrik AI, pabrik chip, pusat data mulai beroperasi

- Hiburan dan game: platform AI real-time untuk terjemahan, siaran langsung, interaksi game, dan agen belanja cerdas

- Robot: lebih dari 10 tahun pengembangan, lengkap dengan tiga arsitektur komputer (pelatihan, simulasi, onboard), 110 robot tampil di pameran ini

- Telekomunikasi: industri bernilai sekitar 2 triliun dolar, stasiun dasar akan bertransformasi dari fungsi komunikasi tunggal menjadi platform infrastruktur AI, platform terkait bernama Aerial, bekerja sama dengan Nokia, T-Mobile, dan lainnya

Semua bidang ini didukung oleh pustaka CUDA-X—inti dari perusahaan algoritma NVIDIA. Pustaka ini adalah aset terpenting perusahaan, memungkinkan platform komputasi memberikan nilai nyata di berbagai industri.

Salah satu pustaka terpenting adalah cuDNN (CUDA Deep Neural Network Library), yang merevolusi AI dan memicu ledakan AI modern.

(Perlihatkan video demo CUDA-X)

Semua yang Anda lihat tadi adalah simulasi—termasuk solver berbasis fisika, model fisik agen AI, dan model robot fisik AI. Semuanya simulasi, tanpa animasi manual atau pengikatan sendi. Inilah kekuatan inti NVIDIA: melalui pemahaman mendalam tentang algoritma dan integrasi organik dengan platform komputasi, membuka peluang ini.

Perusahaan berbasis AI asli dan era komputasi baru

Anda telah melihat raksasa industri seperti Walmart, L’Oréal, JPMorgan Chase, Roche, Toyota, dan banyak perusahaan yang belum pernah Anda dengar—kami sebut sebagai perusahaan AI asli. Daftar ini sangat panjang, termasuk OpenAI, Anthropic, dan banyak perusahaan baru yang melayani berbagai bidang vertikal.

Dalam dua tahun terakhir, industri ini melonjak secara luar biasa. Dana investasi ke startup mencapai 150 miliar dolar—rekor dalam sejarah manusia. Lebih penting lagi, ukuran investasi tunggal melonjak dari jutaan dolar ke ratusan juta bahkan miliaran dolar. Alasannya satu: ini adalah pertama kalinya setiap perusahaan semacam ini membutuhkan banyak sumber daya komputasi dan token. Industri ini menciptakan, menghasilkan token, atau meningkatkan nilai token dari organisasi seperti Anthropic dan OpenAI.

Seperti revolusi PC, internet, dan mobile cloud yang melahirkan perusahaan-perusahaan revolusioner, transformasi platform komputasi ini juga akan melahirkan perusahaan-perusahaan berpengaruh besar, menjadi kekuatan utama di masa depan.

Tiga terobosan besar yang mendorong semuanya

Apa yang sebenarnya terjadi dalam dua tahun terakhir? Tiga hal besar.

Pertama: ChatGPT, membuka era AI generatif (akhir 2022 hingga 2023)

Ini tidak hanya mampu persepsi dan pemahaman, tetapi juga menghasilkan konten unik. Saya tunjukkan integrasi AI generatif dan grafis komputer. AI generatif secara fundamental mengubah cara komputasi—dari pencarian menjadi pembuatan, mempengaruhi arsitektur, deployment, dan makna keseluruhan.

Kedua: AI penalaran (Reasoning AI), diwakili oleh o1

Kemampuan penalaran memungkinkan AI untuk refleksi diri, perencanaan, dan memecah masalah—mengurai masalah yang tidak bisa langsung dipahami menjadi langkah-langkah yang bisa diproses. o1 membuat AI generatif menjadi dapat dipercaya, mampu melakukan penalaran berdasarkan informasi nyata. Untuk itu, jumlah token input konteks dan output untuk berpikir meningkat secara signifikan, dan beban komputasi pun melonjak.

Ketiga: Claude Code, model agen pertama

Ia mampu membaca file, menulis kode, mengompilasi, menguji, mengevaluasi, dan melakukan iterasi. Claude Code merevolusi rekayasa perangkat lunak—semua insinyur NVIDIA menggunakan salah satu atau lebih dari Claude Code, Codex, dan Cursor. Tidak ada insinyur perangkat lunak yang tidak dibantu AI.

Ini adalah titik balik baru—Anda tidak lagi bertanya “apa, di mana, bagaimana” kepada AI, tetapi “buat, jalankan, bangun”, membiarkan AI aktif menggunakan alat, membaca file, memecah masalah, dan bertindak. AI kini bergerak dari persepsi ke generasi, ke penalaran, dan kini mampu menyelesaikan pekerjaan.

Dalam dua tahun terakhir, beban komputasi untuk penalaran meningkat sekitar 10.000 kali lipat, dan penggunaannya sekitar 100 kali lipat. Saya selalu percaya bahwa dalam dua tahun, kebutuhan komputasi meningkat 1 juta kali lipat—ini adalah pengalaman bersama semua orang, dari OpenAI, Anthropic, dan lainnya. Jika kita mendapatkan lebih banyak daya hitung, kita bisa menghasilkan lebih banyak token, pendapatan meningkat, dan AI menjadi lebih pintar. Titik balik penalaran sudah dekat.

Era infrastruktur AI bernilai triliunan dolar

Tahun lalu di sini, saya menyatakan bahwa kami sangat yakin tentang permintaan dan pesanan pembelian Blackwell dan Rubin hingga 2026, sekitar 500 miliar dolar. Hari ini, setahun kemudian di GTC, saya katakan: melihat ke 2027, angka yang saya lihat minimal 1 triliun dolar. Dan saya yakin, kebutuhan nyata akan jauh lebih besar dari itu.

2025: Tahun inferensi NVIDIA

Tahun 2025 adalah “Tahun Inferensi” NVIDIA. Kami ingin memastikan bahwa di luar pelatihan dan pasca-pelatihan, AI tetap unggul di setiap tahap siklus hidupnya, sehingga infrastruktur yang sudah diinvestasikan dapat terus berjalan efisien, dan umur pakainya semakin panjang dengan biaya per unit yang semakin rendah.

Selain itu, Anthropic dan Meta resmi bergabung dengan platform NVIDIA, mewakili sepertiga kebutuhan komputasi AI global. Model open source mendekati tingkat terdepan, ada di mana-mana.

NVIDIA saat ini adalah satu-satunya platform yang mampu menjalankan semua bidang AI—bahasa, biologi, grafis komputer, visi komputer, suara, protein dan kimia, robot—semua model AI, baik di tepi maupun di cloud, dalam berbagai bahasa. Arsitektur NVIDIA bersifat universal untuk semua skenario ini, menjadikan kami platform dengan biaya terendah dan tingkat kepercayaan tertinggi.

Saat ini, 60% bisnis NVIDIA berasal dari lima cloud service provider terbesar di dunia, sisanya 40% tersebar di cloud regional, cloud berdaulat, perusahaan, industri, robot, dan komputasi tepi. Jangkauan luas AI ini adalah kekuatan utama—ini adalah transformasi platform komputasi yang benar-benar baru.

Grace Blackwell dan NVLink 72: inovasi arsitektur besar

Saat arsitektur Hopper masih puncaknya, kami memutuskan untuk merancang ulang sistem secara total, memperluas NVLink dari 8 jalur menjadi NVLink 72, dan melakukan rekonstruksi menyeluruh. Grace Blackwell NVLink 72 adalah taruhan teknologi besar, dan tidak mudah bagi semua mitra—kepada semua, saya ucapkan terima kasih.

Kami juga meluncurkan NVFP4—bukan sekadar FP4 biasa, tetapi tipe tensor core dan unit komputasi baru. Kami sudah membuktikan bahwa NVFP4 dapat melakukan inferensi tanpa kehilangan presisi, dengan peningkatan performa dan efisiensi energi yang besar, dan cocok juga untuk pelatihan. Selain itu, algoritma baru seperti Dynamo dan TensorRT-LLM muncul, dan kami bahkan membangun superkomputer khusus untuk mengoptimalkan kernel, yang disebut DGX Cloud.

Hasilnya, performa inferensi kami sangat mengesankan. Data dari Semi Analysis—yang merupakan evaluasi performa inferensi AI paling komprehensif—menunjukkan NVIDIA unggul jauh dalam hal token per watt dan biaya per token. Sebelumnya, H100 mungkin hanya memberi peningkatan 1,5 kali dari H200 berdasarkan Hukum Moore, tetapi kami mencapai 35 kali lipat. Dylan Patel dari Semi Analysis bahkan mengatakan: “Jensen (黄仁勋) bersikap konservatif, sebenarnya 50 kali lipat.” Benar sekali.

Saya kutip dia: “Jensen sandbagged (黄仁勋) angka performa.”

Biaya per token NVIDIA saat ini adalah yang terendah di dunia, dan tidak tertandingi. Alasannya adalah desain kolaboratif ekstrem (Extreme Co-design).

Contohnya, Fireworks—sebelum NVIDIA memperbarui seluruh perangkat lunak dan algoritma, kecepatan token rata-rata sekitar 700 per detik; setelah pembaruan, mendekati 5.000 per detik, peningkatan sekitar 7 kali. Inilah kekuatan desain kolaboratif ekstrem.

Pabrik AI: dari data center ke pabrik token

Dulu, data center adalah tempat penyimpanan file; sekarang, ia adalah pabrik token. Setiap penyedia cloud dan perusahaan AI di masa depan akan mengukur kinerja mereka dari “efisiensi pabrik token”.

Ini adalah argumen utama saya:

- Sumbu vertikal: throughput—jumlah token yang dihasilkan per detik dengan daya tetap

- Sumbu horizontal: kecepatan interaksi—respon setiap inferensi, semakin cepat, semakin besar model dan konteksnya, semakin pintar AI

Token adalah komoditas baru, dan begitu matang, akan diberi harga berlapis:

- Layer Gratis (tinggi throughput, kecepatan rendah)

- Layer Menengah (~$3 per juta token)

- Layer Tinggi (~$6 per juta token)

- Layer Kecepatan Tinggi (~$45 per juta token)

- Layer Super Kecepatan (~$150 per juta token)

Dibandingkan Hopper, Grace Blackwell meningkatkan throughput di layer tertinggi hingga 35 kali, dan memperkenalkan level baru. Dengan memperkirakan model sederhana, jika 25% daya dialokasikan ke empat layer ini, Grace Blackwell bisa menghasilkan 5 kali lipat pendapatan dibanding Hopper.

Vera Rubin: sistem komputasi AI generasi berikutnya

(Perlihatkan video pengenalan sistem Vera Rubin)

Vera Rubin adalah sistem lengkap yang dioptimalkan secara end-to-end, dirancang khusus untuk beban kerja agen (Agentic):

- Inti komputasi model bahasa besar: cluster GPU NVLink 72, menangani prefill dan KV Cache

- CPU Vera baru: dirancang untuk performa single-thread ekstrem, menggunakan LPDDR5, efisiensi energi tinggi, satu-satunya CPU data center yang pakai LPDDR5, cocok untuk alat AI agen

- Sistem penyimpanan: BlueField 4 + CX 9, platform penyimpanan baru untuk era AI, seluruh industri penyimpanan bergabung

- Switch Spectrum X CPO: switch optik terkemuka dunia yang sudah massal

- Rack Kyber: sistem rack baru, mendukung 144 GPU dalam satu domain NVLink, menggabungkan komputasi depan dan NVLink di belakang, membentuk superkomputer raksasa

- Rubin Ultra: node superkomputer generasi berikutnya, desain vertikal, mendukung skala besar NVLink

Vera Rubin sudah 100% cair pendingin, waktu pemasangan dari dua hari menjadi dua jam, menggunakan pendinginan air panas 45°C, secara signifikan mengurangi beban pendinginan data center. Satya Nadella sendiri mengonfirmasi bahwa rack Vera Rubin pertama sudah berjalan di Azure, dan saya sangat bersemangat.

Integrasi Groq: memperluas performa inferensi secara ekstrem

Kami mengakuisisi tim Groq dan mendapatkan lisensi teknologi mereka. Groq adalah prosesor aliran data deterministik (Deterministic Dataflow Processor), menggunakan kompilasi statis dan penjadwalan compiler, dengan SRAM besar, dioptimalkan untuk beban kerja inferensi tunggal, menawarkan latensi sangat rendah dan kecepatan token sangat tinggi.

Namun, memori Groq terbatas (500MB SRAM on-chip), sehingga sulit menampung parameter model besar dan KV Cache secara mandiri, membatasi penggunaannya secara luas.

Solusinya adalah Dynamo—software pengaturan inferensi. Dengan Dynamo, kami mendistribusikan pipeline inferensi:

- Prefill dan attention decoding dilakukan di Vera Rubin (memerlukan daya besar dan KV Cache besar)

- Feed-Forward Network decoding (pembuatan token) dilakukan di Groq (memerlukan bandwidth tinggi dan latensi rendah)

Keduanya terhubung via Ethernet secara ketat, dan melalui mode khusus, latensi berkurang sekitar setengahnya. Dengan “sistem operasi pabrik AI” Dynamo yang mengatur secara terpadu, performa keseluruhan meningkat 35 kali lipat, dan membuka level performa inferensi baru yang sebelumnya tidak terjangkau NVLink 72.

Gabungan Groq dan Vera Rubin menyarankan:

- Jika beban kerja lebih banyak ke throughput tinggi, gunakan 100% Vera Rubin

- Jika banyak beban kerja bernilai tinggi seperti kode generator, gunakan Groq, sekitar 25% dari pusat data

Chip Groq LP30 yang diproduksi Samsung sudah dalam produksi massal, diperkirakan mulai dikirim kuartal ketiga. Terima kasih kepada Samsung atas kerjasama penuh.

Lompatan sejarah performa inferensi

Mengkuantifikasi kemajuan teknologi: dalam dua tahun, kecepatan pembuatan token di pabrik AI 1 GW akan meningkat dari 22 juta menjadi 700 juta token per detik, meningkat 350 kali. Inilah kekuatan desain kolaboratif ekstrem.

Peta jalan teknologi

- Blackwell: saat ini dalam produksi, sistem standar Oberon, memperluas NVLink dari 8 ke 72 jalur, dan opsi optik hingga NVLink 576

- Vera Rubin (sekarang): rack Kyber, NVLink 144 (kabel tembaga); rack Oberon, NVLink 72 + optik, ekspansi ke NVLink 576; Spectrum 6, switch CPO pertama dunia

- Vera Rubin Ultra (akan datang): GPU Rubin Ultra generasi baru, chip LP35 (pertama kali mengintegrasikan NVFP4), peningkatan performa beberapa kali

- Feynman (masa depan): GPU baru, chip LP40 (hasil kolaborasi NVIDIA dan tim Groq, mengintegrasikan NVFP4); CPU baru—Rosa (Rosalyn); BlueField 5; CX 10; mendukung kedua jalur ekspansi—kabel tembaga dan CPO—dengan sistem rack Kyber

Peta jalan ini jelas: jalur kabel tembaga, jalur