Elon Musk loue Seedance 2.0 en disant « le développement de l'IA vidéo va trop vite » ! ByteDance pense que le modèle n'est pas encore parfait

La version 2.0 de Seedance, le modèle vidéo de ByteDance, connaît un succès fulgurant à l’étranger, Elon Musk s’émerveillant de sa rapidité de développement. Ce modèle a été intégralement connecté à Doubao et Jiumeng, tout en étant accessible en version bêta pour les entreprises. La capacité de « multimodalité » et de « narration longue avec plusieurs caméras » vise directement les scénarios de production professionnelle. ByteDance admet que le produit est en avance mais encore loin d’être parfait, poursuivant l’exploration d’un alignement profond entre grands modèles et retours humains. La version 2.0 de Doubao sera lancée le 14 février.

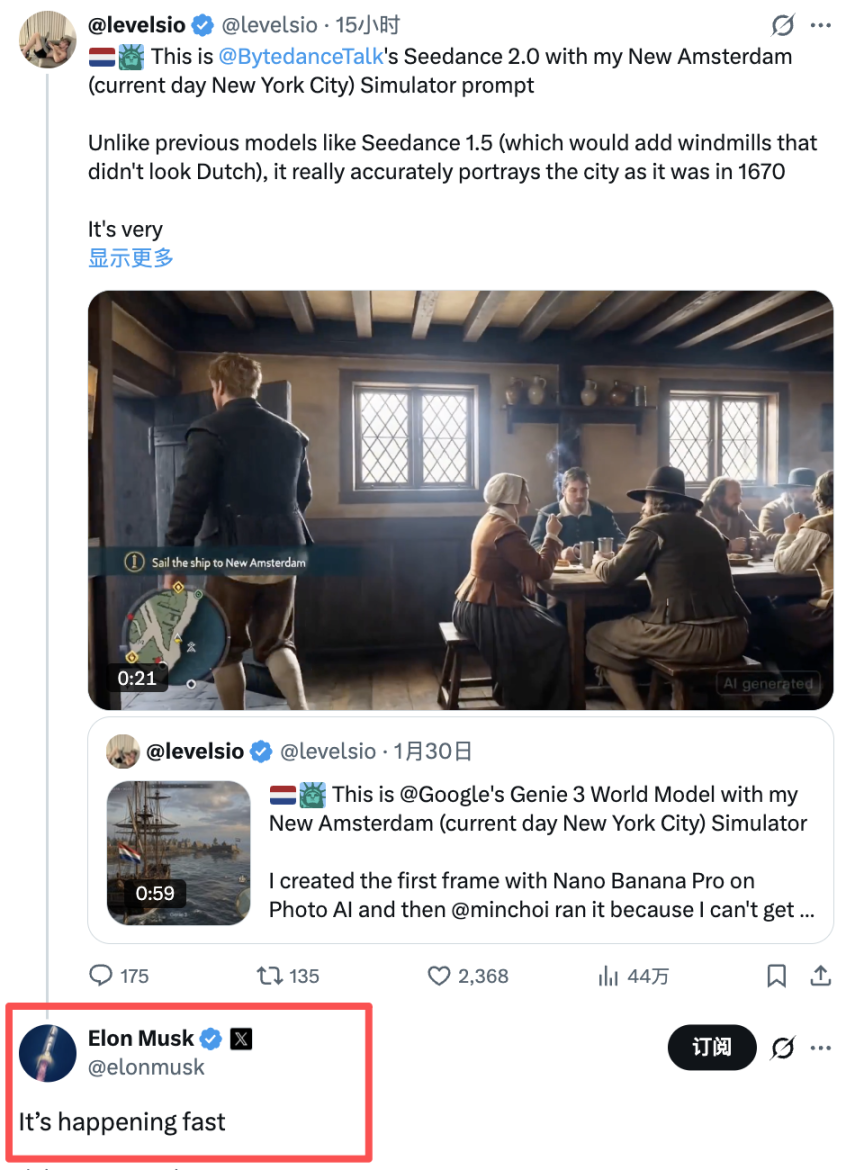

Les modèles vidéo génératifs accélèrent leur entrée dans les produits grand public et les chaînes d’outils pour entreprises. Après la sortie de Seedance 2.0, qui a rapidement gagné en popularité à l’étranger, Elon Musk a relayé un tweet sur X en commentant « It’s happening fast », amplifiant ainsi l’attention du marché sur la progression des capacités de génération vidéo.

Les dernières actualités proviennent des réseaux sociaux. Musk a commenté une publication liée à Seedance 2.0 sur X, exprimant son étonnement face à la vitesse de développement, ce qui a renforcé la discussion autour de ce modèle à l’échelle internationale, tout en suscitant une attention accrue sur sa contrôlabilité et ses capacités de production.

Aujourd’hui, ByteDance a envoyé un signal clair concernant la commercialisation. Seedance 2.0 a été officiellement lancé, intégrant pleinement Doubao et Jiumeng, et a également été mis en ligne sur le centre d’expériences Volcano Ark, accessible en version bêta pour les utilisateurs. Le modèle met en avant la synchronisation audio-visuelle, la narration longue multi-caméras, et la génération contrôlable multimodale, visant un public plus large de créateurs et de contenus commerciaux.

Cependant, l’entreprise reste prudente dans ses déclarations. La micro-communication officielle de ByteDance indique que Seedance 2.0 « est encore loin d’être parfait », ses résultats de génération comportant encore de nombreux défauts. La société poursuivra l’exploration d’un alignement profond entre grands modèles et retours humains. Pour les acteurs du marché, cette combinaison de « forte visibilité + commercialisation rapide + itérations continues » renforce l’attente d’un rythme accéléré dans la compétition sur le secteur de la génération vidéo.

Seedance 2.0 enflamme l’intérêt à l’étranger

Après le lancement de la phase de bêta, Seedance 2.0 a suscité une forte attention mondiale grâce à sa création multimodale et à ses effets de « caméra automatique ». La relance par Musk sur X avec le commentaire « It’s happening fast » a permis de faire passer la diffusion du modèle d’un cercle technique à un public plus large, incluant investisseurs et acteurs du marché.

L’évaluation publique de Musk, sans entrer dans les détails techniques, renforce la narration de « vitesse de développement ». Ce signal contribue à attirer l’attention sur les capacités multimodales de ByteDance, tout en pouvant influencer marginalement la valorisation des acteurs de la chaîne industrielle.

De l’intérieur à l’extérieur : intégration progressive de Doubao, Jiumeng et Volcano Ark

ByteDance a annoncé aujourd’hui que le modèle de génération vidéo Doubao Seedance 2.0 est désormais intégré à l’application Doubao, à la version PC et web, tout en étant pleinement connecté à Jiumeng, et accessible via le centre d’expériences Volcano Ark pour les essais.

Pour le secteur B2B, ByteDance prévoit que, d’ici la mi-février, l’API de Seedance 2.0 sera déployée sur Volcano Ark pour aider les clients à concrétiser leurs idées créatives. Cela indique que Seedance 2.0 ne se limite pas à un outil de création, mais se prépare également à une utilisation plus standardisée côté entreprise.

Multimodalité, narration longue et synchronisation audio-visuelle, ciblant la production professionnelle

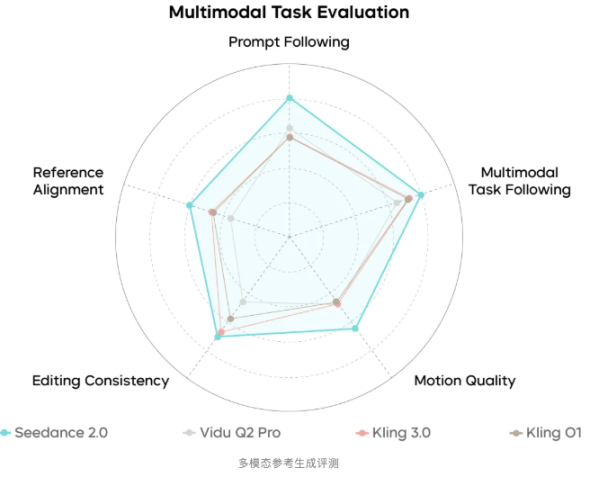

ByteDance insiste sur le fait que Seedance 2.0 répond aux exigences de « qualité et de contrôle pour des scénarios de production professionnelle ». Les fonctionnalités clés comprennent :

1, Entrée multimodale supportant texte, images, audio et vidéo en mélange, avec référence à la composition, aux mouvements, aux effets de caméra, aux effets spéciaux et au son.

2, Synchronisation audio-visuelle en temps réel avec sortie multi-piste, supportant musique de fond, effets sonores ou commentaires, en assurant leur synchronisation avec le rythme visuel.

3, Narration longue multi-caméras avec « pensée de réalisateur », le modèle pouvant analyser automatiquement la logique narrative, générer la séquence de plans, tout en maintenant l’unité des personnages, de la lumière, du style et de l’atmosphère.

4, Ajout de capacités d’édition vidéo et d’extension de durée, renforçant le flux de travail « à la niveau de réalisateur ».

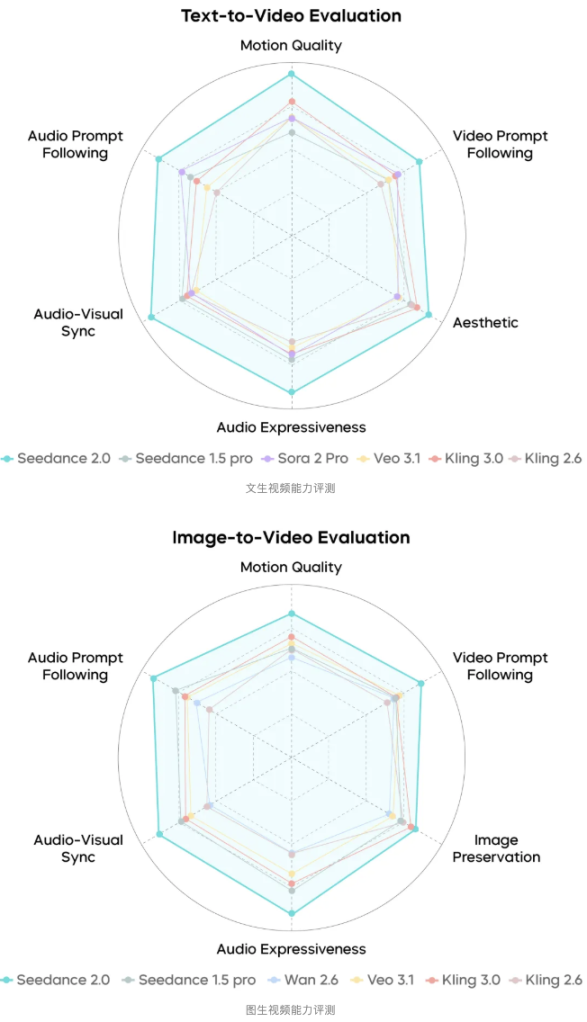

ByteDance indique également que Seedance 2.0 a résolu de manière satisfaisante les défis liés au respect des lois physiques et à la cohérence à long terme, avec un taux de génération dans les scènes en mouvement atteignant le niveau SOTA de l’industrie.

« Encore loin d’être parfait » : limites et restrictions clairement mentionnées

ByteDance affirme que Seedance 2.0 atteint un niveau de performance leader dans l’industrie, mais qu’il reste des marges d’optimisation, notamment en termes de stabilité des détails, de correspondance multi-personnes, de cohérence multi-sujet, de précision de restitution textuelle et d’effets d’édition complexes. La société poursuivra l’alignement profond entre grands modèles et retours humains.

Les règles de conformité et de limites d’utilisation deviennent également plus claires. ByteDance précise que, pour l’instant, Seedance 2.0 limite l’utilisation d’images ou vidéos de personnes comme référence principale. Toute utilisation de personnes doit faire l’objet d’une vérification ou d’une autorisation préalable. Ces restrictions auront un impact direct sur la production et la diffusion de certains contenus commerciaux.

Lancement prévu pour le 14 février, rythme d’amélioration comme nouveau facteur

ByteDance a confirmé que Volcano Engine prévoit de lancer une série de mises à jour importantes pour Doubao, notamment la version 2.0 du modèle, le modèle de création vidéo Seedance 2.0, et le modèle de création d’images Seedream 5.0 Preview, d’ici le 14 février 2026. Ces améliorations concerneront notamment la capacité des modèles de base et des agents d’entreprise.

Face à l’émergence de la remarque de Musk sur la « vitesse de développement », le marché se concentrera désormais sur deux points : premièrement, si l’API de Seedance 2.0 sera déployée rapidement pour répondre aux attentes du marché, et deuxièmement, si le rythme d’amélioration des défauts tels que la cohérence, la synchronisation labiale et l’édition complexe pourra soutenir la transition d’un « démonstration à succès » vers une « productivité stable ».