Perspectivas para 2026: enquanto 81.000 amostras de usuários interagem com o Índice Econômico, de que forma as narrativas sobre produtividade baseada em IA coexistem com as preocupações sobre segurança no emprego?

I. Contexto da pesquisa e integração de dados: da evidência de tráfego a 81.000 narrativas subjetivas

As discussões públicas sobre IA generativa sempre se basearam em dois tipos de evidência: estatísticas macro do mercado e registros de uso e comportamento em nível de produto. O primeiro avança lentamente e tem dificuldade para captar mecanismos no nível das funções, enquanto o segundo é autêntico, mas frequentemente não revela “como as pessoas interpretam sua própria realidade”.

Fonte da imagem: Relatório oficial da Anthropic

Em abril de 2026, a Anthropic publicou “O que 81.000 pessoas nos disseram sobre a economia da IA”. O valor desse relatório não está em apresentar uma “resposta definitiva”, mas em conectar dois tipos centrais de informação:

- Dados observáveis do lado da plataforma: quais tarefas ocupacionais utilizam o Claude e como a intensidade de uso evolui.

- Feedback subjetivo do usuário: se as pessoas se sentem mais eficientes e se estão mais preocupadas com a substituição de seus empregos.

Historicamente, as discussões pendiam para o macro (taxas de emprego, crescimento do mercado) ou para a experiência do usuário (“sinto que estou mais rápido”). Este relatório une os dois, mudando o debate de “opinião versus opinião” para uma síntese de “dados mais percepção”.

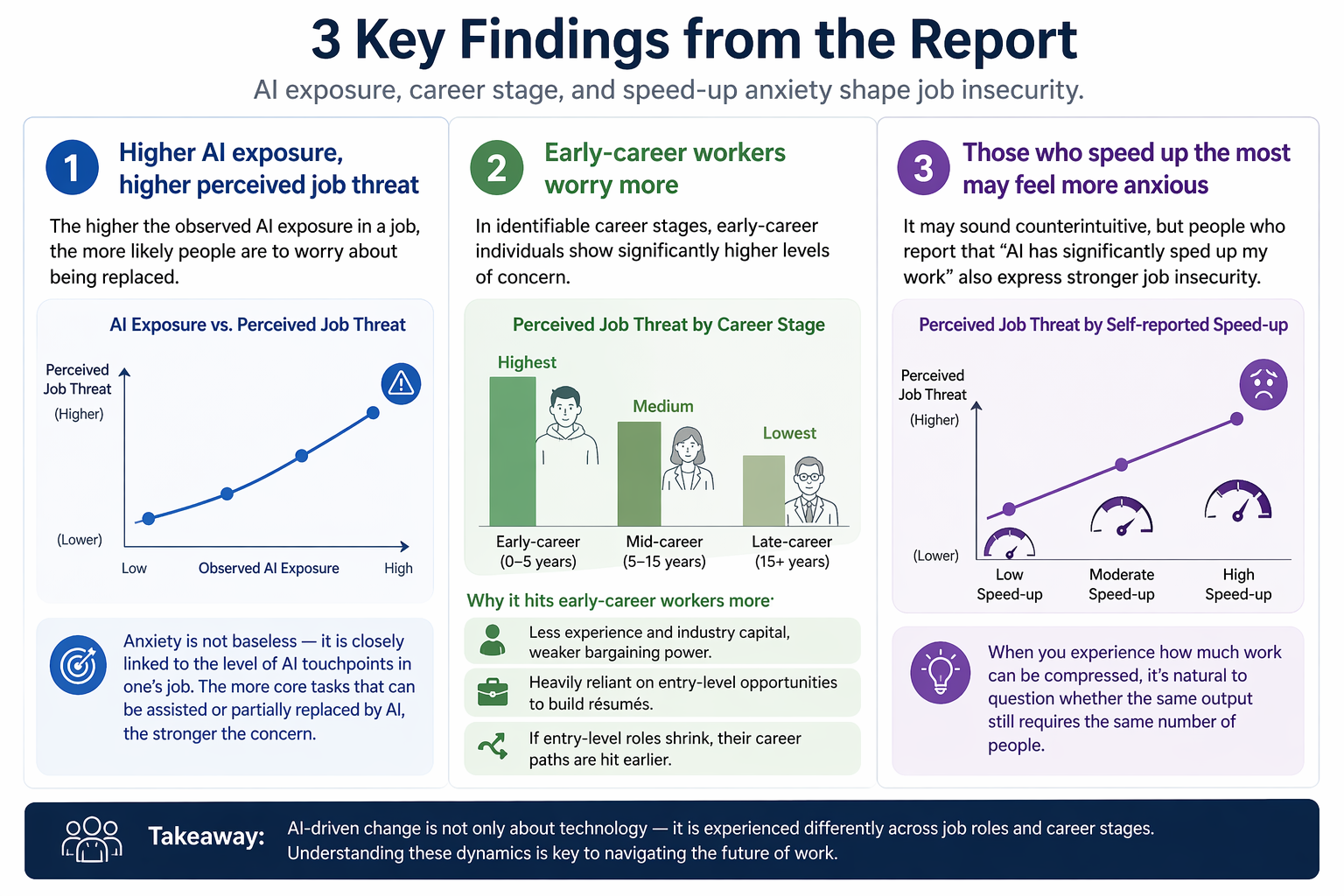

Três principais descobertas: exposição, estágio de carreira, ansiedade por aceleração

Descoberta 1: maior exposição à IA aumenta a percepção de ameaça ao emprego

O relatório identifica uma relação clara: quanto maior a exposição observada à IA em uma profissão, maior a probabilidade de os participantes expressarem preocupação de que seus empregos possam ser substituídos.

Isso indica que a ansiedade de muitos não é infundada, mas está atrelada ao alcance tecnológico de suas funções. Se um cargo já possui várias tarefas centrais que a IA pode auxiliar ou substituir parcialmente, quem ocupa essa posição tende a se preocupar mais com mudanças futuras — reflexo de uma percepção racional de risco.

Descoberta 2: profissionais em início de carreira estão mais preocupados

O relatório aponta que, entre as amostras com estágio de carreira identificável, profissionais em início de carreira apresentam preocupações mais acentuadas.

Esse cenário está alinhado com as observações do mercado de trabalho em 2026, como a intensificação da pressão sobre o emprego dos jovens.

Por que isso ocorre mais entre quem está em início de carreira?

- Menos experiência e menos recursos no setor, resultando em menor poder de barganha.

- Maior dependência de oportunidades de entrada para construir currículo.

- Se cargos de entrada diminuem, as trajetórias de carreira são interrompidas mais cedo.

Descoberta 3: quem experimenta maior aceleração também pode se sentir mais ansioso

Apesar de parecer contraditório, esse ponto é relevante:

Alguns relatam que “a IA aumentou significativamente minha velocidade”, mas também expressam maior insegurança quanto ao emprego.

A lógica é direta:

Ao perceber na prática que a eficiência do trabalho pode ser ampliada drasticamente, a consciência de que o mesmo resultado pode exigir menos pessoas aumenta.

Onde a produtividade realmente se manifesta: expansão de escopo versus velocidade

Muitos presumem que o valor da IA está apenas em “ser mais rápido”. No entanto, o relatório destaca outra dimensão, potencialmente mais relevante: “expansão de escopo”.

- Expansão de escopo: tarefas antes inviáveis agora tornam-se possíveis.

- Velocidade: tarefas já possíveis agora são concluídas mais rapidamente.

A expansão de escopo aparece frequentemente no relatório.

Isso significa que a IA não é apenas uma ferramenta de eficiência — é um multiplicador de capacidades.

Implicações diferentes para diferentes grupos

- Para funções de alta qualificação: permite abordar tarefas complexas de forma mais profunda e sistemática.

- Para algumas funções de baixa remuneração: viabiliza trabalhos paralelos, aquisição de novas habilidades e maior autonomia.

- Para a gestão organizacional: os limites dos cargos podem ser redesenhados e a divisão de tarefas pode se alterar rapidamente.

Por que “mais eficiente” não significa “mais seguro”

Esse é um dos pontos mais negligenciados nas discussões atuais.

Muitos relatórios enfatizam:

“A eficiência dos funcionários aumentou, então a tecnologia é inclusiva.”

Na prática, porém, o ganho de eficiência responde apenas à pergunta “quanto a produção mudou”, não “como os retornos são distribuídos”.

O mesmo dividendo de eficiência pode seguir quatro caminhos

- Para funcionários: maior renda, menos repetição, mais autonomia.

- Para empresas: maior produção com o mesmo quadro ou redução de custos para a mesma produção.

- Para clientes: preços mais baixos, entregas mais rápidas.

- Absorvido pelo sistema: indicadores melhoram, mas a experiência na linha de frente passa a ser “mais tarefas, ritmo acelerado”.

O relatório também traz relatos de participantes dizendo:

Após o uso da IA, supervisores e clientes esperam “mais, mais rápido”.

Isso explica por que muitos relatam estar “mais eficientes” e “mais ansiosos” ao mesmo tempo.

Integração das informações públicas mais recentes: o que podemos e não podemos confirmar

Com base nos materiais do Índice Econômico da Anthropic de 2026 (incluindo os relatórios de janeiro e março e a estrutura da pesquisa), as conclusões mais confiáveis no momento são:

O que podemos confirmar

- A IA já alcançou penetração real em algumas tarefas ocupacionais, superando o estágio conceitual.

- As preocupações subjetivas com o emprego estão alinhadas com a exposição das tarefas.

- Os ganhos de produtividade são reais, refletidos não só em “velocidade”, mas também em “escopo”.

O que não pode ser superestimado

- Esta amostra não permite inferir o impacto líquido no emprego nacional.

- A experiência de usuários individuais não corresponde à de todos os funcionários de uma empresa.

- “Preocupação aumentada” não equivale diretamente a “desemprego”.

Por que é necessário cautela

Esta pesquisa utilizou respostas abertas e classificação por modelo, não um questionário estruturado.

É uma referência valiosa, mas serve melhor para “identificar tendências e hipóteses” do que para conclusões definitivas.

Recomendações práticas para empresas, indivíduos e formuladores de políticas

Para avançar além do debate, as conclusões devem ser traduzidas em ações concretas.

Para empresas: atualize “KPIs de eficiência” para “dupla métrica”

Acompanhe ambas as categorias de métricas:

- Métricas de produção: tempo gasto, volume entregue, taxa de erro, taxa de retrabalho.

- Métricas sustentáveis de efetividade de pessoas: carga de trabalho percebida, risco de rotatividade, cobertura de treinamento, taxa de sucesso em transição de funções.

Evite fazer apenas uma coisa:

Não implemente apenas ferramentas sem ajustar cargos e mecanismos de treinamento.

Caso contrário, a eficiência de curto prazo pode aumentar, mas a estabilidade organizacional de longo prazo pode ser comprometida.

Para indivíduos: eleve o uso de IA para “construção de ativos de carreira”

Priorize três direções:

- Use IA para métodos reutilizáveis, não apenas para ganhos pontuais de velocidade.

- Reforce habilidades em definição de problemas, colaboração entre equipes e responsabilidade pelos resultados.

- Construa um histórico de realizações verificáveis (projetos, casos, insights do mercado) para aumentar sua irredutibilidade.

Para formuladores de políticas e instituições: foque em zonas de proteção para início de carreira

Se grupos em início de carreira são mais sensíveis, o apoio público deve ser mais proativo:

- Vouchers para transição de carreira e requalificação.

- Programas de co-treinamento em IA para cargos de entrada.

- Divulgação mais granular de dados sobre transições de emprego.

Conclusão

Este estudo, com base em 81.000 amostras, demonstra que o impacto econômico da IA envolve pelo menos duas dimensões que precisam ser avaliadas em paralelo: ganhos de eficiência em nível de tarefa e mudanças nas expectativas de trabalho e na distribuição de retornos dos trabalhadores. Focar apenas na primeira leva à superestimação da inclusão; definir risco apenas pela segunda subestima os ganhos reais de ampliação de capacidades.

Uma estrutura analítica robusta deve reconhecer que melhoria de produtividade e incerteza no emprego podem coexistir, com heterogeneidade significativa conforme exposição ao trabalho, estágio de carreira e gestão organizacional. Por isso, o foco das discussões futuras deve migrar de “adotar ou não IA” para “como otimizar mecanismos de distribuição, mitigar custos de transição e garantir mobilidade de carreira sustentável enquanto se aumenta a produção”.

Após 2026, o centro da pesquisa econômica e da governança em IA não está em buscar uma resposta única, mas em construir um sistema abrangente de avaliação que acompanhe simultaneamente eficiência, distribuição e estabilidade no emprego.

Artigos Relacionados

Renderizar em IA: Como a Taxa de Hash Descentralizada Impulsiona a Inteligência Artificial

Render, io.net e Akash: uma comparação entre as redes DePIN de taxa de hash

O que são narrativas cripto? Principais narrativas para 2025 (ATUALIZADO)

Explorando o Smart Agent Hub: Sonic SVM e seu Framework de Escalonamento HyperGrid

O que é Fartcoin? Tudo o que você precisa saber sobre FARTCOIN