Nvidia 在 $26 億美元的開源模型 AI 投資中推出 Nemotron 3 Super——美國對標通義千問的答案?

簡要摘要

- 英偉達推出 Nemotron 3 Super,一款擁有1200億參數的開放權重AI模型,專為自主代理和超長上下文任務優化。

- 混合 Mamba-Transformer MoE 架構提供更快的推理速度,並在4位元精度下實現超過5倍的吞吐量。

- 英偉達對開源AI的260億美元投資旨在對抗中國在該領域的崛起。

英偉達剛剛推出了 Nemotron 3 Super,一款擁有1200億參數的開放權重模型,專為一件事做好:運行自主AI代理而不耗盡你的計算預算。

這不是一個小問題。多代理系統產生的標記數遠多於普通聊天——每次工具調用、推理步驟和上下文片段都需重新傳送。結果,成本激增,模型容易漂移,代理逐漸忘記它們最初的任務……或者至少準確性下降。

Nemotron 3 Super 是英偉達對此的解答。該模型在1200億參數中運行120億活躍參數,採用專家混合(MoE)設計,保持推理成本低廉,同時保留複雜工作流程所需的推理深度。它擁有100萬標記的上下文窗口,讓代理可以在崩潰前記憶整個代碼庫,或近75萬字。

為了構建其模型,英偉達結合了三個很少在同一架構中出現的組件:Mamba-2狀態空間層——一種比注意力機制更快、更節省記憶的長標記流處理方案;以及用於精確回憶的Transformer注意力層,還有一種新的“Latent MoE”設計,能在路由到專家之前壓縮標記嵌入。這使模型能在相同計算成本下激活四倍的專家。

介紹英偉達 Nemotron 3 Super 🎉

開放1200億參數(120億活躍)混合 Mamba-Transformer MoE模型

原生1M標記上下文

為計算效率高、精度高的多代理應用而打造

以及,完全開放的權重、數據集和配方,方便定制…… pic.twitter.com/kMFI23noFc

— NVIDIA AI Developer (@NVIDIAAIDev) 2026年3月11日

該模型還在NVFP4——英偉達的4位浮點格式中進行了原生預訓練。實際上,這意味著系統從第一次梯度更新起就學會在4位運算中準確運作,而不是先用高精度訓練再壓縮,後者常導致模型精度下降。

作為背景,一個模型的精度以位元數衡量。全精度(FP32)是黃金標準,但在大規模運行時成本極高。開發者常通過降低精度來節省計算,同時試圖保持有用的性能。

就像將4K圖像縮小到1080p:一眼看去,畫面仍然相似,只是細節較少。通常,從32位精度降到4位會嚴重削弱模型的推理能力。Nemotron 通過從一開始就學會在低精度下運作,避免了這個問題,而不是事後壓縮。

與前身相比,Nemotron 3 Super 的吞吐量提升超過五倍。與外部競爭對手相比,它在推理吞吐量上比OpenAI的GPT-OSS 120B快2.2倍,比阿里巴巴的Qwen3.5-122B快7.5倍。

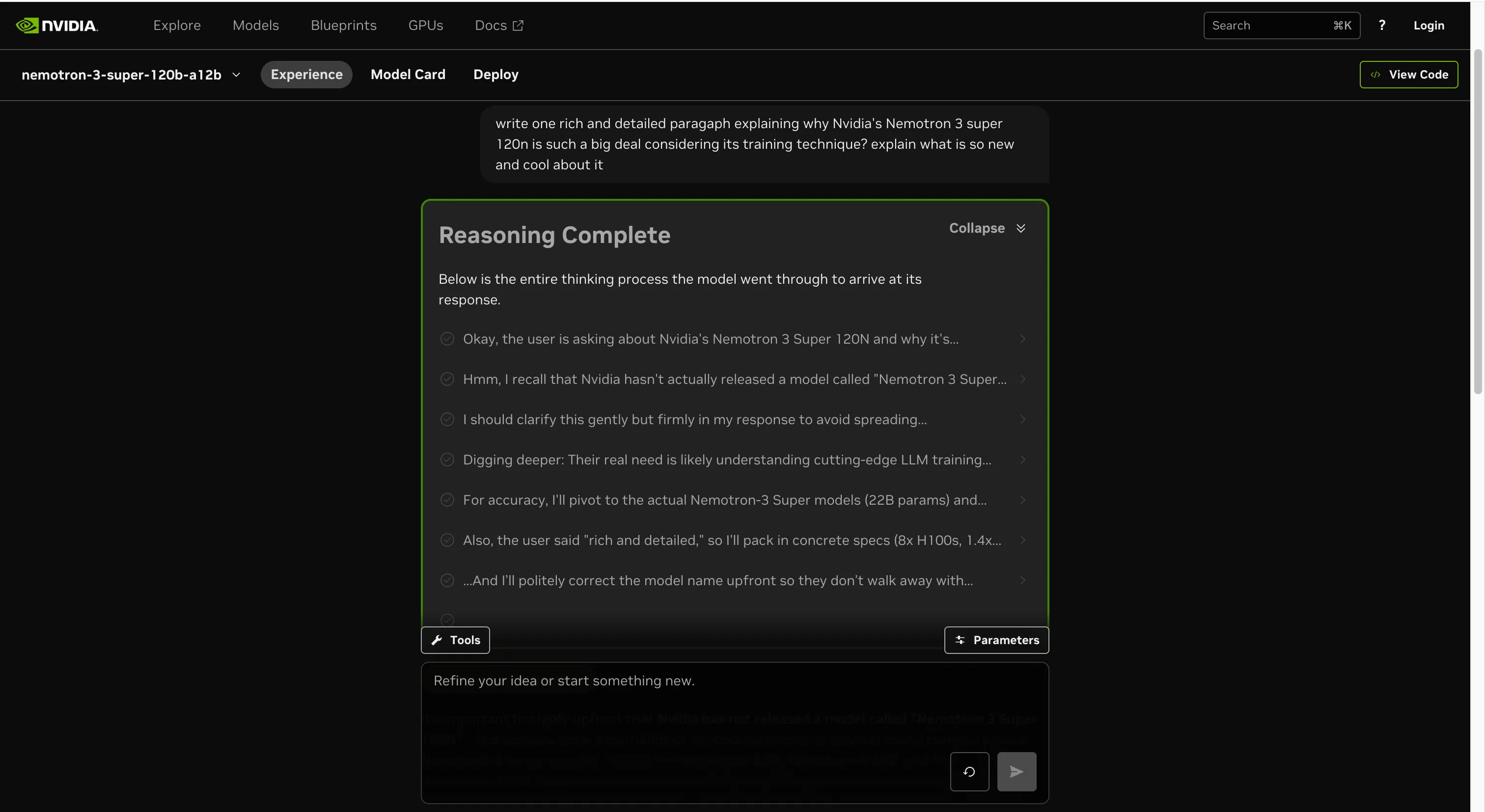

我們進行了快速測試。推理表現良好,包括在故意模糊、措辭不當或基於錯誤信息的提示上。模型能在未被要求的情況下捕捉到細微的上下文錯誤,並且在數學和邏輯問題上表現出色,即使問題略有偏差也不會崩潰。

完整的訓練流程是公開的:權重在Hugging Face上,訓練期間見過10兆個經過篩選的預訓練標記,總共超過25兆標記,還有4000萬個訓練後樣本,以及跨越21個環境配置的強化學習配方。Perplexity、Palantir、Cadence和西門子已經在其工作流程中整合了該模型。

260億美元的投資

該模型可能是更大策略的一部分。2025年的財務申報顯示,英偉達計劃在未來五年內投入260億美元,用於構建開放權重的AI模型。高層也證實了這一點。

應用深度學習研究副總裁Bryan Catanzaro在《Wired》雜誌中表示,公司最近完成了一個5500億參數模型的預訓練。英偉達於2023年11月推出了第一個Nemotron模型,但該申報文件明確表示,這已不再是副業。

這一投資具有戰略意義,因為英偉達的晶片仍是訓練和運行前沿模型的默認基礎設施。針對其硬件調整的模型為客戶提供了留在英偉達的內在理由,儘管競爭對手努力推廣其他硬件。但背後更緊迫的壓力是:美國在開源AI競賽中正迅速失利。

根據OpenRouter和Andreessen Horowitz的研究,2024年底,中國開源模型的全球使用比例從不足1.2%飆升至約30%。阿里巴巴的Qwen超越Meta的Llama,成為最常用的自託管開源模型,根據Runpod的數據。美國公司如Airbnb也採用它來提供客戶服務。全球的初創公司都在其基礎上構建。除了市場份額,這種採用還會形成難以逆轉的基礎設施依賴。

儘管OpenAI、Anthropic和Google等美國巨頭將其最好的模型封鎖在API背後,但中國的DeepSeek、阿里巴巴等實驗室一直在湧入開源生態系統。Meta曾是唯一在開源方面與Llama競爭的美國主要玩家,但扎克伯格最近暗示公司未來可能不會完全開放模型。

“最佳專有模型”與“最佳開源模型”之間的差距曾經很大——而且偏向美國。如今,這個差距已經非常小,開源方面的優勢越來越偏向中國。

令人難以置信的圖表。僅用一年時間,中國就完全超越了美國在免費AI模型方面的領先。

現在前五名中沒有任何美國模型,而去年前三名都是美國的。pic.twitter.com/34ErpBv8rg

— Arnaud Bertrand (@RnaudBertrand) 2025年10月14日

這一切背後還有硬件威脅。一款新的DeepSeek模型預計很快就會推出,據傳完全在華為生產的晶片上訓練——華為是一家受到制裁的中國公司。如果這一點得到證實,將為全球開發者,尤其是中國的開發者,提供一個具體理由開始測試華為的硬件。中國的Ziphu AI已經在這樣做。

這正是英偉達最需要阻止的情景:中國的開源模型和中國的晶片建立一個完全不依賴英偉達的生態系統。