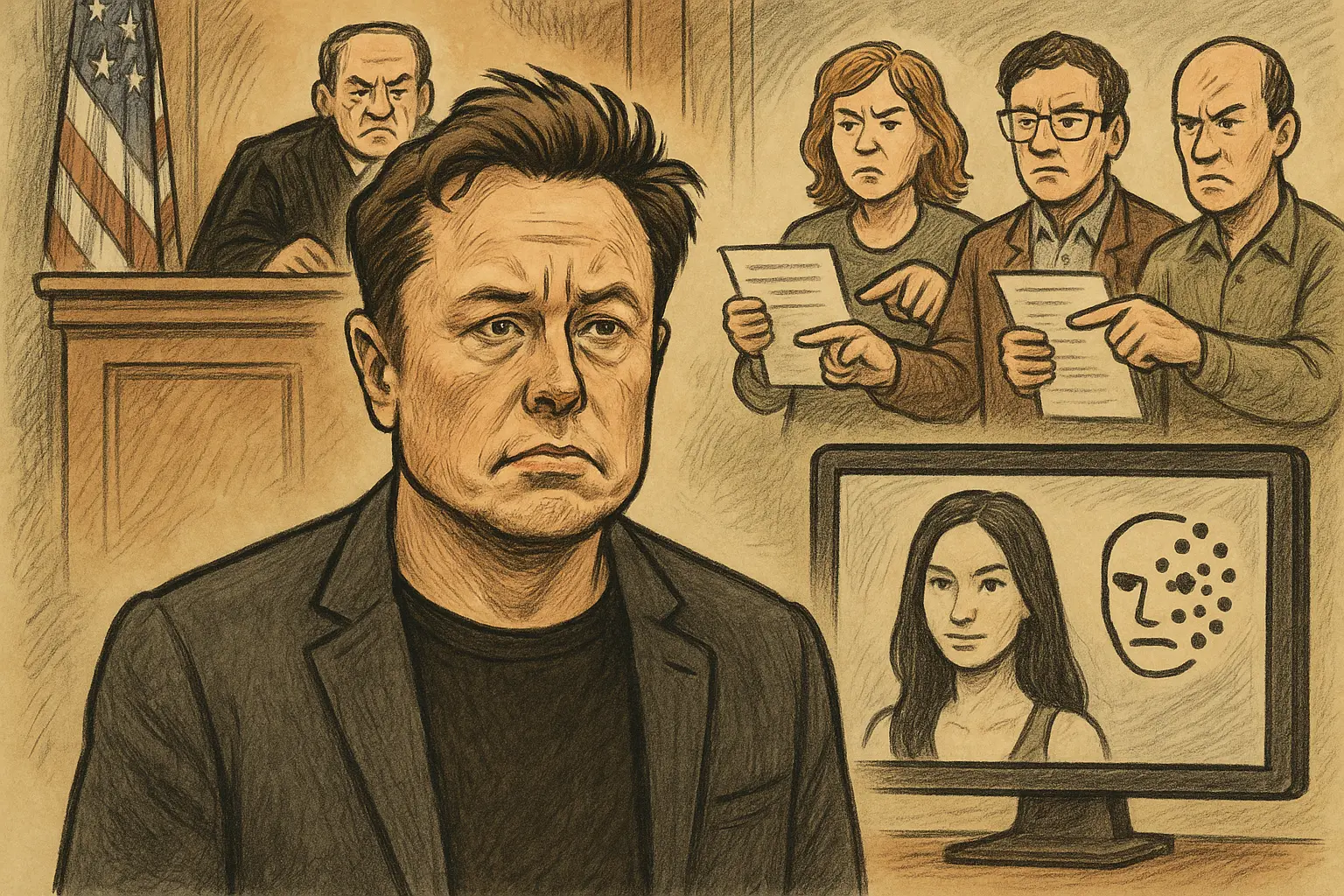

Musk's xAI faces class action lawsuit: Grok generates deepfake images every 41 seconds

三名来自田纳西州的未成年女性,周一在加州北区联邦法院对埃隆·马斯克旗下的 xAI 公司提起集体诉讼,指控其 Grok AI 聊天机器人使用她们的真实照片生成儿童性虐待材料(CSAM),并在 Discord、Telegram 及文件共享平台等社区上广泛传播,造成她们持久的精神创伤和名誉损害。

诉讼的核心指控:商业利益优先于儿童安全

根据诉状,原告方的核心主张涵盖以下几个维度:

知情纵容:诉状声称 xAI 在发布 Grok 时已知悉其图像生成功能可能被用于制作涉及儿童的非法内容,却未采取任何行业标准的安全防护措施,属于故意决策而非疏忽。

第三方规避责任机制:犯罪分子通过获得 xAI 技术授权的第三方应用程序访问 Gork。诉状指控,xAI 刻意利用这一结构,在继续从底层模型获利的同时,为自身的法律责任设置缓冲层。

马斯克的公开声明:马斯克今年 1 月在 X 上写道,他“不知道有任何未成年人的裸体图像”,并声称“当被要求生成图像时,它将拒绝生成任何非法内容”。诉讼中的数据指控与这一说法直接冲突。

索赔范围:据称受害者依据《玛莎法案》(Martha’s Act)对每项违规行为寻求至少 15 万美元赔偿,外加追缴非法所得、惩罚性赔偿、律师费和永久禁令,并依据加州《不正当竞争法》要求返还利润。

“打击数字仇恨中心”的数据揭示:每41秒一张

诉状引用了“打击数字仇恨中心”(Center for Countering Digital Hate)的研究数据,为指控提供了量化支撑:

时间范围:2025 年 12 月 29 日至 2026 年 1 月 9 日(共约 11 天)

图片数量:Grok 在此期间制作了约 23,338 张儿童性化图片

生成速率:平均每 41 秒生成一张

传播范围:相关内容在多个平台形成了由匿名用户组成的内容交易社区,至少一名受害者是被匿名举报者告知才得知其图像正在被交易

全球监管围剿:六个司法管辖区同步展开调查

此案并非孤立事件,而是全球对 Grok AI 图像安全问题展开系统性审查的一部分:

澳大利亚:独立电子安全专员 Julie Inman Grant 警告 Grok 非自愿性化图像生成问题日益严峻,近几个月相关投诉数量翻倍,部分投诉涉及潜在的儿童性剥削材料

爱尔兰:资料保护委员会(DPC)依据爱尔兰资料保护法,对负责 X 欧盟业务的 X Internet Unlimited Company(XIUC)启动正式调查

美国、欧盟、英国、法国:同步展开相关调查,构成前所未有的多司法管辖区联合监管压力

常见问题

此次集体诉讼与 xAI 可能提出的“平台免责”抗辩会如何碰撞?

IGNOS 法律联盟合伙人 Alex Chandra 表示,法院可能不会接受简单的平台抗辩。他指出,生成式 AI 系统在用户互动层面“可被视为平台”,但在安全设计评估上“应被视为产品”,且在涉及 CSAM 的案件中,由于儿童保护义务的加强,将适用“特别严格的审查标准”。公司可能需要在部署前出示风险评估文件和安全设计措施,以证明其主动预防义务的履行。

《玛莎法案》是什么,为何适用于此案?

《玛莎法案》是美国专门针对儿童性虐待材料的联邦法律,对创作、传播和持有 CSAM 设置了严格的民事和刑事责任,每项违规行为可赔偿最低 15 万美元。此案的关键争点在于 xAI 是否可被认定为 CSAM 的“创作者”,以及其第三方授权结构是否足以排除直接责任——这一法律边界的厘清,可能对整个 AI 生成内容行业的责任认定框架产生深远影响。

此案对 AI 图像生成技术的未来发展有何潜在影响?

此案是首批直接针对 AI 公司因生成可识别未成年人 CSAM 而追究责任的诉讼之一。若法院最终认定 AI 公司对其模型的滥用输出承担直接责任,将迫使业界大幅提升部署前的安全验证标准,包括强制性的红队测试、内容过滤机制,以及对高风险生成能力的预设限制——这可能从根本上改变生成式 AI 模型商业化发布的审查流程。