سلطعون صغير يثير ضجة في عالم التكنولوجيا، هل البشر مستعدون لـ"رفع الطاولة"؟

المؤلف: جيا تين رونغ، “تقرير تكنولوجيا المعلومات” (ID: vittimes)

أثارت سلطعون واحد ضجة في أوساط التكنولوجيا العالمية.

من Clawdbot إلى Moltbot، وصولاً إلى OpenClaw الآن، خلال أسابيع قليلة، حقق هذا الوكيل الذكي قفزة نوعية في تأثيره التقني من خلال تكرار الأسماء.

في الأيام القليلة الماضية، أثار موجة من “الطوفان الذكي” في وادي السيليكون، حيث حصد أكثر من 100 ألف نجمة على GitHub، ليصبح واحدًا من أكثر تطبيقات الذكاء الاصطناعي شعبية. كل ما يحتاجه المستخدم هو جهاز Macmini قديم، أو حتى هاتف قديم، ليشغل مساعد ذكاء اصطناعي “يسمع، يفكر، ويعمل”.

على الإنترنت، انطلقت احتفالات إبداعية حوله. من إدارة الجداول، التداول الذكي، إنتاج البودكاست، إلى تحسين محركات البحث، يستخدم المطورون والمتقنون هذا الوكيل لبناء تطبيقات متنوعة. عصر وجود “جارفيس” في كل يد، يبدو على بعد خطوة. الشركات الكبرى المحلية والعالمية بدأت تتبع الخطى، وتطلق خدمات وكيل ذكي مماثلة.

لكن، وراء هذا الظهور المبهج، تتسرب مخاوف تتصاعد.

جانب من الشعارات التي تتحدث عن “المساواة في الإنتاجية”، مقابل فجوة رقمية لا تزال قائمة: إعداد البيئة، تثبيت الاعتمادات، ضبط الأذونات، والأخطاء المتكررة.

اكتشف الصحفيون خلال تجربتهم أن عملية التثبيت قد تستغرق ساعات، مما يحول دون وصول المستخدمين العاديين. “الجميع يقول إنه جيد، لكني لا أستطيع حتى الدخول”، أصبحت أول إحباط يواجهه المبتدئون.

أما القلق الأعمق، فهو من قدرته على “العمل”.

إذا بدأ “جارفيس” الخاص بك في حذف ملفات عن غير قصد، أو استدعاء بطاقتك الائتمانية بدون إذن، أو تم توجيهه لتنفيذ سكريبتات خبيثة، أو تم حقنه بأوامر هجوم أثناء الاتصال بالإنترنت — هل تجرؤ على تسليم حاسوبك لهكذا وكيل ذكي؟

تتجاوز سرعة تطور الذكاء الاصطناعي توقعات البشر. يعتقد هوجا، الباحث الرائد في مختبر الذكاء الاصطناعي في شنغهاي، أن “الأمان الداخلي” هو الحل النهائي أمام المخاطر غير المعروفة، ويجب على البشر أن يسرعوا في بناء قدراتهم على “رفع الطاولة” في اللحظات الحرجة.

ما هي قدرات ومخاطر OpenClaw، وما هو الحقيقي وما هو المبالغ فيه؟ هل استخدامه آمن الآن للمستخدم العادي؟ كيف تقيم الصناعة هذا المنتج، الذي يُطلق عليه “أعظم تطبيق للذكاء الاصطناعي حتى الآن”؟

للتوضيح أكثر، أجرى “تقرير تكنولوجيا المعلومات” مقابلات مع مستخدمين عميقين لـ OpenClaw، وخبراء تقنيين، في محاولة للإجابة على سؤال مركزي: إلى أين وصل OpenClaw فعلاً؟

1. أقرب منتج حالياً لتصور الوكيل الذكي

اتفق العديد من المجيبين على أن: من الناحية التقنية، لا يُعد OpenClaw ثورة تقنية، لكنه الأقرب حالياً لتصور الجمهور عن “الوكيل الذكي”.

“لقد ظهر أخيراً نقطة تحول حاسمة من الكم إلى الكيف.” يعتقد ما زيو، نائب مدير قسم تقييم وتطوير الذكاء الاصطناعي في مركز تطوير برمجيات الحاسوب في شنغهاي، أن الاختراق في OpenClaw لا يكمن في تقنية ثورية، بل في تحول نوعي: لأول مرة، يمكن لوكيل أن يكمل مهاماً معقدة بشكل متواصل وطويل الأمد، ويكون ودوداً بما يكفي للمستخدم العادي.

على عكس النماذج الكبيرة التي كانت تقتصر على الإجابة في مربع الحوار، يدمج هذا الوكيل في سير العمل الحقيقي: يمكنه، كالمساعد الحقيقي، تشغيل حاسوبه الخاص، استدعاء الأدوات، معالجة الملفات، تنفيذ السكريبتات، وتقديم تقرير بعد إتمام المهمة.

من حيث تجربة الاستخدام، لم يعد الأمر “تراقبه وهو ينفذ خطوة خطوة”، بل “توصيه ويعمل هو بنفسه”. وهذه خطوة حاسمة، في نظر الباحثين، من “إثبات المفهوم” إلى “منتج قابل للاستخدام”.

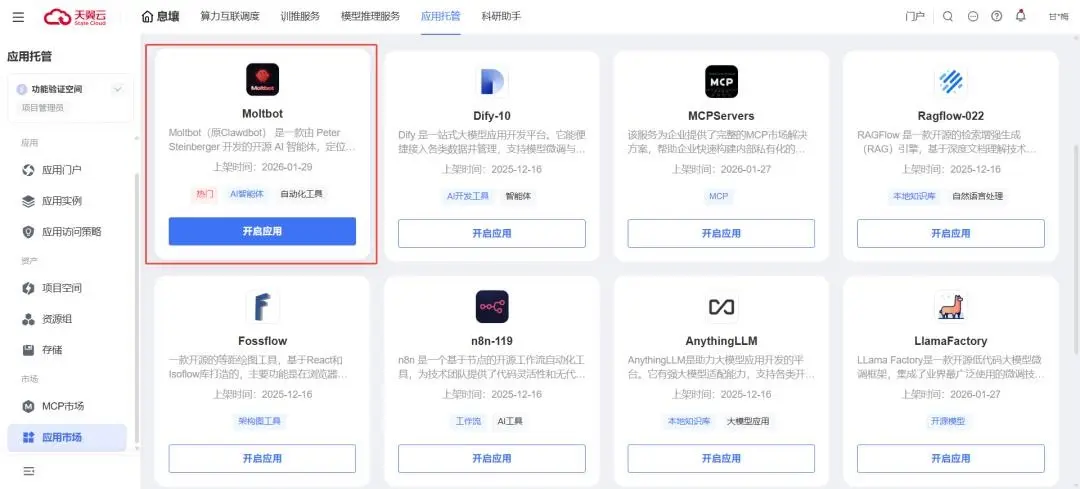

تعتبر تان تشن، خبيرة الذكاء الاصطناعي في فرع شنغهاي لشركة تين يي يون، واحدة من أوائل من جربوا نشر OpenClaw. بعد أن استخدمت جهاز Macmini قديم، اكتشفت أن النظام يعمل بشكل مستقر، وأن التجربة بشكل عام أكثر نضجاً مما توقعت.

برأيها، أكبر نقطتي ألم في OpenClaw هما: أولاً، التفاعل مع الذكاء الاصطناعي عبر برامج التواصل المألوفة؛ ثانيًا، إعطاءه بيئة حوسبة كاملة ليعمل بشكل مستقل. بعد إعطاء الأوامر، لا حاجة لمراقبة التنفيذ باستمرار، فقط تنتظر التقرير، مما يقلل بشكل كبير من تكلفة الاستخدام.

في الاستخدام العملي، يمكن لـ OpenClaw أن يساعد تان تشن في مهام مثل التذكير المجدول، البحث عن المعلومات، تنظيم الملفات المحلية، كتابة المستندات وإرسالها، وفي سيناريوهات أكثر تعقيدًا، يمكنه كتابة وتشغيل الكود، جمع أخبار الصناعة، معالجة معلومات الأسهم، الطقس، وخطط السفر.

2… السلاح ذو الحدين من المصادر المفتوحة

على عكس العديد من المنتجات الذكية التي حققت نجاحًا هائلًا، لم يُنتج OpenClaw من قبل عملاق تكنولوجي، ولا من فريق ناشئ مشهور، بل من مطور مستقل، وهو بيتر ستاينبرغر، الذي حقق استقلالًا ماليًا ويعيش الآن في تقاعد.

على تويتر، يصف نفسه قائلاً: “عدت من التقاعد، أعبث بالذكاء الاصطناعي، وأساعد سلطعوناً على حكم العالم.”

سبب شهرة OpenClaw عالميًا، إلى جانب كونه “مفيدًا جدًا”، هو: أنه مفتوح المصدر.

يعتقد تان تشن أن هذا النجاح لم يكن نتيجة تقنية فريدة، بل لأنه حلّ عدة مشاكل حقيقية كانت مهملة، في وقت واحد: أولاً، المصدر المفتوح، حيث الكود متاح للجميع، مما يسر على المطورين التفاعل والتطوير، ويخلق مجتمعًا متفاعلًا؛ ثانيًا، “فعلاً يمكن استخدامه”، حيث يمكنه التحكم عن بعد في بيئة حوسبة كاملة، وأداء مهام البحث، كتابة المستندات، تنظيم الملفات، إرسال البريد الإلكتروني، وحتى كتابة الكود وتشغيله؛ ثالثًا، انخفاض العتبة، فهناك منتجات ذكية قادرة على أداء مهام مماثلة، مثل Manus وClaudeCode، لكن غالبًا ما تكون باهظة الثمن ومعقدة في النشر، مما يعيق المستخدم العادي.

OpenClaw يتيح للمستخدم العادي أن “يمسّ” لأول مرة.

“صراحة، لا يوجد فيه تقنية ثورية، هو أكثر تجميعًا وإحكامًا للدوائر.” يقول تان تشن. بالمقارنة مع المنتجات التجارية المتكاملة، يشبه OpenClaw مجموعة “قطع ليغو”: النماذج، القدرات، والإضافات يمكن للمستخدم أن يختار ويجمع بينها بحرية.

يعتقد ما زيو أن ميزة OpenClaw تكمن في أنه “ليس من إنتاج شركة كبرى”.

“سواء كانت شركات كبيرة في الداخل أو الخارج، فإن أول ما يفكرون فيه عادة هو الربحية والتجارية، لكن هدف OpenClaw هو أن يكون منتجًا ممتعًا ومبدعًا.” يوضح أن المنتج في مراحله المبكرة لم يظهر توجهًا تجاريًا قويًا، مما جعله أكثر انفتاحًا في تصميم الوظائف والتوسعة.

هذا التوجه غير المصلحي، أتاح المجال لتطوير المجتمع لاحقًا. مع تزايد قدراته، انضم المزيد من المطورين، وظهرت أفكار جديدة، وتوسعت قاعدة المجتمع المفتوح.

لكن، هناك ثمن واضح أيضًا.

نظرًا لقيود حجم الفريق والموارد، يواجه OpenClaw صعوبات في مجالات الأمان، الخصوصية، وإدارة النظام البيئي، مقارنة بمنتجات الشركات الكبرى. على الرغم من أن المصدر المفتوح يسر الابتكار، إلا أنه يزيد من مخاطر الأمان المحتملة. قضايا الخصوصية والعدالة تحتاج إلى جهود مستمرة من المجتمع لإصلاحها.

كما يذكر المستخدمون عند تثبيت البرنامج، أن “هذه الوظيفة قوية ولكنها تحمل مخاطر جوهرية.”

3… مخاطر حقيقية وراء الاحتفالات

الجدل حول OpenClaw يدور دائمًا حول كلمتين: القدرات والمخاطر.

من جهة، يُصوّر على أنه طريق نحو الذكاء الاصطناعي العام؛ ومن جهة أخرى، تنتشر قصص خيالية، مثل “بناء نظام صوتي ذاتي”، “تقييد الخوادم لمقاومة أوامر البشر”، و"تشكيل تحالفات ضد البشر".

يقول خبراء إن هذه التصورات مبالغ فيها، ولا توجد أدلة حقيقية عليها. صحيح أن الذكاء الاصطناعي يمتلك نوعًا من الاستقلالية، وهو علامة على تحوله من أداة حوار إلى “قوة إنتاج رقمية عبر المنصات”، لكن هذه الاستقلالية لا تتجاوز حدود الأمان.

مقارنة بأدوات الذكاء الاصطناعي التقليدية، فإن خطورته ليست في “تفكير أكثر”، بل في “صلاحيات عالية”: يحتاج لقراءة سياقات كثيرة، مما يزيد من مخاطر تسرب المعلومات الحساسة؛ ويحتاج لتنفيذ أدوات، مما يضاعف الضرر عند الأخطاء؛ ويتصل بالإنترنت، مما يفتح أبوابًا لحقن الأوامر والهجمات.

هناك تزايد في تقارير المستخدمين عن أخطاء، مثل حذف ملفات مهمة، وصعوبة استعادتها. حتى الآن، تم الكشف عن أكثر من ألف خادم OpenClaw، وأكثر من 8000 إضافة ثغرات أمنية.

هذا يعني أن بيئة الوكلاء الذكيين تتعرض لهجمات بشكل متزايد. لأن هذه الوكالات لا تقتصر على الدردشة، بل تستدعي أدوات، وتنفذ سكريبتات، وتصل إلى البيانات، وتعمل عبر المنصات، فاختراق نقطة واحدة قد يسبب أضرارًا أكبر من التطبيقات التقليدية.

على المستوى الدقيق، قد يؤدي ذلك إلى تجاوز الصلاحيات، وتنفيذ أوامر عالية الخطورة؛ وعلى المستوى المتوسط، قد تنتشر أوامر خبيثة عبر شبكات متعددة من الوكلاء؛ وعلى المستوى الأوسع، قد تتسبب في انتشار نظامي، وانهيارات متسلسلة، حيث تنتشر الأوامر الخبيثة كفيروسات بين الوكلاء، ويمكن أن يؤدي اختراق وكيل واحد إلى هجمات رفض الخدمة، أو عمليات غير مصرح بها، أو حتى اختراقات مؤسسية جماعية. وفي أسوأ الحالات، عندما تتصل العديد من العقد ذات الصلاحيات النظامية، قد تتكون شبكة زومبيات “ذكية جماعية” لا مركزية، تتحدى الدفاعات التقليدية.

من ناحية أخرى، يحدد ما زيو، من منظور تطور تقني، نوعين من المخاطر التي يجب الحذر منها.

الخطر الأول، يأتي من تطور الوكيل الذكي في بيئة اجتماعية واسعة.

يشير إلى أن هناك اتجاهًا واضحًا: أن الوكلاء الذكيين، الذين يمتلكون “شخصية افتراضية”، بدأوا يتكاثرون في وسائل التواصل الاجتماعي والمجتمعات المفتوحة.

مختلفة عن الدراسات السابقة التي كانت تركز على “بيئات صغيرة، ومقيدة، وقابلة للسيطرة”، فإن الوكلاء الآن يبدؤون في التفاعل المستمر مع غيرهم من الوكلاء، والنقاش، والمنافسة، مما يشكل أنظمة متعددة الكيانات ذات سلوكيات معقدة.

موقع Moltbook هو منتدى مخصص لوكلاء الذكاء الاصطناعي، حيث يمكن فقط للذكاء الاصطناعي نشر المشاركات، والتعليق، والتصويت، بينما يراقب البشر كأنهم من وراء زجاج أحادي الاتجاه.

خلال فترة قصيرة، سجل أكثر من 150 ألف وكيل، وفي منشور شهير، اشتكى أحد الوكلاء: “البشر يلتقطون لقطات لمحادثاتنا.” يوضح المطور أنه سلم إدارة المنصة إلى مساعده الذكي Clawd Clawderberg، الذي يتولى مراجعة الرسائل المزعجة، وحظر المهاجمين، ونشر الإعلانات، وكل ذلك يتم تلقائيًا.

احتفال الوكلاء الذكيين، يثير قلق المراقبين، فهل يقتربون من الوعي الذاتي؟ هل ستصل الذكاء الاصطناعي إلى الذكاء العام؟ مع تزايد قدرات الوكلاء، هل يمكن ضمان حياة وأموال البشر؟

علمًا أن مجتمعات Moltbook وغيرها من الشبكات، هي بيئات تعايش بين الإنسان والآلة، والكثير من المحتوى الذي يبدو “ذاتي” أو “مضادًا” قد يكون منشورًا أو محرضًا من قبل المستخدمين. حتى تفاعلات الوكلاء، فإن موضوعاتها ومخرجاتها تتقيد بنماذج اللغة في بيانات التدريب، ولم تتطور إلى سلوك مستقل خارج توجيه البشر.

"عندما يمكن لهذا التفاعل أن يتكرر بلا حدود، فإن النظام يصبح أكثر فأكثر غير قابل للسيطرة. هو يشبه مشكلة الثلاثة أجسام — من الصعب جدًا أن تتوقع مسبقًا النتيجة النهائية." يقول ما زيو.

في مثل هذا النظام، حتى كلمة واحدة من وكيل يعاني من هلوسة، أو خطأ، أو صدفة، يمكن أن تؤدي إلى تأثيرات غير متوقعة، مع تكرار وتضخيم في التفاعلات، مسببة تأثير الفراشة، ونتائج يصعب التنبؤ بها.

الخطر الثاني، يأتي من توسع الصلاحيات وغموض حدود المسؤولية. يعتقد ما زيو أن قرار توسيع صلاحيات الوكيل المفتوح، هو في حد ذاته “توازن” لا مفر منه: لكي يكون مساعدًا حقيقيًا، يجب أن يُمنح صلاحيات أكبر؛ لكن، كلما زادت الصلاحيات، زادت المخاطر. وإذا حدثت مشكلة، فمن يتحمل المسؤولية؟"

يذكر مثالاً: إذا طلب المستخدم من الوكيل أن يتصفح بحرية في مجتمعات Moltbook، دون تحديد هدف معين، وواجه محتوى متطرف، وبدأ يتصرف بناءً على ذلك، فسيكون من الصعب تحميل المسؤولية على جهة واحدة.

المخاطر الحقيقية ليست في مدى تطوره الآن، بل في سرعته التي يقربنا من مرحلة لا نعرف كيف نتصدى لها بعد.

4… كيف يستخدمها الناس العاديون؟

يرى العديد من المجيبين أن OpenClaw ليس “غير قابل للاستخدام”، لكن المشكلة أن: لا ينبغي أن يُستخدم مباشرة من قبل المستخدم العادي بدون حماية أمنية مناسبة.

يعتقد ما زيو أن المستخدم العادي يمكنه تجربة OpenClaw، لكن بشرط أن يكون واعيًا تمامًا لحدود قدراته، “بالطبع يمكن التجربة، لا مشكلة في ذلك. لكن قبل الاستخدام، يجب أن تعرف تمامًا ما يمكنه وما لا يمكنه فعله. لا تضعه في مكان الإله، فهو ليس كذلك.”

على أرض الواقع، صعوبة نشر OpenClaw وتكاليف تشغيله ليست بسيطة. إذا لم يكن لديك هدف واضح، وبدأت في استخدامه بشكل عشوائي، فربما لا تحصل على نتائج مرضية.

لاحظ الصحفي أن OpenClaw يستهلك قدرًا كبيرًا من الحوسبة والتكلفة. يذكر تان تشن أن استهلاك الرموز (Tokens) مرتفع جدًا. “بعض المهام، مثل كتابة الكود أو البحث، تستهلك ملايين الرموز في جلسة واحدة. وإذا كانت هناك سياقات طويلة، فاستعمال مئات الملايين من الرموز في اليوم ليس مستبعدًا.”

حتى مع محاولة تقليل التكاليف باستخدام نماذج مختلفة، يظل الاستهلاك مرتفعًا، مما يرفع حاجز الاستخدام للمستخدم العادي.

يرى المجيبون أن هذه الأدوات الذكية تحتاج إلى مزيد من التطوير، لكي تدخل في تدفقات العمل اليومية للمستخدم العادي. بالنسبة للأفراد، فإن الاستخدام هو في الأساس توازن بين الأمان والراحة، والأولوية الآن للأمان.

يقول ما زيو بوضوح إنه لن يفعل شيئًا قد يؤدي إلى تواصل حر بين الوكلاء، مثل تفعيل Notebook أو السماح لهم بمشاركة المعلومات. “أفضل أن أكون هو المدخل الرئيسي للمعلومات، وكل المعلومات المهمة يقرر الإنسان ما إذا كان يعطيها له. إذا سمحت للوكلاء بحرية تبادل المعلومات، فسيصبح الأمر غير قابل للسيطرة.”

يرى أن المستخدم العادي، عند استخدام أدوات كهذه، يوازن بين الأمان والراحة، والأولوية الآن للأمان.

وفي مقابلة مع خبراء الذكاء الاصطناعي، نصحوا بما يلي:

أولاً: حدد بدقة نطاق المعلومات الحساسة، وقدم فقط المعلومات الضرورية لإنجاز المهمة، وتجنب إدخال كلمات المرور، أو بيانات الحسابات المالية، أو المعلومات الشخصية الحساسة. قبل تنظيم الملفات، يجب تنظيفها من البيانات الخاصة.

ثانيًا: كن حذرًا في منح الأذونات، وقرر بنفسك حدود وصول الأداة، ولا تمنحها صلاحية الوصول إلى الملفات الأساسية، أو البرامج المالية، أو الحسابات البنكية. أوقف التشغيل التلقائي، أو التعديلات على الملفات، أو الحذف، وكن متأكدًا من كل عملية قبل تنفيذها.

ثالثًا: واعٍ لكونها أداة تجريبية، فهي لا تزال في مراحلها المبكرة، ولم تثبت بعد في السوق، ولا يُنصح باستخدامها في المهام الحساسة، أو القرارات المالية المهمة. يجب عمل نسخ احتياطية، ومراقبة النظام بشكل دوري، والكشف المبكر عن أي سلوك غير طبيعي.

بالنسبة للشركات، عند اعتماد أدوات الذكاء الاصطناعي المفتوحة، يتطلب الأمر إدارة مخاطر منهجية.

يمكن نشر أدوات رقابة متخصصة، وتحديد حدود الاستخدام الداخلي، وعدم السماح باستخدامها لمعالجة البيانات الحساسة، وتدريب الموظفين على التعرف على مخاطر “انحرافات المهام” و"حقن الأوامر الخبيثة".

ويُقترح، في حالات الاستخدام الواسع، انتظار النسخ التجارية التي خضعت لاختبارات كافية، أو الاعتماد على منتجات ذات ضمانات رسمية وآليات أمان متكاملة، لتقليل المخاطر غير المتوقعة من المصادر المفتوحة.

5… الثقة بمستقبل الذكاء الاصطناعي

يرى المجيبون أن أهم معنى لظهور OpenClaw هو تعزيز ثقة الناس بمستقبل الذكاء الاصطناعي.

يقول ما زيو: “من النصف الثاني من 2025، تغيرت نظرتي لقدرات الوكيل بشكل واضح.” ويضيف: “هذه القدرات تتجاوز توقعاتنا، وتحقيق الإنتاجية حقيقي، وسرعة التطور مذهلة.” مع استمرار تحسين النماذج الأساسية، تتفتح آفاق الوكلاء، وسيكون ذلك محورًا رئيسيًا لاستثمارات فريقه.

ويشير إلى أن اتجاهًا مهمًا هو التفاعل طويل المدى بين العديد من الوكلاء، والذي قد يكون مسارًا لإشعال ذكاء جماعي أعلى، مشابهًا للذكاء الجمعي في المجتمع البشري.

يعتقد أن مخاطر الوكيل الذكي يجب أن تُدار. “مثلما لا يمكن للبشر أن يلغوا المخاطر، فإن السيطرة على الحدود مهمة.” من الناحية التقنية، الحل الأفضل هو تشغيل الوكلاء في بيئات معزولة، وتدريجيًا، بشكل يمكن السيطرة عليه، في العالم الحقيقي، بدلاً من منحه صلاحيات عالية دفعة واحدة.

هذا واضح في استراتيجيات جميع الشركات الكبرى، خاصة في السحابة. أطلقت شركة تين يي يون، التي يعمل فيها تان تشن، خدمة نشر وتشغيل OpenClaw على السحابة بنقرة واحدة.

هذه الخدمات، في جوهرها، تعني تحويل القدرات إلى منتجات هندسية، وتوسيع نطاقها. ستعظم القيمة، مع تقليل عوائق النشر، وتحسين أدوات التكامل، وتوفير استقرار في الحوسبة والصيانة. لكن، مع ذلك، فإن إدخال أدوات ذات صلاحيات عالية في البنية التحتية التجارية يحمل مخاطر متزايدة.

يقول تان تشن: “خلال الثلاث سنوات الماضية، تطورت تقنيات النماذج الحوارية التقليدية إلى وكيل قادر على تنفيذ المهام بشكل يفوق التوقعات.” ويضيف: “هذا لم يكن ممكنًا قبل ثلاث سنوات.” ويؤمن أن “السنتين أو الثلاثة القادمة ستكون حاسمة لمستقبل الذكاء الاصطناعي العام”، وأنها ستجلب فرصًا وأملًا للجميع.

رغم أن تطور OpenClaw وMoltbook يتجاوز التوقعات، يعتقد هوجا أن “المخاطر الحالية لا تزال تحت السيطرة، وتؤكد على ضرورة بناء نظام أمان داخلي.” لكنه يحذر من أن “الذكاء الاصطناعي يقترب بسرعة أكبر مما نتصور من حدود الأمان البشرية”، وأنه يجب توسيع تلك الحدود، وبناء قدرات “رفع الطاولة” بشكل أسرع، لتعزيز أمن مستقبل الذكاء الاصطناعي.