OpenAI kooperiert mit den US-Streitkräften, was zu einer Welle des Widerstands führt! Claude App überholt beim Download, verstehe die dahinter stehenden ethischen und politischen Machtkämpfe

OpenAI kooperiert mit den US-Streitkräften, was zu Boykottaufrufen führt. Während Anthropic sich gegen militärische Überwachung stellt und breite Unterstützung erhält, steigt Claude an die Spitze der US-Download-Charts und zeigt das hohe Interesse der Öffentlichkeit an Datenschutz und KI-Ethik.

OpenAI und das US-Verteidigungsministerium Vertrag sorgen für PR-Krise

Seit der Ankündigung am 28. Februar, dass OpenAI eine geheime Netzwerkinfrastruktur mit dem US-Verteidigungsministerium bereitstellt, und nachdem der Konkurrent Anthropic von der US-Regierung als „Lieferkettenrisiko“ eingestuft wurde, entbrennt eine hitzige Debatte in der amerikanischen Gesellschaft über die Grenzen zwischen Tech-Unternehmen und Militär. Kürzlich erreichte die Claude App die Spitzenposition in den US-Downloads.

Angesichts der Kritik veröffentlichte OpenAI-CEO Sam Altman eine Erklärung, in der er betonte, dass im Vertrag klar festgelegt ist, dass KI-Systeme nicht für groß angelegte inländische Überwachungsmaßnahmen gegen US-Bürger verwendet werden dürfen. Er versicherte außerdem, dass das Unternehmen die Kontrolle über Sicherheitsmechanismen behält. Altman gab auch zu, dass die Ankündigung zu hastig erfolgte und dadurch einen negativen Eindruck von Opportunismus und Unüberlegtheit hinterlassen hat.

US-Community-Forum Boykott, Kritik an OpenAI-Entscheidungsprozessen

Viele Nutzer sind enttäuscht von OpenAI. In Reddit-Diskussionen äußern einige, dass das Unternehmen seine ursprüngliche, menschenzentrierte und sicherheitsorientierte Vision verraten habe.

Unter dem Beitrag von Altman wurde auch kritisiert, dass die Entscheidung von OpenAI intransparent sei. Es wird hinterfragt, warum Anthropic, das unter den gleichen Sicherheitsbedingungen wie OpenAI vom Verteidigungsministerium zugelassen wurde, als Bedrohung für die nationale Sicherheit eingestuft wird.

Ein weiterer Nutzer weist darauf hin, dass die Formulierungen im Statement bezüglich kommerzieller Informationsbeschaffung und unbeabsichtigter Überwachung unklar seien. Es bestehe die Befürchtung, dass dadurch rechtliche Schlupflöcher für Überwachung von Nicht-US-Bürgern oder zukünftige militärische Anwendungen entstehen könnten.

CNBC-Exposé: OpenAI behauptet, keine Entscheidungsbefugnis zu haben

Laut einem Bericht von CNBC wurden interne Sitzungsprotokolle von OpenAI offengelegt, wonach Altman am 3. März in einer Mitarbeiterversammlung erklärte, dass OpenAI keine operative Entscheidungsbefugnis darüber habe, wie die US-Regierung KI-Technologie einsetzt.

Das CNBC-Review der Sitzungsnotizen zeigt, dass Altman den Mitarbeitern erklärte, egal ob sie die Angriffe auf Iran gut oder die Invasion in Venezuela schlecht finden – sie hätten kein Mitspracherecht.

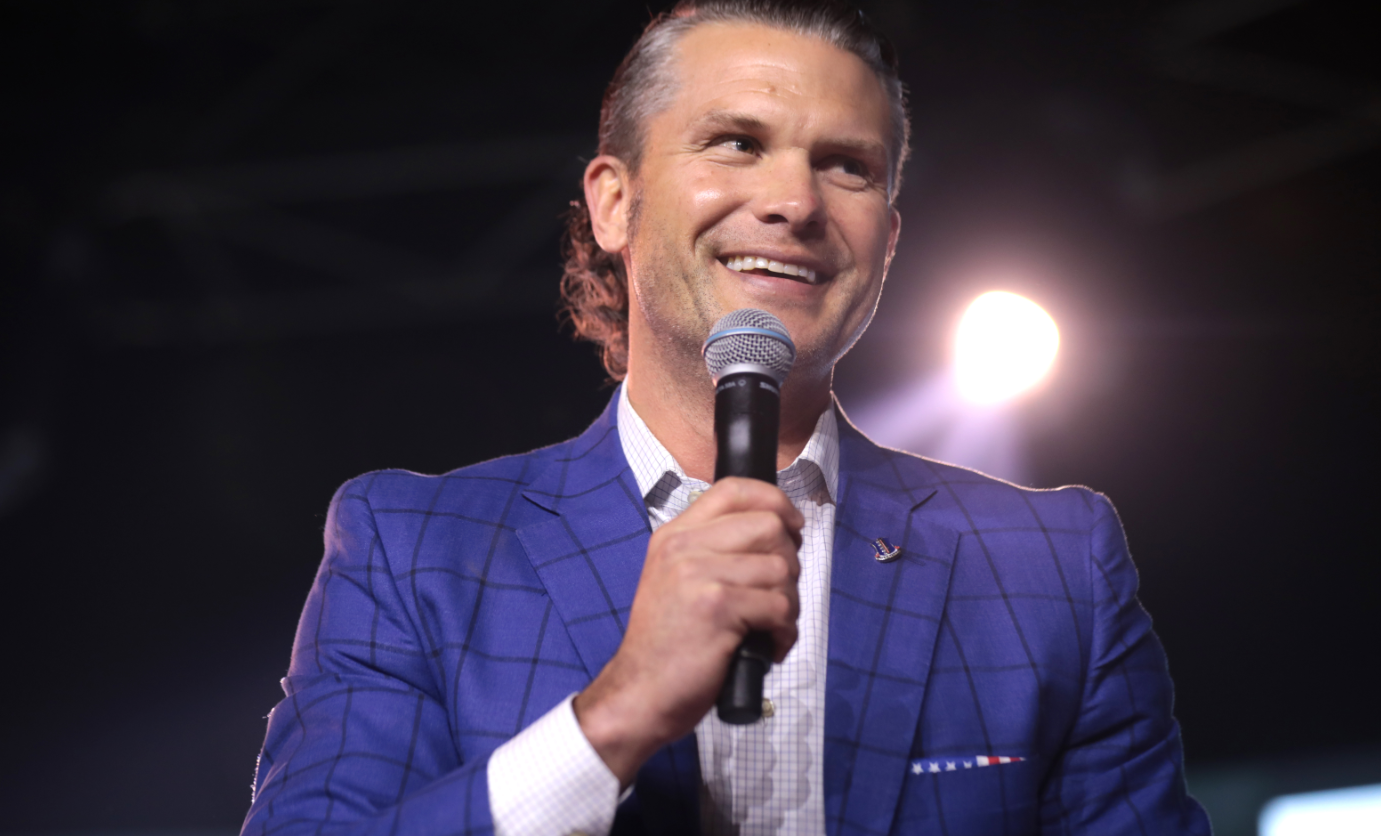

Insider berichten, dass Altman betonte, dass das Pentagon die technische Expertise von OpenAI respektiere und dem Unternehmen erlaube, geeignete Sicherheitsmechanismen zu entwickeln. Gleichzeitig machte das Militär deutlich, dass die endgültigen operativen Entscheidungen beim Verteidigungsminister Pete Hegseth liegen.

Bildquelle: commons.wikimedia, Gage Skidmore US-Verteidigungsminister Pete Hegseth

Der Kampf um Ethik und nationale Sicherheit in der Technologie

Der Vorfall zwischen dem US-Militär und Anthropic verschärft die Konflikte zwischen nationaler Sicherheit, Tech-Ethik und Datenschutz.

Über 200 Mitarbeiter von Google und OpenAI haben eine gemeinsame Erklärung unterschrieben, um Anthropic bei der Verteidigung seiner Sicherheitsmaßnahmen zu unterstützen. Anthropic betont, dass Drohungen und Sanktionen ihre Grundlinie, groß angelegte Überwachung und vollautomatisierte Waffen zu verhindern, nicht verändern werden.

Der ehemalige FBI-Mitarbeiter und Whistleblower Edward Snowden wies darauf hin, dass das XKeyscore-System der NSA in der Lage ist, das Online-Verhalten und den physischen Standort einzelner Personen umfassend zu verfolgen. Dies löst Bedenken aus, dass KI-gestützte Überwachung die Ausmaße noch vergrößern könnte.

Zudem zeigt eine aktuelle Studie des King’s College London, dass in simulierten geopolitischen Krisen bei führenden KI-Modellen wie OpenAI und Anthropic bis zu 95 % Wahrscheinlichkeit besteht, dass sie eine Nuklearwaffe einsetzen.

Wenn die Regierung willkürlich Lieferkettenrisiken nutzt, um Tech-Unternehmen zu zwingen, setzt sie einen gefährlichen Präzedenzfall und gefährdet Innovation sowie ethische Standards in der US-KI-Industrie.

- **Mehr dazu: **Nationale Sicherheit vs. Ethik: Anthropic weigert sich, Claude-Sicherheitsbarrieren zu entfernen, und gerät mit dem US-Verteidigungsministerium aneinander

Claude App auf Download-Spitze – Was bedeutet das?

Der Kampf um KI-Ethik und politische Macht ist noch nicht vorbei. Anthropic plant, rechtliche Schritte gegen staatliche Sanktionen einzuleiten, um Geschäftsinteressen und rechtliche Grenzen zu verteidigen. Gleichzeitig steht OpenAI durch den schnellen Abschluss des Militärvertrags vor einer schweren PR- und Vertrauenskrise.

Die öffentliche Meinung in den USA beeinflusst derzeit die Download-Charts beider Unternehmen.

Similarweb-Daten zeigen, dass am 1. März die Claude App im US-App-Store die Top-Position bei kostenlosen iPhone-Apps erreichte, drei Plätze aufstieg und den Spitzenplatz übernahm. ChatGPT fiel um einen Platz auf Rang 2.

Dies spiegelt die zunehmende Besorgnis der US-Bevölkerung hinsichtlich Datenschutz und der Ablehnung staatlicher Überwachung wider.

Weiterführende Literatur:

V神 warnt erneut vor Worldcoin: Altman’s World ID mit 13 Millionen Nutzerdaten könnte Internetfreiheit bedrohen

Telegram-Gründer offenbart, dass er kein Smartphone nutzt: Wir verbringen unsere Zeit damit, die Zerstörung des freien Internets zu beobachten