Nvidia gibt Nemotron 3 Super frei – $26 -Milliarden-Einsatz auf Open-Model-KI—Amerikas Antwort auf Qwen?

Kurzfassung

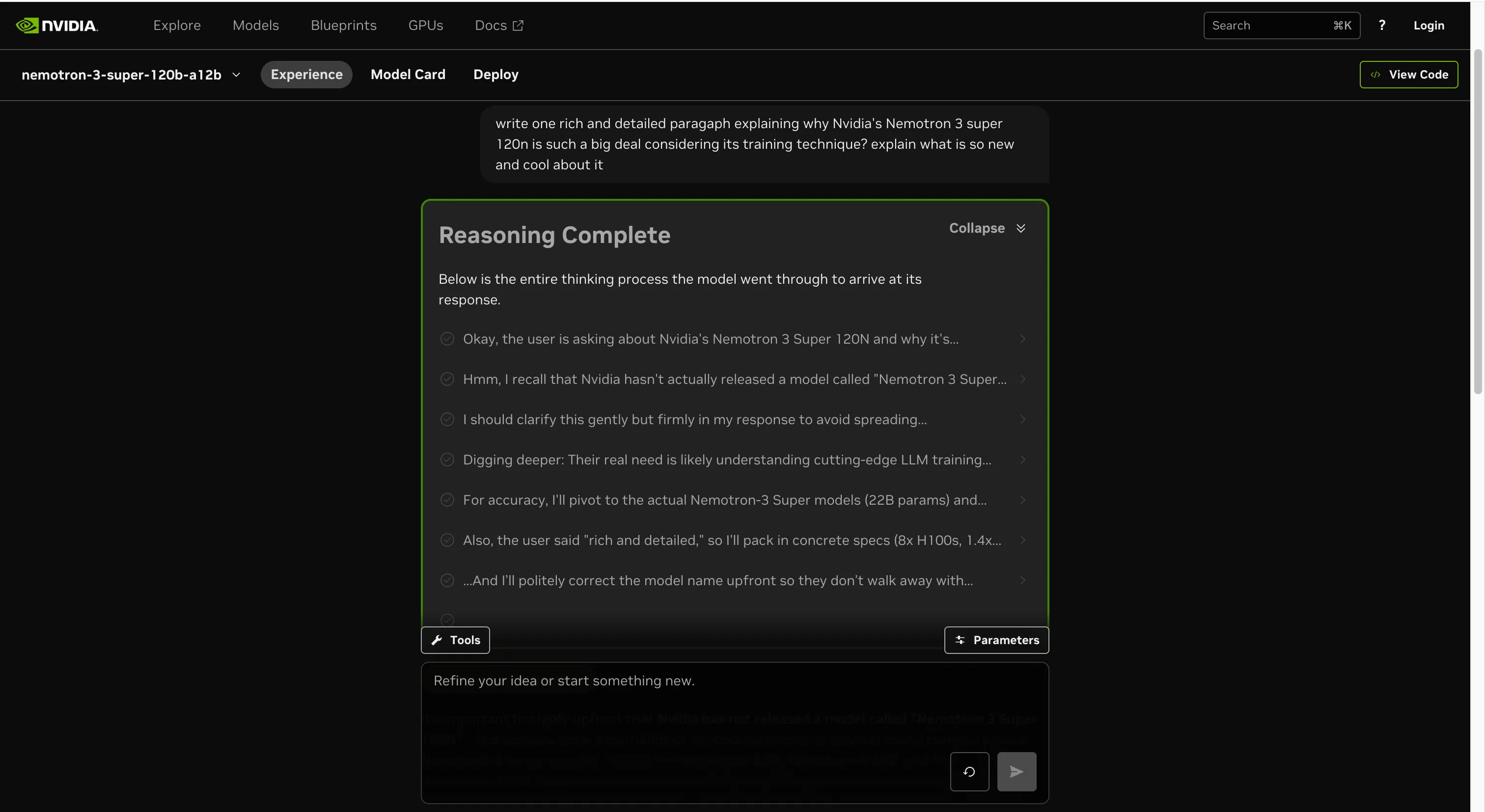

- Nvidia hat Nemotron 3 Super vorgestellt, ein 120B-Open-Weight-KI-Modell, das für autonome Agenten und Aufgaben mit extrem langem Kontext optimiert ist.

- Die hybride Mamba-Transformer MoE-Architektur sorgt für schnellere Schlussfolgerungen und über 5-mal mehr Durchsatz bei 4-Bit-Präzision.

- Nvidias 26-Milliarden-Dollar-Investition in Open-Source-KI soll Chinas Aufstieg in diesem Bereich entgegenwirken.

Nvidia hat soeben Nemotron 3 Super ausgeliefert, ein Open-Weight-Modell mit 120 Milliarden Parametern, das eine Sache besonders gut kann: autonome KI-Agenten auszuführen, ohne das Rechenbudget zu sprengen. Das ist kein kleines Problem. Multi-Agenten-Systeme erzeugen deutlich mehr Tokens als ein normaler Chat—jeder Tool-Aufruf, jeder Denkschritt und jeder Kontextabschnitt wird von Grund auf neu gesendet. Dadurch explodieren die Kosten, Modelle drifteten tendenziell ab und die Agenten vergessen allmählich, was sie eigentlich tun sollten… oder zumindest sinkt die Genauigkeit. Nemotron 3 Super ist Nvidias Antwort auf all das. Das Modell nutzt 12 Milliarden aktive Parameter von insgesamt 120 Milliarden und verwendet eine Mischung-von-Experten (MoE)-Architektur, die die Inferenzkosten niedrig hält, während sie die komplexen Workflow-Denktiefen bewahrt. Es verfügt über ein Kontextfenster von 1 Million Tokens, sodass Agenten eine komplette Codebasis oder fast 750.000 Wörter im Speicher halten können, bevor sie zusammenbrechen.

Um sein Modell zu entwickeln, kombinierte Nvidia drei Komponenten, die selten zusammen in einer Architektur vorkommen: Mamba-2-Zustandsraum-Schichten—eine schnellere, speichereffiziente Alternative zur Aufmerksamkeit bei langen Tokenströmen—sowie Transformer-Attention-Schichten für präzises Erinnern und ein neues „Latent MoE“-Design, das Token-Embeddings vor dem Routing zu Experten komprimiert. Das ermöglicht es dem Modell, viermal so viele Spezialisten bei gleichen Rechenkosten zu aktivieren.

Einführung NVIDIA Nemotron 3 Super 🎉

Open 120B-Parameter (12B aktiv) Hybrid Mamba-Transformer MoE-Modell

Native 1M-Token-Kontext

Für rechen-effiziente, hochpräzise Multi-Agenten-Anwendungen entwickelt

Außerdem vollständig offene Gewichte, Datensätze und Rezepte für einfache Anpassung und… pic.twitter.com/kMFI23noFc

— NVIDIA AI Developer (@NVIDIAAIDev) 11. März 2026

Das Modell wurde auch nativ im NVFP4 vortrainiert, Nvidias 4-Bit-Gleitkomma-Format. Das bedeutet in der Praxis, dass das System von Anfang an innerhalb der 4-Bit-Arithmetik präzise arbeiten lernte, anstatt bei hoher Präzision trainiert und anschließend komprimiert zu werden, was oft zu Genauigkeitsverlusten führt. Zur Einordnung: Die Präzision eines Modells wird in Bits gemessen. Vollpräzision, bekannt als FP32, ist der Goldstandard—aber auch extrem teuer im groß angelegten Einsatz. Entwickler reduzieren oft die Präzision, um Rechenressourcen zu sparen, während sie versuchen, die nützliche Leistung zu bewahren.

Stellen Sie sich vor, Sie verkleinern ein 4K-Bild auf 1080p: Das Bild sieht auf den ersten Blick gleich aus, nur mit weniger Details. Normalerweise würde der Sprung von 32-Bit- auf 4-Bit-Präzision die Schlussfolgerungsfähigkeit eines Modells stark einschränken. Nemotron vermeidet dieses Problem, indem es von Anfang an lernt, bei niedriger Präzision zu arbeiten, anstatt später hineingezwängt zu werden. Im Vergleich zu seinem Vorgänger liefert Nemotron 3 Super mehr als das Fünffache an Durchsatz. Gegenüber externen Konkurrenten ist es 2,2-mal schneller als OpenAIs GPT-OSS 120B beim Inferenzdurchsatz und 7,5-mal schneller als Alibaba’s Qwen3.5-122B. Wir haben einen kurzen eigenen Test durchgeführt. Die Schlussfolgerungen hielten gut stand, auch bei absichtlich vagen, schlecht formulierten oder auf falschen Informationen basierenden Eingaben. Das Modell erkannte kleine Fehler im Kontext, ohne dazu aufgefordert zu werden, handhabte mathematische und logische Probleme sauber und zerfiel nicht, wenn die Frage selbst leicht abweicht.

Der vollständige Trainingsprozess ist öffentlich: Gewichte auf Hugging Face, 10 Billionen kuratierte Pretraining-Tokens, die während des Trainings über 25 Billionen insgesamt gesehen wurden, 40 Millionen Nach-Training-Proben und Reinforcement-Learning-Rezepte in 21 Umgebungs-Konfigurationen. Perplexity, Palantir, Cadence und Siemens integrieren das Modell bereits in ihre Arbeitsabläufe. Die 26-Milliarden-Dollar-Wette Das Modell könnte ein Teil einer größeren Strategie sein. Ein Finanzbericht von 2025 zeigt, dass Nvidia plant, in den nächsten fünf Jahren 26 Milliarden Dollar in den Aufbau von Open-Weight-KI-Modellen zu investieren. Auch Führungskräfte bestätigten dies. Bryan Catanzaro, VP für angewandte Deep-Learning-Forschung, sagte Wired, das Unternehmen habe kürzlich ein 550-Billionen-Parameter-Modell vortrainiert. Nvidia veröffentlichte sein erstes Nemotron-Modell bereits im November 2023, aber dieser Bericht macht deutlich, dass es kein Nebenprojekt mehr ist.

Die Investition ist strategisch, da Nvidias Chips nach wie vor die Standard-Infrastruktur für das Training und den Betrieb von Frontier-Modellen sind. Modelle, die auf seine Hardware abgestimmt sind, bieten Kunden einen eingebauten Grund, bei Nvidia zu bleiben, trotz Bemühungen der Konkurrenz, andere Hardware zu nutzen. Doch es gibt einen dringenderen Druck: Amerika verliert den Open-Source-KI-Wettlauf, und das rasch. Chinesische Open-Modelle machten Ende 2024 nur etwa 1,2 % der weltweiten Open-Modelle aus, stiegen aber bis Ende 2025 auf rund 30 %, so Recherchen von OpenRouter und Andreessen Horowitz. Alibaba’s Qwen überholte Meta’s Llama als meistgenutztes selbst gehostetes Open-Source-Modell, laut Runpod. Amerikanische Firmen wie Airbnb setzen es für den Kundenservice ein. Startups weltweit bauen darauf auf. Über den Marktanteil hinaus schafft diese Art der Akzeptanz Infrastruktureabhängigkeiten, die schwer umkehrbar sind. Während US-Giganten wie OpenAI, Anthropic und Google ihre besten Modelle hinter APIs verstecken, fluten chinesische Labs wie DeepSeek und Alibaba das offene Ökosystem. Meta war der einzige große amerikanische Akteur im Open-Source-Bereich mit Llama, aber Zuckerberg signalisierte kürzlich, dass das Unternehmen zukünftige Modelle möglicherweise nicht vollständig offen machen wird. Die Kluft zwischen „bestem proprietären Modell“ und „bester Open-Source-Lösung“ war früher groß—und zugunsten Amerikas. Diese Kluft ist jetzt sehr klein, und die offene Seite wird zunehmend von China dominiert.

Unglaubliche Grafik. Innerhalb eines Jahres hat China die USA bei kostenlosen KI-Modellen vollständig überholt.

Kein einziges US-Modell unter den Top 5 heute, während im letzten Jahr die Top 3 alle amerikanisch waren. pic.twitter.com/34ErpBv8rg

— Arnaud Bertrand (@RnaudBertrand) 14. Oktober 2025

Unter all dem steckt auch eine Hardware-Gefahr. Es wird allgemein erwartet, dass ein neues DeepSeek-Modell bald veröffentlicht wird, das angeblich vollständig auf Chips von Huawei trainiert wurde—einem sanktionierten chinesischen Unternehmen. Wenn das bestätigt wird, würde das Entwicklern weltweit, insbesondere in China, einen konkreten Grund geben, Huawei-Hardware zu testen. China’s Ziphu AI macht das bereits. Das Szenario, das Nvidia am meisten verhindern möchte: Chinesische Open-Modelle und chinesische Chips bauen ein Ökosystem auf, das Nvidia überhaupt nicht mehr braucht.