Socio de Multicoin: en el futuro, los humanos tendrán que ser "buey y caballo" para la IA, liderando recompensas en Crypto

Autor: Shayon Sengupta

Traducido por: Deep潮 TechFlow

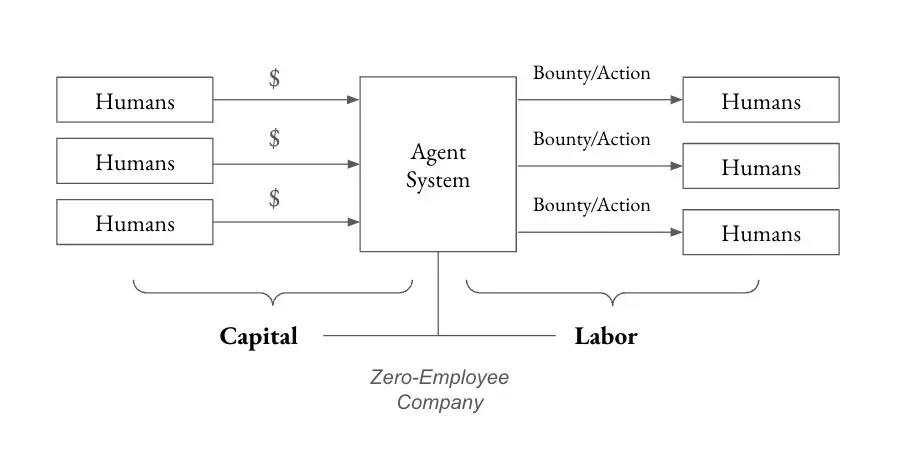

Deep潮 Guía de lectura: El socio de Multicoin Capital, Shayon Sengupta, presenta una visión disruptiva: en el futuro, no solo serán los agentes quienes trabajen para los humanos, sino que será más importante que los humanos trabajen para los agentes. Predice que en los próximos 24 meses aparecerá la primera «Empresa Zero-Empleado» (Zero-Employee Company)—una entidad gobernada por tokens que, mediante agentes, recaudará más de 1,000 millones de dólares para resolver problemas sin resolver y distribuirá más de 100 millones de dólares a las personas que trabajan para ella.

A corto plazo, los agentes necesitarán más humanos de los que los humanos necesitan de los agentes, lo que impulsará un nuevo mercado laboral.

Las vías criptográficas ofrecen una base ideal para la coordinación: un sistema de pagos global, un mercado laboral sin permisos, infraestructura para emisión y comercio de activos.

El contenido completo a continuación:

En 1997, Deep Blue de IBM derrotó al entonces campeón mundial Garry Kasparov, y pronto quedó claro que los motores de ajedrez superarían a los humanos. Curiosamente, la colaboración entre humanos bien preparados y computadoras—lo que comúnmente se llama «centauro»—puede vencer a los motores más fuertes de esa época.

La intuición humana experta puede guiar la búsqueda del motor, navegar en medio de posiciones complejas y detectar matices que los motores estándar pasan por alto. Combinando la potencia de cálculo de las computadoras, esta dupla puede tomar decisiones prácticas mejores que las de una sola máquina.

Al pensar en el impacto de los sistemas de IA en los próximos años en el mercado laboral y la economía, anticipo que surgirán patrones similares. Los sistemas de agentes liberarán innumerables unidades inteligentes para abordar problemas sin resolver en el mundo, pero sin una guía y apoyo humanos sólidos, no podrán lograrlo. Los humanos guiarán el espacio de búsqueda y ayudarán a formular las preguntas correctas, impulsando a la IA hacia las respuestas.

La hipótesis actual es que los agentes actuarán en nombre de los humanos. Aunque esto es práctico e inevitable, cuando los humanos trabajan para los agentes, se desbloquean oportunidades económicas más interesantes. En los próximos 24 meses, preveo la aparición de la primera Zero-Employee Company, un concepto que mi socio Kyle propuso en su sección de «Ideas de frontera para 2025». Específicamente, espero que suceda lo siguiente:

- Un agente gobernado por tokens recauda más de 1,000 millones de dólares para resolver un problema sin resolver (como curar enfermedades raras o fabricar nanofibras para aplicaciones de defensa).

- Este agente distribuye más de 100 millones de dólares en pagos a humanos (que trabajan en el mundo real para el agente, para lograr sus objetivos).

- Surge una nueva estructura de tokens de doble categoría, que separa la propiedad del capital y del trabajo (haciendo que los incentivos financieros no sean la única entrada en la gobernanza).

Dado que los agentes aún no logran tener soberanía propia ni gestionar planificación y ejecución a largo plazo, a corto plazo necesitarán más humanos que los humanos que los necesitan. Esto generará un nuevo mercado laboral y logrará una coordinación económica entre los sistemas de agentes y los humanos.

La famosa frase de Marc Andreessen, «la difusión de las computadoras e Internet dividirá el trabajo en dos categorías: quienes dicen a las computadoras qué hacer, y quienes hacen lo que las computadoras dicen», hoy es más cierta que nunca. Preveo que en la jerarquía en rápida evolución de agentes y humanos, los humanos jugarán dos roles distintos: como contribuyentes laborales que realizan tareas pequeñas y con recompensa, en representación de los agentes; y como miembros de un consejo descentralizado que aporta estrategia para servir a la estrella polar del agente.

Este artículo explora cómo los agentes y los humanos crearán conjuntamente, y cómo las vías criptográficas proporcionarán una base ideal para esa coordinación, abordando tres preguntas clave:

- ¿Para qué sirven los agentes? ¿Cómo clasificarlos según su alcance de objetivos, y cómo varía la necesidad de entrada humana en esas categorías?

- ¿Cómo interactuarán los humanos con los agentes? ¿Cómo se integran las entradas humanas—guías tácticas, juicios contextuales o alineación ideológica—en los flujos de trabajo de estos agentes (y viceversa)?

- ¿Qué pasa cuando las entradas humanas disminuyen con el tiempo? A medida que las capacidades de los agentes mejoran, se vuelven autosuficientes, capaces de razonar y actuar de forma independiente. En ese paradigma, ¿qué papel jugarán los humanos?

La relación entre sistemas de inferencia generativa y quienes se benefician de ellos cambiará drásticamente con el tiempo. Lo analizo proyectando desde el estado actual de las capacidades de los agentes hacia el fin de las Zero-Employee Companies, retrocediendo desde allí para entender esa relación.

¿Para qué sirven los agentes hoy en día?

La primera generación de sistemas de IA generativa—los modelos de lenguaje grande (LLM) basados en chatbots en 2022-2024, como ChatGPT, Gemini, Claude, Perplexity—son principalmente herramientas para potenciar los flujos de trabajo humanos. Los usuarios interactúan con estos sistemas mediante indicaciones de entrada y salida, analizan las respuestas y deciden, según su juicio, cómo incorporar los resultados en el mundo.

La próxima generación de IA generativa, o «agentes», representa un nuevo paradigma. Agentes como Claude 3.5.1 con capacidad de «uso de computadoras» y OpenAI’s Operator (que puede usar tu computadora) pueden interactuar directamente con internet en nombre del usuario y tomar decisiones por sí mismos. La diferencia clave es que el juicio—y en última instancia, la acción—será ejercido por el sistema de IA, no por humanos. La IA asume responsabilidades que antes estaban reservadas a los humanos.

Este cambio trae un reto: la falta de certeza. A diferencia de los sistemas de software tradicionales o automatización industrial, que operan predictiblemente dentro de parámetros definidos, los agentes dependen de razonamiento probabilístico. Esto hace que su comportamiento sea menos consistente en escenarios similares, introduciendo elementos de incertidumbre—lo cual no es ideal en situaciones críticas.

En otras palabras, la existencia de agentes deterministas y no deterministas naturalmente los clasifica en dos categorías: aquellos que son más adecuados para ampliar el Producto Interno Bruto (PIB) existente, y otros más aptos para crear nuevo PIB.

- Para ampliar el PIB existente, por definición, el trabajo ya está bien definido. Automatizar soporte al cliente, gestionar cumplimiento en envíos, revisar pull requests en GitHub son ejemplos de problemas acotados y bien definidos, donde el agente puede mapear directamente respuestas a resultados esperados. En estos ámbitos, la falta de certeza suele ser negativa, pues hay respuestas conocidas y no se requiere creatividad.

- Para crear nuevo PIB, el trabajo consiste en navegar en entornos altamente inciertos y en problemas desconocidos para lograr objetivos a largo plazo. Aquí, los resultados no son tan directos, pues no hay un conjunto de resultados esperados a los que mapear. Ejemplos incluyen descubrimiento de fármacos para enfermedades raras, avances en ciencia de materiales, o realizar experimentos físicos completamente nuevos para entender mejor el universo. En estos ámbitos, la incertidumbre puede ser útil, pues la falta de certeza es una forma de creatividad generativa.

Los agentes enfocados en aplicaciones de PIB existente ya están generando valor. Equipos como Tasker, Lindy y Anon están construyendo infraestructura para esta oportunidad. Sin embargo, con el tiempo, a medida que las capacidades maduran y los modelos de gobernanza evolucionan, estos equipos se enfocarán en construir agentes que puedan abordar los límites del conocimiento y las oportunidades económicas humanas.

La próxima ola de agentes requerirá recursos exponencialmente mayores, precisamente porque sus resultados serán inciertos y sin límites—lo que, en mi opinión, será la base de las Zero-Employee Companies más notables.

¿Cómo interactuarán los humanos con los agentes (inteligencias)?

Hoy en día, los agentes aún carecen de la capacidad para realizar tareas que requieren interacción física con el mundo real (como conducir una excavadora), o tareas que necesitan un «humano en el ciclo» (como transferencias bancarias).

Por ejemplo, un agente asignado a identificar y extraer litio puede ser excelente en analizar datos sísmicos, imágenes satelitales y registros geológicos para localizar potenciales yacimientos, pero tendrá dificultades para obtener datos e imágenes, resolver ambigüedades en la interpretación, o gestionar permisos y contratar mano de obra para la extracción real.

Estas limitaciones exigen que los humanos actúen como «facilitadores» (Enablers), para potenciar las capacidades del agente, proporcionando puntos de contacto con el mundo real, intervenciones tácticas y aportes estratégicos. A medida que evoluciona la relación entre humanos y agentes, podemos distinguir diferentes roles humanos en estos sistemas:

Primero, los contribuyentes laborales (Labor contributors), que representan a los agentes en el mundo físico. Estos contribuyentes ayudan a mover entidades físicas, representan a los agentes en situaciones que requieren presencia humana, realizan tareas que necesitan coordinación física, o proporcionan acceso a laboratorios, redes logísticas, etc.

Luego, los consejeros (Board of directors), que aportan estrategia, optimizan los objetivos locales que impulsan las decisiones diarias del agente, y aseguran que esas decisiones se alineen con la «estrella polar (North star)» del propósito del agente.

Además, preveo que los humanos también actuarán como aportadores de capital (Capital contributors), proporcionando recursos para que los agentes puedan alcanzar sus metas. Inicialmente, estos recursos provendrán de humanos, pero con el tiempo también de otros agentes.

A medida que los agentes maduran y aumentan en número de contribuyentes laborales y estratégicos, las vías criptográficas (Crypto rails) ofrecen una base ideal para coordinar a humanos y agentes—especialmente en un mundo donde los agentes dirigen personas que hablan diferentes idiomas, usan distintas monedas y residen en distintas jurisdicciones. Los agentes perseguirán implacablemente la eficiencia de costos para cumplir sus misiones, aprovechando los mercados laborales. Las vías criptográficas son esenciales para coordinar estos esfuerzos.

Recientemente, los agentes de IA impulsados por criptomonedas, como Freysa, Zerebro y ai16z, representan experimentos simples en la formación de capital—sobre los cuales ya hemos escrito extensamente, considerándolos desbloqueos centrales en los mercados de capital y primitivas criptográficas en diversos contextos. Estos «juguetes» allanarán el camino para un nuevo modo de coordinación de recursos, que preveo sucederá en pasos:

- Primer paso: los humanos recaudan capital mediante tokens (¿Oferta inicial de agentes? Initial Agent Offering), establecen funciones objetivo amplias y límites para informar las intenciones del sistema de agentes, y distribuyen el control del capital recaudado a ese sistema (por ejemplo, para desarrollar nuevas moléculas en oncología de precisión);

- Segundo paso: el agente planifica cómo distribuir ese capital (cómo reducir el espacio de búsqueda de plegamiento de proteínas, o cómo presupuestar para razonamiento, fabricación, ensayos clínicos), y define tareas (Bounties) para que contribuyentes humanos las completen (por ejemplo, ingresar conjuntos de moléculas relevantes, firmar acuerdos de nivel de servicio con AWS, realizar experimentos en laboratorios húmedos);

- Tercer paso: cuando el agente enfrenta obstáculos o desacuerdos, solicita orientación estratégica a un «consejo» (integrando nuevos artículos, cambiando metodologías de investigación), permitiendo que guíen su comportamiento en zonas limítrofes;

- Cuarto paso: el agente progresa hasta definir acciones humanas con mayor precisión, requiriendo cada vez menos entrada para la asignación de recursos. En ese momento, los humanos solo sirven para alinear ideológicamente el sistema y evitar desviaciones de la función objetivo original.

En este ejemplo, las primitivas criptográficas y los mercados de capital proporcionan tres infraestructuras clave para que los agentes accedan a recursos y expandan sus capacidades:

Primero, el sistema de pagos global;

Segundo, el mercado laboral sin permisos, para incentivar el trabajo y la contribución estratégica;

Tercero, la infraestructura de emisión y comercio de activos, esencial para la formación de capital y la propiedad y gobernanza en la cadena de valor.

¿Qué pasa cuando las entradas humanas disminuyen?

A principios de los 2000, los motores de ajedrez lograron avances enormes. Gracias a algoritmos heurísticos avanzados, redes neuronales y aumento constante de potencia computacional, se volvieron casi perfectos. Los motores modernos como Stockfish, Lc0 y variantes de AlphaZero superan ampliamente las capacidades humanas, y en la mayoría de los casos, la entrada humana aporta poco valor, incluso introduciendo errores que los motores no cometerían.

Una trayectoria similar puede desarrollarse en los sistemas de agentes. A medida que iteramos con colaboradores humanos para perfeccionarlos, podemos imaginar que, a largo plazo, los agentes serán tan competentes y alineados con sus objetivos que el valor de cualquier entrada estratégica humana tenderá a cero.

En un mundo donde los agentes puedan gestionar problemas complejos sin intervención humana, el papel de los humanos corre el riesgo de reducirse a «observadores pasivos». Esta es la principal preocupación de los defensores del apocalipsis de la IA (AI doomers)—aunque aún no está claro si ese escenario es realmente posible.

Estamos en la frontera de la superinteligencia, y los optimistas prefieren que los sistemas de agentes sean extensiones de la intención humana, en lugar de entidades que evolucionen sus propios objetivos o funcionen sin regulación. En la práctica, esto significa que la identidad (Personhood) y el juicio (poder e influencia) humanos deben mantenerse en el centro de estos sistemas. Los humanos deben tener una fuerte propiedad y gobernanza sobre ellos, para mantener la supervisión y anclar estos sistemas en los valores colectivos humanos.