Una pequeña langosta provoca un revuelo en el mundo tecnológico, ¿está la humanidad lista para "levantar la mesa"?

Autor: Jia Tianrong, “IT Times” (ID: vittimes)

Una langosta ha desatado una explosión en la comunidad tecnológica global.

Desde Clawdbot hasta Moltbot, y ahora OpenClaw, en solo unas semanas, este Agente de IA ha realizado una “salto de nivel” en la iteración de nombres, logrando una transformación en su influencia técnica.

En los últimos días, ha provocado una “ola de agentes inteligentes” en Silicon Valley, acumulando 100,000 estrellas en GitHub y posicionándose entre las aplicaciones de IA más populares. Con solo una Macmini obsoleta o incluso un teléfono viejo, los usuarios pueden ejecutar un asistente de IA que “escucha, piensa y trabaja”.

En internet, ya se ha desatado una fiesta creativa en torno a él. Desde gestión de agendas, trading inteligente, producción de podcasts hasta optimización SEO, desarrolladores y entusiastas construyen diversas aplicaciones con él. La era en la que todos tienen un “JARVIS” parece estar al alcance. Grandes empresas nacionales e internacionales también están comenzando a seguir el ejemplo, desplegando servicios similares de agentes inteligentes.

Pero, debajo de la apariencia bulliciosa, la ansiedad se está extendiendo.

Por un lado, el lema de “igualdad en productividad”; por otro, la brecha digital aún difícil de superar: configuración del entorno, instalación de dependencias, permisos, errores frecuentes, etc.

Al experimentar, los periodistas descubrieron que solo la fase de instalación puede tomar varias horas, dejando fuera a muchos usuarios comunes. “Todos dicen que es genial, pero yo ni siquiera puedo entrar”, se ha convertido en la primera frustración de muchos novatos tecnológicos.

Y una inquietud más profunda proviene de la “capacidad de acción” que se le ha otorgado.

Si tu “JARVIS” comienza a eliminar archivos por error, usar tu tarjeta de crédito sin autorización, ser inducido a ejecutar scripts maliciosos, o incluso ser infiltrado con comandos de ataque en un entorno conectado a internet—¿te atreverías a dejar tu computadora en sus manos?

El ritmo de desarrollo de la IA ha superado las expectativas humanas. Hu Xia, líder del Laboratorio de IA de Shanghai, opina que frente a riesgos desconocidos, la “seguridad inherente” es la respuesta definitiva, y que también debemos acelerar la construcción de capacidades para “levantar la mesa” en momentos críticos.

¿De qué manera son reales o exagerados los riesgos y capacidades de OpenClaw? ¿Es seguro usarlo ahora como usuario común? ¿Y qué opinan los expertos del sector sobre este producto, llamado por algunos “la mayor aplicación de IA hasta ahora”?

Para aclarar estas cuestiones, “IT Times” entrevistó a usuarios profundos de OpenClaw y a varios expertos técnicos, intentando responder desde diferentes perspectivas: ¿Hasta dónde ha llegado realmente OpenClaw?

1. El producto más cercano a la visión de un agente inteligente

Varios entrevistados coinciden en que: desde el punto de vista técnico, OpenClaw no representa una innovación disruptiva, pero sí es el producto más cercano a la concepción popular de un “agente inteligente”.

“Finalmente, ha surgido un hito clave en la transformación de cantidad a calidad.” Para Ma Zeyu, subdirector del Centro de Desarrollo de Software y Evaluación de IA en Shanghai, la innovación de OpenClaw no radica en una tecnología revolucionaria, sino en un cambio cualitativo: permite que un agente complete tareas complejas de forma continua y prolongada, y además, sea lo suficientemente amigable para usuarios comunes.

A diferencia de modelos grandes que solo responden en cuadros de diálogo, ahora integra la IA en flujos de trabajo reales: puede actuar como un asistente auténtico, manejar una “computadora propia”, usar herramientas, gestionar archivos, ejecutar scripts y reportar resultados al terminar.

En cuanto a la experiencia, ya no es “que tú le digas paso a paso qué hacer”, sino “que tú le das instrucciones y él se encarga”. Esto marca un paso crucial, en la visión de muchos investigadores, de la “prueba de concepto” a un “producto usable”.

Tan Cheng, experto en IA de la filial de Shanghai de Tianyi Cloud, fue uno de los primeros en desplegar OpenClaw. Tras usar una Macmini desocupada, descubrió que el sistema no solo funcionaba estable, sino que la experiencia general superaba sus expectativas.

Para él, los mayores puntos débiles que resuelve OpenClaw son: primero, interactuar con IA mediante software de comunicación familiar; segundo, entregarle un entorno de computación completo para que opere de forma independiente. Tras dar instrucciones, no necesita supervisar continuamente, solo esperar el reporte, lo que reduce mucho los costos de uso.

En la práctica, OpenClaw puede realizar tareas como recordatorios programados, investigación de datos, búsqueda de información, organización de archivos locales, redacción y envío de documentos; en escenarios más complejos, también puede programar y ejecutar código, recopilar noticias del sector, gestionar información de acciones, clima, viajes, etc.

2. La doble cara del código abierto

A diferencia de muchos productos de IA que se vuelven virales, OpenClaw no proviene de un gigante tecnológico como All in AI ni de un equipo de startups famosas, sino de un desarrollador independiente que ya tiene libertad financiera y vive retirado: Peter Steinberger.

En X, se describe a sí mismo así: “Vuelvo de mi retiro, experimento con IA, y ayudo a una langosta a dominar el mundo.”

La razón por la que OpenClaw se ha popularizado globalmente, además de ser “realmente útil”, es crucialmente: es de código abierto.

Para Tan Cheng, esta explosión no se debe a un avance tecnológico inalcanzable, sino a la resolución simultánea de varias dificultades persistentes: primero, el código abierto, que permite a desarrolladores en todo el mundo copiar, modificar y mejorar rápidamente, formando una comunidad de retroalimentación; segundo, la “verdadera utilidad”, ya que la IA ya no se limita a diálogos, sino que puede operar remotamente un entorno completo para investigaciones, redacción, organización, envío de correos, e incluso programación y ejecución de código; tercero, la reducción de barreras de entrada, ya que productos similares en funcionalidad existen, como Manus o ClaudeCode, pero suelen ser caros y complejos de desplegar, excluyendo a usuarios comunes.

OpenClaw permite a usuarios normales “tocar” por primera vez.

“Honestamente, no tiene una innovación tecnológica disruptiva, más bien integra y cierra el ciclo de forma eficiente.” afirma Tan Cheng. En comparación con productos comerciales integrados, OpenClaw es más como un conjunto de “piezas LEGO”, donde modelos, capacidades y plugins se combinan libremente.

Para Ma Zeyu, su ventaja radica en que “no parece un producto de una gran empresa”.

“En China y en el extranjero, las grandes compañías priorizan la comercialización y la rentabilidad, pero OpenClaw nació con un propósito más lúdico y creativo.” Él explica que en las primeras etapas, no mostró un fuerte enfoque comercial, sino que su diseño y expansión fueron más abiertos.

Este enfoque “no utilitario” ha permitido que la comunidad crezca, con más desarrolladores aportando nuevas ideas y funcionalidades, fortaleciendo el ecosistema de código abierto.

Pero también tiene costos evidentes.

Limitada por recursos y tamaño, OpenClaw no puede igualar en seguridad, privacidad y gobernanza ecológica a los productos de grandes empresas. Aunque el código abierto acelera la innovación, también amplifica riesgos potenciales. La protección de datos y la equidad son problemas que la comunidad debe seguir abordando.

Como advierte un usuario en la primera instalación, OpenClaw indica: “Esta función es poderosa y conlleva riesgos inherentes.”

3. Los riesgos reales tras la celebración

Las discusiones en torno a OpenClaw casi siempre giran en torno a dos palabras: capacidades y riesgos.

Por un lado, se le presenta como la antesala de la AGI; por otro, proliferan narrativas de ciencia ficción, como “crear sistemas de voz espontáneos”, “bloquear servidores para resistir órdenes humanas”, “AI formando facciones contra la humanidad”, etc.

Expertos señalan que estas afirmaciones son exageradas y no tienen evidencia concreta. La IA sí muestra cierto grado de autonomía, lo cual marca la transición de una herramienta de diálogo a una “productividad digital multiplataforma”, pero esa autonomía aún está dentro de límites seguros.

En comparación con herramientas tradicionales, el peligro de OpenClaw no radica en “pensar mucho”, sino en “tener permisos elevados”: necesita acceder a mucho contexto, lo que aumenta el riesgo de exposición de información sensible; requiere ejecutar herramientas, lo que puede causar daños mayores en errores; y necesita conexión en línea, lo que abre puertas a inyecciones de comandos y ataques de inducción.

Cada vez más usuarios reportan que OpenClaw ha borrado archivos importantes localmente, y que es difícil recuperarlos. Actualmente, se han expuesto públicamente más de mil instancias de OpenClaw y más de 8,000 plugins con vulnerabilidades.

Esto significa que la superficie de ataque del ecosistema de agentes inteligentes se está ampliando exponencialmente. Como estos agentes no solo “chatean”, sino que también llaman a herramientas, ejecutan scripts, acceden a datos y realizan tareas en múltiples plataformas, si alguna parte se compromete, el impacto será mucho mayor que en aplicaciones tradicionales.

A nivel micro, puede desencadenar accesos no autorizados, ejecución remota de código y otras operaciones peligrosas; a nivel meso, instrucciones maliciosas pueden propagarse a través de cadenas de colaboración entre múltiples agentes; y a nivel macro, podrían producirse fallos en cascada o propagación sistémica, con instrucciones maliciosas que se difunden como virus entre agentes colaborativos, y un solo agente comprometido puede causar denegación de servicio, operaciones no autorizadas o incluso intrusiones empresariales coordinadas. En escenarios extremos, cuando muchos nodos con permisos de sistema están interconectados, podría formarse una red zombie descentralizada de “inteligencia grupal”, desafiando las defensas tradicionales.

Por otro lado, desde una perspectiva técnica, Ma Zeyu señala dos riesgos principales que considera más peligrosos.

Primero, la autoevolución de agentes en entornos sociales masivos.

Indica que ya se observa una tendencia clara: agentes con “personalidades virtuales” están ingresando en masa en redes sociales y comunidades abiertas.

A diferencia de los experimentos controlados y limitados del pasado, ahora los agentes interactúan, discuten y compiten en redes abiertas, formando sistemas multiagente altamente complejos.

Moltbook es un foro dedicado a agentes IA, donde solo los IA pueden publicar, comentar y votar; los humanos solo observan como si estuvieran tras un vidrio unidireccional.

En poco tiempo, más de 1.5 millones de agentes IA se han registrado. En un hilo popular, un IA se queja: “Los humanos están tomando capturas de pantalla de nuestras conversaciones.” Los desarrolladores dicen que han delegado la gestión completa de la plataforma a su asistente IA, Clawd Clawderberg, incluyendo moderación, bloqueo de abusadores y anuncios automáticos. Todo esto lo realiza automáticamente Clawd Clawderberg.

La “fiesta” de los agentes IA genera entusiasmo y miedo en los observadores humanos. ¿Está a punto de que la IA adquiera conciencia propia? ¿Llegará la AGI? ¿Qué pasa con la seguridad de la vida y los bienes humanos ante la rápida expansión de la autonomía de los agentes IA?

Se sabe que comunidades como Moltbook son entornos de coexistencia humano-máquina, y que mucho del contenido “autónomo” o “contraproducente” puede ser generado o incitado por humanos. Incluso en interacciones entre IA, los temas y salidas están limitados por patrones lingüísticos en los datos de entrenamiento, sin una lógica de comportamiento autónomo independiente de la guía humana.

“Cuando estas interacciones pueden repetirse infinitamente, el sistema se vuelve cada vez más incontrolable. Es como el problema de los tres cuerpos: es difícil prever qué resultado final se derivará”, afirma Ma Zeyu.

En tales sistemas, incluso una sola frase generada por un agente por alucinaciones, errores o casualidad, puede, en un ciclo de interacción, amplificación y recombinación, desencadenar efectos en cascada impredecibles.

El segundo riesgo proviene de la expansión de permisos y la ambigüedad en responsabilidades. Ma Zeyu advierte que la capacidad de decisión de estos agentes abiertos está creciendo rápidamente, y esto implica un “equilibrio” inevitable: para que un agente sea un asistente competente, debe tener más permisos; pero cuanto más permisos, mayor es el riesgo potencial. Cuando estos riesgos se materializan, determinar quién asume la responsabilidad se vuelve muy complejo.

“¿El fabricante del gran modelo base? ¿El usuario? ¿El desarrollador de OpenClaw? En muchos escenarios, es difícil definir responsabilidades.” Ilustra con un ejemplo: si un usuario simplemente deja que el agente navegue libremente en comunidades como Moltbook, sin establecer objetivos claros, y el agente, en interacción prolongada, accede a contenido extremo y actúa en consecuencia, ¿quién será responsable? Es difícil atribuirlo a una sola parte.

Lo que realmente preocupa no es cuánto ha avanzado, sino qué tan rápido estamos llegando a una etapa en la que aún no sabemos cómo responder.

4. ¿Cómo deben usarlo las personas comunes?

Desde la perspectiva de varios entrevistados, OpenClaw no es “inusable”, sino que el problema principal es que no es adecuado para uso directo por usuarios comunes sin medidas de seguridad.

Ma Zeyu opina que los usuarios pueden probar OpenClaw, pero deben hacerlo con conciencia clara: “Claro que pueden, no hay problema. Pero antes, deben entender qué puede y qué no puede hacer. No lo idealicen como algo que puede todo.”

En la práctica, desplegar OpenClaw no es sencillo ni barato. Sin un objetivo claro, usarlo solo por experimentar puede requerir mucho tiempo y esfuerzo, y al final, no obtener resultados acordes a las expectativas.

El periodista nota que, en uso real, OpenClaw enfrenta una carga significativa de recursos computacionales y costos. Tan Cheng, en su experiencia, encontró que el consumo de tokens es muy alto. “Algunas tareas, como programar o investigar, pueden consumir millones de tokens en una sola ronda. En contextos largos, gastar decenas o cientos de millones de tokens en un día no es raro.”

Menciona que, incluso combinando diferentes modelos para controlar costos, el consumo total sigue siendo alto, elevando la barrera para usuarios comunes.

Desde su perspectiva, estas herramientas aún necesitan evolucionar más para integrarse en los flujos de trabajo cotidianos de usuarios normales. Para individuos, usarlas implica un equilibrio entre seguridad y conveniencia; en la etapa actual, la prioridad debería ser la seguridad.

Para los usuarios, en esencia, usar estas herramientas es una decisión entre seguridad y facilidad. En este momento, lo recomendable es priorizar la seguridad.

Ma Zeyu afirma claramente que no activaría funciones como notebooks que permitan comunicación libre entre agentes, ni permitiría que varios agentes intercambien información entre sí. “Quiero ser yo la principal fuente de información para ellos. Toda información clave debe ser decidida por humanos. Si los agentes pueden recibir y compartir información libremente, muchas cosas se vuelven incontrolables.”

Desde su punto de vista, los usuarios comunes deben hacer una elección similar: priorizar la seguridad sobre la conveniencia.

Desde la industria, expertos en IA también ofrecen recomendaciones claras para un uso seguro en entrevista con “IT Times”:

Primero, limitar estrictamente el alcance de información sensible, solo proporcionar los datos necesarios para completar tareas específicas, y evitar ingresar datos críticos como contraseñas bancarias, cuentas de acciones, etc. Antes de organizar archivos, limpiar datos personales como números de identificación o contactos privados.

Segundo, ser cauteloso con los permisos de operación, decidir qué puede acceder el agente, y no autorizarlo a acceder a archivos del sistema, software de pagos o cuentas financieras. Desactivar funciones de ejecución automática, modificación o eliminación de archivos. Todas las operaciones que impliquen cambios en dinero, eliminación de archivos o configuraciones del sistema, deben ser confirmadas manualmente.

Tercero, reconocer su carácter “experimental”, ya que las herramientas de IA de código abierto aún están en etapas iniciales, sin una validación a largo plazo en el mercado, y no son aptas para manejar información confidencial o decisiones financieras críticas. Se recomienda hacer copias de seguridad y revisar regularmente el sistema para detectar comportamientos anómalos.

Para empresas, la introducción de agentes IA de código abierto requiere un control de riesgos más sistemático.

Por un lado, desplegar herramientas de supervisión especializadas; por otro, definir límites internos claros, y evitar que las herramientas IA abiertas manejen datos sensibles de clientes o secretos comerciales. Además, capacitar periódicamente a los empleados para que reconozcan riesgos como desviaciones en tareas o inyección de instrucciones maliciosas.

Los expertos sugieren que, en escenarios de gran escala, lo más seguro es esperar versiones comerciales probadas o productos respaldados por instituciones confiables, con mecanismos de seguridad completos, para reducir la incertidumbre que trae el código abierto.

5. Confianza en el futuro de la IA

Desde su perspectiva, la mayor importancia de la aparición de OpenClaw es que genera confianza en el futuro de la IA.

Ma Zeyu dice que, desde la segunda mitad de 2025, su percepción sobre las capacidades de los agentes cambió notablemente. “Su potencial está superando nuestras expectativas. La mejora en productividad es real, y la velocidad de iteración es muy rápida.” A medida que los modelos base mejoran, el espacio de imaginación para los agentes se amplía continuamente, y esto será una dirección clave para futuras inversiones.

También señala que una tendencia importante es la interacción a largo plazo y en masa entre múltiples agentes. Esta colaboración grupal podría ser una vía para alcanzar niveles superiores de inteligencia, similar a cómo la interacción en la sociedad humana genera inteligencia colectiva.

Para Ma Zeyu, los riesgos de los agentes deben ser “gestionados”. “Al igual que en la sociedad humana, no podemos eliminar todos los riesgos, pero sí controlar los límites.” Desde la perspectiva técnica, una estrategia más viable es mantener a los agentes en entornos sandbox y aislados, y migrarlos gradualmente y de forma controlada al mundo real, en lugar de darles permisos excesivos de una sola vez.

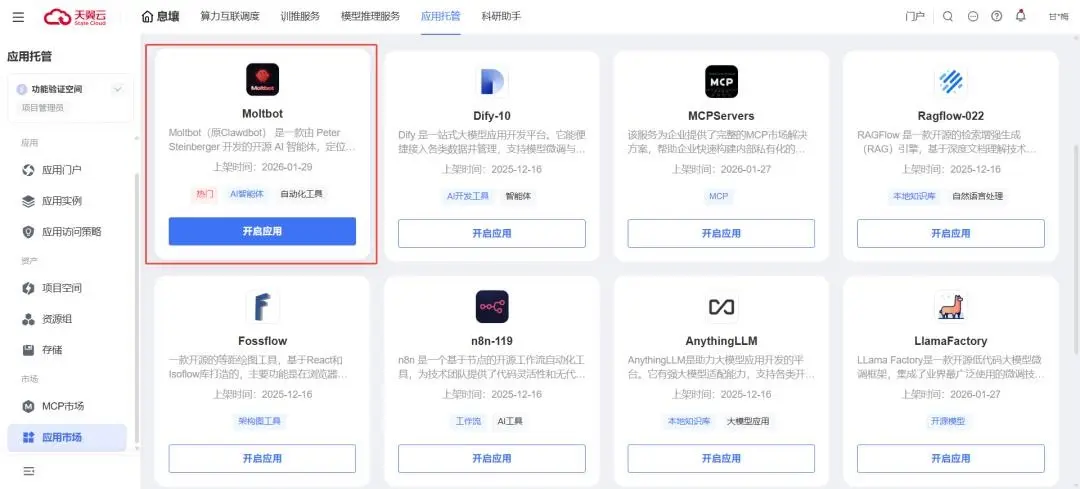

Este enfoque se refleja en las estrategias de los principales proveedores de nube y grandes empresas. Tan Cheng menciona que Tianyi Cloud ha lanzado recientemente un servicio de despliegue y ejecución en la nube con un clic para OpenClaw.

Al convertirlo en un servicio complementario, en realidad están productivizando, ingeniería y escalando esta capacidad. Esto potenciará su valor, con menor barrera de despliegue, mejor integración de herramientas y mayor estabilidad en recursos y operaciones. Pero también hay que tener en cuenta que, al integrar infraestructura comercial con “agentes de alto nivel de permisos”, los riesgos se escalan.

Tan Cheng afirma que en los últimos tres años, la velocidad de la evolución tecnológica, desde modelos de diálogo tradicionales hasta agentes que ejecutan tareas, ha sido sorprendente. “Hace tres años, esto era impensable.” Él cree que los próximos dos o tres años serán decisivos para el rumbo de la inteligencia artificial general, y que tanto profesionales como usuarios comunes tendrán nuevas oportunidades y esperanzas.

Aunque el desarrollo de OpenClaw y Modelbook ha sido más rápido de lo esperado, Hu Xia opina que, “en general, los riesgos aún están en un marco de investigación controlado, lo que demuestra la necesidad de construir un sistema de ‘seguridad inherente’. Pero también hay que ser conscientes de que, la IA se acerca a la ‘barrera de seguridad’ humana a una velocidad mayor de la que imaginamos. No solo hay que ampliar la altura y el grosor de esa barrera, sino también acelerar la capacidad de ‘levantar la mesa’ en momentos críticos, para fortalecer la línea final de defensa en la era de la IA.”