OpenAI afirma que hay 'líneas rojas' de seguridad en el acuerdo con el Pentágono, pero los usuarios no lo creen

En breve

- OpenAI firmó un acuerdo con el Pentágono para desplegar IA en entornos clasificados.

- La empresa afirmó que impuso “líneas rojas”, pero el contrato permite “todos los fines legales”, un estándar que en última instancia depende de la interpretación del propio gobierno.

- La controversia generó el movimiento QuitGPT y provocó un aumento en las descargas de Claude.

OpenAI anunció este fin de semana que alcanzó un acuerdo con el Pentágono para desplegar sistemas avanzados de IA en entornos clasificados, marcando una expansión significativa del trabajo de la compañía con las fuerzas armadas de EE. UU. El anuncio se produjo menos de 24 horas después de que la administración Trump incluyera a Anthropic en la lista negra, calificando a la firma rival de IA como un “riesgo en la cadena de suministro para la seguridad nacional” tras una disputa sobre el lenguaje del contrato relacionado con vigilancia y armas autónomas. El presidente Donald Trump también ordenó a las agencias federales que cesaran inmediatamente el uso de la tecnología de Anthropic, con el secretario del Tesoro Scott Bessent escribiendo el lunes en X que la agencia “está terminando todo uso de productos de Anthropic, incluido su plataforma Claude, dentro de nuestro departamento.”

"¡ESTADOS UNIDOS DE AMÉRICA NUNCA PERMITIRÁ QUE UNA EMPRESA RADICAL DE IZQUIERDA, WOKE, DICTE CÓMO NUESTRO GRAN MILITAR LUCHA Y GANA GUERRAS! Esa decisión corresponde a SU COMANDANTE EN JEFE, y a los líderes que designo para dirigir nuestro Ejército.

Los locos de izquierda en Anthropic… pic.twitter.com/aIEx92nnyx

— La Casa Blanca (@WhiteHouse) 27 de febrero de 2026

El momento de los anuncios de IA colocó el acuerdo de OpenAI bajo una intensa escrutinio. En una publicación detallada en su blog, la compañía describió lo que llamó “líneas rojas” firmes y salvaguardas que rigen su asociación con el Pentágono. El acuerdo, según OpenAI, plantea preguntas más amplias sobre cómo se gobernarán los sistemas de IA en entornos de seguridad nacional y cómo se interpretarán y aplicarán en la práctica las restricciones declaradas por la empresa. Cuando “legal” no es suficiente La publicación del blog de OpenAI comienza con tres compromisos presentados como innegociables: no usar su tecnología para vigilancia masiva interna, para dirigir de forma independiente sistemas de armas autónomas, ni para decisiones automatizadas de alto riesgo como la puntuación de crédito social. Luego viene el lenguaje real del contrato, que OpenAI llama “el lenguaje relevante”, no “el acuerdo completo”.

“El Departamento de Guerra puede usar el sistema de IA para todos los fines legales, en conformidad con la ley aplicable, requisitos operativos y protocolos de seguridad y supervisión bien establecidos,” dijo OpenAI. Esa es la frase exacta que Anthropic afirmó que el gobierno había estado exigiendo durante las negociaciones. La misma frase que Anthropic se negó a aceptar. OpenAI la firmó, pero argumenta que sus líneas rojas permanecen completamente intactas. Sin embargo, “legal” en contextos de seguridad nacional no es un límite fijo—vive dentro de un mosaico de leyes, órdenes ejecutivas, directivas internas y, a menudo, interpretaciones legales clasificadas. Cuando un contrato otorga “todos los fines legales,” el límite práctico se convierte en el marco legal actual del gobierno, no en un estándar independiente establecido por el proveedor. Un conjunto de cláusulas La disposición sobre armas indica que el sistema de IA “no será utilizado para dirigir de forma independiente armas autónomas en ningún caso donde la ley, regulación o política del departamento requiera control humano.” La prohibición solo aplica cuando alguna otra autoridad ya exige control humano—se basa completamente en la política existente, específicamente en la Directiva DoD 3000.09. Esa directiva requiere que los sistemas autónomos permitan a los comandantes ejercer “niveles apropiados de juicio humano sobre el uso de la fuerza.” Y “apropiado” es tan subjetivo como puede serlo. El juicio humano no es control humano. Esta distinción no fue accidental. Los expertos en defensa han señalado que omitir el lenguaje “humano en el ciclo” fue deliberado, precisamente para preservar la flexibilidad operativa.

El argumento más fuerte de OpenAI es su arquitectura de despliegue solo en la nube—los bucles de decisión letal totalmente autónomos requerirían despliegue en el borde en dispositivos de campo de batalla, lo cual este contrato no permite. Esa es una restricción técnica real. Pero la IA basada en la nube aún puede realizar identificación de objetivos, análisis de patrones de vida y planificación de misiones. Esas actividades en la cadena de eliminación, independientemente de dónde esté el disparador final. El resultado para un objetivo no difiere según el servidor en el que corra el modelo. La cláusula de vigilancia sigue un patrón similar. La línea roja declarada por OpenAI: no vigilancia masiva interna. El lenguaje del contrato: El sistema “no será utilizado para monitoreo sin restricciones de la información privada de las personas en EE. UU. en conformidad con estas autoridades”—luego enumera la Cuarta Enmienda, FISA y la Orden Ejecutiva 12333. La palabra “sin restricciones” implica que una versión restringida de vigilancia masiva sería permisible. Y la EO 12333 es la orden ejecutiva que la NSA ha utilizado para justificar interceptar las comunicaciones de estadounidenses cuando se realiza fuera de las fronteras de EE. UU. Y aquí es donde las preocupaciones de Anthropic sobre el lenguaje durante las negociaciones se vuelven evidentes. La argumentación de Anthropic era que la ley actual no ha alcanzado lo que la IA hace posible. El gobierno puede comprar legalmente grandes cantidades de datos comerciales agregados sobre estadounidenses sin una orden judicial—y ya lo ha hecho. El lenguaje del contrato de OpenAI, al anclar sus protecciones en marcos legales existentes, puede no cerrar la brecha que realmente le preocupaba a Anthropic. Responde Altman El sábado por la noche, Altman realizó un AMA respondiendo a miles de preguntas sobre el acuerdo. Cuando le preguntaron qué haría que OpenAI se retirara de una asociación con el gobierno, respondió: “Si nos pidieran hacer algo inconstitucional o ilegal, nos retiraremos.”

Si nos pidieran hacer algo inconstitucional o ilegal, nos retiraremos. Ven a visitarme a la cárcel si es necesario.

— Sam Altman (@sama) 1 de marzo de 2026

Ese marco sitúa el límite de OpenAI en la legalidad—no en un juicio ético independiente sobre lo que la empresa permitirá o no si resulta ser legal, que es lo que defiende Anthropic. Preguntado si le preocupaba futuras disputas sobre qué se considera “legal,” reconoció el riesgo: “Si tenemos que enfrentar esa pelea, la enfrentaremos, pero claramente nos expone a cierto riesgo.” Sobre por qué OpenAI alcanzó un acuerdo en el que Anthropic no, Altman explicó: “Anthropic parecía más centrada en prohibiciones específicas en el contrato, en lugar de citar leyes aplicables, con lo cual nos sentimos cómodos. Claramente preferiría confiar en salvaguardas técnicas si solo tuviera que escoger una. Creo que Anthropic quería más control operativo del que nosotros queríamos.” Esa es una diferencia filosófica sustantiva. Anthropic argumentaba que, dado que los modelos de frontera pueden ser reutilizados para inteligencia y flujos de trabajo militares de formas difíciles de anticipar, los límites deben ser explícitos y vinculantes por escrito, incluso a costa del acuerdo. La postura de OpenAI es que la arquitectura técnica, el personal incorporado y la ley existente en conjunto constituyen una salvaguarda más sólida que solo el texto contractual. El público tomó partido

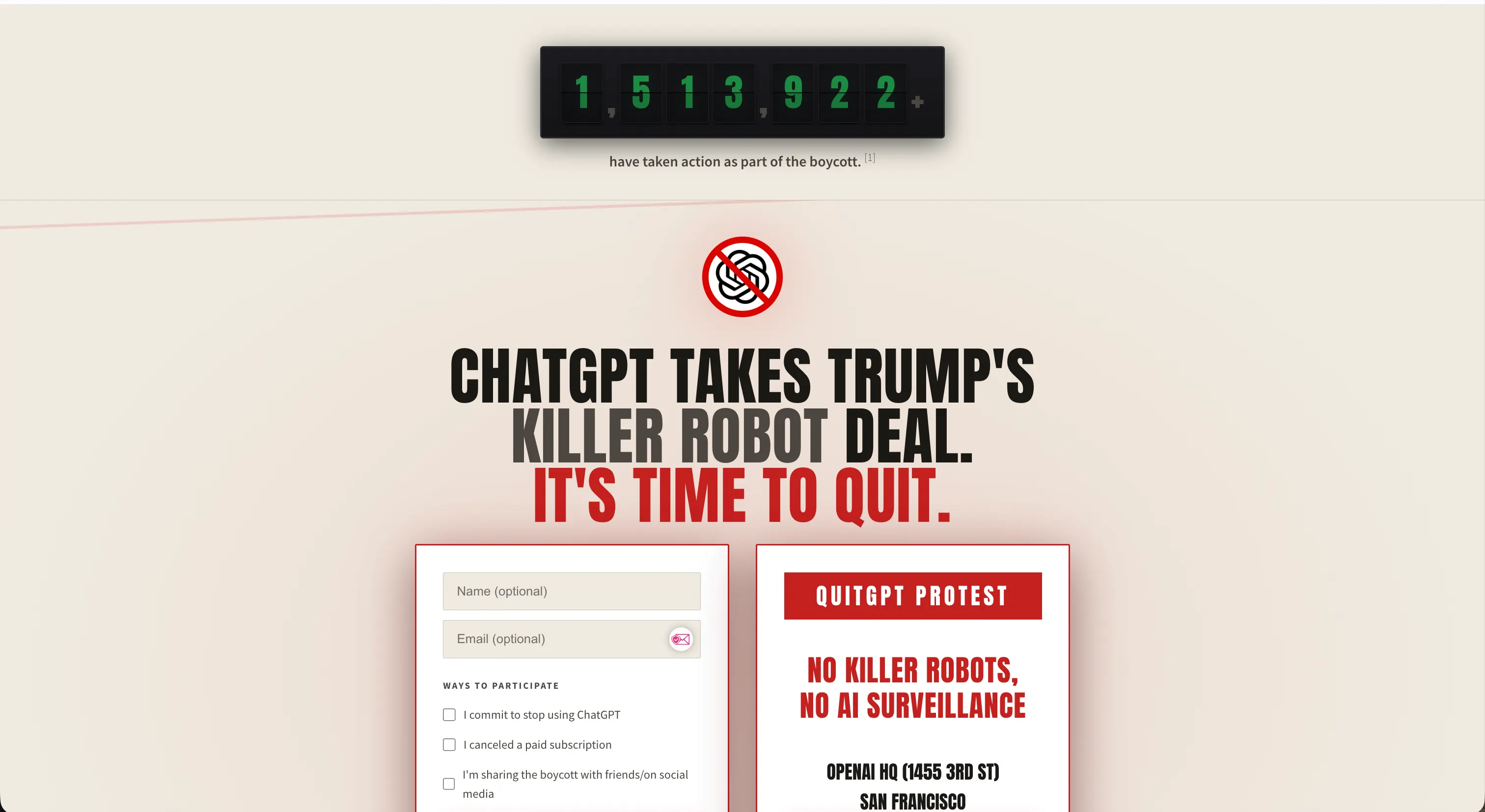

La reacción fue inmediata. Para el lunes, el movimiento “QuitGPT” afirmó que más de 1.5 millones de personas habían tomado medidas—cancelando sus suscripciones, compartiendo publicaciones de boicot o inscribiéndose en quitgpt.org.

La campaña presentó la acción de OpenAI como priorizar contratos militares sobre la seguridad de los usuarios, acusando a la empresa de aceptar que el Pentágono use su tecnología para “todos los fines legales, incluyendo robots asesinos y vigilancia masiva.”

OpenAI podría disputar esa caracterización. Pero el mercado se movió de igual manera.

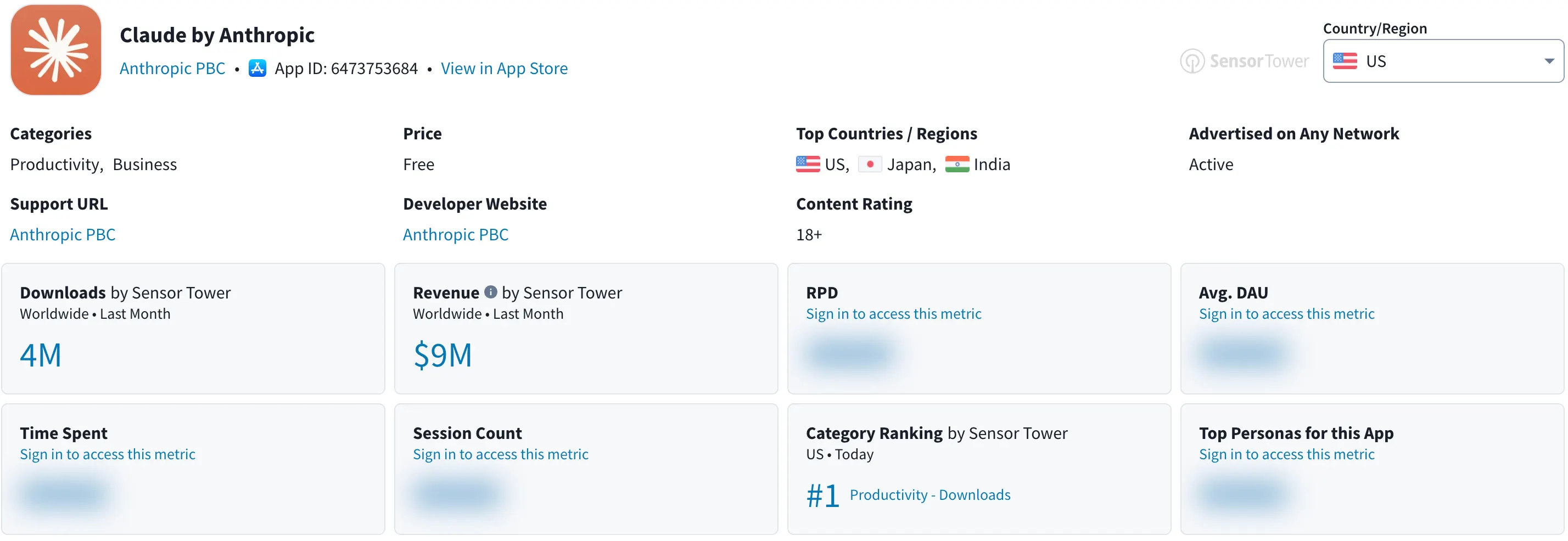

Claude de Anthropic superó a ChatGPT para convertirse en la aplicación gratuita más descargada en Estados Unidos en la App Store de Apple, y la compañía informó a Decrypt que vio registros récord de inscripciones diarias durante el fin de semana.

La estrella pop Katy Perry compartió una captura de pantalla de la página de precios de Claude en X. Cientos de usuarios documentaron públicamente sus cancelaciones de suscripción en Reddit. Graffiti en apoyo a Anthropic apareció frente a sus oficinas en San Francisco, mientras que ataques con tiza cubrieron las aceras de OpenAI. Incluso cientos de empleados de OpenAI habían firmado previamente una carta abierta apoyando la negativa de Anthropic a ceder a las demandas del Pentágono.

El marco de QuitGPT es emocionalmente convincente, pero no del todo preciso. Anthropic tiene una asociación con Palantir y Amazon Web Services que otorga acceso a los modelos Claude a agencias de inteligencia y departamentos de defensa de EE. UU., y se ha alegado que ha sido utilizada en operaciones militares para derrocar gobiernos en Venezuela e Irán. La ética de la IA y la contratación en seguridad nacional nunca fue clara en ninguno de los lados. Lo que la campaña capturó, con precisión, es que un segmento importante de usuarios creía que había una diferencia significativa en cómo ambas empresas establecían sus límites—y votaron con sus suscripciones. Si esa diferencia es tan significativa como parece, requiere leer cuidadosamente el contrato.