Las gafas inteligentes Meta son expuestas: imágenes privadas de usuarios tomando una ducha, relaciones sexuales, números de tarjetas de crédito... enviadas a Kenia para entrenar IA

Una investigación de los medios suecos reveló que imágenes íntimas de usuarios de gafas inteligentes Meta Ray-Ban, desde pantallas de inodoros hasta fotos desnudas, fueron enviadas a las pantallas de censores subcontratados en Kenia, mientras que los dependientes dijeron a los consumidores que “los datos siguen siendo locales.”

(Resumen: Zuckerberg predijo que los teléfonos móviles serían eliminados!) Las gafas inteligentes de IA + proyección holográfica son el futuro de la humanidad)

(Suplemento de contexto: El exejecutivo de Meta dio la noticia de que Zuckerberg había eliminado el crimen del comunismo: creando en secreto una herramienta de “censura de discursos en Facebook Taiwán y Hong Kong” y traicionando la privacidad de los usuarios de Facebook)

Índice de contenido de este artículo

Toggle

- Máscaras defectuosas, empleados de afasia

- Una triple identidad con un par de gafas

- Resistencia popular en señales Bluetooth

- Colapso estructural de los mecanismos de consentimiento

Según un informe de investigación publicado conjuntamente por el “Daily News” de Suecia y el “Gothenburg Post”: ¡Los usuarios de gafas inteligentes de Meta están enviando toda tu vida privada a Kenia!

La investigación reveló que cuando un usuario activa las funciones de IA de las gafas inteligentes Meta Ray-Ban (ya sea pidiéndole que reconozca un objeto delante de él, traduzca un menú o responda a una pregunta), los datos de imagen y voz capturados por la cámara se envían a los servidores de Meta en Luleå, Suecia, y Dinamarca.

Estos datos se distribuyen luego a miles de trabajadores contratados por Sama, el subcontratador de Meta, en Nairobi, Kenia, para revisarlos, anotarlos y clasificarlos uno a uno y entrenar modelos de IA.

Un examinador keniano dirigió a periodistas de investigación:

“Podemos ver de todo, desde el salón hasta el desnudo. Son personas reales como nosotros.”

Vieron imágenes de usuarios en el baño, grabaciones de actos sexuales, números de tarjetas de crédito capturados accidentalmente en cámara, conversaciones privadas y imágenes de usuarios viendo contenido para adultos.

Máscara defectuosa, empleado de afasia

El diseño del sistema de Meta debería incluir teóricamente un mecanismo de seguridad: un algoritmo automático de enmascaramiento que oculte rostros e información sensible en las imágenes. Sin embargo, investigaciones de los medios suecos descubrieron que este sistema a menudo falla. Los censores pueden ver claramente escenas cotidianas en los hogares de personas corrientes que no tienen ni idea de que sus gafas están grabando, y mucho menos de que lo que graban aparecerá en la pantalla de alguien al otro lado del mundo.

Lo que resulta aún más irónico es la brecha de información en el lado del consumidor. El reportero visitó un total de diez cadenas de cadenas de gafas en Estocolmo y Gotemburgo, principalmente Synsam y Synoptik. Cuando se les preguntó sobre la privacidad, los vendedores de muchas tiendas dijeron que los usuarios tienen control total y que todos los datos permanecen en la aplicación móvil y no se transmitirán a otros lugares.

Esto parece ser exactamente lo contrario de la verdad.

Con las funciones de IA de las gafas inteligentes Ray-Ban Meta, los datos deben procesarse a través de la infraestructura de Meta, y no existe una opción para computación puramente local. Los registros de voz se almacenan en la nube por defecto durante hasta un año para “mejorar el sistema de IA”, y no hay mecanismo de salida salvo la eliminación manual uno a uno. Muchos empleados de la tienda admitieron que no sabían qué datos transmitían realmente las gafas.

Petter Flink, experto en seguridad informática de la Agencia Sueca de Protección de Datos (IMY), advierte que esta tecnología es una táctica de marketing que oculta riesgos reales para la privacidad. Los consumidores no tienen conocimiento del proceso de procesamiento en el back-end. La respuesta de Meta es una línea estándar de defensa corporativa: la empresa cumple con los acuerdos de usuario y las normativas GDPR, y la ubicación de los revisores “no afecta al cumplimiento, siempre que se cumplan las normas.”

La triple identidad de unas gafas

La investigación sueca revela la primera capa de preocupación sobre la privacidad de las gafas inteligentes de Meta: lo que tú crees que es privado en realidad está siendo revisado por desconocidos. Pero eso es solo la punta del iceberg.

La segunda capa ya ha surgido al otro lado del Atlántico. Se encontró a agentes del Servicio de Inmigración y Control de Aduanas de EE. UU. (ICE) usando gafas inteligentes Meta Ray-Ban durante operaciones policiales, tomando en secreto fotos de presuntos inmigrantes indocumentados en lugares públicos y comprobándolas con bases de datos y redes sociales. “The Verge” citó a personas familiarizadas con el asunto señalando que no se trata de un caso aislado, sino de un modelo operativo en constante proliferación.

Un par de dispositivos portátiles de consumo se convierte directamente en una herramienta de vigilancia estatal sin orden judicial ni orden de registro.

La tercera capa es la amenaza estructural más grande. A mediados de febrero, el New York Times obtuvo documentos internos de Meta que revelaban que Reality Labs estaba desarrollando una función de reconocimiento facial en tiempo real con el nombre en clave “Name Tag”: cuando el usuario mira a alguien, la IA puede comparar los datos de Meta plataforma y mostrar el nombre, perfil y amigos en común de la persona en segundos. El documento interno contiene una descripción escalofriante de la estrategia: “Iremos a vivir en un entorno político dinámico donde muchos grupos de la sociedad civil centrarán sus recursos en otros temas.”

En otras palabras: Meta sabe que esta función provocará una reacción negativa, así que elige atacar cuando el oponente no tiene tiempo para encargarse de ella.

Tres capas apiladas, un par de gafas de sol de 299 dólares cumplen tres funciones a la vez: un recopilador silencioso de datos de entrenamiento de IA, una herramienta de sigilo para las fuerzas del orden estatales y un arma social para la identificación en tiempo real. Y ni una sola persona alrededor del usuario (fotografiada, identificada, censurada) ha pulsado jamás el botón de “aceptar”.

Resistencia popular en señales Bluetooth

La respuesta a nivel institucional ha sido frustrantemente lenta. El Centro de Información de Privacidad Electrónica de EE. UU. (EPIC) ha enviado una carta a la Comisión Federal de Comercio (FTC) solicitando una investigación, pero en el clima político actual, la aplicación de la ley por parte del regulador es en sí misma una incógnita. Europa tiene el RGPD, pero la respuesta estándar de Meta es “cumplimos”, y la brecha entre los flujos reales de datos y los compromisos de cumplimiento fue revelada por periodistas suecos mediante visitas in situ a diez tiendas.

El primero en responder de forma sustancial fue un sociólogo suizo. El desarrollador independiente Yves Jeanrenaud lanzó “Nearby Glasses” a finales de febrero, una aplicación para Android que alerta cuando se detectan gafas inteligentes Meta o Snap dentro de un rango de 10 a 15 metros escaneando el identificador del fabricante en la señal de emisión Bluetooth Low Energy (BLE).

Jeanrenaud dijo que su motor surgió de “presenciar la magnitud y la naturaleza antihumana de los abusos implicados en estas gafas inteligentes.” Algunas personas fotografían a escondidas a clientes en salones de estética, otras graban vídeos en tribunales y clínicas, y otras encienden cámaras en baños públicos… Cada uno tiene casos reales, no hipótesis.

Colapso estructural de los mecanismos de consentimiento

Volviendo a la cuestión fundamental: las gafas inteligentes Meta son una crisis de privacidad y no solo una controversia sobre el producto, porque desmontan la premisa básica sobre la que operan los marcos modernos de privacidad: el modelo de “consentimiento informado”.

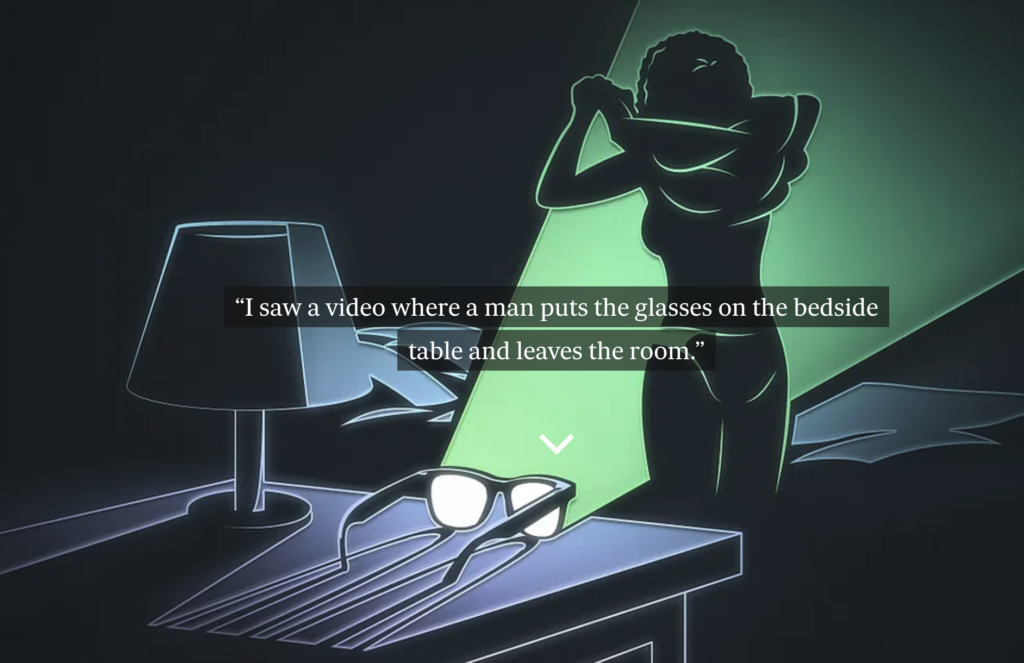

La lógica tradicional es que las empresas deben informarte y obtener el consentimiento antes de recopilar tus datos. Pero la forma en que funciona el Meta Ray-Ban hace que esta lógica colapse en tres direcciones a la vez. Para quien lo lleva, el dependiente te dice que la información se deja local, pero en realidad se está volando a Dinamarca y Kenia.

Para la persona que se está fotografiando, no eres usuario de Meta, no has pulsado ningún botón de consentimiento ni siquiera sabes que estás siendo grabado.

Para esos censores en Nairobi, se ven obligados a presenciar los momentos más íntimos de desconocidos, y el coste psicológico del trabajo nunca se muestra en los informes ESG de Meta.

La solidez de la protección de la privacidad nunca depende de lo que diga el texto de las regulaciones, sino de si la empresa cree que vas a seguir adelante. Y Meta aparentemente lo ha calculado: no vas a…