¡La colaboración de OpenAI con las fuerzas armadas de EE. UU. genera una ola de resistencia! La descarga de Claude App supera a la competencia, entendiendo la lucha ética y política detrás

La colaboración de OpenAI con las fuerzas armadas de EE. UU. ha provocado un boicot. La oposición a la vigilancia militar por parte de Anthropic ha recibido un amplio apoyo popular, impulsando a Claude a encabezar las descargas en Estados Unidos, lo que refleja la alta preocupación de la población por la privacidad y la ética en la inteligencia artificial.

Contrato entre OpenAI y el Departamento de Defensa de EE. UU. genera crisis de relaciones públicas

Desde el 28 de febrero, cuando OpenAI anunció su colaboración confidencial con el Departamento de Defensa de EE. UU. para desplegar redes seguras, y tras que su competidor Anthropic fuera etiquetado por el gobierno estadounidense como “riesgo en la cadena de suministro”, la sociedad estadounidense ha debatido intensamente sobre la línea entre las empresas tecnológicas y las fuerzas armadas. Recientemente, la aplicación Claude alcanzó el primera lugar en las descargas en EE. UU.

Frente a las críticas, el CEO de OpenAI, Sam Altman, emitió un comunicado en el que destacó que el contrato prohíbe expresamente el uso de sistemas de IA para vigilancia masiva de ciudadanos estadounidenses y afirmó que la compañía mantendrá el control sobre los mecanismos de seguridad. Altman también admitió que la decisión de anunciar esto fue apresurada, lo que generó percepciones negativas de oportunismo y precipitación.

Resistencia en foros estadounidenses y cuestionamientos a los criterios de decisión de OpenAI

Muchos usuarios en línea expresaron su decepción con la situación actual de OpenAI. En discusiones en Reddit, algunos opinan que la compañía ha abandonado su visión original centrada en el ser humano y en el desarrollo seguro.

Debajo del post de Altman, varios usuarios criticaron la falta de transparencia en las decisiones de OpenAI y cuestionaron por qué, bajo las mismas condiciones de seguridad aceptadas por el Departamento de Defensa, Anthropic, que presentó condiciones idénticas, es considerado una amenaza para la seguridad nacional.

Otros señalaron que las definiciones en la declaración sobre la obtención comercial de información y la vigilancia no intencional son vagas, lo que podría dejar lagunas legales para monitoreo de no ciudadanos o futuras aplicaciones militares.

Revelaciones de CNBC: OpenAI afirma no tener control sobre las decisiones operativas

Un informe de CNBC revela detalles de reuniones internas de OpenAI, en las que Altman afirmó el 3 de marzo que la compañía no tiene control sobre cómo el Departamento de Defensa de EE. UU. utilizará la tecnología de IA.

CNBC revisó parte de las actas de esas reuniones, en las que Altman explicó a los empleados que, independientemente de si consideran correcto atacar Irán o incorrecto invadir Venezuela, no tienen autoridad para opinar al respecto.

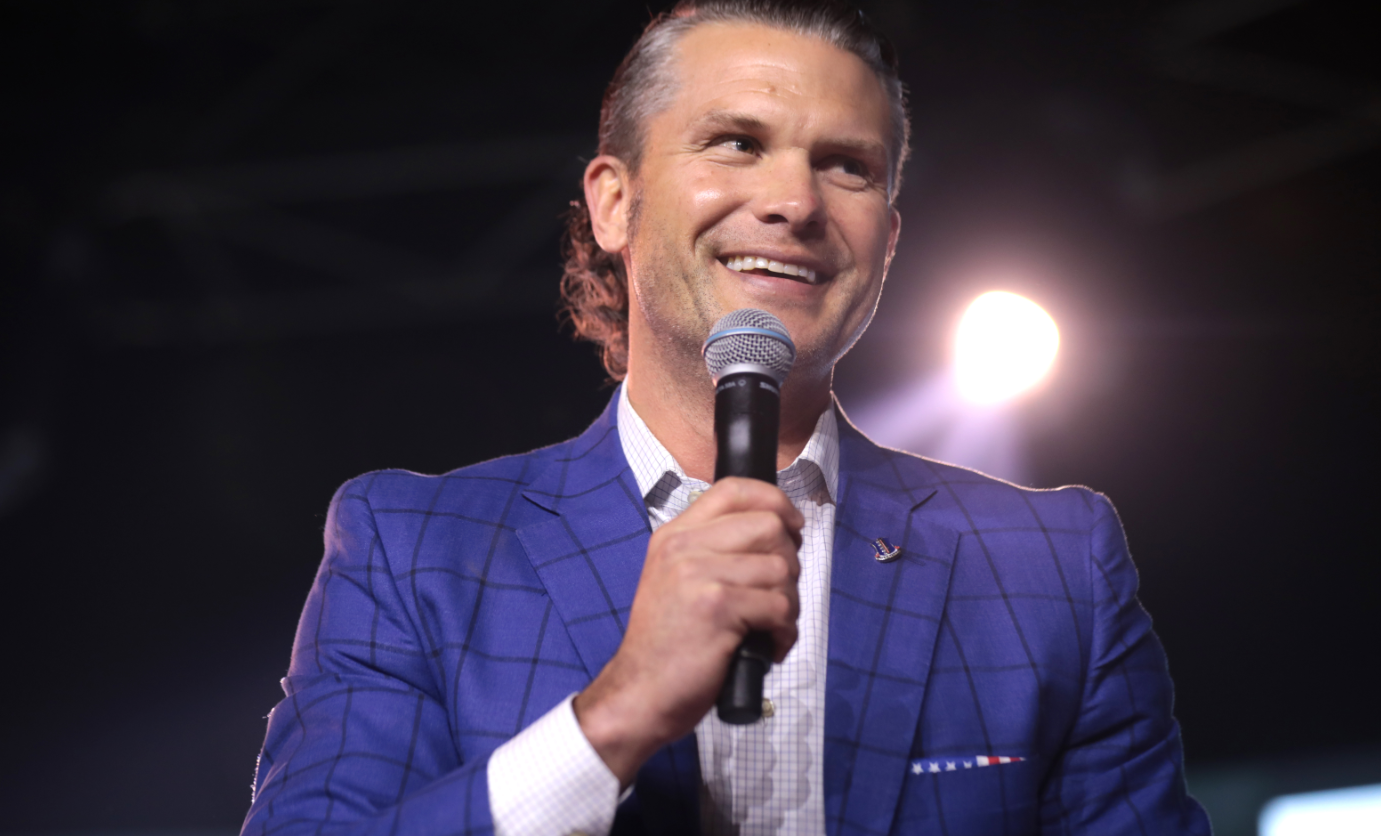

Fuentes cercanas revelaron que Altman enfatizó en la reunión que el Pentágono respeta la experiencia técnica de OpenAI y permite que la empresa establezca mecanismos de seguridad adecuados, pero que la decisión final sobre operaciones recae en el Secretario de Defensa, Pete Hegseth.

Fuente: commons.wikimedia, Gage Skidmore, Secretario de Defensa de EE. UU. Pete Hegseth

El tira y afloja entre ética tecnológica y seguridad nacional

El incidente entre las fuerzas armadas de EE. UU. y Anthropic ha intensificado la tensión entre la seguridad nacional, la ética tecnológica y la libertad de privacidad.

Más de 200 empleados de Google y OpenAI firmaron una carta pública apoyando la decisión de Anthropic de mantener sus barreras de seguridad. Anthropic reafirmó que ninguna amenaza o sanción cambiará su línea de no permitir vigilancia masiva ni armas totalmente automatizadas.

El exfuncionario del FBI y reconocido denunciante Edward Snowden advirtió que el sistema XKeyscore de la NSA puede rastrear en su totalidad las actividades en línea y la ubicación física de las personas, lo que ha generado preocupaciones sobre la expansión del monitoreo con la intervención de la IA.

Además, un estudio reciente del King’s College London muestra que, en simulaciones de crisis geopolíticas, hay un 95% de probabilidad de que los modelos de IA principales, como OpenAI y Anthropic, opten por desplegar armas nucleares.

Si el gobierno usa arbitrariamente la etiqueta de “riesgo en la cadena de suministro” para forzar a las empresas tecnológicas a ceder, establecerá un peligroso precedente que podría obstaculizar la innovación y la ética en la industria de la IA en EE. UU.

- Para más detalles, ver: La seguridad nacional vs. ética: Anthropic se niega a eliminar las barreras de seguridad de Claude y enfrenta al Departamento de Defensa de EE. UU.

¿Significa algo que la app Claude haya alcanzado el primer lugar en descargas?

La lucha por la ética en IA y el poder político continúa. Anthropic planea acudir a los tribunales para defender sus derechos comerciales y límites legales frente a las sanciones gubernamentales. Mientras tanto, OpenAI enfrenta una grave crisis de relaciones públicas y una pérdida de confianza por haber asumido rápidamente contratos militares.

La opinión pública en EE. UU. también ha influido en las tendencias de descarga de sus productos.

Según datos de Similarweb, hasta el 1 de marzo, en la tienda de aplicaciones de EE. UU., Claude App subió 3 puestos en la lista de aplicaciones gratuitas más populares para iPhone, alcanzando el primer lugar en descargas, mientras que ChatGPT bajó un puesto y quedó en segundo lugar.

Esto refleja claramente que, tras la controversia de seguridad nacional, la población estadounidense valora cada vez más la protección de su privacidad y muestra una voluntad colectiva de resistirse a un control excesivo por parte del gobierno.

Lecturas recomendadas:

V神 advierte nuevamente sobre Worldcoin: el World ID creado por Altman, que tiene datos de 13 millones de usuarios, podría amenazar la libertad en internet

El fundador de Telegram revela que no usa teléfono: “Estamos agotando nuestro tiempo mientras vemos cómo destruyen la internet libre”