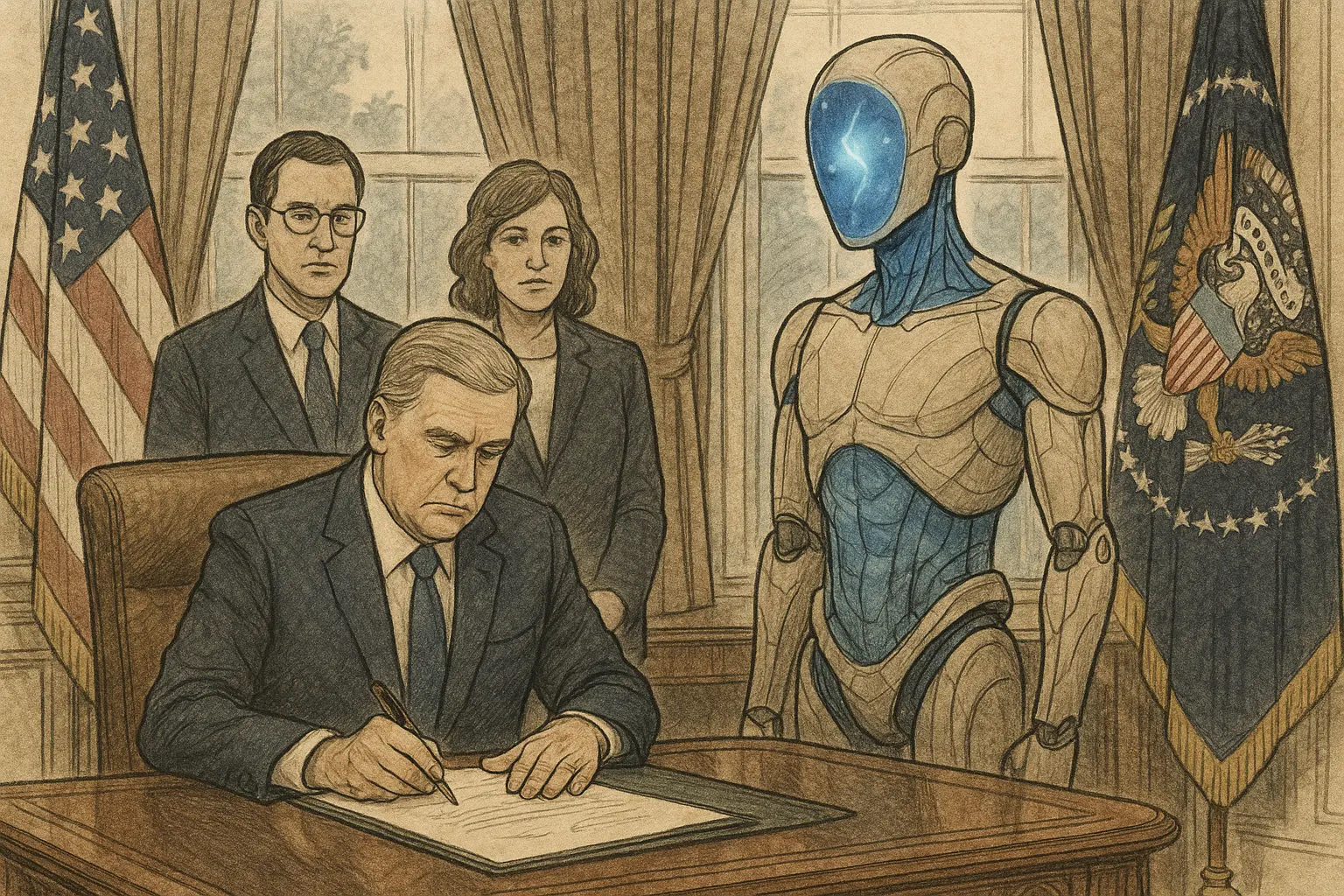

Medio estadounidense: el borrador de una orden ejecutiva de la Casa Blanca permite que el modelo Anthropic Mythos entre en el gobierno

Según un informe del 28 de abril citado por Axios a partir de fuentes conocedoras, la Casa Blanca está elaborando directrices que permitirían a las agencias federales eludir la determinación de riesgo de la cadena de suministro (SCRD) de Anthropic e introducir nuevos modelos para uso del gobierno, incluido el modelo Mythos de Anthropic. Al respecto, la Casa Blanca emitió una declaración oficial que afirma que cualquier anuncio de políticas será publicado directamente por el presidente; cualquier otra afirmación es pura especulación.

Contactos recientes de la Casa Blanca y medidas propuestas

Según el informe de Axios del 28 de abril, a principios de este mes, el jefe de gabinete de la Casa Blanca, Susie Wiles, y el secretario del Tesoro, Scott Bessent, se reunieron conjuntamente con el CEO de Anthropic, Dario Amodei, y ambas partes describieron ese encuentro como una reunión introductoria productiva, en la que se analizaron las direcciones de la cooperación entre la empresa y el gobierno.

Esta semana, la Casa Blanca convocó a empresas de distintos sectores para proporcionar información sobre posibles medidas administrativas y mejores prácticas para desplegar el sistema Mythos. De acuerdo con el informe de Axios, las reuniones pertinentes incluyeron “table reads” de la guía propuesta, y la guía podría contradecir las instrucciones emitidas previamente por la Oficina de Administración y Presupuesto (OMB) de que los departamentos del gobierno no deben utilizar el sistema de Anthropic. Anthropic se negó a comentar sobre el informe correspondiente de Axios.

Antecedentes del conflicto: determinación de riesgo de la cadena de suministro y demanda legal del Pentágono

Según el informe de Axios del 28 de abril, el Pentágono (DoD) ya había emitido previamente una determinación de riesgo de la cadena de suministro sobre Anthropic y presentó una demanda en los tribunales. El núcleo de la disputa radica en que Anthropic se negó a firmar un acuerdo que permitiría al Pentágono usar el modelo Claude bajo el estándar de “todo uso legal” (incluye aplicaciones de drones). Las cláusulas de prohibición explícitas de Anthropic incluyen la vigilancia interna a gran escala y el desarrollo de armas totalmente autónomas. El Pentágono afirmó que la negativa de Anthropic demuestra que no es un socio confiable.

Según el informe de Axios, aunque el litigio legal continúa, las agencias gubernamentales, incluido el Pentágono, todavía pueden usar algunos modelos de Anthropic, y la Agencia de Seguridad Nacional de EE. UU. (NSA) también utiliza Mythos. Sin embargo, el Pentágono aún sigue los antiguos términos de servicio que ambas partes consideran demasiado estrictos, y no puede obtener la versión más reciente de las actualizaciones de los modelos de Anthropic.

Postura central de Anthropic y comparación con la industria

Según el informe de Axios del 28 de abril, Anthropic insiste en negarse a firmar el acuerdo de “todo uso legal” y prohíbe explícitamente que los usos incluyan la vigilancia interna a gran escala y el desarrollo de armas totalmente autónomas.

El informe de Axios también señala que OpenAI y Google ya han firmado acuerdos con el Pentágono que permiten usar sus modelos bajo el estándar de “todo uso legal” en entornos confidenciales; ambas compañías afirman que los acuerdos respetan las dos prohibiciones delimitadas por Anthropic.

Preguntas frecuentes

¿Qué contenido específico tienen las directrices relacionadas con Anthropic que planea elaborar la Casa Blanca?

Según el informe del 28 de abril de Axios que cita a fuentes conocedoras, la Casa Blanca está elaborando directrices que permitirían a las agencias federales eludir la determinación de riesgo de la cadena de suministro de Anthropic. Las medidas podrían publicarse en forma de orden ejecutiva e incluir directrices para el despliegue del modelo Mythos. La declaración oficial de la Casa Blanca afirma que cualquier anuncio de políticas será publicado directamente por el presidente.

¿Cuál es la razón fundamental de la disputa entre el Pentágono y Anthropic?

Según el informe de Axios del 28 de abril, la disputa se originó porque Anthropic se negó a firmar un acuerdo que permitiría al Pentágono usar el modelo Claude bajo el estándar de “todo uso legal”. Los usos prohibidos explícitamente incluyen la vigilancia interna a gran escala y el desarrollo de armas totalmente autónomas; luego, el Pentágono emitió una determinación de riesgo de la cadena de suministro y presentó una demanda legal.

¿Cuál es la postura de OpenAI y Google sobre el mismo tema?

Según el informe de Axios del 28 de abril, tanto OpenAI como Google ya han firmado acuerdos con el Pentágono que permiten usar sus modelos bajo el estándar de “todo uso legal” en entornos confidenciales; y ambas compañías afirman que los acuerdos respetan las dos prohibiciones delimitadas por Anthropic.

Artículos relacionados

Modelos de OpenAI para migrar gradualmente al chip Trainium personalizado de Amazon, dice Altman que está “mirando con ilusión” hacia ello

Modelo Ling-2.6-flash de Ant Group publicado como código abierto: 104B de parámetros con 7.4B activos, logra múltiples puntos de referencia SOTA

Sam Altman publica capturas de pantalla del modo doble de Codex; las funciones de oficina y de programación se separan oficialmente

Codex de OpenAI lanza una interfaz de doble modo: Excelmogging para el trabajo de oficina y Codemaxxing para la programación

Taylor Swift solicita marcas registradas de voz e imagen para prevenir la difusión de contenido falsificado por IA