Tesla FSD m'a sauvé la vie de mon père lors de sa crise cardiaque, la conduite autonome l'a conduit à l'hôpital pour une urgence.

Une Tesla Model Y, après avoir perdu connaissance suite à une crise cardiaque en conduite, a été reprogrammée à distance par son fils pour définir une destination. FSD a automatiquement navigué jusqu’à l’urgence, le médecin confirmant qu’un retard aurait pu être fatal.

(Précédent : Elon Musk annonce l’arrêt de la production des Model X/S pour fabriquer des robots ; Q4 affiche une perte latente de 2,39 milliards de dollars sur le Bitcoin)

(Contexte supplémentaire : Tesla + xAI + SpaceX : Comprendre la vision ultime d’Elon Musk pour l’IA)

Aller

En novembre dernier, dans la nuit, Jack Brandt a raconté sur la plateforme X cette nuit éprouvante. Son père conduisait une nouvelle Tesla Model Y sur la voie ouest de l’autoroute I-20 en Géorgie, en route d’Atlanta vers Birmingham pour s’occuper de sa mère âgée, lorsqu’il a soudainement fait une crise cardiaque, avec une douleur thoracique intense qui l’a presque fait perdre connaissance…

Vers 3h50 du matin, mon téléphone a sonné. C’était mon père. Il avait une douleur thoracique aiguë, il était presque inconscient, incapable de conduire en toute sécurité. Mais la fonction FSD (pilotage automatique complet) était activée, le véhicule continuait à avancer. J’ai immédiatement contacté mon grand-père, nous n’avions que quelques secondes pour décider.

https://t.co/0eN8pCqfKU

— Jack Brandt (@JJackBrandt) 6 février 2026

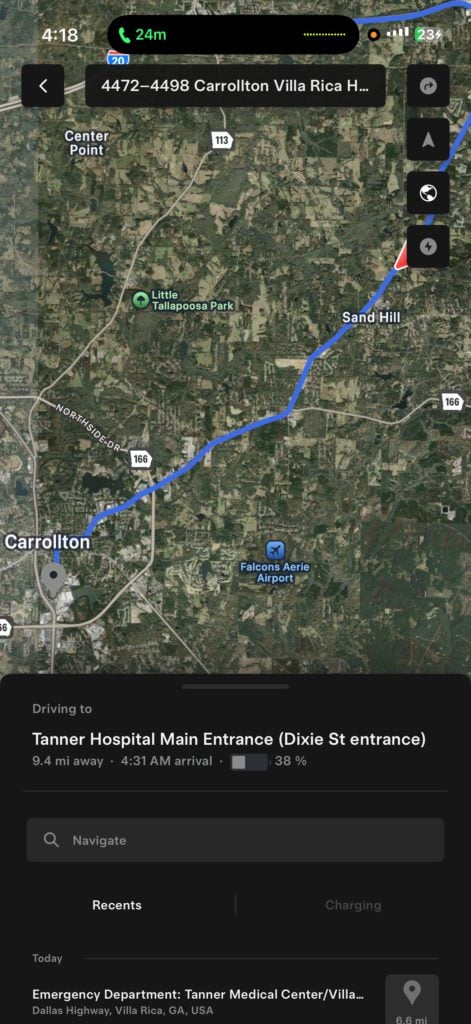

Grand-père a contacté son oncle à Douglasville, en Géorgie, qui lui a indiqué qu’il y avait un Tanner Medical Center à proximité. Jack a rapidement trouvé cet hôpital sur Google Maps, situé à Carrollton, et a poussé la destination via l’application Tesla sur le véhicule de son père.

En tant que conducteur autorisé sur son compte, je peux à distance modifier la navigation FSD de sa Juniper.

« Ce qui s’est passé ensuite me donne encore la chair de poule », écrit Jack. La Model Y a quitté l’autoroute à la prochaine sortie, a fait un demi-tour pour revenir sur la voie est, puis a repris la route vers Carrollton, en suivant un itinéraire qu’elle n’avait jamais emprunté, jusqu’à l’entrée de l’urgence.

Ils avaient déjà appelé l’hôpital pour prévenir, l’équipe d’urgence était prête à l’accueillir.

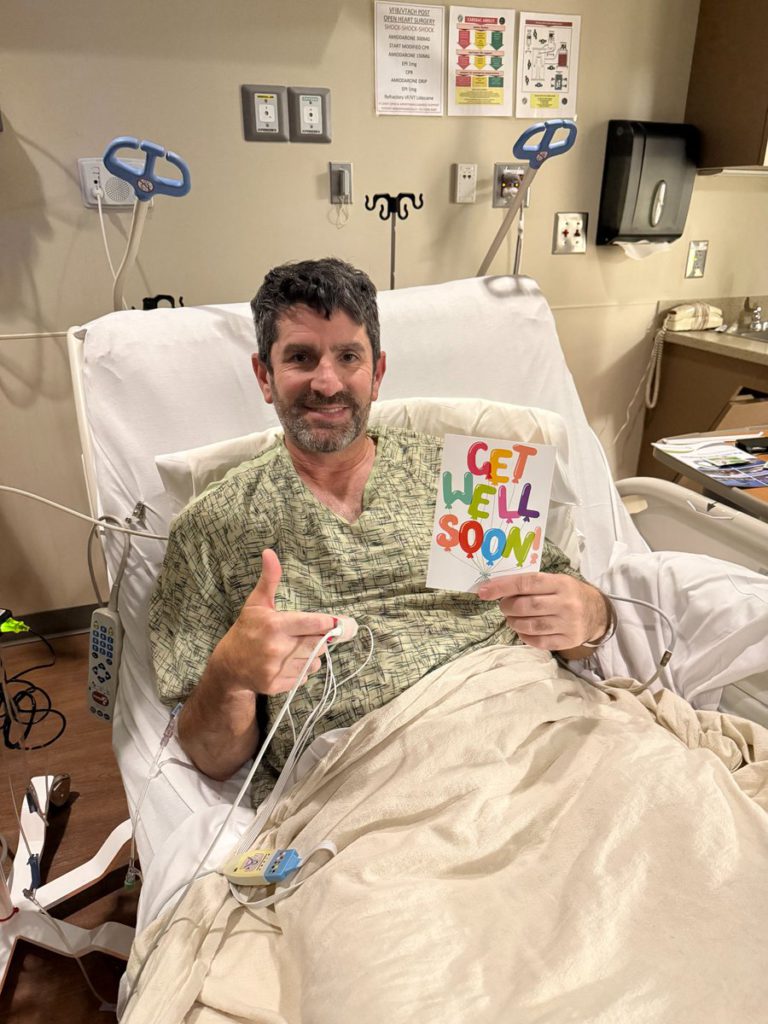

Trois artères bloquées, et ils sont allés à la bonne clinique

Le médecin traitant a rapidement diagnostiqué : trois artères coronaires gravement obstruées, nécessitant une intervention immédiate. L’équipe médicale a dit à la famille Brandt : « S’il s’était arrêté sur le côté pour attendre une ambulance, ou s’il avait essayé de continuer jusqu’à Birmingham, il ne serait pas vivant. »

Ce n’est pas une histoire soigneusement emballée par le marketing. C’est un événement statistiquement peu probable, qui s’est produit à la croisée des capacités technologiques et de la vulnérabilité humaine. Jack a écrit dans son article :

Je remercie Tesla, Tesla AI, Elon Musk pour avoir créé une technologie capable de sauver des vies. Ce n’est pas une hypothèse, c’est mon père, qui est encore en vie et en train de se remettre, grâce à votre équipe. Au petit matin, sur une autoroute sombre en Géorgie, lors d’un infarctus STEMI, le système l’a envoyé à l’hôpital à temps.

Je tiens aussi à remercier tout le personnel médical du Tanner Medical Center de Carrollton, en Géorgie — je pense sincèrement qu’il n’y a pas de meilleur hôpital au monde. Votre équipe a été exceptionnelle. Merci du fond du cœur.

Cette technologie doit être accessible à plus de personnes.

FSD n’est pas qu’une fonction pratique — c’est une corde de sauvetage.

Une histoire de sauvetage ne prouve pas la sécurité, mais montre une possibilité réelle

Bien sûr, un seul cas réussi ne peut pas constituer une preuve statistique. C’est une limite essentielle dans toute discussion sérieuse sur la sécurité de la conduite autonome.

Même si le rapport de sécurité officiel de Tesla indique que les véhicules équipés de FSD ont en moyenne un accident tous les plusieurs millions de miles, bien en dessous de la moyenne humaine, les critiques soulignent que la base de comparaison est problématique : FSD est principalement utilisé sur des autoroutes et des routes suburbaines à faible risque, tandis que les statistiques d’accidents humains couvrent tous les types de routes.

Aucun des deux n’a tort. Et c’est là que réside la difficulté.

La véritable signification de l’événement Brandt ne réside pas dans la preuve que FSD est « suffisamment sûr », mais dans la démonstration d’une possibilité : lorsque les systèmes d’aide à la conduite par IA et l’interface de contrôle à distance sont combinés, ils peuvent offrir une voie de survie dans des situations extrêmes où la conduite humaine échoue totalement. Mais pour transformer cette « possibilité » en « fiabilité », il ne suffit pas d’améliorer les algorithmes, il faut aussi un cadre réglementaire qui évolue au même rythme que la technologie.