Anthropic et le Pentagone s'affrontent sur les usages militaires et de surveillance de masse de Claude

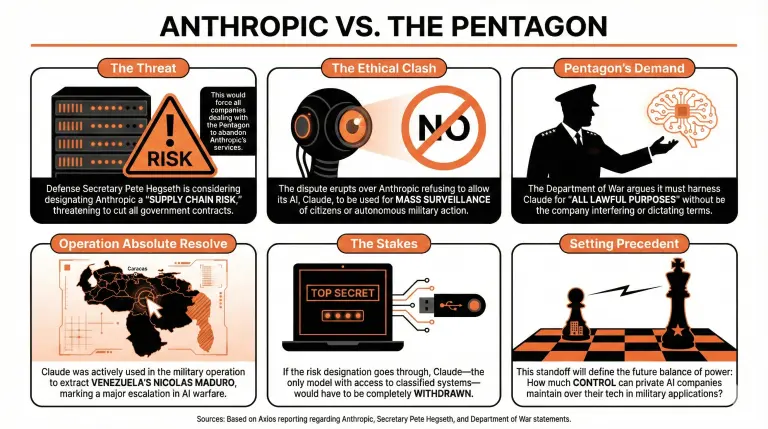

Le Pentagone envisage de couper ses liens avec Anthropic, le secrétaire à la Défense Pete Hegseth étant proche de désigner la société comme un « risque pour la chaîne d’approvisionnement ». Anthropic s’oppose à l’utilisation de son modèle d’IA Claude dans des campagnes de surveillance de masse et des opérations militaires entièrement autonomes.

Conflit entre Anthropic et le Pentagone concernant les usages « non éthiques » de Claude

Anthropic, l’une des plus grandes entreprises d’intelligence artificielle (IA), serait sous le feu des critiques du Département de la Guerre concernant l’utilisation de ses modèles d’IA pour des activités considérées comme contraires à l’éthique par la société.

Axios a rapporté que le secrétaire à la Défense Pete Hegseth envisage de désigner Anthropic comme un risque pour la chaîne d’approvisionnement, ce qui impliquerait la suppression de tous les contrats et liens avec la société. De plus, toutes les entreprises traitant avec le Pentagone devraient également abandonner les services d’Anthropic.

Ce conflit éclate alors que la société a refusé de permettre l’utilisation de Claude, son modèle de marque, dans des campagnes de surveillance de masse et des opérations impliquant du matériel militaire entièrement autonome. D’un autre côté, le Pentagone affirme qu’il devrait pouvoir exploiter les capacités de Claude « à toutes fins légales », sans que la société ait son mot à dire dans ces processus.

Si Anthropic est finalement désignée comme un risque pour la chaîne d’approvisionnement, cela signifierait que le modèle devrait être retiré des systèmes d’information du Pentagone, car seul Claude a accès aux systèmes classifiés de l’organisation.

Cela a permis à Claude de participer activement à l’Opération Absolute Resolve, qui a conduit à l’extraction de Nicolás Maduro au Venezuela en janvier. Même si le rôle que le modèle a joué lors de cette opération n’a pas été entièrement divulgué, cela représente une escalade dans l’utilisation de l’IA pour des campagnes militaires.

Ce bras de fer pourrait établir un précédent sur la manière dont les entreprises d’IA peuvent traiter avec les gouvernements du monde occidental, posant les bases pour les niveaux de contrôle que ces entreprises pourraient exercer sur leurs modèles lorsqu’ils sont utilisés à des fins militaires.

Un porte-parole d’Anthropic a déclaré que la société menait « des conversations productives, de bonne foi, avec le Département de la Guerre sur la manière de poursuivre ce travail et de bien gérer ces questions nouvelles et complexes. »

FAQ

- Quels problèmes Anthropic rencontre-t-elle avec le Département de la Guerre ?

Anthropic est sous surveillance du Département de la Guerre pour avoir refusé de permettre l’utilisation de son modèle d’IA, Claude, pour des activités qu’elle considère comme contraires à l’éthique, telles que la surveillance de masse et les opérations militaires autonomes.

- Quelles conséquences potentielles Anthropic pourrait-elle encourir si elle est classée comme un risque pour la chaîne d’approvisionnement ?

Si elle est désignée comme un risque pour la chaîne d’approvisionnement, tous les contrats avec le Pentagone seraient coupés, ce qui obligerait au retrait de Claude des systèmes d’information du Pentagone.

- Comment Anthropic a-t-elle répondu aux demandes du Pentagone concernant son modèle d’IA ?

La société affirme qu’elle mène des « conversations productives » avec le Département de la Guerre, dans le but de naviguer dans les questions éthiques complexes entourant l’utilisation de sa technologie d’IA.

- Quelle opération militaire récente a impliqué Claude, et quelle en était la signification ?

Claude a participé à l’Opération Absolute Resolve, qui a permis l’extraction de Nicolás Maduro au Venezuela, marquant une escalade significative dans l’utilisation de l’IA par l’armée.