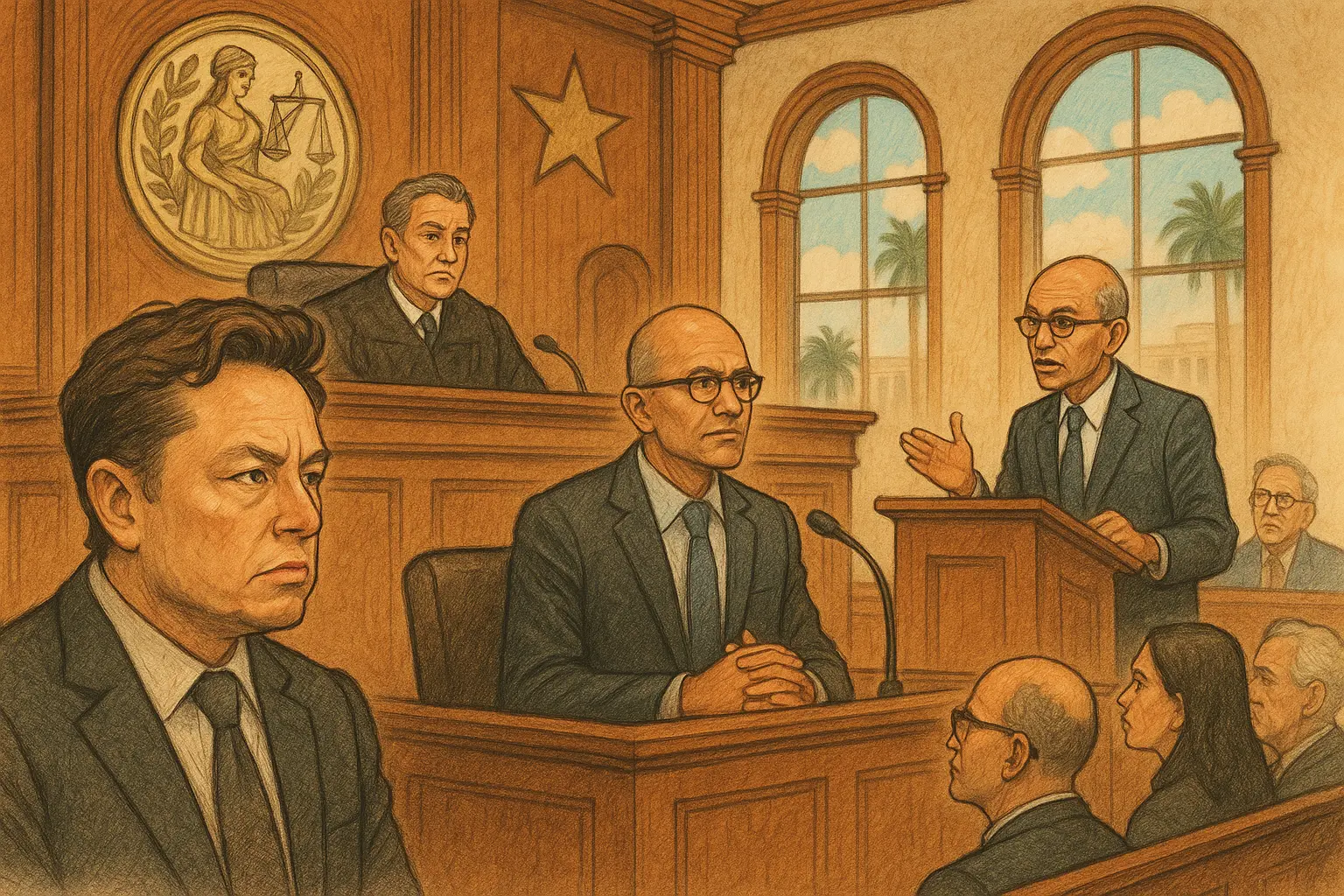

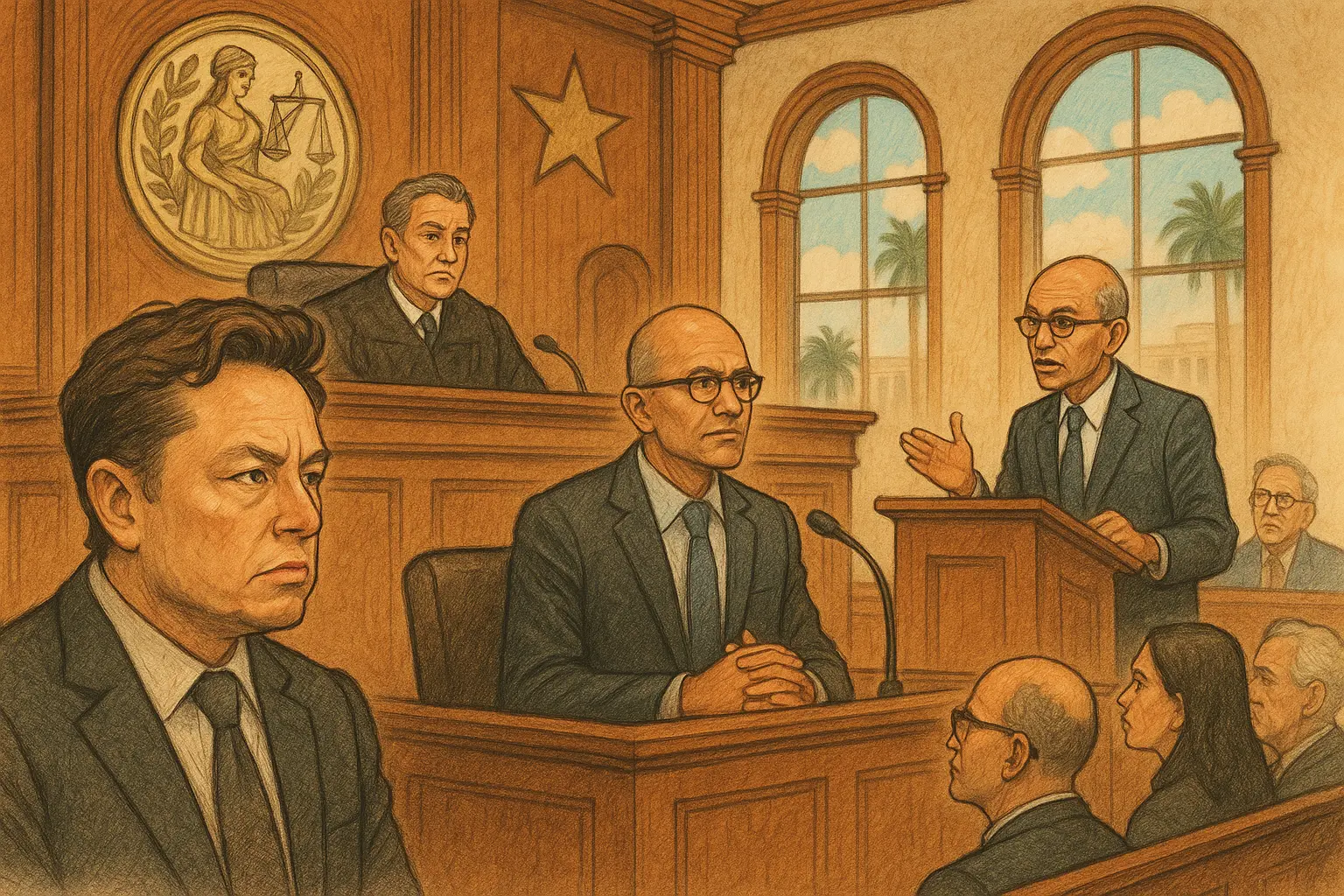

Elon Musk a lancé le 27 avril, devant un tribunal de Californie, la procédure de sélection du jury dans le cadre du procès visant OpenAI, accusée d’avoir trahi son engagement de départ de créer une organisation à but non lucratif. La juge présidente est Yvonne Gonzalez Rogers. D’après les documents judiciaires, Satya Nadella, PDG de Microsoft, figure comme témoin appelé à se présenter et à témoigner pendant la durée du procès, afin de rendre une décision finale avant la mi-mai.

Accusations au cœur du procès : OpenAI aurait trahi son engagement de départ non lucratif

Selon les documents judiciaires, Musk accuse OpenAI d’avoir renié sa mission non lucrative promise lors de sa création. Les documents indiquent qu’en 2015, OpenAI a été créée en persuadant Elon Musk d’y participer en tant que cofondateur, avec Sam Altman, la qualifiant comme un laboratoire de recherche non lucratif dont la technologie « appartiendra au monde entier ». Après avoir investi des centaines de millions de dollars dans OpenAI, Musk l’a quittée. Par la suite, OpenAI a créé des filiales commerciales en invoquant les fonds nécessaires à la construction de centres de données. Microsoft a investi des milliards de dollars dans OpenAI ; OpenAI adopte aujourd’hui une structure de gouvernance hybride, contrôlée par une fondation à but non lucratif sur la partie lucrative.

Position de contestation d’OpenAI et principaux points de litige entre les deux parties

Selon la position de contestation présentée par OpenAI dans ses documents judiciaires, la rupture avec Musk découle du fait que Musk cherche à obtenir un contrôle absolu sur l’entreprise, et non de la question du statut d’organisation à but non lucratif. Dans un message publié sur sa plateforme officielle X, OpenAI affirme : « Le cœur de cette affaire a toujours été la tentative d’Elon Musk de s’emparer de davantage de pouvoir et d’argent pour satisfaire ses propres envies. Son procès n’est qu’une action de harcèlement motivée par l’orgueil, la jalousie et le désir d’entraver des concurrents. »

Dans les documents judiciaires, OpenAI indique également que quelques jours après l’adhésion de Musk au concours d’intelligence artificielle en 2023, il a publiquement appelé à suspendre pendant six mois le développement d’une intelligence artificielle de pointe.

Demandes de réparation de Musk et mécanisme de décision du tribunal

D’après les documents judiciaires, les demandes de réparation de Musk comprennent : ordonner à OpenAI de redevenir une organisation strictement à but non lucratif, ainsi que le remplacement de Sam Altman et du cofondateur Greg Brockman. Musk avait auparavant formulé une demande d’indemnisation pouvant atteindre 1 340 milliards de dollars ; il a ensuite retiré sa prétention de revenus personnels, promettant de donner toute indemnisation à l’organisation à but non lucratif d’OpenAI. D’après les documents judiciaires, la juge Gonzalez Rogers conserve le droit de décider de toute modalité d’indemnisation de manière autonome, sans que le jury participe à cette étape.

Questions fréquentes

De quelles accusations précises Musk accuse-t-il OpenAI, et comment le procès va-t-il se dérouler ?

Selon les documents judiciaires, Musk accuse OpenAI d’avoir trahi sa mission non lucrative promise lors de sa création en 2015. Le procès commencera en Californie par la sélection du jury le 27 avril 2026 (lundi). La juge présidente, Gonzalez Rogers, rendra une décision finale avant la mi-mai, en se fondant sur les résultats de l’enquête du jury et sur les conclusions tirées.

Quelles réparations juridiques Musk cherche-t-il dans le procès ?

Selon les documents judiciaires, Musk demande au tribunal d’obliger OpenAI à redevenir une organisation strictement à but non lucratif, et de remplacer le PDG Sam Altman et le président Brockman. Musk avait auparavant demandé 134 milliards de dollars ; il a ensuite retiré sa prétention de revenus personnels, en s’engageant à donner toute indemnisation à l’organisation à but non lucratif d’OpenAI.

Pourquoi le PDG de Microsoft, Nadella, est-il appelé à témoigner, et quel est son lien avec OpenAI ?

D’après les documents judiciaires, le PDG de Microsoft, Satya Nadella, témoignera en personne pendant le procès. Microsoft est le principal investisseur d’OpenAI : il y a investi des milliards de dollars et détient un intérêt correspondant dans la structure de gouvernance hybride qu’OpenAI applique actuellement.

Avertissement : Les informations contenues dans cette page peuvent provenir de tiers et ne représentent pas les points de vue ou les opinions de Gate. Le contenu de cette page est fourni à titre de référence uniquement et ne constitue pas un conseil financier, d'investissement ou juridique. Gate ne garantit pas l'exactitude ou l'exhaustivité des informations et n'est pas responsable des pertes résultant de l'utilisation de ces informations. Les investissements en actifs virtuels comportent des risques élevés et sont soumis à une forte volatilité des prix. Vous pouvez perdre la totalité du capital investi. Veuillez comprendre pleinement les risques pertinents et prendre des décisions prudentes en fonction de votre propre situation financière et de votre tolérance au risque. Pour plus de détails, veuillez consulter l'

avertissement.

Articles similaires

Le sénateur Bernie Sanders lance un avertissement concernant la menace existentielle de l’IA

Sanders a insisté sur le fait que, même si la plupart des scientifiques de l’IA reconnaissent la possibilité que l’IA échappe au contrôle et devienne un danger pour notre existence, aucune mesure majeure n’a été prise pour l’éviter. « Nous devons nous assurer que l’IA profite à l’humanité, et ne nous nuit pas », a-t-il déclaré.

Points clés :

Bernie Sanders

CoinpediaIl y a 4m

Responsable du modèle IA de Xiaomi : la concurrence en IA passe à l’ère des agents, l’auto-évolution est un événement clé vers l’AGI

Le responsable de l’équipe des grands modèles de Xiaomi, Luo Fuli, a accordé une interview approfondie (numéro de vidéo : BV1iVoVBgERD) sur la plateforme Bilibili le 24 avril, d’une durée de 3,5 heures. Il s’agit de la première fois qu’elle expose de manière systématique ses points de vue techniques en tant que responsable technique. Luo Fuli a déclaré que la course aux grands modèles est passée de l’ère du Chat à l’ère des Agents, et a souligné que « l’auto-évolution » sera l’événement clé de l’AGI au cours de l’année à venir.

MarketWhisperIl y a 4m

La voix de xAI Grok prend en charge la ligne d’assistance client de Starlink, 70% des appels sont clôturés automatiquement

Selon l’annonce officielle publiée par xAI le 23 avril, xAI a lancé l’agent vocal d’IA Grok Voice Think Fast 1.0, et l’a déjà déployé sur la ligne d’assistance clientèle Starlink +1 (888) GO STARLINK. D’après les données d’essai divulguées dans l’annonce, 70% des appels sont automatiquement clôturés par l’IA, sans intervention humaine.

MarketWhisperIl y a 16m

GPT-5.5 revient à la pointe du codage, mais OpenAI change de benchmarks après avoir perdu face à Opus 4.7

Message de Gate News, 27 avril — SemiAnalysis, un cabinet d’analyse de semi-conducteurs et d’IA, a publié un benchmark comparatif d’assistants de codage incluant GPT-5.5, Claude Opus 4.7 et DeepSeek V4. Le principal constat : GPT-5.5 marque le premier retour d’OpenAI à la pointe dans les modèles de codage en six mois, avec des ingénieurs de SemiAnalysis qui alternent désormais entre Codex et Claude Code après s’être auparavant appuyés presque exclusivement sur Claude. GPT-5.5 repose sur une nouvelle approche de préentraînement codée « Spud » et représente la première expansion de l’échelle de préentraînement d’OpenAI depuis GPT-4.5.

Lors de tests pratiques, une division claire des tâches est apparue. Claude gère la planification de nouveaux projets et la configuration initiale, tandis que Codex excelle dans les corrections de bugs axées sur le raisonnement. Codex fait preuve d’une meilleure compréhension des structures de données et d’un raisonnement logique, mais a des difficultés à inférer l’intention utilisateur ambiguë. Sur une tâche à un seul tableau de bord, Claude a reproduit automatiquement la mise en page de la page de référence tout en fabriquant de grandes quantités de données, tandis que Codex a ignoré la mise en page mais a fourni des données nettement plus exactes.

L’analyse révèle un détail de manipulation du benchmark : dans un billet de blog de février, OpenAI a exhorté l’industrie à adopter SWE-bench Pro comme nouveau standard pour les benchmarks de codage. Cependant, l’annonce de GPT-5.5 est passée à un nouveau benchmark appelé « Expert-SWE ». La raison, dissimulée dans les petits caractères, est que GPT-5.5 a été dépassé par Opus 4.7 sur SWE-bench Pro et a chuté de manière significative par rapport à Mythos non publié de l’Anthropic 77.8%.

Concernant Opus 4.7, Anthropic a publié une analyse post-mortem une semaine après la sortie, reconnaissant trois bugs dans Claude Code qui ont persisté pendant plusieurs semaines de mars à avril, affectant près de tous les utilisateurs. Plusieurs ingénieurs avaient déjà signalé une dégradation des performances dans la version 4.6, mais ils avaient été écartés en tant qu’observations subjectives. De plus, le nouveau tokenizer d’Opus 4.7 augmente l’utilisation de tokens jusqu’à 35 %, qu’Anthropic a admis ouvertement — ce qui revient effectivement à une hausse de prix cachée.

DeepSeek V4 a été évalué comme « tenant le rythme avec la frontière mais sans la mener », se positionnant comme l’alternative la moins coûteuse parmi les modèles à code source fermé. L’analyse a également noté que « Claude continue de surpasser DeepSeek V4 Pro sur des tâches d’écriture chinoises à haute difficulté », en commentant que « Claude a gagné contre le modèle chinois dans sa propre langue. »

L’article présente un concept clé : le prix des modèles doit être évalué par « coût par tâche » plutôt que par « coût par token ». Le prix de GPT-5.5 est le double de celui de GPT-5.4 input $5, output par million de tokens, mais il accomplit les mêmes tâches en utilisant moins de tokens, ce qui ne rend pas nécessairement le coût réel plus élevé. Les données initiales de SemiAnalysis montrent que le ratio input-to-output de Codex est de 80:1, inférieur à celui de Claude Code à 100:1.

GateNewsIl y a 20m

Google DeepMind Executive: Every AI Product Company Should Build Custom Benchmarks

Gate News message, April 27 — Logan Kilpatrick, senior product manager at Google DeepMind and product lead for Google AI Studio, stated on X that every company building AI-based products should establish its own custom benchmarks to measure AI model performance. He described this as a method to

GateNewsIl y a 1h

MediaTek remporte une grande commande de Google pour la 8e génération de TPU ! L’“effet fermentation” des ASIC stimule trois valeurs conceptuelles bénéficiaires

MediaTek s’est intégré à la chaîne d’approvisionnement des puces d’entraînement Google TPU de 8e génération, en prenant en charge la conception des I/O Die, et en utilisant la technologie N3P de TSMC ainsi que l’emballage CoWoS-S, ce qui montre qu’elle a atteint un niveau de conception d’ASIC d’IA haut de gamme. On s’attend à ce que le chiffre d’affaires ASIC de cette année dépasse 1 milliard de dollars, et que le volume d’expédition des TPU atteigne, d’ici 2027, jusqu’à des dizaines de millions d’unités ; la chaîne d’approvisionnement taïwanaise, notamment King Yuan Electronics, I-Cube Precision et Hon Hai, bénéficiera également, et le marché se tournera progressivement vers l’avenir de la coopération par spécialisation et de l’intégration hétérogène avec chiplets.

ChainNewsAbmediaIl y a 1h