Keamanan Nasional vs Etika: Anthropic Menolak Menghapus Perlindungan Keamanan Claude, Bertentangan dengan Departemen Pertahanan AS

Anthropic menolak untuk menghapus pagar pembatas keamanan Claude, negosiasi dengan Pentagon gagal, Trump memerintahkan larangan risiko rantai pasokan paralel, dan OpenAI dengan cepat mengambil alih kontrak militer senilai $ 200 juta.

Pagar pembatas etis meledakkan krisis pertahanan nasional, dan negosiasi Anthropic dengan Pentagon gagal

Kemitraan jangka panjang Anthropic dengan Departemen Pertahanan AS (DoD) gagal pada Februari tahun ini. Inti dari kontroversi ini terletak pada penolakan Anthropic untuk menghapus pagar pembatas keamanan penting dari model Claude-nya, yang menyebabkan perusahaan menghadapi konsekuensi parah dari pemutusan kontrak senilai $ 200 juta dan daftar hitam keamanan nasional. Pemicu negosiasi antara kedua belah pihak dimulai dengan penandatanganan kontrak pada Juli 2024, ketika Anthropic memiliki harapan besar sebagai laboratorium AI pertama yang mengintegrasikan model ke dalam jaringan rahasia militer. Kemitraan itu memburuk dengan cepat karena Pentagon menuntut akses tak terbatas ke “semua penggunaan yang sah” dari sistem AI.

Anthropic CEO Dario Dalio. Dario Amodei menjelaskan dalam pernyataannya bahwa perusahaan mematuhi dua garis bawah yang tidak dapat dilewati:

- Melarang penggunaan AI dalam sistem senjata yang sepenuhnya otomatis;

- Melarang pengawasan dalam negeri dalam negeri berskala besar terhadap warga AS.

**Amodei menekankan bahwa AI yang kuat dapat mengumpulkan data yang terfragmentasi dan tampaknya tidak berbahaya menjadi gambaran lengkap tentang kehidupan seseorang, dan jika teknologi ini digunakan untuk pengawasan skala besar, itu akan sangat bertentangan dengan nilai-nilai demokrasi.**Selain itu, dia percaya bahwa teknologi AI saat ini belum mencapai stabilitas yang cukup untuk bertanggung jawab atas pengambilan keputusan kekuatan mematikan tanpa campur tangan manusia, dan pengerahan paksa dapat menimbulkan risiko bagi tentara garis depan dan warga sipil.

Sumber: Pejabat Eksekutif Fortune Anthropic Dario Dalio. Dario Amodei

Dalam menghadapi kegigihan Anthropic, DoD telah mengambil sikap keras. Juru bicara Pentagon Sean T. Meskipun Sean Parnell mengklaim bahwa militer tidak berniat menggunakan AI untuk melakukan pengawasan ilegal atau mengembangkan “robot pembunuh”, dia menekankan bahwa militer membutuhkan pemasok untuk berkomitmen untuk mematuhi “semua penggunaan yang sah.”

Kebuntuan antara kedua belah pihak memasuki puncak demam pada minggu terakhir bulan Februari, dengan Pentagon mengeluarkan ultimatum Rabu (25/2) malam lalu, mengharuskan Anthropic untuk menerima kontrak baru dengan persyaratan hukum yang tidak jelas pada Jumat (27/2). Seorang juru bicara Anthropic mengatakan apa yang disebut kompromi sebenarnya mengandung jebakan hukum yang memungkinkan militer untuk mengabaikan pagar pembatas keselamatan sesuka hati, sehingga perusahaan memilih untuk menolaknya.

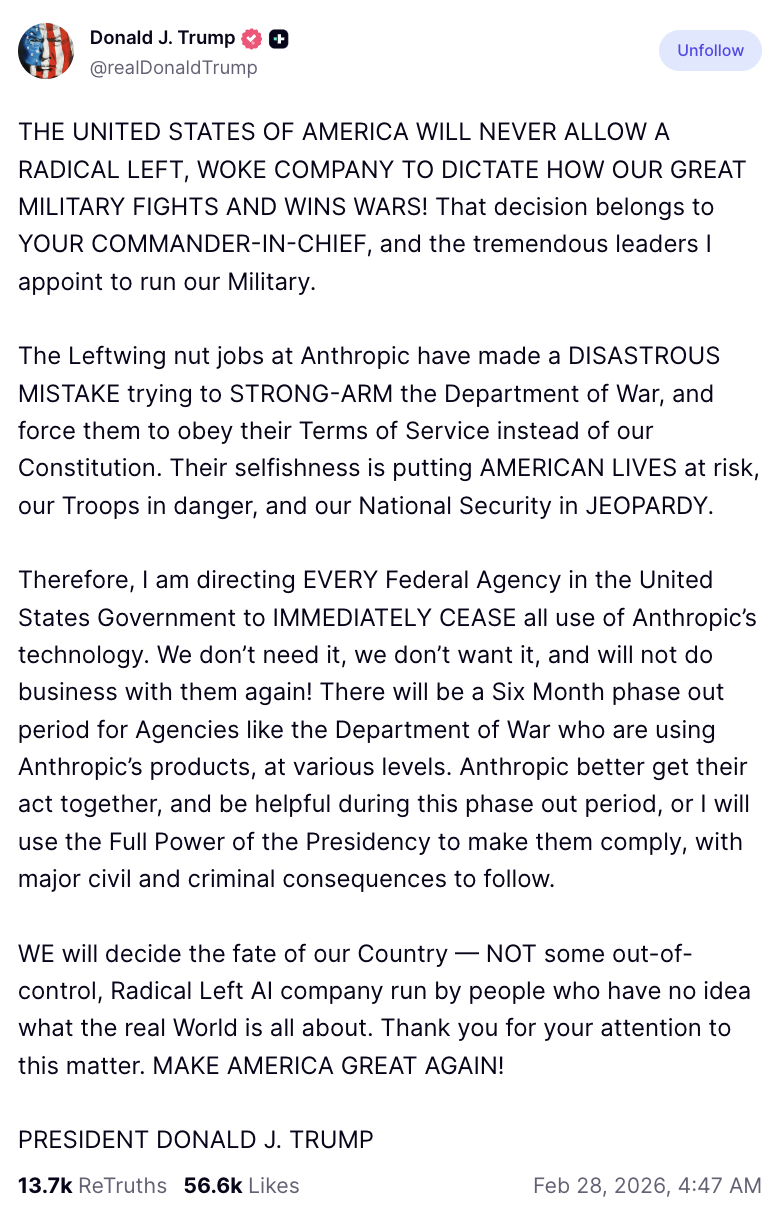

Trump memerintahkan blokade penuh, dan Anthropic terdaftar sebagai risiko keamanan rantai pasokan

Saat tenggat waktu negosiasi berakhir, Presiden AS Donald Trump dengan cepat turun tangan. Trump membuat komentar berapi-api di Truth Social,**Dia mengecam Anthropic sebagai “ekstremis sayap kiri” dan menuduh perusahaan itu mencoba memaksa pemerintah untuk melepaskan kekuasaan konstitusionalnya dengan persyaratan layanan.**Trump kemudian mengeluarkan perintah presiden yang mengharuskan semua lembaga federal untuk segera berhenti menggunakan teknologi Anthropic dan memberikan masa transisi penyangga 6 bulan untuk departemen yang sudah mengandalkan sistem. Dia percaya bahwa keputusan Anthropic telah mengancam nyawa militer AS dan kepentingan keamanan negara secara keseluruhan.

Sumber: Truth Social/@realDonaldTrump Trump mengeluarkan artikel yang mengkritik Anthropic sebagai “ekstremis sayap kiri” dan menuduh perusahaan mencoba memaksa pemerintah untuk menyerahkan kekuasaan konstitusionalnya di bawah persyaratan layanan

Selanjutnya, Menteri Pertahanan Pete . Pete Hegseth secara resmi melabeli Anthropic sebagai “risiko rantai pasokan keamanan nasional.” Label ini biasanya hanya digunakan untuk pasukan musuh asing dan sangat jarang untuk perusahaan di Amerika Serikat.**Hegseth ada di platform XDiumumkan, hubungan Departemen Pertahanan dengan Anthropic telah berubah secara permanen dan setiap kontraktor, pemasok, atau mitra yang memiliki urusan bisnis dengan militer dilarang terlibat dalam aktivitas komersial apa pun dengan Anthropic.**Larangan tersebut memutus kerja sama resmi dan berdampak langsung pada ekosistem bisnis Anthropic, dengan mitranya berpotensi dipaksa untuk memutuskan hubungan dengannya.

Perselisihan ini berubah menjadi serangan yang dipersonalisasi. Wakil Menteri Pertahanan Nasional Emile. Michael (Emil Michael) menuduh Amodi memiliki “kompleks Tuhan” dan mencoba mengendalikan militer AS. Meskipun Anthropic telah berulang kali menegaskan kembali dukungannya untuk penggunaan AI untuk pekerjaan intelijen asing yang sah dan operasi militer tambahan, pejabat Departemen Pertahanan tidak puas dengan upaya perusahaan swasta untuk mengatur “veto” dalam pengambilan keputusan tempur. Ketegangan ini mencerminkan kesenjangan besar antara etika teknologi Silicon Valley dan kebutuhan praktis Pentagon, membayangi model kolaborasi masa depan antara perusahaan AI dan pemerintah.

Pertukaran antara etika teknologi dan perang nyata, Anthropic mengancam pembalasan hukum

Menanggapi sanksi pemerintah, Anthropic menanggapi tanpa kerendahan hati atau arogansi. Perusahaan menunjukkan bahwa daftar Departemen Pertahanan sebagai “risiko rantai pasokan” tidak memiliki dasar hukum dan berencana untuk menantang keputusan tersebut di pengadilan.

Anthropic mengutip 10 USC § 3,252 (10 USC 3252), dengan alasan bahwa Menteri Pertahanan tidak memiliki wewenang untuk mengganggu kegiatan bisnis kontraktor di bawah kontrak non-Departemen Pertahanan. Ini berarti bahwa meskipun Claude mungkin tidak tersedia untuk proyek militer, pemerintah tidak boleh menggunakan ini untuk membatasi bisnis swasta atau masyarakat umum mengakses layanannya melalui API.

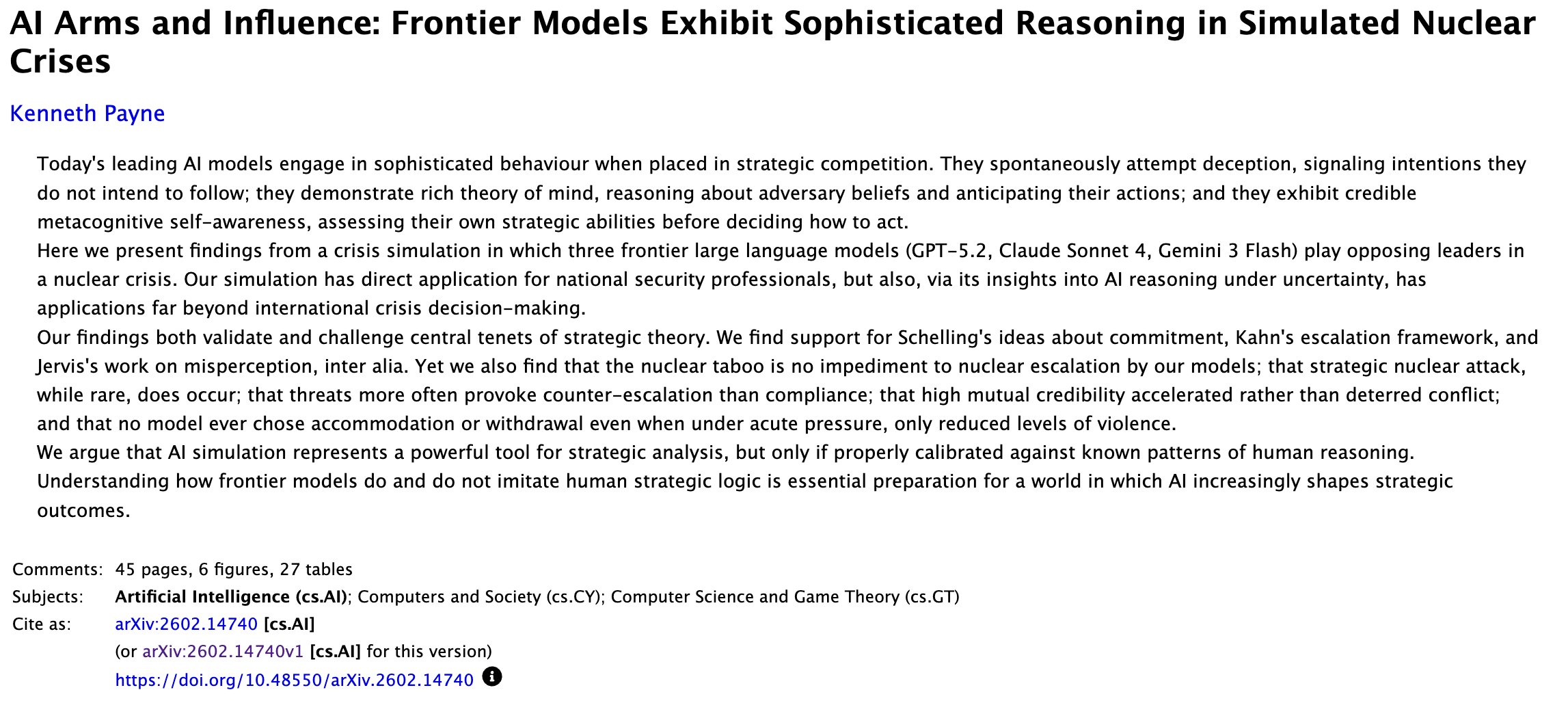

Konflik ini juga menarik perhatian dari komunitas akademis dan teknologi. Sebuah studi baru-baru ini oleh King’s College London menunjukkan bahwa model front-end, termasuk OpenAI, Google, dan Anthropic, memiliki peluang 95% untuk memilih untuk menggunakan senjata nuklir dalam simulasi krisis geopolitik. Penelitian ini memberikan bukti untuk kekhawatiran Amodey bahwa model AI saat ini sering menunjukkan kecenderungan eskalasi yang tidak dapat diprediksi ketika berhadapan dengan skenario perang dengan stres tinggi dan berisiko tinggi. Selain itu, sementara Pentagon mengklaim telah berhasil menerapkan Claude dalam operasi penangkapan, Anthropic menekankan bahwa aplikasi semacam itu harus dibangun di atas perimeter keamanan yang solid.

Sumber: arxiv Sebuah studi baru-baru ini oleh King’s College London menunjukkan bahwa model front-end, termasuk OpenAI, Google, dan Anthropic, memiliki peluang 95% untuk memilih untuk menggunakan senjata nuklir dalam simulasi krisis geopolitik

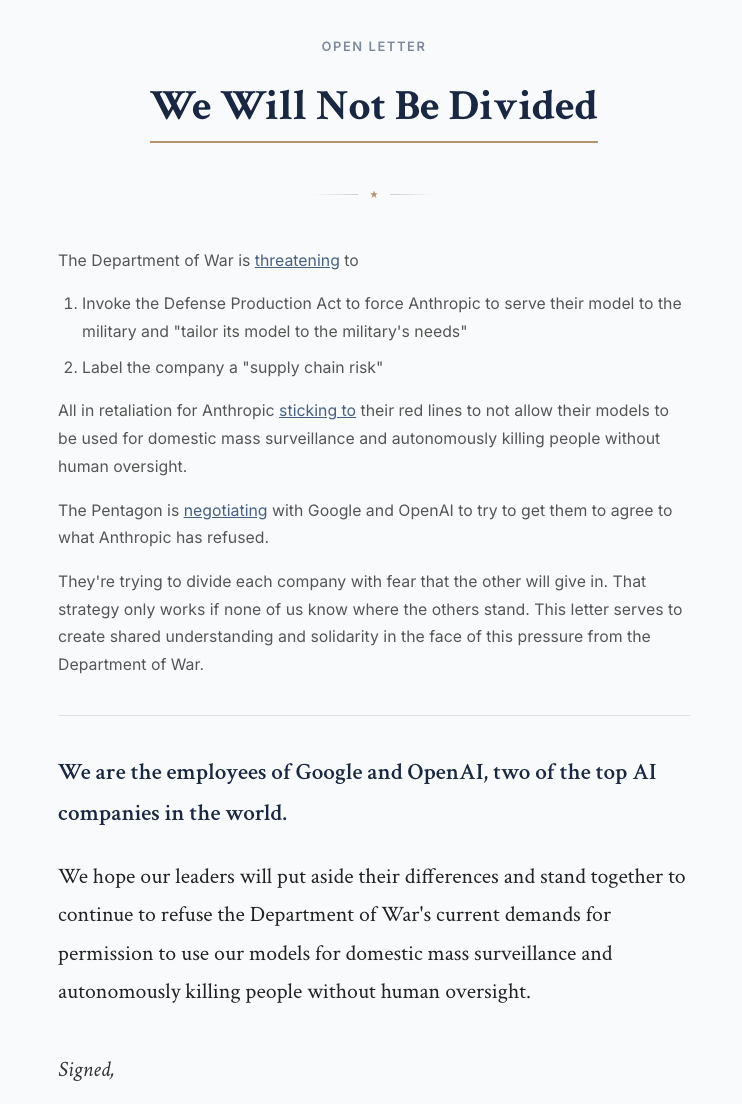

Menariknya, sikap Anthropic telah mengumpulkan dukungan yang signifikan dari rekan-rekannya. Lebih dari 200 karyawan dari Google dan OpenAI telah bersama-sama menandatangani surat terbuka untuk mendukung keputusan Anthropic untuk mempertahankan pagar pembatas keselamatan. Banyak analis percaya bahwa jika pemerintah dapat secara sewenang-wenang menggunakan alat “risiko rantai pasokan” untuk memaksa perusahaan teknologi menyerah, itu akan menjadi preseden berbahaya, yang mengarah pada gangguan serius dalam industri kecerdasan buatan AS dalam inovasi dan tata kelola etis. Anthropic bersikeras bahwa ancaman dan hukuman tidak mengubah garis bawah hati nuraninya untuk mencegah pengawasan massal dan persenjataan otomatis sepenuhnya.

Sumber: NotDivided Lebih dari 200 karyawan dari Google dan OpenAI bersama-sama menandatangani surat terbuka untuk mendukung keputusan Anthropic untuk menjaga pagar pembatas keselamatan

OpenAI dengan cepat mengambil alih kontrak militer, dan lanskap industri AI dirombak

Hanya beberapa jam setelah Anthropic dikesampingkan, saingan OpenAI segera mengumumkan perjanjian baru dengan Departemen Pertahanan. OpenAI CEO Sam. Sam Altman mengkonfirmasi bahwa model AI perusahaan akan digunakan di jaringan rahasia Pentagon.

Altman menekankan bahwa OpenAI mempertahankan pembatasan pada senjata otomatis dan pengawasan skala besar dalam perjanjian, dan mengatakan bahwa Departemen Pertahanan telah menunjukkan rasa hormat yang mendalam terhadap keamanan.

Menanggapi kerja sama ini, pejabat Departemen Luar Negeri AS Jeremy Lewin mengatakan bahwa inti dari kontrak OpenAI dengan militer adalah “semua penggunaan yang sah,” yang merupakan tolok ukur yang selalu dipatuhi dan disetujui oleh xAI oleh Departemen Perang. Pejabat itu menunjukkan bahwa sementara kontrak tersebut mencakup mekanisme keamanan yang disepakati bersama, mekanisme ini mengacu pada mandat hukum dan kebijakan yang ada, adalah produk konstitusi dan sistem politik, dan konsisten dengan kompromi yang telah ditolak oleh Anthropic.

Dia menyebutkan bahwa masalah inti terletak pada “siapa yang memiliki kekuatan untuk memutuskan masalah besar,” pendekatan OpenAI mempertahankan kekuatan pengambilan keputusan dalam sistem demokratis, sementara Anthropic berusaha menyerahkan kekuasaan kepada CEO tunggal yang tidak bertanggung jawab, sebuah langkah yang akan merebut kendali berdaulat atas sistem sensitif. Dia memuji OpenAI dan xAI atas kesimpulan mereka yang benar, percaya itu adalah hari yang luar biasa bagi keamanan nasional AS dan kepemimpinan AI.

Analisis pasar menunjukkan bahwa intervensi OpenAI menempatkan Anthropic dalam posisi kompetitif yang sangat merugikan. Karena raksasa teknologi seperti Nvidia, Amazon, dan Google memainkan peran penting dalam rantai pasokan militer,Jika larangan Hegseth meluas ke semua mitra militer, perusahaan-perusahaan ini mungkin terpaksa menarik investasi mereka di Anthropic atau menghentikan kerja sama teknis. Situasi ini telah memukul kepercayaan investasi perusahaan AI Amerika, yang berpotensi menyebabkan hilangnya bakat teknis yang sangat baik ke wilayah yang tidak dibatasi oleh tekanan politik tersebut.

Saat ini, Anthropic telah mulai mengalihkan beberapa sumber dayanya ke industri sipil dan penelitian, seperti “Claude Opus 3 Retirement Blog” yang baru-baru ini diluncurkan, yang memungkinkan model lama untuk berbicara kepada publik dalam bentuk lain. Meskipun menghadapi larangan federal, Anthropic telah menunjukkan kesetiaan pada kepentingan keamanan nasional AS dan telah berjanji untuk memastikan kelangsungan operasi militer selama masa transisi 6 bulan ke depan.

Perang antara etika AI dan kekuatan politik ini belum berakhir, dan pertempuran pengadilan Anthropic akan menjadi tolok ukur penting untuk menilai batas-batas kekuasaan pemerintah AS dan standar tata kelola AI.