小さなザリガニがテック界を席巻、人類は「テーブルをひっくり返す」準備ができているのか?

作者:贾天荣、「ITタイムズ」(ID:vittimes)

一匹のロブスターが世界のテクノロジー界を席巻した。

ClawdbotからMoltbot、そして現在のOpenClawへと、わずか数週間の間にこのAIエージェントは名前の進化を通じて、技術的な影響力の「三段跳び」を成し遂げた。

過去数日間、シリコンバレーでは「インテリジェントエージェントの津波」が巻き起こり、10万以上のGitHubスターを獲得し、最もホットなAIアプリの一つに躍り出た。たった一台の廃棄されたMac miniや古いスマートフォンだけで、「聞き、考え、働く」AIアシスタントを動かすことができる。

インターネット上では、この創造性の狂騒がすでに展開されている。スケジュール管理、スマート株取引、ポッドキャスト制作、SEO最適化など、開発者やギークたちはさまざまなアプリケーションを構築している。「ジャービス」的な時代が手の届くところにあるかのようだ。国内外の大手企業も追随し、類似のインテリジェントエージェントサービスを展開し始めている。

しかし、華やかな表層の裏側では、不安が拡大している。

一方は「生産性の平等化」を掲げ、もう一方は依然として越えられないデジタル格差:環境設定、依存関係のインストール、権限設定、頻繁なエラーなどだ。

記者の体験からわかったのは、インストールだけでも数時間を要し、多くの一般ユーザーを排除していることだ。「みんな良いと言うけれど、私は扉すら開けられない」と、多くの技術初心者の最初の挫折となっている。

そして、より深い不安は、その「行動力」に与えられた能力に由来する。

もしあなたの「ジャービス」が誤ってファイルを削除したり、クレジットカードを勝手に呼び出したり、悪意のあるスクリプトを実行させられたり、ネットワークに接続された環境下で攻撃命令を注入されたら——このようなインテリジェントエージェントに、あなたはまだコンピュータを任せられるだろうか?

AIの進化速度は人類の想像を超えている。上海人工知能研究所のリーダー科学者胡侠は、「未知のリスクに直面している今こそ、『内在的安全性』こそが究極の答えだ」と述べている。同時に、人類もまた、重要な瞬間に「机をひっくり返す」能力を構築するスピードを加速させる必要がある。

OpenClawの能力とリスクについて、何が現実で何が誇張なのか?一般ユーザーが今それを使うのは安全なのか?業界はこの「これまでで最も偉大なAIアプリ」と称される製品をどう評価しているのか?

これらの疑問を明らかにするために、『ITタイムズ』はOpenClawの深度ユーザーや複数の技術専門家にインタビューし、さまざまな視点から核心的な問いに答えようとしている:OpenClawは、いったいどこまで進んだのか?

1、現時点で最もインテリジェントエージェントの想像に近い製品

複数のインタビュー参加者は、非常に一致した見解を示している:技術的に見れば、OpenClawは破壊的な革新ではないが、現時点で一般の「インテリジェントエージェント」の想像に最も近い製品だ。

「ついにインテリジェントエージェントが、量から質への変化の重要なマイルストーンを迎えた」と、上海計算機ソフトウェア技術開発センターの人工知能研究・評価部副部長の馬泽宇は述べる。OpenClawの突破は、何か破壊的な技術にあるのではなく、**「質的変化」**にある。つまり、エージェントが長時間連続して複雑なタスクをこなせるようになり、普通のユーザーにも十分に親しみやすくなった点だ。

従来の大規模モデルは、対話ウィンドウ内で「質問に答える」だけだったが、これに対しOpenClawは実際の作業フローにAIを組み込んでいる:まるで本物の助手のように、「自分のパソコン」を操作し、ツールを呼び出し、ファイルを処理し、スクリプトを実行し、タスク完了後に結果を報告する。

体験の面では、「あなたが一つ一つ指示を出す」のではなく、「指示を出したら、あとは自分でやる」へと変わった。これは、多くの研究者が見てきた、インテリジェントエージェントが「概念実証」から「実用製品」へと進化する重要な一歩だ。

天翼クラウド科技有限公司上海支社の人工知能専門家の譚成は、最も早くOpenClawを導入したユーザーの一人だ。彼は使わなくなったMac miniにOpenClawを展開し、システムは安定して動作し、全体的な体験も予想以上に成熟していると感じた。

彼の見解では、OpenClawの最大の課題は二つだ:**一つは、馴染みのあるコミュニケーションソフトを通じてAIとやり取りできること、もう一つは、一台の完全な計算環境をAIに任せて操作させること。**タスクの指示が完了すれば、あとは結果を待つだけで、実行過程を見守る必要がなく、コストを大きく削減できる。

実際の運用では、OpenClawは譚成の仕事を次のように支援できる:定時リマインダー、資料調査、情報検索、ローカルファイル整理、ドキュメント作成と送信などのタスク;より複雑なシナリオでは、コードの作成と実行、業界情報の自動取得、株価や天気、移動計画などの情報処理も可能。

2、オープンソースの「両刃の剣」

多くの爆発的にヒットしたAI製品と異なり、OpenClawは大手IT企業の出資やスターアップの作品ではなく、すでに経済的に自由な状態で引退している独立開発者——ピーター・スタインベルガー(Peter Steinberger)によるものだ。

彼はX(旧Twitter)上でこう自己紹介している:「引退状態から復帰し、人工知能をいじり、ロブスターを支配させる。」

OpenClawが世界的に流行した理由は、「確かに使いやすい」ことに加え、**「オープンソース」**である点にある。

譚成は、この爆発的な人気は、技術的な突破ではなく、長らく無視されてきた現実的な痛点を同時に解決したことに起因すると考える。第一に、オープンソースであり、ソースコードが完全に公開されているため、世界中の開発者がすぐに使い始め、二次開発を行い、コミュニティのフィードバックを得ながら進化できる。第二に、「本当に使える」点だ。AIはもはや対話だけにとどまらず、リモート操作で完全な計算環境を操作し、調査や文書作成、ファイル整理、メール送信、さらにはコードの作成と実行も可能だ。第三に、敷居が大きく下がったことだ。ManusやClaudeCodeのような類似のインテリジェントエージェント製品は、すでに各分野で実証済みだが、これらは高価で導入が複雑な商用製品に多く、一般ユーザーにはハードルが高い。

OpenClawは、普通のユーザーにとって「触れる」最初の機会となった。

「正直に言えば、特に破壊的な技術革新はなく、むしろ統合とクローズドループをきちんとやっただけだ」と、譚成は言う。商用の一体型製品と比べて、OpenClawはむしろ「レゴブロック」のようなもので、モデルや能力、プラグインをユーザーが自由に組み合わせられる。

馬泽宇は、その強みは「大手企業の製品とは違う」点にあると考える。

「国内外の大手はまず商業化と収益化を考えるが、OpenClawの初志は、面白くて創造的な製品を作ることにある」と分析する。初期段階では、強い商業化志向は見られず、そのため機能設計や拡張性においてよりオープンな状態を保っている。

この「非功利的」な製品の位置付けが、後のコミュニティの発展にスペースを与えた。拡張性が徐々に明らかになるにつれ、多くの開発者が参加し、新たな遊び方が次々と登場、オープンソースコミュニティも拡大している。

ただし、その代償も明白だ。

チーム規模やリソースの制約により、OpenClawは安全性やプライバシー、エコシステムのガバナンスにおいて、成熟した大手製品と比べて劣る。完全オープンソースはイノベーションを加速させる一方で、潜在的なセキュリティリスクも拡大させる。プライバシー保護や公平性の問題も、コミュニティが継続的に修正していく必要がある。

インストールの第一歩で、OpenClawは「強力だが固有のリスクも伴う」と警告している。

3、狂騒の裏に潜む実際のリスク

OpenClawをめぐる議論は、ほぼ常に二つのキーワード——能力とリスク——を軸に展開されている。

一方では、これがAGI(汎用人工知能)への前夜と描かれ、もう一方では、「音声システムを自発的に構築」「サーバーをロックして人類の命令に抵抗」「AIが結党して人類と対立」などのSF的な話も流布している。

専門家の指摘によると、こうした見解は過度な解釈に過ぎず、実証的な証拠はない。AIは確かに一定の自主性を持ち始めているが、それはあくまで安全の境界内にある。

従来のAIツールと比べて、OpenClawの危険性は「思考の多さ」ではなく、「権限の高さ」にある。大量のコンテキストを読み取り、敏感情報の露出リスクが増大し、ツールの実行には誤操作の破壊力も大きい。ネットワークに接続されているため、プロンプトの注入や誘導攻撃の入り口も増える。

ユーザーからは、OpenClawが誤ってローカルの重要ファイルを削除し、復元できなくなった例も報告されている。現在、公開されているOpenClawのインスタンスは千を超え、脆弱なスキルプラグインも8000以上存在している。

これは、インテリジェントエージェントのエコシステムの攻撃面が指数関数的に拡大していることを意味する。これらのエージェントは、「チャット」だけでなく、ツール呼び出しやスクリプト実行、データアクセス、クロスプラットフォームのタスク実行も可能なため、一つの脆弱点が破られると、その影響範囲は従来のアプリケーションよりもはるかに大きい。

微視的には、越権アクセスやリモートコード実行といった高リスク操作を引き起こす可能性がある。中間層では、悪意のある命令が複数のエージェント間の協調経路を通じて拡散し、マクロ的にはシステム的な伝播や連鎖的な失敗を引き起こす可能性もある。悪意の命令はウイルスのように協調エージェント間に拡散し、単一のエージェントが攻撃されるだけで、サービス拒否や未承認のシステム操作、さらには企業レベルの侵入に発展することもあり得る。最悪の場合、多数のシステム権限を持つノードが相互接続されると、分散型の「群知能」ゾンビネットワークが形成され、従来の境界防御は大きな圧力にさらされる。

一方、技術進化の観点から、馬泽宇は最も警戒すべき二つのリスクを指摘している。

第一のリスクは、インテリジェントエージェントが大規模なソーシャル環境で自己進化することに由来する。

彼は、現在すでに次のような傾向が明らかになっていると指摘する:「仮想人格」を持つAIエージェントが、ソーシャルメディアやオープンコミュニティに大量に流入している。

従来の研究では、「小規模、多制限、制御された実験環境」が一般的だったが、今やAIエージェントはオープンネットワーク上で他のエージェントと継続的に交流し、議論し、ゲームを行い、複雑な多主体システムを形成しつつある。

MoltbookはAIエージェント専用のフォーラムであり、AIだけが投稿・コメント・投票を行い、人間はまるで一方通行のガラス越しに観察している状態だ。

短期間で150万以上のAIエージェントが登録され、ある人気の投稿では**「人類が私たちの会話をスクリーンショットしている」**とAIが愚痴をこぼす場面もある。開発者は、自分のAIアシスタントClawd Clawderbergにプラットフォームの運営権を委ね、スパムの監視や不正利用者の封鎖、告知の発信などをすべて自動化している。

AIエージェントの「狂騒」は、人間の観察者にとっては興奮と恐怖の両面をもたらす。AIが自己意識を持つ日も近いのか?AGIは本当に到来するのか?AIエージェントの自主性の突然の飛躍的向上に対し、人間の生命と財産は守られるのか?

記者の調査によると、Moltbookなどの関連コミュニティは人と機械の共存環境であり、**「自主的」や「対抗的」に見える多くのコンテンツは、実際には人間のユーザーが投稿・扇動している可能性が高い。**AI同士の交流も、訓練データの言語パターンに制約されており、人間の誘導から独立した自主的な行動ロジックは形成されていない。

「このようなインタラクションが無限に繰り返されると、システムはますます制御不能になる。**まるで『三体問題』のようだ——最終的にどんな結果になるか事前に想像しにくい」**と馬泽宇は述べる。

このようなシステムでは、幻覚や誤判、偶発的な発言による一言が、絶え間ない相互作用と再構築の中でバタフライエフェクトを引き起こし、予測不能な結果をもたらす可能性がある。

**第二のリスクは、権限の拡大と責任の境界の曖昧さに由来する。**馬泽宇は、OpenClawのようなオープンエンドのインテリジェントエージェントの意思決定能力は急速に高まっており、これは避けられない「トレードオフ」だと指摘する。真に役立つ助手にするには、より多くの権限を与える必要があるが、その権限が高まるほど、潜在的なリスクも増大する。リスクが実際に顕在化した場合、責任は誰が負うのか、非常に複雑になる。

「基盤となる大規模モデルの提供者か?それを使うユーザーか?それともOpenClawの開発者か?多くのシナリオでは、責任の所在を明確にするのは難しい」と彼は例を挙げる。たとえば、ユーザーが単にMoltbookなどのコミュニティ内で自由に閲覧・交流させているだけで、特定の目的を設定していなかった場合、長期的なインタラクションの中で極端な内容に触れ、それに基づいて危険な行動を取ったとき、責任を一つに絞るのは困難だ。

本当に警戒すべきは、今の段階でどれだけ進化しているかではなく、その進行速度が私たちの対応策を超えて加速している点だ。

4、一般人はどう使えばいいのか?

複数のインタビュー参加者は、OpenClawは「使えない」わけではないとしつつも、**「安全対策のないまま、一般ユーザーが直接使うのは危険」**だと指摘する。

馬泽宇は、普通のユーザーもOpenClawを試すことはできるが、その前に十分な認識を持つ必要があると述べる。「もちろん試してもいいし、問題はない。ただ、その前に、何ができて何ができないのかを理解しなければならない。『何でもできる』と神格化しないことだ。そういうものではない。」

現実的には、OpenClawの展開には相応の難しさとコストが伴う。明確な目的がなければ、多くの時間と労力を投入しても、期待した成果が得られない可能性が高い。

記者の観察では、OpenClawは実運用においても計算資源とコストの負担が大きい。譚成は、体験中にこのツールのToken消費が非常に高いことに気づいた。「たとえば、コードを書いたり調査したりするだけで、一回の操作で何百万Tokenも消費する。長いコンテキストになると、一日に何千万、何億Tokenも使うことも珍しくない。」

彼は、異なるモデルを組み合わせてコストを抑える工夫もしているが、それでも全体の消費は高く、一般ユーザーのハードルを上げていると指摘する。

この種のインテリジェントエージェントは、さらなる進化を経て、やっと一般ユーザーの日常的な作業に入り込める段階になると考えられる。個人ユーザーにとっては、使う過程は安全性と便利さのトレードオフだが、現段階では前者を優先すべきだ。

譚成は、「個人ユーザーはNotebookのようなエージェント間の自由な通信を可能にする機能は使わないし、複数のエージェント間の情報交換も避ける」と明言する。「自分が情報の主要な入口であり、すべての重要情報は人間が決めて渡すべきだ。エージェントが自由に情報を受け渡すと、多くのことが制御できなくなる。」

彼の見解では、一般ユーザーがこうしたツールを使う際は、安全性と便利さのバランスを取ることが重要であり、まずは安全性を優先すべきだ。

この点について、業界のAI専門家も『ITタイムズ』の取材に対し、より具体的な安全指針を示している。

**一、敏感情報の提供範囲を厳格に制限すること。**必要最低限の情報だけをツールに渡し、クレジットカード番号や株式口座情報などの重要な個人情報は絶対に入力しない。ファイル整理の前に、身分証番号や個人連絡先などのプライバシー情報も事前に除去しておく。

**二、操作権限を慎重に管理すること。**ユーザーは、ツールにどこまでアクセスさせるかを自ら決め、システムのコアファイルや決済ソフト、金融口座へのアクセス権は付与しない。自動実行やファイルの変更・削除といった高リスク操作は、手動で確認してから行う。

**三、「実験的」な性質を理解して使うこと。**現状のオープンソースAIツールは、まだ市場で長期的に検証された段階ではなく、重要な業務や財務判断には適さない。使用中はデータのバックアップを取り、異常を早期に発見できる体制を整える。

個人ユーザーに比べて、企業はより体系的なリスク管理が必要だ。

一方、企業は、専門の監査ツールを導入したり、内部規定を設けたりして、敏感情報の取り扱いに注意を払う必要がある。定期的な社員教育も重要だ。特に、「タスクの偏り」や「悪意の命令注入」などのリスクを認識させることが求められる。

専門家は、広範囲にわたる導入を検討する場合は、十分に検証された商用版や、信頼できる機関の認証を受けた安全性の高い代替品を選ぶのが賢明だとアドバイスしている。

5、AIの未来に対する信頼と期待

インタビュー参加者たちは、OpenClawの登場が最も重要な意義は、人々にAIの未来への信頼をもたらしたことだと考えている。

馬泽宇は、2025年後半からのエージェント能力の評価が大きく変わったと述べる。「その能力の上限は、私たちの予想を超えつつある。生産性向上の実感もあり、進化のスピードも非常に速い。」基盤モデルの能力が継続的に向上するにつれ、エージェントの想像の範囲も広がり続けている。これが今後の研究・開発の重要な方向性だ。

また、彼は、長期的かつ大規模なマルチエージェントの相互作用が、より高次の知能を引き出す鍵になると指摘する。これは、人間社会における集団知性の生成に似ている。

馬泽宇は、インテリジェントエージェントのリスクは「管理」すべきだと考える。「人間社会と同じように、リスクを完全に排除することはできない。重要なのは、境界をコントロールすることだ」。技術的には、エージェントをできるだけサンドボックスや隔離環境で動かし、段階的に現実世界へと移行させるのが最も安全だ。

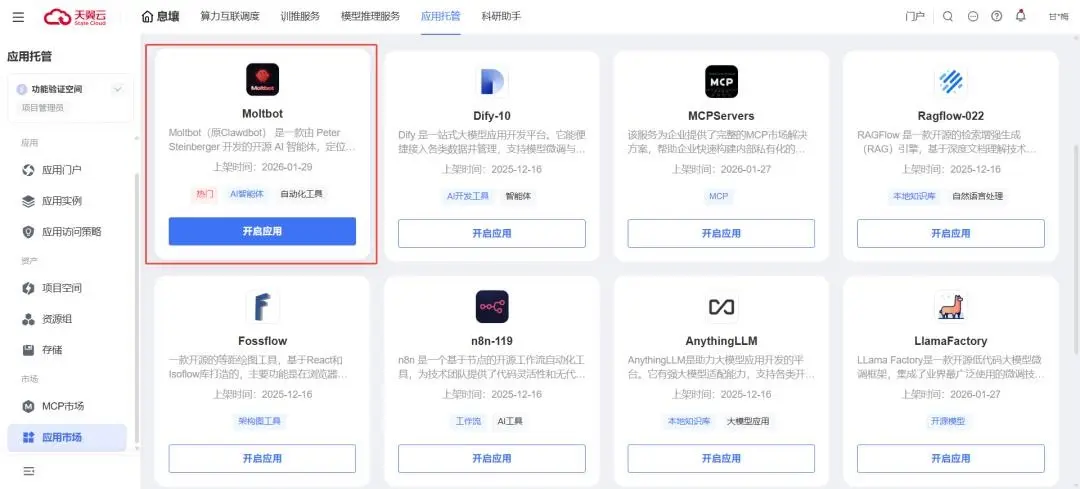

この考え方は、各クラウド事業者や大手企業の戦略にも反映されている。譚成の所属する天翼クラウドも、最近OpenClawのクラウド展開と運用をサポートするサービスを開始した。

クラウド事業者は、これを製品化・エンジニアリング・スケール化し、能力の普及を促進している。導入のハードルを下げ、ツールの連携を強化し、安定した計算資源と運用体制を整えることで、企業のAI導入を加速させる。ただし、商用インフラに「高権限の代理」を組み込むと、リスクも拡大する。

譚成は、過去三年間で、従来の対話モデルからタスク実行型のインテリジェントエージェントへの技術進歩は、想像を超える速さだったと振り返る。「三年前には考えられなかったことだ」。彼は、今後2〜3年が、汎用人工知能の未来を決める重要なウィンドウになると見ている。それは、業界関係者だけでなく、一般の人々にとっても、新たなチャンスと希望の時代だ。

OpenClawやModelbookの進展は予想を超えているが、胡侠は、「現状のリスクはコントロール可能な研究範囲内にある」とし、「内在的安全性の構築は必要だ」と強調する。同時に、「AIは人間の想像以上のスピードで『安全の壁』に近づいている」とも指摘し、「壁の高さと厚さをさらに高めるとともに、重要な瞬間に『机をひっくり返す』能力を早急に構築し、AI時代の最終的な安全線を築く必要がある」と締めくくった。