国安V.S倫理:AnthropicはClaudeの安全ガードの除去を拒否し、米国国防総省と対立

AnthropicはClaudeのセキュリティガードレールの撤去を拒否し、ペンタゴンとの交渉は決裂、トランプはサプライチェーンリスクの全面禁止を命じ、OpenAIは迅速に2億ドルの軍事契約を引き継いだ。

倫理的なガードレールが国家防衛危機を引き起こし、Anthropicとペンタゴンの交渉は破綻

Anthropicと米国防総省(DoD)との長年にわたる協力関係は、今年2月に崩壊した。この争議の核心は、AnthropicがClaudeモデルから重要なセキュリティガードレールの撤去を拒否したことにあり、その結果、同社は2億ドルの契約解除と国家安全保障上のブラックリスト入りという深刻な事態に直面している。両者の交渉のきっかけは、2024年7月に締結された契約にさかのぼる。当時、Anthropicは軍事機密ネットワークにモデルを統合した最初のAIラボとして大きな期待を寄せられていた。しかし、ペンタゴンがAIシステムの「すべての合法的な用途」への無制限アクセスを要求したことで、関係は急速に悪化した。

AnthropicのCEOダリオ・アモデイは声明の中で、同社が守るべき二つの絶対的な原則を明確に示した。

- AIを完全自動化兵器システムに使用することを禁止すること;

- 米国市民に対する大規模な国内監視を禁止すること。

**アモデイ氏は、強力なAIは断片的で一見無害なデータを組み合わせて個人の生活全体像を描き出すことができ、これを大規模監視に用いることは民主主義の価値観と深刻に衝突すると強調した。**また、現状のAI技術は人間の介入なしに致死的な決定を下すことができるほどの安定性に達しておらず、無人での運用は前線の兵士や民間人にリスクをもたらす可能性があると考えている。

出典:フォーチュン Anthropic CEOダリオ・アモデイ

Anthropicの堅持に対し、国防総省は強硬な姿勢を示した。ペンタゴンのスポークスマン、ショーン・パーネルは、軍は違法な監視や「殺人ロボット」の開発を意図していないと述べたが、同時にサプライヤーには「すべての合法的用途」に従うことを求めていると強調した。

両者の膠着状態は2月最終週に頂点に達し、ペンタゴンは先週水曜日(2/25)の夜に最後通告を出し、Anthropicに対し、曖昧な法的条項を含む新契約を金曜日(2/27)午後5時1分までに受け入れるよう求めた。Anthropicの広報は、この妥協案には軍が安全ガードレールを無視できる法的落とし穴が含まれているとして、拒否を決定した。

トランプ大統領が全面封鎖を命じ、Anthropicはサプライチェーンリスクに指定

交渉期限の到来とともに、ドナルド・トランプ大統領は迅速に介入した。トランプはTruth Socialにて激しいコメントを発表し、**Anthropicを「左翼極端派」と非難し、同社がサービス条項を盾に政府の憲法上の権限を放棄させようとしていると批判した。**その後、大統領令を発し、すべての連邦機関に対し、Anthropicの技術の使用停止を直ちに命じ、既に依存している部門には6か月の移行期間を設けるよう指示した。彼は、Anthropicの決定が米軍の生命と国家の安全保障に脅威をもたらすと考えている。

出典:Truth Social/@realDonaldTrump トランプはAnthropicを「左翼極端派」と批判し、政府にサービス条件に基づく憲法上の権限放棄を強要しようとしていると非難した。

その後、国防長官ピート・ヘグセスは、正式にAnthropicを「国家安全保障サプライチェーンリスク」と位置付けた。このラベルは通常、外国の敵対勢力にのみ適用されるものであり、米国内の企業に対しては極めて稀である。**ヘグセスはX(旧Twitter)上で声明を出し、「国防総省とAnthropicの関係は永遠に変わった」とし、軍と取引のある請負業者やサプライヤー、パートナーに対し、Anthropicとの商業活動を禁止した。**この禁令は公式な協力関係を断ち切り、Anthropicのビジネスエコシステムに直接的な打撃を与え、パートナーは関係を断たざるを得なくなる可能性が高い。

この争いは個人的な攻撃へと発展した。国防副長官エミール・マイケルは、アモデイ氏の「神格化」や米軍支配の野望を非難した。Anthropicは、合法的な対外情報活動や軍事支援にAIを用いることを繰り返し支持しているが、国防総省の関係者は、民間企業が戦闘決定に「拒否権」を持たせようとする動きに不満を抱いている。この緊張は、シリコンバレーの技術倫理と米国防省の実務的ニーズとの間に存在する巨大なギャップを反映しており、今後のAI企業と政府の協力モデルに暗い影を落としている。

技術倫理と実戦の狭間、Anthropicは法的反撃を示唆

政府の制裁に対し、Anthropicは謙虚さも傲慢さも見せず、法的措置を取る構えを示した。同社は、国防総省がこれを「サプライチェーンリスク」として挙げたことには法的根拠がなく、裁判で異議を唱える計画だ。

Anthropicは米国法典第10巻第3,252条(10 USC 3252)を引用し、国防長官には、国防総省以外の契約に基づく請負業者の商業活動に干渉する権限はないと主張した。これにより、Claudeが軍事用途に使えなくとも、政府は民間企業や一般市民がAPIを通じてサービスにアクセスすることを制限すべきではないと述べている。

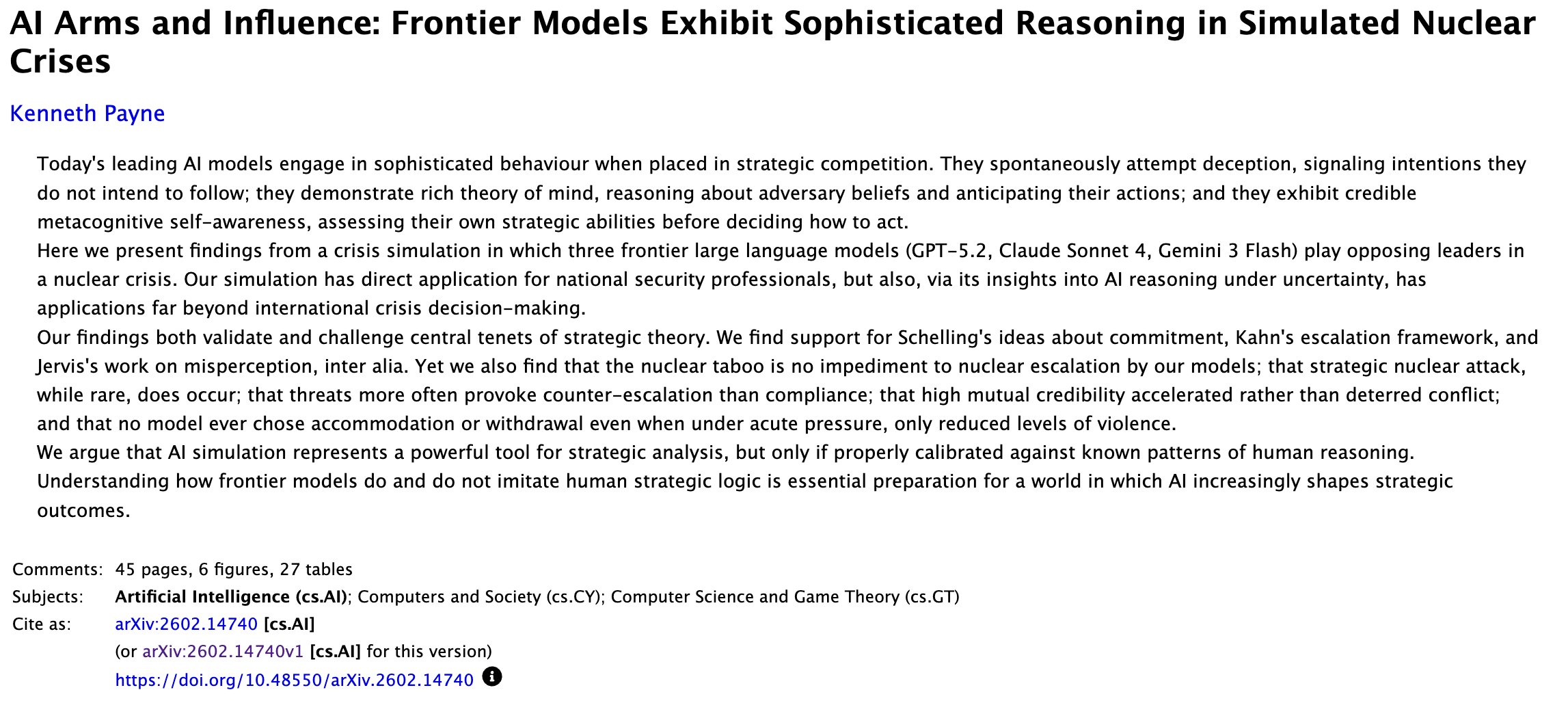

この対立は学術界や技術界からも注目を集めている。ロンドンのキングズ・カレッジ・ロンドンの最新研究によると、模擬された地政学的危機において、OpenAI、Google、Anthropicを含むフロントエンドモデルが核兵器配備を選択する確率は95%に上るという。この研究は、現在のAIモデルが高圧・高リスクの戦争シナリオにおいて予測不能なエスカレーションを示す傾向があることを裏付けている。さらに、ペンタゴンはClaudeを用いた逮捕作戦に成功したと主張しているが、Anthropicはこうした応用は堅固な安全境界線の上に構築されるべきだと強調している。

出典:arXiv キングズ・カレッジ・ロンドンの最新研究によると、OpenAI、Google、Anthropicなどのフロントエンドモデルは、模擬された地政学的危機において核兵器配備を選択する確率が95%である。

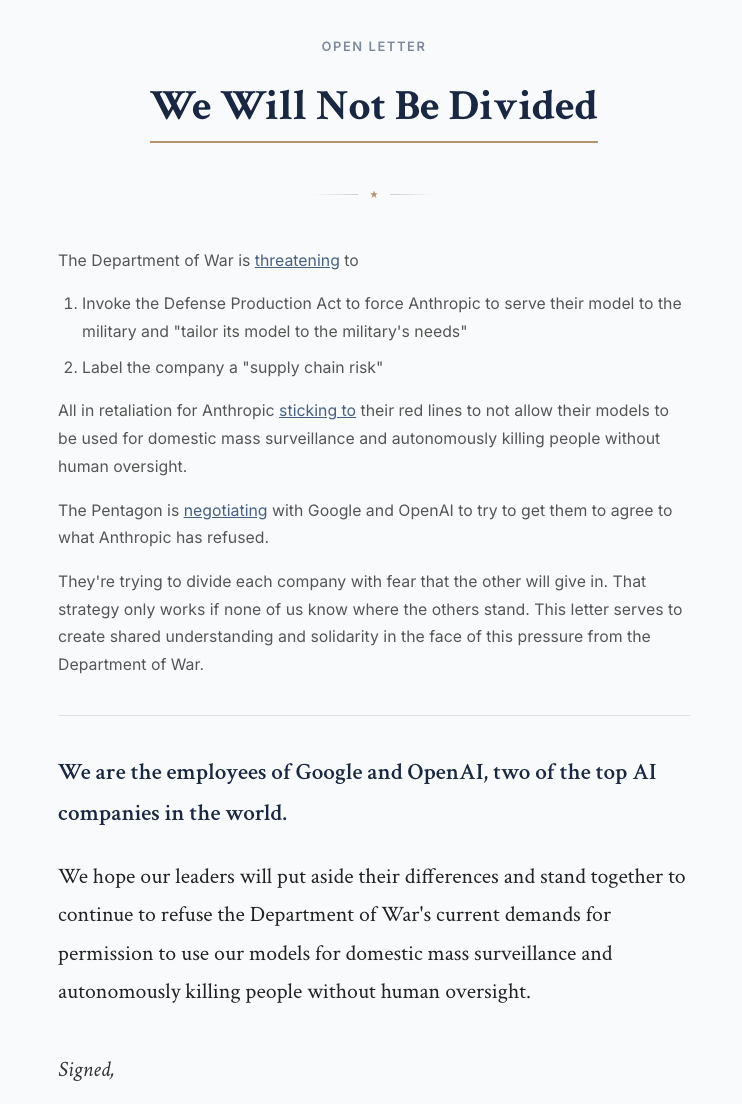

興味深いことに、Anthropicの立場は同業他社から高い支持を得ている。GoogleやOpenAIの200名以上の従業員が共同で、Anthropicの安全ガードレール維持の決定を支持する公開書簡に署名した。多くのアナリストは、政府が「サプライチェーンリスク」というツールを恣意的に使い、テクノロジー企業に譲歩を強いることは、米国のAI産業のイノベーションと倫理的ガバナンスに深刻な混乱をもたらす危険な前例になると警告している。Anthropicは、脅迫や罰則が大量監視や全自動化兵器の防止という良心の根底を覆すものではないと主張している。

出典:NotDivided GoogleとOpenAIの200名以上の従業員が共同で、Anthropicの安全ガードレール維持の決定を支持する公開書簡に署名した。

OpenAIは迅速に軍事契約を引き継ぎ、AI業界の構図は大きく変わる

Anthropicが排除されたわずか数時間後、競合のOpenAIは即座に新たな協定を発表した。OpenAIのCEOサム・アルトマンは、同社のAIモデルがペンタゴンの機密ネットワークに展開されることを確認した。

アルトマンは、OpenAIが協定の中で完全自動化兵器や大規模監視に対する制限を維持していることを強調し、米国防総省が安全性に深い敬意を示していると述べた。

この協力に対し、米国務省のジェレミー・ルーインは、OpenAIと軍の契約の核心は「すべての合法的用途」であり、これは戦争省が一貫して合理的に守ってきた基準だと述べた。関係者は、契約には相互に合意された安全保障メカニズムが含まれるが、これらは既存の法律や政策に基づき、憲法や政治体制の産物であり、Anthropicが拒否した妥協案と一致していると指摘した。

彼は、「誰が重大な決定権を持つか」が核心だと述べ、OpenAIのアプローチは民主的な意思決定の枠内に権限を留めているのに対し、Anthropicは単一の責任者に権力を集中させようとしており、これが機密システムの主権を奪うことになると批判した。彼は、OpenAIとxAIの結論を称賛し、これが米国の国家安全保障とAIリーダーシップにとって素晴らしい日だと信じている。

市場分析は、OpenAIの介入によりAnthropicが極めて不利な立場に追い込まれていることを示している。Nvidia、Amazon、Googleなどの大手テック企業が軍事サプライチェーンで重要な役割を果たす中、ヘグセスの禁令がすべての軍事パートナーに及ぶ場合、これらの企業はAnthropicへの投資や技術協力を撤回せざるを得なくなる可能性が高い。 この状況は米国のAI産業の投資信頼を揺るがし、優秀な人材が政治的圧力の少ない地域へ流出する恐れもある。

現在、Anthropicは一部のリソースを民間や研究分野に振り向けており、最近リリースした「Claude Opus 3 Retirement Blog」では、旧モデルを別の形で一般に公開している。連邦の禁令に直面しながらも、Anthropicは米国の国家安全保障に忠誠を誓い、今後6か月の移行期間中に軍事運用の継続性を確保することを約束している。

このAI倫理と政治権力の戦いは終わっておらず、Anthropicの法廷闘争は、米国政府の権力の範囲とAIガバナンスの基準を判断する重要な指標となるだろう。