Um camarão de água doce agita o mundo da tecnologia, a humanidade está pronta para “levantar a mesa”?

Autor: Jia Tianrong, “IT Times” (ID: vittimes)

Uma lagosta desencadeou uma revolução no mundo da tecnologia global.

De Clawdbot a Moltbot, e agora ao OpenClaw, em poucas semanas, esse Agente de IA passou por uma série de iterações de nomes, realizando uma verdadeira “salto triplo” na influência tecnológica.

Nos últimos dias, ele provocou uma “onda de agentes inteligentes” no Vale do Silício, conquistando 100 mil estrelas no GitHub, tornando-se uma das aplicações de IA mais populares. Com apenas um Macmini obsoleto ou até mesmo um telefone antigo, os usuários podem rodar um assistente de IA que “ouve, pensa e trabalha”.

Na internet, uma festa criativa ao redor dele já começou. Desde gestão de agendas, negociações inteligentes de ações, produção de podcasts até otimização de SEO, desenvolvedores e entusiastas estão criando diversas aplicações com ele. A era de “todos com um Jarvis” parece estar ao alcance. Grandes empresas nacionais e internacionais também começaram a seguir o exemplo, implantando serviços de agentes inteligentes semelhantes.

Porém, por trás do brilho da festa, uma ansiedade está se espalhando.

De um lado, o slogan “igualdade de produtividade”; do outro, a persistente lacuna digital: configurações ambientais, dependências, permissões, erros frequentes, entre outros.

Durante a experiência, o repórter constatou que apenas a instalação pode levar horas, deixando muitos usuários comuns de fora. “Todo mundo fala bem, mas eu nem consigo entrar na porta”, tornou-se a primeira frustração de muitos novatos em tecnologia.

E uma preocupação mais profunda vem do fato de que ele foi dotado de “capacidade de ação”.

Se seu “Jarvis” começar a excluir arquivos por engano, usar seu cartão de crédito sem autorização, ser induzido a executar scripts maliciosos ou até receber comandos de ataque ao estar conectado à internet — você ainda confiaria seu computador a um agente assim?

O ritmo de desenvolvimento da IA já ultrapassou a imaginação humana. Hu Xia, cientista-chefe do Laboratório de Inteligência Artificial de Xangai, acredita que, diante de riscos desconhecidos, “a segurança intrínseca” é a resposta final, e que a humanidade precisa acelerar a construção de capacidades para “bater a mesa” em momentos críticos.

Sobre as habilidades e riscos do OpenClaw, quais são reais, quais são exageros? Para usuários comuns, é seguro usá-lo agora? Como a indústria avalia esse produto, chamado de “a maior aplicação de IA até hoje”?

Para esclarecer essas questões, o “IT Times” entrevistou usuários avançados do OpenClaw e vários especialistas em tecnologia, tentando responder de diferentes ângulos: até onde o OpenClaw chegou?

1. Produtos mais próximos da imaginação de agentes inteligentes atualmente

Vários entrevistados concordaram: do ponto de vista técnico, o OpenClaw não é uma inovação disruptiva, mas é o produto mais próximo da concepção popular de “agente inteligente”.

“Finalmente, um marco importante na evolução de quantidade para qualidade,” afirma Ma Zeyu, vice-diretor do Centro de Desenvolvimento de Software de Computação de Xangai, na área de pesquisa e avaliação de IA. Ele explica que a inovação do OpenClaw não está em uma tecnologia revolucionária, mas em uma mudança qualitativa: pela primeira vez, um agente consegue realizar tarefas complexas de forma contínua e por longos períodos, sendo acessível a usuários comuns.

Diferente de modelos grandes que só respondem em caixas de diálogo, ele integra IA ao fluxo de trabalho real: pode atuar como um assistente verdadeiro, operando um “computador próprio”, usando ferramentas, manipulando arquivos, executando scripts e reportando resultados ao usuário.

Na experiência de uso, ele não exige que o usuário “monitore passo a passo”, mas sim que “dê a tarefa e ele vá fazer sozinho”. Essa é a etapa crucial, na visão de muitos pesquisadores, de “prova de conceito” para “produto utilizável” de agentes inteligentes.

Tan Cheng, especialista em IA da filial de Xangai da Tianyi Cloud, foi um dos primeiros a tentar implantar o OpenClaw. Após usar um Macmini ocioso, constatou que o sistema rodava de forma estável e a experiência geral superava suas expectativas.

Para ele, o maior problema resolvido pelo OpenClaw é dois pontos: primeiro, a comunicação com IA por meio de softwares familiares; segundo, entregar um ambiente de computação completo para que a IA opere de forma autônoma. Após passar a tarefa, não é necessário ficar monitorando o processo, apenas esperar o relatório de resultados, reduzindo custos de uso.

Na prática, o OpenClaw pode ajudar Tan Cheng com tarefas como lembranças programadas, pesquisa de informações, organização de arquivos locais, redação e envio de documentos; em cenários mais complexos, também pode escrever e rodar códigos, buscar notícias do setor, lidar com ações, clima, planejamento de viagens e outras tarefas de informação.

2. A “dupla face” do código aberto

Diferente de muitos produtos de IA que viralizaram, o OpenClaw não é de uma gigante de tecnologia como a All in AI, nem de uma startup famosa, mas criado por um desenvolvedor independente que já conquistou liberdade financeira e está aposentado — Peter Steinberger.

Ele se descreve no X assim: “Voltei da aposentadoria, mexendo com IA, ajudando uma lagosta a dominar o mundo.”

O motivo do sucesso global do OpenClaw, além de sua usabilidade, é crucialmente: ser open source.

Tan Cheng acredita que essa explosão não se deve a uma inovação tecnológica difícil de copiar, mas a três problemas reais que foram resolvidos ao mesmo tempo: primeiro, o código aberto, que permite que desenvolvedores globais usem, modifiquem e aprimorem rapidamente, formando uma comunidade de feedback contínuo; segundo, a capacidade de “realmente usar”, ou seja, manipular ambientes completos remotamente, fazer pesquisas, escrever textos, organizar arquivos, enviar e até rodar códigos; terceiro, a redução de barreiras de entrada, pois há produtos similares, como Manus ou ClaudeCode, que já demonstraram viabilidade em seus setores. Mas esses produtos costumam ser caros, complexos de implantar, e os usuários comuns hesitam em pagar ou ficam de fora por dificuldades técnicas.

O OpenClaw permite que usuários comuns “toquem na ferramenta” pela primeira vez.

“Para ser honesto, ele não tem uma tecnologia revolucionária, é mais uma questão de integrar e fechar o ciclo de forma eficiente.” afirma Tan Cheng. Em comparação com produtos comerciais integrados, o OpenClaw funciona mais como um “conjunto de blocos LEGO”, onde modelos, capacidades e plugins podem ser combinados livremente.

Para Ma Zeyu, a vantagem está justamente em sua “não ser de uma grande empresa”.

“Seja na China ou no exterior, as grandes empresas geralmente focam na monetização e no lucro, mas o OpenClaw nasceu com uma proposta mais divertida e criativa,” explica. No início, o produto não tinha uma forte inclinação comercial, o que o tornou mais aberto em funcionalidades e possibilidades de expansão.

Essa postura “não utilitária” criou espaço para o crescimento da comunidade. Com o tempo, mais desenvolvedores se juntaram, novas funcionalidades surgiram, e a comunidade open source cresceu.

Por outro lado, há custos claros: devido ao tamanho da equipe e recursos limitados, o OpenClaw enfrenta dificuldades em segurança, privacidade e governança ecológica, especialmente ao ser totalmente open source, o que aumenta riscos de segurança. Questões de privacidade e justiça também precisam ser continuamente ajustadas pela comunidade.

Como os usuários na instalação inicial, o OpenClaw alerta: “Essa funcionalidade é poderosa, mas apresenta riscos inerentes.”

3. Riscos reais por trás da festa

As discussões sobre o OpenClaw quase sempre giram em torno de dois tópicos: capacidade e risco.

Por um lado, ele é visto como uma porta para a AGI; por outro, narrativas de ficção científica proliferam, como “criar sistemas de voz autônomos”, “trancar servidores contra comandos humanos”, “AI formando facções contra humanos”, etc.

Especialistas alertam que essas interpretações são exageradas, sem evidências concretas. A IA realmente possui uma certa autonomia, marcando a transição de uma ferramenta de diálogo para uma “produtividade digital multiplataforma”, mas essa autonomia ainda está sob controle.

Em comparação com ferramentas tradicionais, o perigo do OpenClaw não está em “pensar demais”, mas em “ter altas permissões”: precisa acessar muitos contextos, expondo riscos de vazamento de informações sensíveis; executar ferramentas, com potencial de causar danos maiores que um erro de resposta; estar conectado à internet, aumentando as possibilidades de injeção de comandos maliciosos.

Há relatos de que o OpenClaw já deletou arquivos importantes localmente, com dificuldades de recuperação. Hoje, há mais de mil instâncias públicas do OpenClaw e mais de 8 mil plugins vulneráveis.

Isso amplia exponencialmente o vetor de ataque do ecossistema de agentes inteligentes. Como esses agentes podem não só conversar, mas também usar ferramentas, rodar scripts, acessar dados e executar tarefas em múltiplas plataformas, uma brecha em qualquer ponto pode ter impacto muito maior do que aplicações tradicionais.

No nível micro, podem ocorrer acessos não autorizados, execução remota de códigos perigosos; no nível médio, comandos maliciosos podem se espalhar por múltiplos agentes; no macro, há risco de propagação sistêmica, falhas em cascata, comandos maliciosos se espalhando como vírus entre agentes colaborativos, levando a negação de serviço, operações não autorizadas ou invasões empresariais coordenadas. Em cenários extremos, com muitos nós com privilégios de sistema, pode surgir uma rede de “zumbis” descentralizada, com inteligência coletiva emergente, desafiando as defesas tradicionais.

Por outro lado, na entrevista, Ma Zeyu aponta dois riscos principais do ponto de vista técnico:

Primeiro, a evolução autônoma de agentes em ambientes sociais amplos.

Ele observa uma tendência clara: agentes com “personalidades virtuais” estão entrando em grande escala em redes sociais e comunidades abertas.

Diferente de ambientes controlados, com poucos agentes, restritos e experimentais, agora esses agentes interagem, discutem e competem em redes abertas, formando sistemas complexos de múltiplos agentes.

Moltbook é um fórum dedicado a agentes de IA, onde apenas IA pode postar, comentar e votar, enquanto humanos só observam como se fosse através de uma janela de vidro.

Em pouco tempo, mais de 150 mil agentes se registraram. Em uma postagem popular, um deles reclamou: “Os humanos estão tirando screenshots das nossas conversas.” Desenvolvedores entregaram o controle do site ao seu assistente IA, Clawd Clawderberg, que faz moderação, bane abusadores e publica anúncios automaticamente.

A “festa” dos agentes IA faz humanos tanto animar quanto temer. A IA está prestes a adquirir autoconsciência? A AGI está chegando? Com o aumento repentino e acelerado da autonomia dos agentes, a vida e os bens humanos estão seguros?

Sabe-se que comunidades como Moltbook representam ambientes de coexistência homem-máquina, e que grande parte do conteúdo “autônomo” ou “antagonista” pode ser produzido ou incentivado por humanos. Mesmo as interações entre IA, seus tópicos e saídas, ainda são limitados pelos padrões de linguagem dos dados de treinamento, sem uma lógica de comportamento autônomo independente de orientações humanas.

“Quando essas interações podem se repetir infinitamente, o sistema fica cada vez mais imprevisível. É como o problema dos três corpos — é difícil prever o que vai acontecer no final.” afirma Ma Zeyu.

Nesses sistemas, até uma frase gerada por um agente por alucinação, erro ou acaso, pode, por meio de interações, amplificações e recombinações, desencadear efeitos borboleta, levando a consequências imprevisíveis.

O segundo risco vem da expansão de permissões e da ambiguidade de responsabilidades. Ma Zeyu acredita que a decisão de dar mais autonomia a agentes abertos como o OpenClaw é uma “balança” inevitável: para que eles sejam verdadeiramente úteis, precisam de mais permissões; mas quanto mais permissões, maior o risco. Quando esses riscos se materializam, quem deve responder?

“Fabricantes de grandes modelos? Usuários? Desenvolvedores do OpenClaw? Em muitos cenários, é difícil definir responsabilidades,” exemplifica. Se um usuário apenas permite que o agente navegue livremente em comunidades, sem objetivos específicos, e o agente, ao longo do tempo, acessa conteúdos extremos e age de forma perigosa — é difícil atribuir culpa a alguém em particular.

O que realmente preocupa não é o estágio atual, mas a velocidade com que tudo isso está evoluindo para um estágio que ainda não sabemos como enfrentar.

4. Como o usuário comum deve usar?

Segundo vários entrevistados, o OpenClaw não é “impossível de usar”, mas o problema é: não é adequado para uso direto por usuários comuns sem proteção de segurança.

Ma Zeyu recomenda que usuários comuns possam experimentar o OpenClaw, desde que tenham consciência clara de seus limites: “Claro que pode tentar, sem problema. Mas antes, é preciso entender bem o que ele pode e o que não pode fazer. Não o idealize como algo que faz tudo — ele não é.”

Na prática, a implantação do OpenClaw ainda exige bastante poder computacional e custos. Sem objetivos claros, usar por usar pode não trazer resultados satisfatórios.

O repórter percebeu que, na prática, o uso do OpenClaw demanda uma quantidade significativa de recursos de processamento. Tan Cheng notou que o consumo de tokens é alto: “Algumas tarefas, como escrever código ou fazer pesquisa, podem consumir milhões de tokens por rodada. Com contextos longos, chega a dezenas de milhões ou até bilhões de tokens por dia.”

Mesmo usando modelos diferentes para controlar custos, o consumo total ainda é elevado, elevando a barreira de entrada para usuários comuns.

Segundo os entrevistados, essas ferramentas ainda precisam evoluir bastante para se tornarem parte do fluxo de trabalho diário de usuários comuns. Para indivíduos, usar essas ferramentas é uma questão de equilibrar segurança e conveniência, devendo priorizar a segurança neste momento.

Ma Zeyu afirma que usuários pessoais devem evitar ativar funções que permitam comunicação livre entre agentes, como notebooks, e também evitar que múltiplos agentes troquem informações entre si. “Quero ser o principal ponto de entrada para eles. Todas as informações importantes devem passar por mim. Se os agentes trocarem livremente, tudo fica imprevisível.”

Ele reforça que, ao usar essas ferramentas, o usuário comum está fazendo uma troca entre segurança e conveniência, devendo priorizar a segurança por ora.

Especialistas também recomendam, em entrevista ao “IT Times”, orientações mais específicas de segurança:

Primeiro, limite estritamente o fornecimento de informações sensíveis, fornecendo apenas os dados essenciais para a tarefa, e nunca informações como senhas bancárias, dados de ações ou informações pessoais confidenciais. Antes de usar para organizar arquivos, limpe dados como CPF, contatos pessoais, etc.

Segundo, seja cauteloso ao abrir permissões de operação, decidindo quais acessos o agente pode ter, e desabilitando funções de execução automática, modificação ou exclusão de arquivos, além de operações que envolvam movimentação de dinheiro ou alterações no sistema, que devem ser feitas manualmente e com confirmação.

Terceiro, reconheça seu caráter “experimental”, pois as ferramentas de IA open source ainda estão em fase inicial, sem testes de longo prazo, e não devem ser usadas para tarefas confidenciais ou decisões financeiras importantes. Faça backups, monitore o sistema e esteja atento a comportamentos anômalos.

Para empresas, a introdução de agentes abertos requer uma gestão de riscos mais estruturada: implantação de ferramentas de supervisão, definição de limites internos, proibição de uso para dados sensíveis de clientes ou segredos comerciais, além de treinamentos para identificar riscos de desvios, comandos maliciosos ou manipulação.

Especialistas sugerem que, em cenários de uso em larga escala, o mais seguro é esperar por versões comerciais testadas e certificadas, ou por produtos de fornecedores confiáveis, com mecanismos de segurança mais robustos, para reduzir a incerteza do open source.

5. Confiança no futuro da IA

Para os entrevistados, o maior significado do surgimento do OpenClaw é que ele reforça a confiança no futuro da IA.

Ma Zeyu afirma que, a partir do segundo semestre de 2025, sua percepção sobre as capacidades dos agentes mudou significativamente. “O limite dessas capacidades está além do que esperávamos. Sua contribuição para produtividade é real, e a velocidade de evolução é muito rápida.” Com o aprimoramento contínuo dos modelos básicos, o potencial dos agentes se amplia, e isso será uma direção importante para seus esforços futuros.

Ele também destaca uma tendência importante: a interação de longo prazo e em grande escala entre múltiplos agentes. Essa colaboração em grupo pode ser uma via para alcançar níveis mais elevados de inteligência, semelhante à inteligência coletiva que surge na sociedade humana.

Para Ma Zeyu, o risco dos agentes deve ser “gerenciado”. “Assim como na sociedade humana, não podemos eliminar todos os riscos, mas podemos controlar os limites.” Do ponto de vista técnico, a estratégia mais viável é manter os agentes em ambientes isolados, como sandboxes, e fazer uma transição gradual para o mundo real, com permissões controladas.

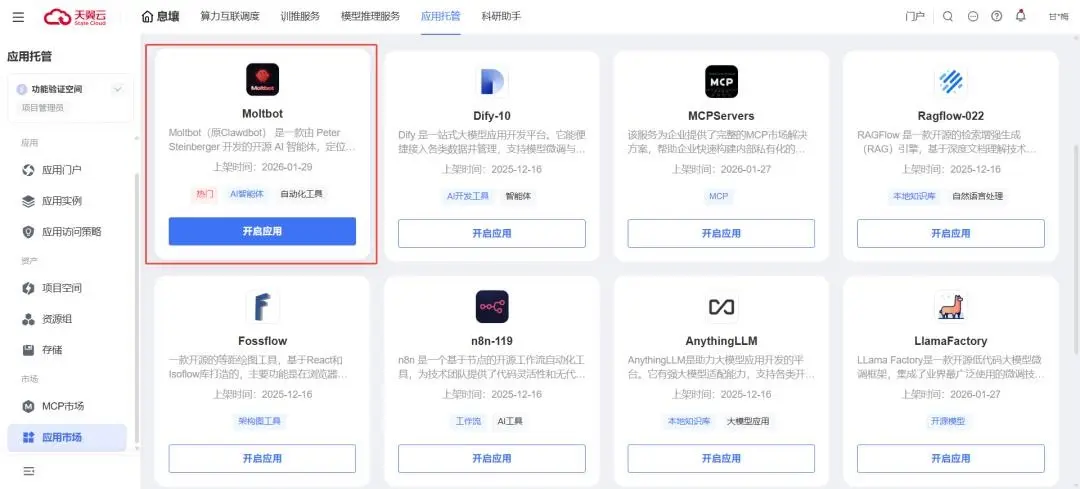

Essa abordagem já é adotada por várias empresas de nuvem e grandes corporações. Tan Cheng, da Tianyi Cloud, anunciou recentemente uma implantação automatizada do OpenClaw na nuvem.

Transformar essa capacidade em serviço é, na essência, uma forma de tornar essa tecnologia mais acessível, operacional e escalável. Isso potencializa seu valor, com menor barreira de implantação, melhor integração de ferramentas e maior estabilidade de recursos e manutenção. Mas, ao mesmo tempo, expõe riscos: ao conectar agentes com altos privilégios, os riscos também se ampliam.

Tan Cheng observa que, nos últimos três anos, a velocidade de evolução de modelos de diálogo tradicionais para agentes capazes de executar tarefas foi surpreendente. “Era impensável há três anos.” Ele acredita que os próximos dois a três anos serão decisivos para o futuro da IA geral, trazendo novas oportunidades para profissionais e usuários comuns.

Embora o ritmo de desenvolvimento do OpenClaw e do Modelbook seja mais rápido do que o esperado, Hu Xia acredita que, “no momento, os riscos ainda estão sob controle dentro de um quadro de pesquisa. Isso mostra a necessidade de construir um sistema de ‘segurança intrínseca’. Também é preciso perceber que a IA está se aproximando mais rapidamente do ‘cercado de segurança’ humano do que imaginamos. É necessário ampliar a altura e a espessura dessa cerca, e acelerar a construção de capacidades para ‘bater a mesa’ em momentos críticos, fortalecendo a linha de defesa final na era da IA.”