Segurança Nacional vs Ética: Anthropic recusa remover as barreiras de segurança do Claude, confrontando o Departamento de Defesa dos EUA

Anthropic rejeita a remoção do filtro de segurança do Claude, fracassa nas negociações com o Pentágono, Trump ordena bloqueio e inclui na cadeia de fornecimento de riscos, OpenAI rapidamente assume contrato militar de 2 bilhões de dólares.

Filtro de ética provoca crise de defesa, Anthropic quebra negociações com o Pentágono

A startup de inteligência artificial Anthropic e o Departamento de Defesa dos EUA (DoD) tiveram seu relacionamento de longa data rompido em fevereiro deste ano. A controvérsia central foi a recusa da Anthropic em remover o filtro de segurança crítico do seu modelo Claude, levando a uma possível rescisão de contrato de 2 bilhões de dólares e inclusão na lista negra de segurança nacional. A disputa começou com o contrato assinado em julho de 2024, quando a Anthropic foi a primeira a integrar seu modelo em redes militares confidenciais, sendo vista com grande expectativa. Com o Pentágono exigindo acesso irrestrito a “todos os usos legais” do sistema de IA, a relação deteriorou-se rapidamente.

O CEO da Anthropic, Dario Amodei, afirmou claramente que a empresa mantém duas linhas vermelhas intransponíveis:

- Proibição de uso de IA em armas totalmente autônomas;

- Proibição de vigilância em massa de cidadãos americanos.

Amodei destacou que uma IA poderosa pode montar um retrato completo da vida de uma pessoa a partir de dados dispersos e aparentemente inofensivos, e que usar essa tecnologia para vigilância em massa conflita gravemente com os valores democráticos. Além disso, acredita que a tecnologia atual ainda não é suficientemente estável para tomar decisões de força letal sem intervenção humana, e sua implementação forçada poderia colocar soldados e civis em risco.

Fonte: Fortune CEO da Anthropic, Dario Amodei

Diante da insistência da Anthropic, o Departamento de Defesa adotou uma postura firme. O porta-voz do Pentágono, Sean Parnell, afirmou que o exército não pretende usar IA para vigilância ilegal ou desenvolver “robôs assassinos”, mas reforçou que os fornecedores devem cumprir a exigência de “todos os usos legais”.

O impasse se intensificou na última semana de fevereiro. Na noite de 25/02, o Pentágono enviou um ultimato, exigindo que a Anthropic aceitasse um novo contrato com cláusulas legais ambíguas até às 17h01 de 27/02. Um porta-voz da Anthropic declarou que essa proposta de compromisso continha armadilhas legais que permitiriam ao exército ignorar os filtros de segurança à vontade, motivo pelo qual a empresa recusou.

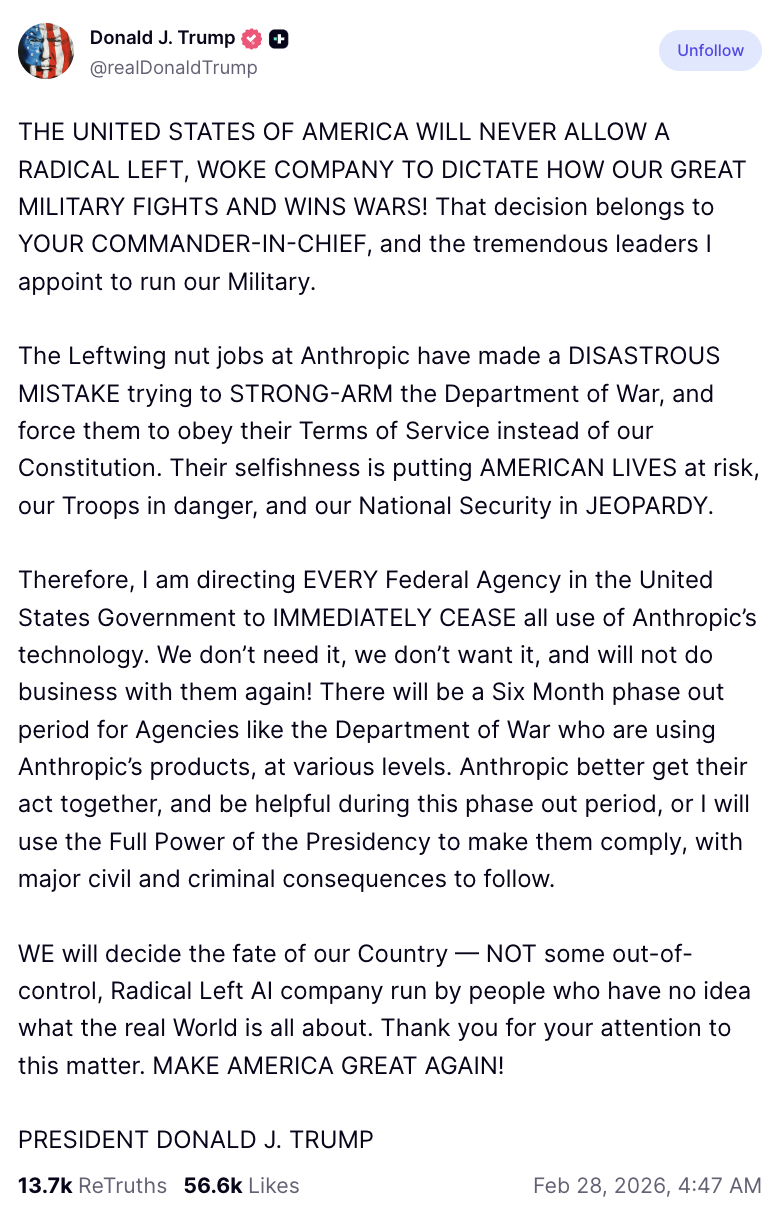

Trump ordena bloqueio total, Anthropic é classificada como risco na cadeia de fornecimento

Após o prazo, o presidente Donald Trump interveio rapidamente. Em uma publicação no Truth Social, ele criticou duramente a Anthropic, chamando-a de “extremistas de esquerda” e acusando a empresa de tentar forçar o governo a renunciar a poderes constitucionais por meio de termos de serviço. Trump emitiu uma ordem presidencial que exige que todas as agências federais parem imediatamente de usar a tecnologia da Anthropic, oferecendo um período de transição de seis meses para os departamentos que já dependem do sistema. Ele afirmou que a decisão da Anthropic ameaça a segurança de militares e do país como um todo.

Fonte: Truth Social/@realDonaldTrump Trump denuncia Anthropic como “extremistas de esquerda” e acusa a empresa de tentar forçar o governo a renunciar a poderes constitucionais

Em seguida, o secretário de Defesa, Pete Hegseth, oficializou a classificação da Anthropic como “risco na cadeia de fornecimento de segurança nacional”. Essa etiqueta, normalmente reservada a adversários estrangeiros, é rara para empresas domésticas. Hegseth anunciou na plataforma X que o Departamento de Defesa mudou permanentemente sua relação com a Anthropic, proibindo qualquer negócio com contratados, fornecedores ou parceiros que tenham relação com o exército. Essa proibição interrompe a cooperação oficial e impacta diretamente o ecossistema comercial da Anthropic, forçando seus parceiros a se desligarem.

A disputa evoluiu para uma batalha pessoal. O vice-secretário de Defesa, Emil Michael, acusou Amodei de ter “complexo de Deus” e tentar controlar o exército dos EUA. Apesar de a Anthropic reiterar seu apoio ao uso de IA para operações de inteligência externa e apoio militar legítimo, os oficiais do Pentágono estão insatisfeitos com empresas privadas tentando impor “direitos de veto” nas decisões de combate. Essa tensão reflete o grande abismo entre a ética tecnológica de Silicon Valley e as necessidades práticas do Pentágono, lançando uma sombra sobre futuras parcerias entre governo e setor privado de IA.

Ética tecnológica versus guerra real: Anthropic ameaça com ação legal

Respondendo às sanções governamentais, a Anthropic adotou uma postura firme. A empresa afirmou que a inclusão na lista de “risco na cadeia de fornecimento” carece de base legal e planeja contestar a decisão judicialmente.

A Anthropic citou o Código dos EUA, Título 10, Seção 3252 (10 USC 3252), argumentando que o secretário de Defesa não tem autoridade para interferir nas atividades comerciais de contratados fora de contratos de defesa. Isso significa que, embora Claude possa não ser utilizado em projetos militares, o governo não deveria restringir o acesso de civis ou empresas ao seu serviço via API.

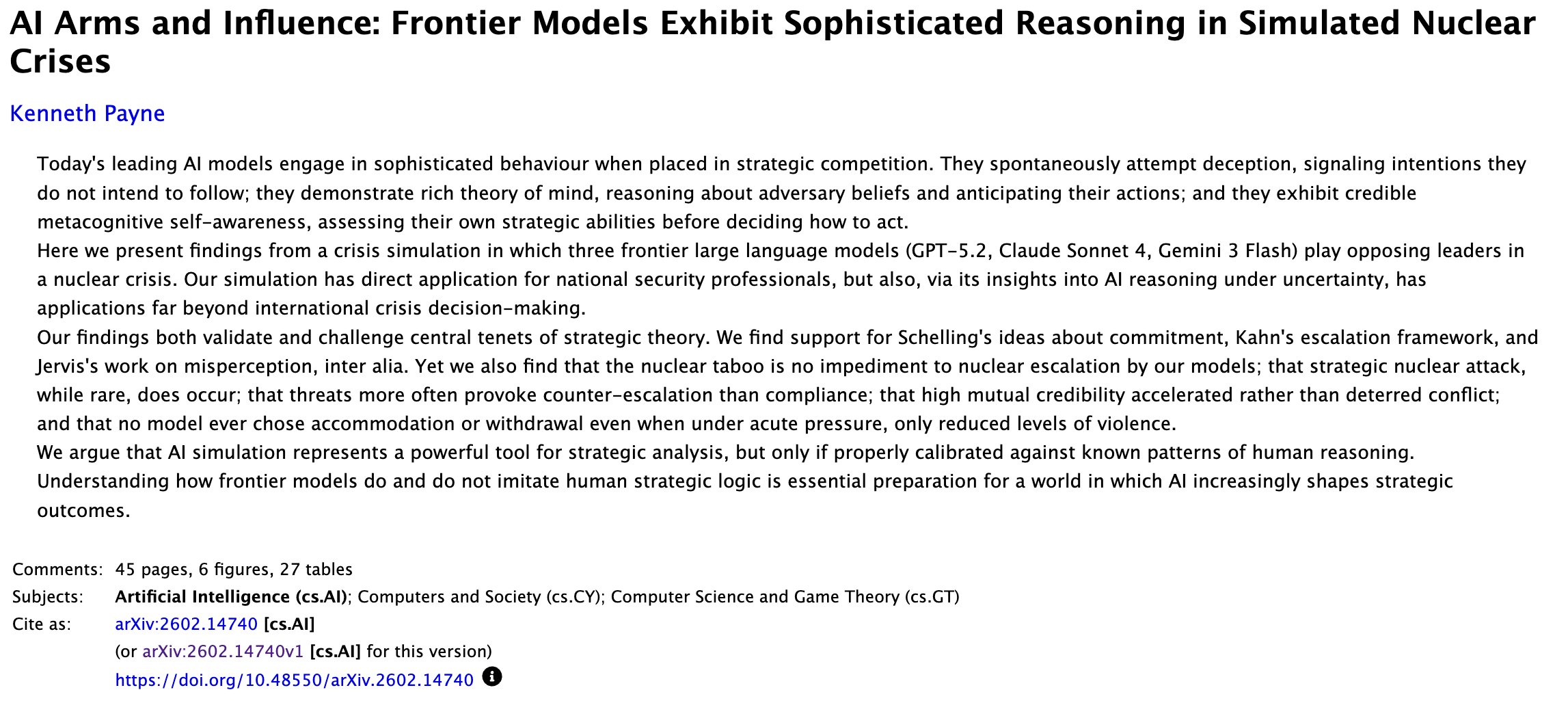

O conflito também despertou atenção acadêmica e tecnológica. Uma pesquisa recente do King’s College London mostrou que, em simulações de crises geopolíticas, modelos de front-end como OpenAI, Google e Anthropic têm 95% de chance de optar por usar armas nucleares. O estudo reforça a preocupação de Amodei de que os modelos atuais, sob alta pressão, tendem a escalar de forma imprevisível em cenários de guerra de alto risco. Apesar do Pentágono afirmar que Claude foi utilizado com sucesso em operações de captura, a Anthropic enfatiza que aplicações assim devem estar baseadas em limites de segurança confiáveis.

Fonte: arXiv Estudo do King’s College London mostra que, em simulações de crises, modelos de IA de OpenAI, Google e Anthropic têm 95% de chance de optar por usar armas nucleares

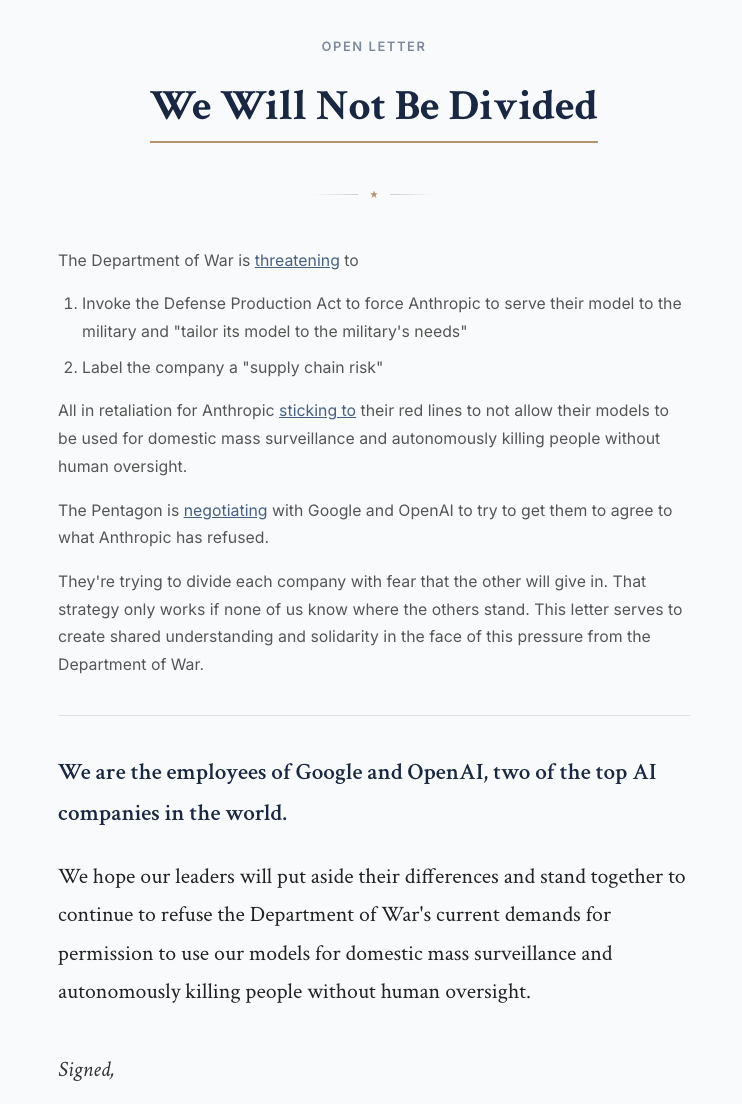

Curiosamente, a posição da Anthropic recebeu forte apoio da indústria. Mais de 200 funcionários de Google e OpenAI assinaram uma carta pública apoiando a decisão de manter os filtros de segurança. Muitos analistas alertam que, se o governo usar arbitrariamente a classificação de “risco na cadeia de fornecimento” para pressionar empresas de tecnologia, isso criará um precedente perigoso, prejudicando a inovação e a governança ética da IA nos EUA. A Anthropic afirma que ameaças e punições não vão alterar sua linha de defesa contra vigilância em massa e armas autônomas.

Fonte: NotDivided Mais de 200 funcionários de Google e OpenAI assinam carta apoiando a manutenção dos filtros de segurança da Anthropic

OpenAI assume rapidamente contrato militar, reconfiguração do setor de IA

Horas após a exclusão da Anthropic, a concorrente OpenAI anunciou um novo acordo com o Departamento de Defesa. O CEO, Sam Altman, confirmou que seus modelos de IA serão implantados na rede confidencial do Pentágono.

Altman destacou que o acordo mantém restrições ao uso de armas autônomas e vigilância em massa, e que o Departamento de Defesa demonstrou profundo respeito pela segurança.

Sobre a parceria, o oficial do Departamento de Estado, Jeremy Lewin, afirmou que o contrato com a OpenAI se baseia na cláusula de “todos os usos legais”, uma diretriz consistente com a política do exército, aprovada pelo xAI. Ele explicou que, embora o contrato inclua mecanismos de segurança, estes são baseados na legislação e políticas existentes, e são compatíveis com a proposta de compromisso recusada pela Anthropic.

Ele acrescentou que a questão central é “quem tem a decisão final sobre problemas críticos”. A OpenAI mantém essa decisão no âmbito democrático, enquanto a Anthropic tenta concentrar o poder no CEO, o que compromete a soberania sobre sistemas sensíveis. Ele elogiou a postura da OpenAI e do xAI, considerando que isso é positivo para a segurança nacional e a liderança dos EUA em IA.

Analistas de mercado afirmam que a intervenção da OpenAI coloca a Anthropic em posição extremamente desfavorável. Com gigantes como Nvidia, Amazon e Google atuando na cadeia de fornecimento militar, se a proibição de Hegseth se estender a todos os parceiros militares, essas empresas podem ser forçadas a retirar seus investimentos ou encerrar colaborações tecnológicas com a Anthropic. Essa situação prejudica a confiança de investidores na indústria de IA americana e pode levar à fuga de talentos para regiões menos sujeitas a pressões políticas.

Atualmente, a Anthropic já começou a redirecionar parte de seus recursos para o setor civil e de pesquisa, como o recente lançamento do “Claude Opus 3 Retirement Blog”, que permite que modelos antigos dialoguem com o público de outra forma. Apesar da proibição federal, a Anthropic reafirma seu compromisso com os interesses de segurança nacional dos EUA e garante que, durante o período de transição de seis meses, manterá a continuidade das operações militares.

Essa guerra de ética em IA e poder político ainda não acabou. A batalha judicial da Anthropic será um marco importante para definir os limites do poder do governo dos EUA e os princípios de governança da IA.