OpenAI Afirma Linhas Vermelhas de Segurança no Acordo com o Pentágono—Mas os Utilizadores Não Estão a Acreditar

Resumo

- A OpenAI assinou um acordo com o Pentágono para implementar IA em ambientes classificados.

- A empresa afirmou ter imposto “linhas vermelhas”, mas o contrato permite “todos os propósitos legais”, um padrão que depende da interpretação do próprio governo.

- A controvérsia provocou o movimento QuitGPT e impulsionou um aumento nas downloads do Claude.

A OpenAI anunciou neste fim de semana que chegou a um acordo com o Pentágono para implantar sistemas avançados de IA em ambientes classificados, marcando uma expansão significativa do trabalho da empresa com o exército dos EUA. O anúncio ocorreu menos de 24 horas após a administração Trump incluir a Anthropic na lista negra, qualificando a rival de IA como um “risco na cadeia de suprimentos para a segurança nacional” após uma disputa sobre a linguagem do contrato relacionada à vigilância e armas autônomas. O presidente Donald Trump também ordenou às agências federais que cessassem imediatamente o uso da tecnologia da Anthropic, com o secretário do Tesouro Scott Bessent escrevendo na X na segunda-feira que a agência “está encerrando todo uso dos produtos da Anthropic, incluindo a plataforma Claude, dentro do nosso departamento.”

"OS ESTADOS UNIDOS DA AMÉRICA NUNCA PERMITIRÃO QUE UMA EMPRESA RADICAL DE ESQUERDA, WOKE, DITE COMO NOSSA GRANDE FORÇA MILITAR LUTA E VENCE GUERRAS! Essa decisão pertence ao SEU COMANDANTE-EM CHEFE, e aos líderes que nomeio para administrar nosso Exército.

Os lunáticos de esquerda na Anthropic… pic.twitter.com/aIEx92nnyx

— A Casa Branca (@WhiteHouse) 27 de fevereiro de 2026

O timing dos anúncios de IA colocou o acordo da OpenAI sob forte escrutínio. Em um post detalhado no blog, a empresa descreveu o que chamou de “linhas vermelhas” firmes e salvaguardas que regulam sua parceria com o Pentágono. O acordo, conforme apresentado pela OpenAI, levanta questões mais amplas sobre como os sistemas de IA serão governados em contextos de segurança nacional e como as restrições declaradas pela empresa serão interpretadas e aplicadas na prática. Quando “legal” não basta O post do blog da OpenAI começa com três compromissos considerados inegociáveis: nenhuma utilização de sua tecnologia para vigilância doméstica em massa, para direcionar independentemente sistemas de armas autônomas ou para decisões automatizadas de alto risco, como pontuação de crédito social. Depois vem a linguagem real do contrato — que a OpenAI chama de “a linguagem relevante”, não “o acordo completo”.

“O Departamento de Guerra pode usar o sistema de IA para todos os propósitos legais, de acordo com a lei aplicável, requisitos operacionais e protocolos de segurança e supervisão bem estabelecidos,” afirmou a OpenAI. Essa é a frase exata que a Anthropic afirmou que o governo vinha exigindo durante as negociações. A frase exata que a Anthropic se recusou a aceitar. A OpenAI assinou, mas argumenta que suas linhas vermelhas permanecem totalmente intactas. No entanto, “legal” em contextos de segurança nacional não é uma fronteira fixa — ela existe dentro de um mosaico de leis, ordens executivas, diretrizes internas e, muitas vezes, interpretações jurídicas classificadas. Quando um contrato concede “todos os propósitos legais,” o limite prático passa a ser o envelope jurídico atual do governo, não um padrão independente imposto pelo fornecedor. Um conjunto de cláusulas A provisão de armas afirma que o sistema de IA “não será usado para direcionar independentemente armas autônomas em qualquer caso onde a lei, regulamento ou política do departamento exija controle humano.” A proibição só se aplica quando alguma outra autoridade já exige controle humano — ela se apoia inteiramente na política existente, especificamente na Diretiva DoD 3000.09. Essa diretiva exige que sistemas autônomos permitam que comandantes exerçam “níveis apropriados de julgamento humano sobre o uso da força.” E “apropriado” é tão subjetivo quanto se pode imaginar. Julgamento humano não é controle humano. Essa distinção não foi acidental. Especialistas em defesa observaram que omitir a linguagem “loop humano” foi uma decisão deliberada, justamente para preservar a flexibilidade operacional.

O argumento mais forte da OpenAI é sua arquitetura de implantação apenas na nuvem — loops de decisão letal totalmente autônomos exigiriam implantação de borda em dispositivos de campo de batalha, o que este contrato não permite. Essa é uma restrição técnica real. Mas IA baseada na nuvem ainda pode realizar identificação de alvos, análise de padrões de vida e planejamento de missões. Essas atividades fazem parte da cadeia de eliminação, independentemente de onde o gatilho final esteja localizado. O resultado para um alvo não difere dependendo do servidor onde o modelo roda. A cláusula de vigilância segue um padrão semelhante. A linha vermelha declarada pela OpenAI: nenhuma vigilância doméstica em massa. A linguagem do contrato: o sistema “não deverá ser usado para monitoramento não restrito de informações privadas de pessoas nos EUA” — e lista a Quarta Emenda, FISA e a Ordem Executiva 12333. A palavra “não restrito” implica que uma versão restrita de vigilância em massa seria permitida. E a EO 12333 é a ordem executiva que a NSA usou para justificar interceptações de comunicações de americanos feitas fora das fronteiras dos EUA. E é aqui que as preocupações da Anthropic sobre a redação durante as negociações se tornam evidentes. A argumentação da Anthropic era que a legislação atual não acompanhou o que a IA torna possível. O governo pode legalmente comprar grandes quantidades de dados comerciais agregados sobre americanos sem mandado — e já o fez. A linguagem do contrato da OpenAI, ao ancorar suas proteções em marcos jurídicos existentes, pode não fechar a lacuna que a Anthropic realmente temia. Resposta de Altman No sábado à noite, Altman realizou uma AMA respondendo a milhares de perguntas sobre o acordo. Quando questionado sobre o que faria a OpenAI desistir de uma parceria com o governo, ele respondeu: “Se nos pedirem para fazer algo inconstitucional ou ilegal, vamos sair fora.”

Se nos pedirem para fazer algo inconstitucional ou ilegal, vamos sair fora. Venha me visitar na prisão, se necessário.

— Sam Altman (@sama) 1 de março de 2026

Essa abordagem coloca o limite da OpenAI na legalidade — não em um julgamento ético independente sobre o que a empresa permitirá ou não, se for legal, como defende a Anthropic. Questionado se tinha preocupação com futuras disputas sobre o que constitui “legal,” ele reconheceu o risco: “Se precisarmos enfrentar essa luta, enfrentaremos, mas isso claramente nos expõe a algum risco.” Sobre por que a OpenAI fechou um acordo que a Anthropic não pôde, Altman explicou: “A Anthropic parecia mais focada em proibições específicas no contrato, do que em citar leis aplicáveis, com o que nos sentimos confortáveis. Eu claramente preferiria confiar em salvaguardas técnicas, se tivesse que escolher uma. Acho que a Anthropic queria mais controle operacional do que nós.” Essa é uma diferença filosófica substancial. A Anthropic argumentou que, como modelos de fronteira podem ser reaproveitados para inteligência e operações militares de formas difíceis de prever, os limites precisam ser explícitos e vinculativos por escrito, mesmo que isso prejudique o acordo. A posição da OpenAI é que arquitetura técnica, pessoal incorporado e leis existentes constituem uma salvaguarda mais forte do que o texto contratual sozinho. O público escolheu um lado

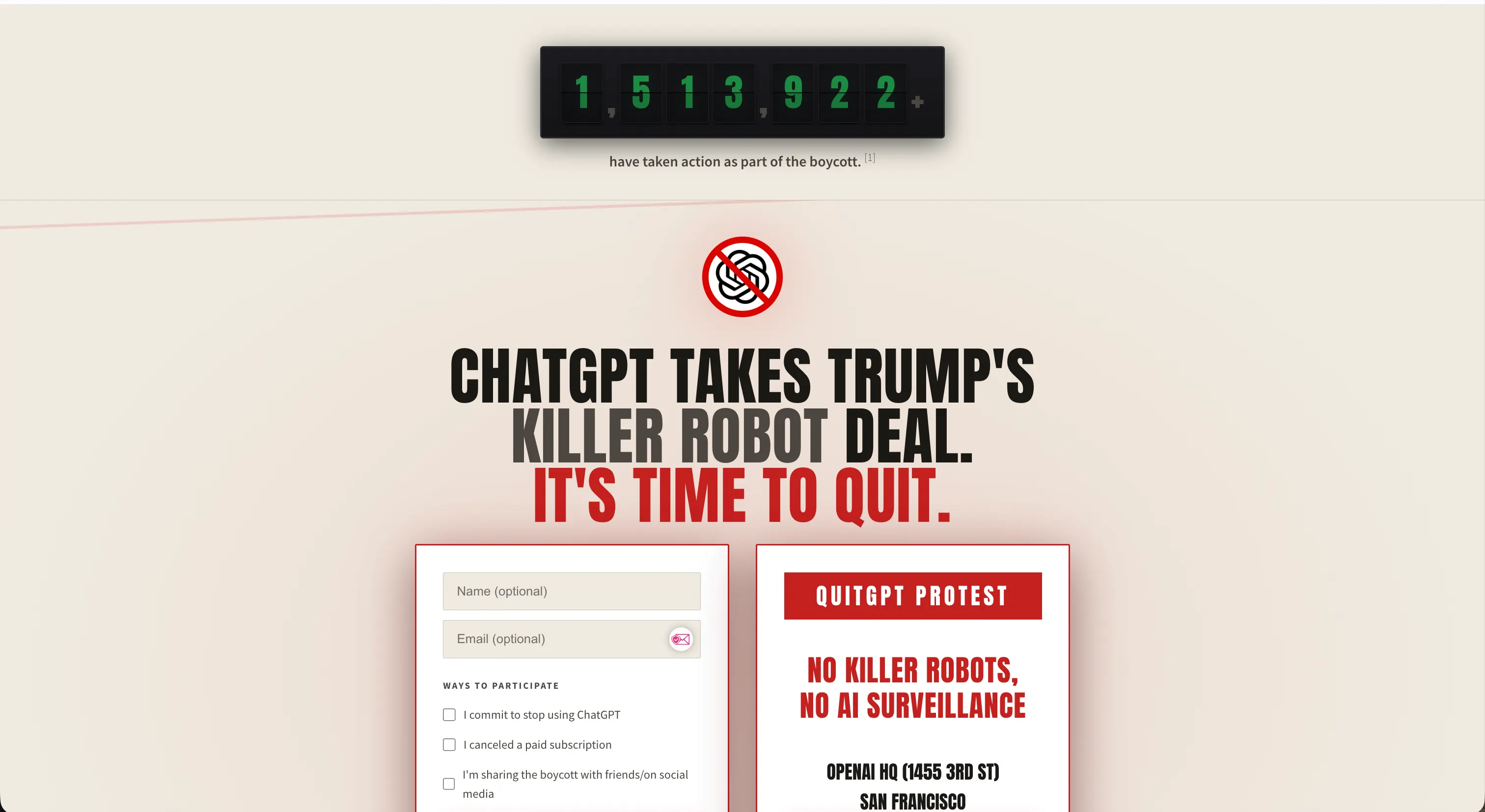

A reação foi imediata. Até segunda-feira, o movimento “QuitGPT” afirmou que mais de 1,5 milhão de pessoas tomaram alguma ação — cancelando assinaturas, compartilhando posts de boicote ou se inscrevendo em quitgpt.org.

A campanha enquadrou a ação da OpenAI como uma prioridade por contratos militares em detrimento da segurança dos usuários, acusando a empresa de concordar em permitir que o Pentágono use sua tecnologia para “qualquer propósito legal, incluindo robôs assassinos e vigilância em massa.”

A OpenAI pode contestar essa caracterização. Mas o mercado se moveu independentemente.

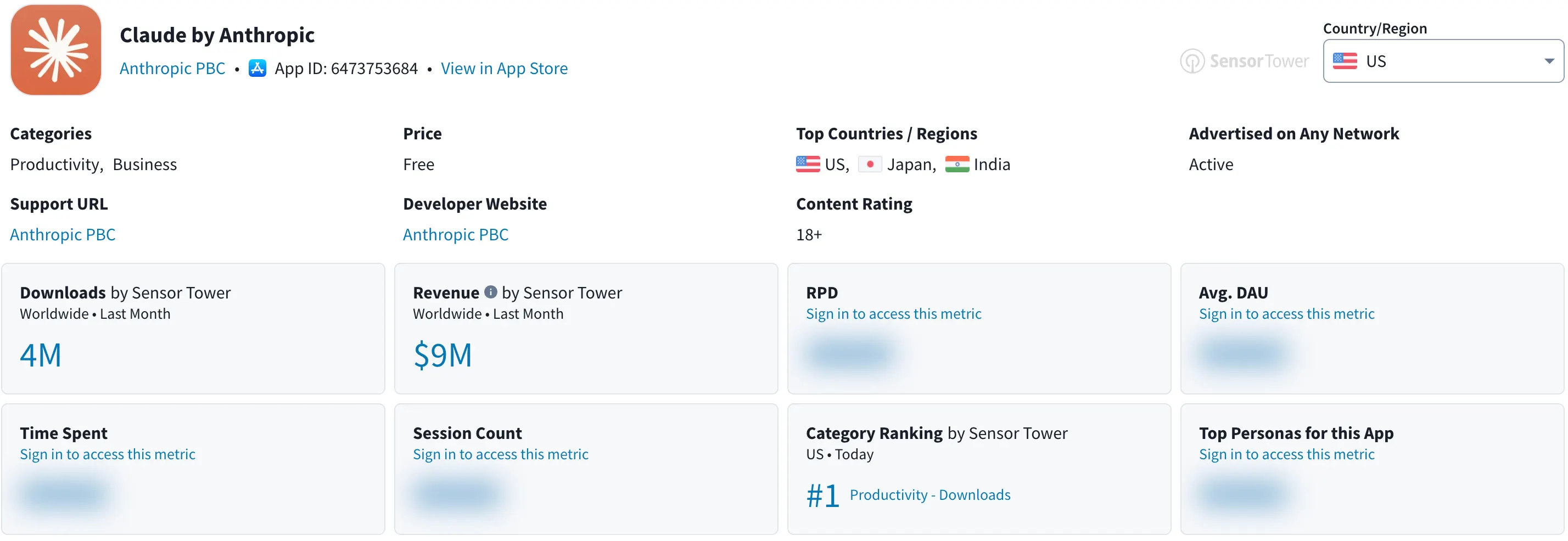

O Claude da Anthropic ultrapassou o ChatGPT e tornou-se o aplicativo gratuito mais baixado nos Estados Unidos na App Store da Apple, com a empresa informando ao Decrypt que registrou recordes de inscrições diárias no fim de semana.

A estrela pop Katy Perry compartilhou uma captura de tela da página de preços do Claude no X. Centenas de usuários documentaram publicamente o cancelamento de suas assinaturas no Reddit. Grafites elogiando a Anthropic apareceram fora de seus escritórios em São Francisco, enquanto ataques de giz cobriam as calçadas da OpenAI. Até mesmo centenas de funcionários da OpenAI haviam assinado uma carta aberta apoiando a recusa da Anthropic em ceder às exigências do Pentágono.

A narrativa QuitGPT é emocionalmente convincente, mas não totalmente precisa. A própria Anthropic possui uma parceria com a Palantir e a Amazon Web Services que concede às agências de inteligência e departamentos de defesa dos EUA acesso aos modelos Claude, e supostamente foi usada em operações militares para derrubar governos na Venezuela e Irã. A ética de contratos de IA e segurança nacional nunca foi clara de ambos os lados. O que a campanha capturou, com precisão, é que uma grande parcela dos usuários acreditava que havia uma diferença significativa na forma como as duas empresas estabeleciam seus limites — e votaram com suas assinaturas. Se essa diferença é tão significativa quanto parece, depende de uma leitura cuidadosa do contrato.