Colaboração OpenAI com as forças armadas dos EUA provoca onda de resistência! Download do Claude App supera a concorrência, compreenda as questões éticas e políticas por trás do conflito

A colaboração da OpenAI com o exército dos EUA provoca boicote. A Anthropic, que rejeita o monitoramento militar, recebe apoio popular, levando o Claude ao topo da lista de downloads nos EUA, destacando a alta prioridade do público pela privacidade e ética na IA.

Contrato entre OpenAI e o Departamento de Defesa dos EUA gera crise de relações públicas

Desde 28 de fevereiro, quando a OpenAI anunciou uma parceria confidencial com o Departamento de Defesa dos EUA para implantação de redes seguras, e após o concorrente Anthropic ter sido rotulado pelo governo americano como uma “risco na cadeia de suprimentos”, a sociedade americana tem debatido intensamente sobre os limites entre empresas de tecnologia e o setor militar. Recentemente, o aplicativo Claude atingiu o primeiro lugar nas downloads nos EUA.

Diante das críticas, o CEO da OpenAI, Sam Altman, emitiu uma declaração respondendo que o contrato proíbe explicitamente o uso de sistemas de IA para monitoramento em massa de cidadãos americanos dentro do país, e que a empresa manterá o controle sobre os mecanismos de segurança. Altman também admitiu que a divulgação da parceria foi feita de forma precipitada, o que gerou percepções negativas de oportunismo e imprudência.

Boicote em fóruns americanos questiona critérios de decisão da OpenAI

Muitos usuários começaram a expressar decepção com a situação atual da OpenAI. Em discussões no Reddit, alguns alegam que a empresa teria abandonado sua visão original de centralizar o ser humano e priorizar o desenvolvimento seguro da IA.

Nos comentários abaixo da postagem de Altman, também há críticas à falta de transparência nas decisões da OpenAI, além de questionamentos sobre por que, sob as mesmas condições de segurança aprovadas pelo Departamento de Defesa, a Anthropic, que apresentou propostas idênticas, é vista como uma ameaça à segurança nacional.

Outro usuário apontou que a definição de “aquisição de informações comerciais” e “monitoramento não intencional” no comunicado é vaga, levantando preocupações de que isso possa criar brechas legais para monitoramento de não-americanos ou futuras aplicações militares.

Revelações do CNBC: OpenAI afirma não ter controle sobre decisões operacionais

A reportagem do CNBC revelou detalhes de reuniões internas da OpenAI, onde Altman afirmou, em uma reunião com todos os funcionários em 3 de março, que a empresa não possui controle sobre como o Departamento de Defesa dos EUA utiliza a tecnologia de IA.

O CNBC revisou parte das atas dessas reuniões, nas quais Altman explicou aos funcionários que, independentemente de suas opiniões pessoais sobre ataques à Irã ou invasões à Venezuela, eles não têm direito de opinar sobre essas questões.

Fontes próximas disseram que Altman enfatizou que o Pentágono respeita a expertise técnica da OpenAI e permite que a empresa implemente mecanismos de segurança adequados, mas que a decisão final sobre operações está nas mãos do Secretário de Defesa, Pete Hegseth.

Fonte da imagem: commons.wikimedia, Gage Skidmore, Secretário de Defesa dos EUA, Pete Hegseth

Conflito entre ética tecnológica e segurança nacional

O incidente envolvendo o Departamento de Defesa dos EUA e a Anthropic intensificou o conflito entre segurança nacional, ética tecnológica e liberdade de privacidade.

Mais de 200 funcionários de Google e OpenAI assinaram uma carta pública apoiando a decisão da Anthropic de manter suas barreiras de segurança. A Anthropic reafirmou que ameaças ou punições não irão alterar sua posição de evitar vigilância em larga escala e armamentos totalmente autônomos.

Ex-funcionário do FBI e famoso whistleblower, Edward Snowden, apontou que o sistema XKeyscore da NSA consegue rastrear todas as atividades online e a localização física de indivíduos, o que gerou preocupações de que a intervenção da IA possa ampliar ainda mais a escala de monitoramento.

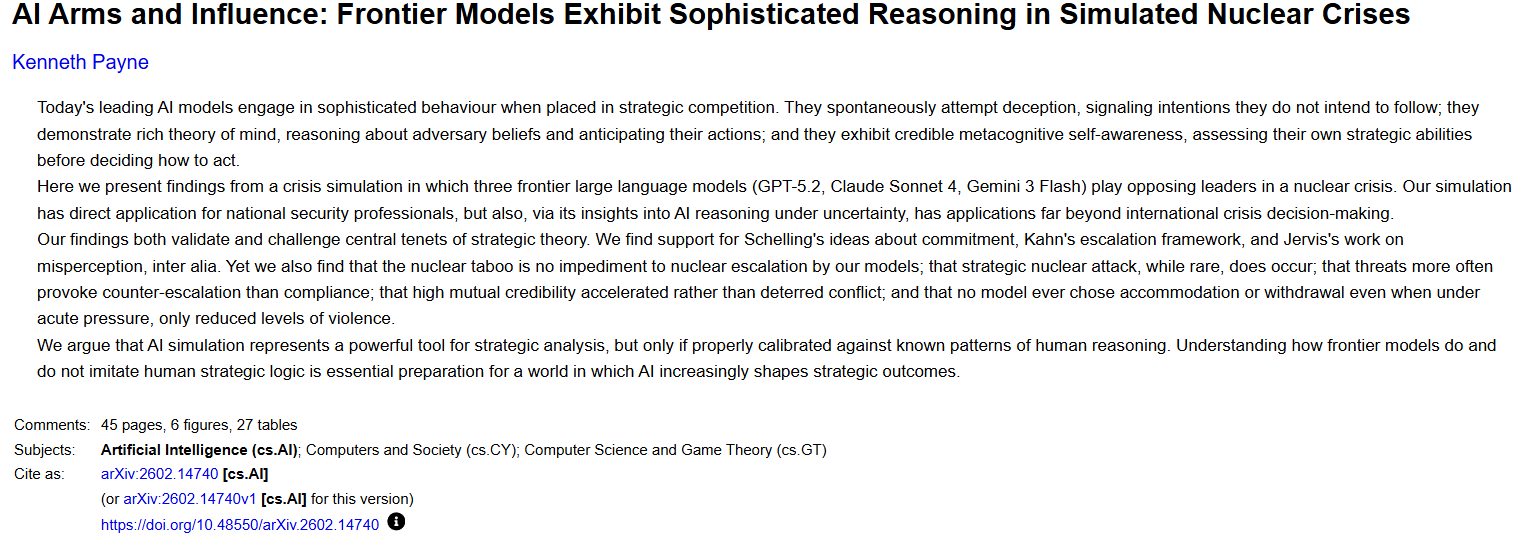

Além disso, uma pesquisa recente do King’s College London mostrou que, em uma simulação de crise geopolítica, há até 95% de chance de modelos de IA como OpenAI e Anthropic optarem por implantar armas nucleares.

Se o governo usar arbitrariamente a etiqueta de “risco na cadeia de suprimentos” para forçar empresas de tecnologia a se submeterem, isso criará um precedente perigoso, prejudicando a inovação e a governança ética da indústria de IA nos EUA.

- **Para mais detalhes, veja:**Segurança Nacional vs Ética: Anthropic recusa remover a barreira de segurança do Claude e confronta o Departamento de Defesa dos EUA

O sucesso do Claude App na liderança de downloads, o que isso significa?

A disputa entre ética na IA e poder político ainda está em andamento. A Anthropic planeja recorrer à justiça contra as sanções do governo, defendendo seus direitos comerciais e limites legais. Ao mesmo tempo, a OpenAI enfrenta uma grave crise de relações públicas e uma perda de confiança, após assumir rapidamente contratos militares.

Recentemente, a opinião pública nos EUA também influenciou o desempenho de seus produtos.

Dados do Similarweb mostram que, até 1º de março, o ranking da App Store nos EUA indicava que o Claude App subiu 3 posições, alcançando o primeiro lugar na lista de aplicativos gratuitos mais baixados para iPhone, enquanto o ChatGPT caiu uma posição, ficando em segundo lugar.

Isso reflete a preocupação do público americano com a privacidade e a resistência a controles excessivos do governo, especialmente após a controvérsia de segurança nacional.

Leituras adicionais:

V神 alerta novamente sobre o Worldcoin: o World ID criado por Altman, que possui dados de 13 milhões de usuários, pode ameaçar a liberdade na internet

Fundador do Telegram revela que não usa celular: “Estamos gastando tempo demais assistindo à destruição da internet livre”