Veja as características e o modo de funcionamento dos Agentes Geridos pela Claude de uma só vez! Isto pode acelerar a produção das empresas dez vezes?

A Anthropic lança os Claude Managed Agents, disponibilizando infraestruturas totalmente geridas e coordenação entre múltiplos agentes, simplificando bastante a arquitectura de base para o desenvolvimento. A empresa afirma oficialmente que pode ajudar as organizações a acelerar em 10 vezes a produção, enquanto procura activamente conquistar o mercado de IA a nível empresarial.

Os Claude Managed Agents são lançados oficialmente

O gigante da tecnologia em IA, a Anthropic, lançou os Claude Managed Agents, ajudando as empresas a construir e a implementar agentes de IA de forma mais simples. Esta ferramenta oferece aos programadores uma infra-estrutura pronta a usar, simplificando os processos complexos que antes impediam a automatização de tarefas de trabalho, e afirma ainda permitir que as empresas acelerem em 10 vezes a velocidade de colocar os produtos em produção.

Quais são as características dos Claude Managed Agents?

De acordo com o artigo oficial, ao desenvolver sistemas de agentes, as empresas normalmente precisam de vários meses para tratar infra-estruturas, gestão de estado e definições de permissões.

Os Claude Managed Agents abstraem esta complexa infra-estrutura de base; assim, os programadores só precisam de definir as tarefas e as barreiras de segurança do agente, enquanto a plataforma trata automaticamente do funcionamento subsequente.

As suas principais características abrangem os seguintes aspectos:

Característica 1: Infra-estrutura de segurança totalmente gerida

Os Claude Managed Agents fornecem um ambiente de execução ao nível da produção, tratando automaticamente a execução e validação em sandbox segura, permitindo que os modelos de linguagem acedam a ficheiros, executem código e naveguem na web a partir de contentores cloud protegidos.

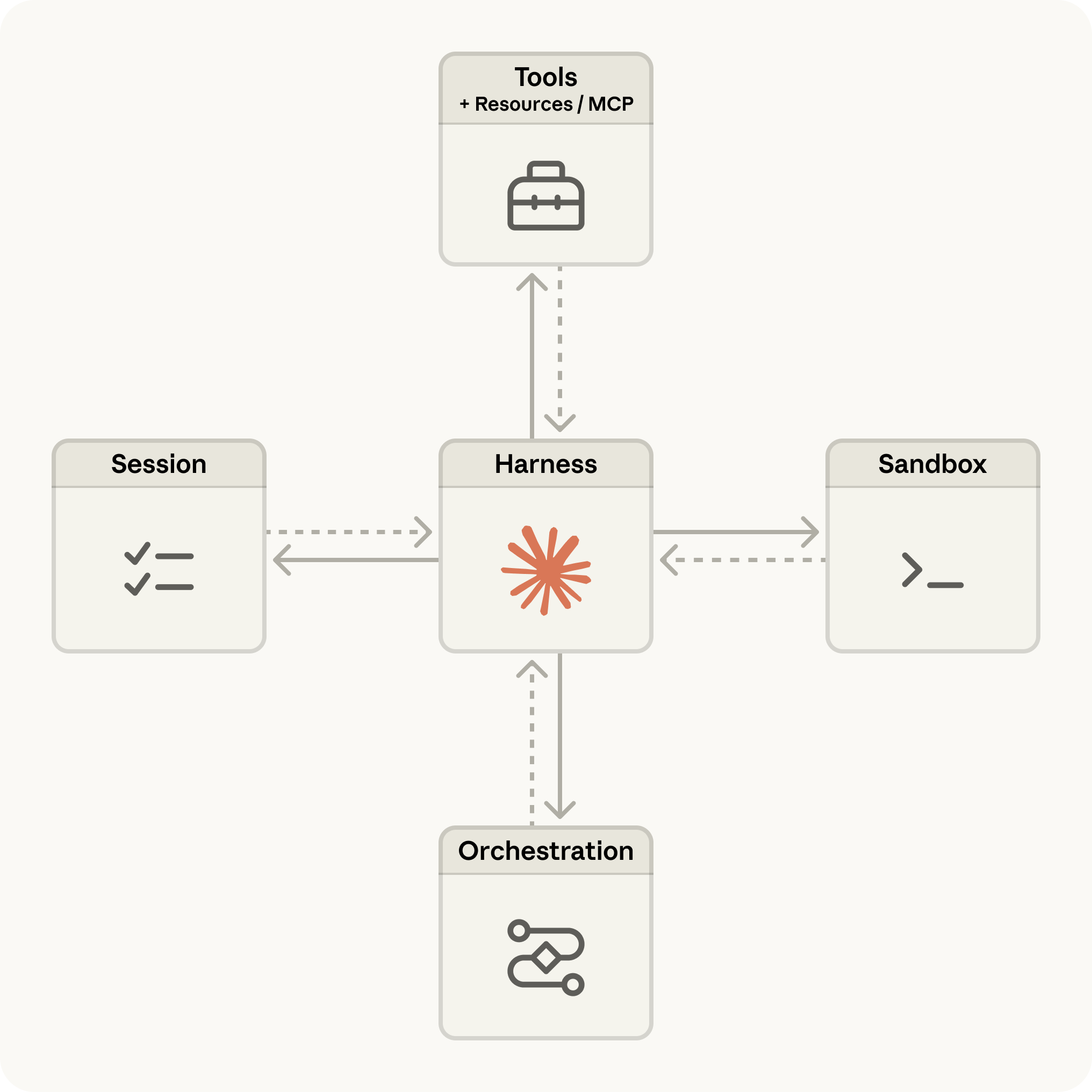

Fonte da imagem: anthropic Claude Managed Agents possuem uma infra-estrutura de segurança totalmente gerida

Característica 2: Suporte para execução autónoma durante longos períodos

Os Claude Managed Agents foram concebidos para trabalhos assíncronos que exigem execução prolongada. O agente consegue operar de forma autónoma durante várias horas e dispõe de um sistema de ficheiros persistente e de registos do histórico de conversas; mesmo que haja uma quebra de ligação a meio, consegue manter o progresso da execução e os resultados da saída.

Característica 3: Coordenação entre múltiplos agentes e ferramentas de governação

Os Claude Managed Agents têm a capacidade de iniciar e comandar outros agentes para processar tarefas em paralelo. A plataforma inclui, de forma nativa, ferramentas de governação como gestão de identidades, permissões por âmbito e rastreamento de execução, garantindo a segurança dos agentes ao acederem a sistemas reais.

Como funcionam os Claude Managed Agents?

Quanto ao modo como os Claude Managed Agents funcionam na prática, a documentação oficial descreve-o em passos:

- Criar um agente: : Os programadores definem o modelo, instruções do sistema e ferramentas; após a criação, podem referenciar repetidamente em diferentes sessões.

- Criar um ambiente: : Configurar contentores cloud, instalar previamente pacotes de software e definir regras de acesso à rede.

- Iniciar uma sessão: : Iniciar uma instância de execução que refira o agente e a configuração do ambiente acima, para realizar uma tarefa específica.

- Enviar eventos e respostas em streaming: : Enviar as mensagens do utilizador como eventos; o modelo executa autonomamente as ferramentas e devolve os resultados, mantendo também o histórico no lado do servidor.

- Orientar ou interromper: : Durante a execução, o utilizador pode enviar eventos adicionais para orientar o agente, ou interromper directamente para alterar a direcção da execução.

Reduzir a lacuna tecnológica; a Notion testa primeiro

A responsável de engenharia da plataforma Claude, Katelyn Lesse, assinalou que a implementação em larga escala de agentes é um problema altamente complexo de engenharia de sistemas distribuídos; com a infra-estrutura base pronta fornecida pela Anthropic, os engenheiros dos clientes conseguem concentrar-se no núcleo do negócio e no desenvolvimento de produto.

Num artigo oficial, a Anthropic explicou ainda que, no design anterior dos AI Agents, frequentemente o modelo de linguagem e as ferramentas de execução ficam ligados ao mesmo contentor, o que torna a manutenção do sistema difícil.

A nova arquitectura separa o modelo de computação do ambiente de execução; não só reduz significativamente a latência do tempo até ao primeiro carácter, como também permite que os agentes se conectem de forma flexível ao seu próprio cloud privado virtual empresarial, melhorando simultaneamente a segurança e impedindo que código malicioso aceda a credenciais sensíveis.

Na aplicação prática, a startup de produtividade Notion demonstrou como usar este novo serviço para activar funcionalidades de condução dos clientes.

O gestor de produto da Notion, Eric Liu, no momento da demonstração, entregou uma longa lista de tarefas aos Claude Managed Agents; e estes começaram a completar cada passo por ordem. Os programadores também podem ver, em directo no painel da plataforma Claude, o estado do trabalho do agente e as ferramentas utilizadas.

Corrida dos gigantes da tecnologia pelo mercado de IA empresarial

Empresas tecnológicas têm estado a alocar recursos para conquistar o mercado de IA a nível empresarial; **este ano, em Fevereiro, a OpenAI lançou a **Frontier platform, e a Nvidia também, em Março deste ano, acompanhou a tendência de criar lagostas no OpenClaw e **lançou a open source **NemoClaw para o OpenClaw, disponibilizando modelos abertos e um ambiente de sandbox isolado, acrescentando privacidade de dados e protecção de segurança aos AI Agents.

Estes movimentos mostram que a indústria está a preparar activamente infra-estruturas de IA mais escaláveis e seguras para as empresas, acelerando a implementação integral da IA no domínio empresarial.

Leitura adicional:

CZ da Binance ironiza os agentes de IA «lagosta»: diz «libertar as mãos», mas acaba sempre ocupado a repará-la