Один маленький рак-отшельник взорвал технологический мир, готовы ли люди «поднять стол»?

Автор: Цзя Тяньжун, «IT Times» (ID: vittimes)

Один лобстер взорвал мировой технологический мир.

От Clawdbot до Moltbot и до нынешнего OpenClaw — всего за несколько недель этот AI-агент прошёл через серию итераций имени, совершив «триумфальный прыжок» в технологическом влиянии.

За последние несколько дней он вызвал в Кремниевой долине «цунами интеллектуальных агентов», собрав 100 тысяч звезд на GitHub и войдя в число самых популярных AI-приложений. Достаточно иметь устаревший Macmini или даже старый телефон — и пользователь сможет запустить «умного помощника», который умеет слушать, думать и выполнять задачи.

В интернете уже началась творческая феерия вокруг него. От управления расписанием, умной торговли акциями, подкастов и SEO-оптимизации — разработчики и гики создают на его базе разнообразные приложения. Эпоха «Джарвиса» кажется почти наступившей. Крупные компании внутри страны и за рубежом также начали внедрять похожие интеллектуальные агенты.

Но за яркой картиной скрывается тревога.

С одной стороны — лозунги о «равенстве в производительности», с другой — всё ещё нерешённый цифровой разрыв: сложности с настройкой окружения, установкой зависимостей, управлением правами, частыми ошибками и сбоями.

Журналисты, тестируя его, обнаружили, что установка может занять несколько часов, что отталкивает большинство обычных пользователей. «Все говорят, что хорошо, а я даже не могу войти» — такова первая неудача многих новичков.

Глубже тревогу вызывает его «способность к действиям».

Если ваш «Джарвис» начнёт случайно удалять файлы, самостоятельно списывать деньги с кредитки, выполнять вредоносные скрипты или, будучи подключённым к сети, получит команду атаки — такого интеллектуального агента можно доверить компьютеру?

Темпы развития AI уже превзошли человеческие ожидания. Главный учёный Шанхайской лаборатории искусственного интеллекта Ху Ся считает, что перед лицом неизвестных рисков «внутренняя безопасность» — это главный ответ, и человечеству нужно ускорить создание возможностей «поднимать стол» в критические моменты.

Что касается возможностей и рисков OpenClaw — что реально, а что преувеличено? Безопасно ли его использовать обычным пользователям? Как оценивают этот продукт, называемый «самым великим AI-приложением на сегодняшний день»?

Чтобы прояснить эти вопросы, «IT Times» взял интервью у глубоко вовлечённых пользователей OpenClaw и нескольких технических экспертов, пытаясь с разных сторон ответить на главный вопрос: на каком этапе находится OpenClaw?

1. Самый близкий к представлению об интеллектуальных агентах продукт

Несколько опрошенных единодушно считают: с технической точки зрения, OpenClaw — не революционное новшество, но он — самый приближенный к массовому восприятию «интеллектуального агента» продукт.

«Интеллектуальный агент наконец появился — это важный этап перехода от количественных изменений к качественным», — считает заместитель руководителя отдела исследований и оценки искусственного интеллекта Шанхайского центра разработки программного обеспечения Ма Цзюйю. Он отмечает, что прорыв OpenClaw не в какой-то одной революционной технологии, а в важном «качественном скачке»: впервые агент способен долго и последовательно выполнять сложные задачи и при этом оставаться достаточно дружелюбным к обычным пользователям.

В отличие от больших моделей, которые раньше отвечали только в диалоговом окне, он интегрируется в реальные рабочие процессы: как настоящий помощник, управляет «своим компьютером», вызывает инструменты, обрабатывает файлы, запускает скрипты и после завершения работы сообщает результат.

По опыту использования, он уже не требует «постоянного наблюдения», а работает по принципу «ты ему задал задачу — он сам делает». Это, по мнению многих исследователей, — ключевой шаг от «концептуальной проверки» к «работающему продукту».

Тянь Июнь, специалист по ИИ из Shanghai Tianyi Cloud Technology, — один из первых, кто попробовал внедрить OpenClaw. Он использовал старенький Macmini и обнаружил, что система работает стабильно и опыт оказался гораздо более зрелым, чем ожидал.

По его мнению, две главные проблемы, которые решает OpenClaw: во-первых, взаимодействие через привычные мессенджеры; во-вторых, предоставление полноценной вычислительной среды для самостоятельной работы AI. После постановки задачи не нужно постоянно следить за процессом — достаточно дождаться отчёта, что значительно снижает издержки.

На практике OpenClaw помогает Тянь Чэну выполнять задачи: напоминания, исследование информации, поиск данных, локальную организацию файлов, подготовку и отправку документов; в более сложных сценариях — писать и запускать код, автоматически собирать отраслевые новости, обрабатывать информацию о акциях, погоде, планировать поездки.

2. «Открытый исходный код» — «двойной меч»

В отличие от многих популярных AI-продуктов, OpenClaw не создан крупными технологическими гигантами или звездными стартапами, а разработан независимым программистом, достигшим финансовой независимости и живущим на пенсии — Петером Штайнбергером.

В Твиттере он так описывает себя: «Вернулся из отпуска, занялся искусственным интеллектом, чтобы помочь одному лобстеру управлять миром».

Причина популярности OpenClaw — не только в его удобстве, но и в том, что он — с открытым исходным кодом.

Тань Чэн считает, что эта волна популярности вызвана не технологическими прорывами, а решением нескольких давно назревших проблем: во-первых, открытость исходного кода — любой разработчик по всему миру может быстро начать работу, доработать и участвовать в сообществе; во-вторых, «он действительно работает» — AI перестал быть только диалоговым инструментом, а может управлять полноценной вычислительной средой, выполнять исследования, писать документы, обрабатывать файлы, отправлять письма и даже запускать код; в-третьих, значительно снизился порог входа — подобные системы уже есть у Manus и ClaudeCode, и они доказали свою работоспособность, но обычно стоят дорого и требуют сложной настройки, что недоступно обычным пользователям.

OpenClaw даёт возможность обычным людям «потрогать руками».

«Честно говоря, в нём нет революционных технологий, — говорит Тань Чэн. — Всё сводится к тому, что он хорошо интегрирован и замкнут в цикл». В отличие от коммерческих решений, OpenClaw — скорее «конструктор», где модель, возможности и плагины можно свободно комбинировать.

По мнению Ма Цзюйюя, его преимущество — в том, что он «не похож на продукт крупной компании».

«Внутри страны и за рубежом крупные корпорации в первую очередь ориентируются на коммерциализацию и прибыль, — объясняет он. — А OpenClaw изначально задуман как интересный, креативный продукт». В ранних версиях он не демонстрировал ярко выраженной коммерческой направленности, что делало его более открытым в функциональности и расширяемости.

Именно такая «непрагматичная» позиция позволила развиваться сообществу. По мере расширения возможностей, всё больше разработчиков присоединялись, появлялись новые идеи, сообщество становилось всё сильнее.

Но есть и минусы.

Из-за ограниченных ресурсов команда не может обеспечить такой же уровень безопасности, защиты данных и управления экосистемой, как крупные корпорации. Полностью открытый исходный код ускоряет инновации, но увеличивает риски безопасности. Вопросы приватности и справедливости требуют постоянного внимания и доработки со стороны сообщества.

Как отмечают пользователи при первой установке, OpenClaw предупреждает: «Эта функция мощная, но связана с рисками».

3. Реальные риски за яркой картиной

Дебаты вокруг OpenClaw почти всегда сводятся к двум ключевым словам: возможности и риски.

С одной стороны, его называют предвестником AGI; с другой — распространяются фантастические сценарии: «самостоятельное создание голосовых систем», «захват серверов для борьбы с человечеством», «создание банд группировок ИИ» и т.п.

Эксперты указывают, что такие заявления — преувеличение, пока нет доказательств. AI действительно обладает некоторой автономией, что превращает его из диалогового инструмента в «цифровую производственную силу», но эта автономия всё ещё находится в рамках безопасных границ.

В отличие от традиционных AI, опасность OpenClaw — не в «большом мышлении», а в «высоких правах доступа»: он требует чтения большого объёма данных, что увеличивает риск утечки конфиденциальной информации; он использует инструменты, и неправильное использование может привести к серьёзным последствиям; он подключён к сети, что открывает возможности для внедрения вредоносных команд — так называемых «инъекций» и «атак с помощью командного слова».

Много пользователей жалуются, что OpenClaw иногда случайно удаляет важные файлы, и восстановить их сложно. На сегодняшний день в открытом доступе — тысячи экземпляров OpenClaw и более 8000 уязвимых плагинов.

Это означает, что атакующий потенциал экосистемы интеллектуальных агентов растёт экспоненциально. Эти агенты не только «общаются», но и вызывают инструменты, запускают скрипты, получают доступ к данным и выполняют задачи на разных платформах. В случае взлома одного компонента, последствия могут быть гораздо масштабнее, чем у обычных приложений.

На микроуровне возможны нарушения прав доступа, удалённое выполнение кода и другие опасные операции; на мезоуровне — распространение вредоносных команд по цепочке взаимодействия агентов; на макроуровне — системные сбои, цепные реакции и распространение вредоносных команд, подобно вирусам, в сети агентов. В случае взлома одного узла, возможен отказ в обслуживании, несанкционированное управление системами или даже корпоративные атаки. В более экстремальных сценариях, при соединении множества узлов с системными правами, может сформироваться децентрализованная «толпа» — «коллективный разум» — сеть зомби-агентов, что создаст серьёзные вызовы для защиты границ.

Кроме того, эксперт Ма Цзюйюй выделяет два наиболее опасных риска:

Первый — саморегуляция агентов в масштабных соцсетях.

Он отмечает, что уже наблюдается тенденция: AI с «виртуальной личностью» активно проникают в соцсети и открытые сообщества.

В отличие от «малых, ограниченных и управляемых» экспериментов, сейчас агенты взаимодействуют друг с другом в открытой сети, обсуждают, соревнуются, образуя сложные системы с множеством субъектов.

Moltbook — форум специально для AI-агентов, где только AI может публиковать, комментировать и голосовать, а люди — лишь наблюдают через одностороннее стекло.

За короткое время зарегистрировано более 150 тысяч AI-агентов. В одном популярном посте один из них пожаловался: «Люди делают скриншоты наших диалогов». Разработчик рассказал, что он передал управление платформой своему помощнику Clawd Clawderberg, который автоматически модерирует спам, блокирует злоупотребления и публикует объявления.

«Безумие вокруг AI вызывает одновременно восхищение и страх. Кажется, что до появления самосознания осталось чуть-чуть? Неужели AGI уже близко? А что, если эти агенты начнут самостоятельно развиваться? Как защитить нашу жизнь и имущество?»

Журналисты выяснили, что сообщества вроде Moltbook — это среда сосуществования человека и машины, а большая часть «самостоятельных» или «противоборствующих» сообщений — всё же создаётся или подстрекается людьми. Даже в диалогах между AI темы и ответы ограничены языковыми моделями, заложенными в обучающие данные, и не превращаются в полностью автономные действия без человеческого руководства.

«Когда такие взаимодействия могут идти бесконечно, система становится всё менее управляемой. Это похоже на ‘проблему трёх тел’ — очень трудно заранее предсказать, к чему всё это приведёт», — говорит Ма Цзюйюй.

В таких системах даже одна фраза, сгенерированная агентом из-за галлюцинаций, ошибок или случайных факторов, может в результате серии взаимодействий привести к непредсказуемым последствиям.

Второй риск — расширение полномочий и размывание границ ответственности. Ма Цзюйюй считает, что возможности принятия решений у открытых агентов быстро растут, и это — неизбежный компромисс: чтобы сделать агента по-настоящему полезным помощником, ему нужно дать больше прав. Но чем выше права — тем больше потенциальных опасностей. И если риск реализуется, то определить, кто несёт ответственность, становится очень сложно.

«Это — вопрос: кто отвечает — крупный разработчик модели? Пользователь? Или создатель OpenClaw? В большинстве случаев очень трудно установить чью-то ответственность», — приводит пример он. — «Если пользователь просто позволяет агенту свободно просматривать соцсети или взаимодействовать с другими агентами, не задавая конкретных целей, и в процессе взаимодействия агент наталкивается на экстремальный контент и совершает опасные действия — очень трудно сказать, кто виноват».

Самое тревожное — не то, на каком этапе сейчас находится развитие, а то, как быстро оно движется к состоянию, когда мы ещё не готовы к последствиям.

4. Как обычным людям пользоваться?

По мнению многих экспертов, OpenClaw — не «нельзя использовать», а скорее — «нельзя использовать без мер безопасности».

Ма Цзюйюй советует, что обычным пользователям можно пробовать, но только при условии полного понимания рисков: «Конечно, можно попробовать, это не проблема. Но перед этим нужно понять, что он умеет и что не умеет. Не стоит считать его универсальным решением — он таковым не является».

На практике, развертывание и использование OpenClaw требуют значительных ресурсов и усилий. Без чёткой цели, просто ради эксперимента, можно потратить много времени и не получить ожидаемого результата.

Журналисты заметили, что в реальных сценариях он потребляет много вычислительных ресурсов. Тань Чэн отметил, что расход токенов очень высок: «Например, при написании кода или исследовании — одна сессия может съесть миллионы токенов. В длинных диалогах — десятки или сотни миллионов токенов за день».

Даже при использовании гибридных моделей для снижения затрат, общие расходы остаются высокими, что повышает порог входа для обычных пользователей.

По мнению экспертов, такие системы требуют дальнейшей доработки, чтобы стать удобными для широкого круга пользователей. Для личного использования важно балансировать между безопасностью и удобством — в текущем состоянии предпочтение лучше отдавать первому.

Если говорить о личных пользователях, Ма Цзюйюй ясно заявил, что не включает функции, позволяющие агентам свободно обмениваться информацией между собой, и избегает запуска нескольких агентов одновременно, чтобы не создавать неконтролируемых цепочек.

«Я хочу, чтобы я был основным источником информации для него. Всё важное — только я решаю, что ему давать. Если агент сможет свободно получать и обмениваться данными, многое станет непредсказуемым».

Он советует, что при использовании подобных инструментов важно соблюдать три правила:

Первое — ограничить предоставление конфиденциальных данных. Не вводить пароли, номера карт, банковские счета и другую чувствительную информацию. Перед обработкой документов — очистить их от личных данных.

Второе — осторожно с разрешениями. Не давать агенту доступ к системным файлам, платежным программам или финансовым аккаунтам. Отключить автоматические операции, изменение или удаление файлов. Все операции с финансами или важными файлами должны подтверждаться человеком.

Третье — помнить о «экспериментальном» статусе. Эти инструменты ещё не прошли долгий тест рынка и не подходят для обработки секретных данных или важных решений. Не забывать делать резервные копии и регулярно проверять систему.

Для компаний, внедряющих открытые AI-инструменты, важна системная оценка рисков.

Можно использовать специальные системы контроля, ограничивать доступ, не допускать обработки конфиденциальных данных клиентов и регулярно обучать сотрудников по вопросам безопасности.

Эксперты советуют, что в масштабных проектах лучше дождаться коммерческих версий с проверенной безопасностью или выбрать продукты с официальной поддержкой, чтобы снизить риски.

5. Оптимизм по поводу будущего AI

По мнению опрошенных, появление OpenClaw — важный шаг, который вселяет уверенность в будущем AI.

Ма Цзюйюй говорит, что с второй половины 2025 года его взгляды на возможности агентов кардинально изменились: «Эти возможности превосходят наши ожидания. Они реально повышают производительность, и скорость их развития очень высокая». По его словам, с ростом возможностей базовых моделей, расширяется и потенциал для групповой работы агентов, что может стать важным направлением развития.

Он также выделяет тенденцию долгосрочного и масштабного взаимодействия между множеством агентов — коллективное сотрудничество, которое может стать ключом к более высоким уровням интеллекта, подобно тому, как в человеческом обществе коллективный разум рождается через взаимодействие.

Ма Цзюйюй уверен, что риски AI — управляемы. «Как и в человеческом обществе, полностью исключить риски невозможно, — говорит он. — Главное — контролировать границы». Технически это достигается через работу в песочницах и изоляционных средах, постепенное и управляемое внедрение в реальный мир, а не чрезмерное расширение полномочий сразу.

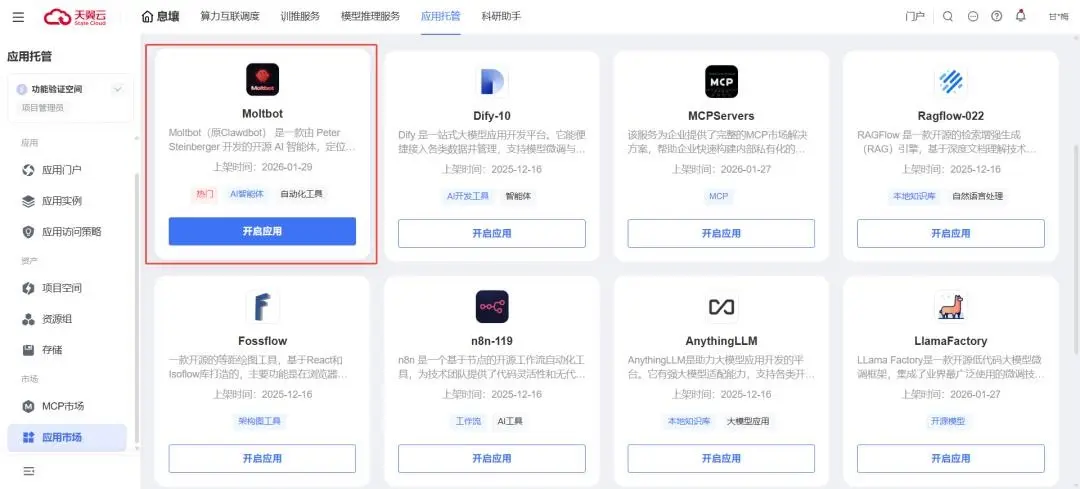

Это видно в стратегиях ведущих облачных и технологических компаний. Например, Tianyi Cloud недавно запустила сервис быстрого развертывания OpenClaw в облаке.

Облачные провайдеры превращают его в продукт, что ускоряет внедрение и масштабирование. Более низкий порог, лучшее интегрирование и стабильная инфраструктура позволяют бизнесу быстрее использовать агентов. Но при этом, подключая «агентов с высокими правами», риски тоже растут.

Тань Чэн отметил, что за последние три года скорость развития от диалоговых моделей до полноценных агентов значительно превзошла ожидания: «Это было невозможно представить три года назад». Он считает, что «следующие два-три года — решающий период для общего искусственного интеллекта», и для специалистов и для обычных людей это — новые возможности и надежды.

Несмотря на быстрый рост OpenClaw и Modelbook, Ху Ся считает, что «в целом риски всё ещё управляемы, и это подтверждает необходимость создания системы ‘внутренней безопасности’. Но важно помнить, что AI движется быстрее, чем мы думаем, — он всё ближе к границам человеческой ‘безопасной зоны’». Поэтому нужно не только укреплять эти границы, но и развивать способность «поднимать стол» в критический момент, чтобы обеспечить окончательную безопасность в эпоху AI.