Anthropic обвиняет 3 китайские компании в использовании AI-обучения! Пользователи критикуют двойные стандарты: вы тоже крадете авторские права

Anthropic обвиняет три китайские компании по искусственному интеллекту DeepSeek, Moonshot AI и Min в использовании метода дистилляции для копирования их моделей. Этот шаг вызвал насмешки в сети, поскольку пользователи отмечают, что такие действия также нарушают авторские права, а также спровоцировали дебаты в США о экспорте чипов и национальной безопасности.

Anthropic обвиняет 3 китайские ИИ-лаборатории в дистилляционной тренировке, захвате передовых возможностей моделей

Разработчик чат-бота Claude, компания Anthropic, публично обвинила три китайские ИИ-лаборатории DeepSeek, Moonshot AI и MiniMax в том, что они создали более 24 000 фальшивых аккаунтов для доступа к данным и обмена ими с моделью Claude более 16 миллионов раз, а также использовали технологию дистилляции, чтобы перенести основные способности Claude в свои собственные модели.

«Дистилляция» — это распространённая техника обучения ИИ, при которой более старые или крупные и зрелые модели оценивают качество ответов новых моделей, позволяя меньшим и менее затратным моделям учиться и переносить вычислительные результаты крупных моделей.

Изначально технология дистилляции использовалась в индустрии ИИ как легальный способ создания облегчённых моделей для клиентов, однако конкуренты также могут использовать её для прямого копирования исследований других лабораторий.

Anthropic указывает, что эти три китайские ИИ-лаборатории использовали прокси-серверы для обхода обнаружения и массово захватывали наиболее отличительные способности Claude, такие как логика, использование инструментов и программирование.

Источник изображения: X Anthropic обвиняет 3 китайские ИИ в дистилляционной тренировке, захвате передовых возможностей моделей

Пользователи критикуют двойные стандарты, Anthropic сталкивается с судебными исками по авторским правам

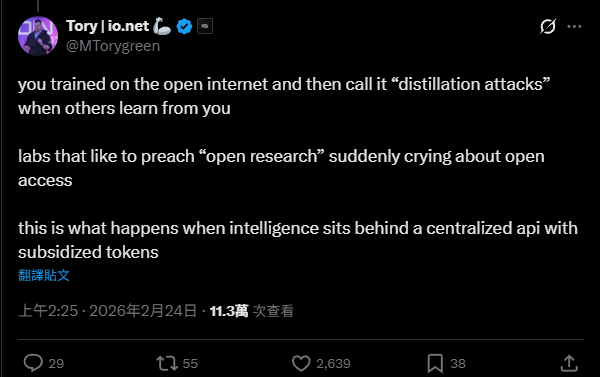

Однако после публикации заявления Anthropic вызвало волну насмешек и критики в сети. Некоторые считают, что Anthropic проявляет двойные стандарты в отношении методов обучения моделей.

Соучредитель компании по инфраструктуре ИИ IO.Net Tory Green написал, что компании используют открытые интернет-данные для обучения, а когда другие учатся у них, называют это атакой дистилляции. В то время как Anthropic громко заявляла о необходимости открытых исследований, теперь она жалуется на открытый доступ.

В 2025 году известный форум Reddit подал в суд на Anthropic, обвиняя компанию в несанкционированном сборе более 100 000 постов и комментариев на форуме для дообучения модели Claude. Reddit утверждает, что Anthropic нарушила пользовательское соглашение и, несмотря на публичные заявления о прекращении сбора данных, продолжала обращаться к серверам Reddit более чем 100 000 раз.

Кроме того, Anthropic также подала коллективный иск за использование 7 миллионов книг без лицензии для обучения модели Claude, и в прошлом году согласилась выплатить до 1,5 миллиарда долларов в качестве компенсации, что стало крупнейшей в истории США выплатой по авторским правам, хотя суд должен утвердить этот компромисс.

- **Дополнительные материалы:**Самый крупный иск о возмещении ущерба в истории ИИ! Использование нелицензированных книг для обучения Claude, компенсация 48 миллиардов долларов, тайваньские авторы также получили выплаты

OpenAI также выдвинуло аналогичные предупреждения против DeepSeek

Помимо Anthropic, крупные игроки в области ИИ, такие как OpenAI, также сталкиваются с подобными проблемами.

По внутренней памятке, полученной «Рейтером» на прошлой неделе, OpenAI предупредила американских законодателей, что DeepSeek целится на разработчика ChatGPT и ведущие американские ИИ-компании, пытаясь копировать модели и использовать их для обучения своих алгоритмов.

Наблюдения показывают, что аккаунты, связанные с сотрудниками DeepSeek, разрабатывают различные методы обхода ограничений доступа OpenAI. Используя запутанные маршрутизаторы третьих сторон и скрытые источники, они получают доступ к американским моделям искусственного интеллекта и извлекают результаты для дистилляционного обучения.

Споры о технологиях дистилляции в Китае на фоне ослабления экспортных ограничений на чипы в США

Когда американские гиганты ИИ обвиняют Китай в использовании технологий дистилляции для обучения, США находятся в чувствительном периоде дебатов о политике экспорта чипов в Китай. В январе администрация Трампа официально разрешила компаниям, таким как Nvidia, экспортировать передовые чипы H200 в Китай.

Критики считают, что в ключевой момент глобальной конкуренции за лидерство в ИИ, ослабление экспортных ограничений значительно увеличит возможности Китая в области ИИ.

Дмитрий Альперович, председатель аналитического центра Silverado Policy Accelerator, заявил, что ускоренное развитие китайских моделей ИИ частично связано с использованием технологий дистилляции для кражи передовых американских моделей. Эти доказательства дают более убедительные основания для того, чтобы США отказались продавать этим компаниям любые чипы для ИИ, иначе их преимущества только возрастут.

Anthropic предупреждает, что системы ИИ, созданные американскими компаниями, имеют механизмы защиты от использования их в биологическом оружии или для вредоносных кибератак. Однако модели, созданные с помощью технологии дистилляции, зачастую лишены таких мер безопасности.

Anthropic выражает опасение, что если зарубежные лаборатории смогут интегрировать эти неограниченные возможности в военные и разведывательные системы, авторитарные правительства смогут использовать ИИ для проведения атак в киберпространстве, распространения дезинформации и масштабного слежения, что значительно увеличит риски для безопасности.

Дополнительная информация:

Китайские хакеры начали масштабную кибератаку с использованием ИИ! Anthropic: скорость и масштаб кибератак с помощью ИИ превзошли человеческих хакеров