OpenAI заявляет о наличии «красных линий» безопасности в сделке с Пентагоном — но пользователи не верят в это

Кратко

- OpenAI подписала соглашение с Пентагоном о развертывании ИИ в секретных средах.

- Компания заявила, что установила «красные линии», но контракт допускает «все законные цели», что в конечном итоге зависит от интерпретации правительства.

- Этот скандал вызвал движение QuitGPT и привел к росту скачиваний Claude.

OpenAI на этих выходных объявила о достижении соглашения с Пентагоном о развертывании передовых систем ИИ в секретных средах, что означает значительное расширение сотрудничества компании с вооруженными силами США. Объявление последовало менее чем через 24 часа после того, как администрация Трампа внесла Anthropic в черный список, обозначив конкурента в области ИИ как «угрозу цепочке поставок национальной безопасности» после спора о формулировках контракта, связанных с наблюдением и автономным оружием. Президент Дональд Трамп также распорядился немедленно прекратить использование технологий Anthropic, а министр финансов Скотт Бессент в понедельник в X написал, что агентство «прекращает все использование продуктов Anthropic, включая платформу Claude, в нашем ведомстве».

"Соединенные Штаты Америки никогда не позволят радикальной левой, woke-компании диктовать, как наша армия ведет и выигрывает войны! Это решение принадлежит ВАШЕМУ командиру — командующему и выдающимся лидерам, которых я назначаю для управления нашей армией.

Левые безумцы из Anthropic… pic.twitter.com/aIEx92nnyx

— Белый дом (@WhiteHouse) 27 февраля 2026 г.

Сроки анонсов ИИ привели к тому, что сделка OpenAI оказалась под пристальным вниманием. В подробном блоге компания изложила, что она называет «красными линиями» и слоями мер безопасности, регулирующими партнерство с Пентагоном. Согласно OpenAI, соглашение поднимает более широкие вопросы о том, как системы ИИ будут регулироваться в национальной безопасности и как практическое толкование и исполнение заявленных ограничений будет происходить. Когда «законно» недостаточно В блоге OpenAI говорится о трех обязательствах, которые представлены как неотъемлемые: запрет на использование технологий для массового внутреннего наблюдения, самостоятельного управления автономным оружием или для высокорискованных автоматизированных решений, таких как социальный кредит. Затем идет конкретный язык контракта — который OpenAI называет «соответствующим языком», а не «полным соглашением».

«Министерство войны может использовать систему ИИ для всех законных целей, соответствующих применимому законодательству, операционным требованиям и установленным протоколам безопасности и надзора», — говорится в заявлении OpenAI. Это именно та формулировка, которую Anthropic утверждала, что правительство требовало на протяжении переговоров. Именно эта формулировка, с которой Anthropic отказалась согласиться. OpenAI подписала ее, но утверждает, что ее «красные линии» остаются полностью в силе. Однако «законность» в контексте национальной безопасности — не фиксированная граница — она существует внутри сложной системы законов, исполнительных указов, внутренних директив и часто засекреченных юридических интерпретаций. Когда контракт допускает «все законные цели», практический предел определяется текущим юридическим полем правительства, а не независимым стандартом, установленным поставщиком. Группа условий Положения о оружии гласят, что система ИИ «не будет использоваться для самостоятельного управления автономным оружием в случаях, когда закон, регуляции или политика ведомства требуют человеческого контроля». Запрет действует только там, где уже требуется человеческое управление — он полностью основан на существующей политике, в частности, директиве DoD 3000.09. Эта директива требует, чтобы автономные системы позволяли командующим осуществлять «соответствующий уровень человеческого суждения» при использовании силы. И «соответствующий» — настолько субъективный термин, насколько это возможно. Человеческое суждение — не то же самое, что человеческий контроль. Этот различие не случайно. Защитные ученые отмечали, что исключение формулировки «человек в цепочке» было сделано специально, чтобы сохранить операционную гибкость.

Самая сильная контраргументация OpenAI — это архитектура развертывания только в облаке — полностью автономные смертельные решения потребовали бы развертывания на периферийных устройствах на поле боя, что в этом контракте не разрешено. Это реальное техническое ограничение. Но облачный ИИ все равно может выполнять идентификацию целей, анализ паттернов поведения и планирование миссий. Эти действия входят в цепочку убийства независимо от того, на каком сервере работает модель. Итог по цели не меняется в зависимости от сервера. Положение о наблюдении следует аналогичной логике. Заявленная «красная линия» OpenAI — запрет на массовое внутреннее наблюдение. В контракте указано, что система «не должна использоваться для неограниченного мониторинга частной информации граждан США» — при этом перечислены Четвертая поправка, FISA и Исполнительный указ 12333. Слово «неограниченный» подразумевает, что ограниченная версия массового наблюдения допустима. А EO 12333 — это исполнительный указ, который NSA использует для оправдания перехвата коммуникаций американцев за пределами США. Здесь проявляется обеспокоенность Anthropic по поводу формулировок в ходе переговоров. Их аргумент — что текущие законы не успели за возможностями ИИ. Правительство может легально приобретать огромные объемы агрегированных коммерческих данных о гражданах США без ордера — и уже делает это. Язык контракта OpenAI, закрепляя защиту в рамках существующих правовых рамок, может не закрывать ту брешь, о которой беспокоился Anthropic. Ответ Altman В субботу вечером Altman провел AMA, отвечая на тысячи вопросов о сделке. Когда его спросили, что заставит OpenAI отказаться от партнерства с правительством, он ответил: «Если нас попросят сделать что-то неконституционное или незаконное, мы уйдем.»

Если нас попросят сделать что-то неконституционное или незаконное, мы уйдем. При необходимости приходите ко мне в тюрьму.

— Сэм Альтман (@sama) 1 марта 2026 г.

Этот подход ограничивает OpenAI рамками законности — а не этической оценки того, что компания готова или не готова разрешить, если это будет законно, что защищает Anthropic. На вопрос о возможных будущих спорах о том, что считать «законным», он признал риск: «Если придется бороться с этим, мы будем, но это явно несет определенные риски.» Почему OpenAI заключила сделку, а Anthropic — нет, Альтман объяснил так: «Anthropic казалась более сосредоточенной на конкретных запретах в контракте, чем на применимых законах, с чем мы чувствовали себя комфортно. Я явно предпочел бы полагаться на технические меры безопасности, если бы мне пришлось выбирать. Думаю, Anthropic хотел больше операционного контроля, чем мы.» Это существенная философская разница. Anthropic утверждает, что поскольку передовые модели могут быть перепрофилированы для разведки и военных задач, границы должны быть четко прописаны и обязательны, даже ценой сделки. Позиция OpenAI — что техническая архитектура, закрепленный персонал и существующее право вместе создают более надежную защиту, чем просто контрактный текст. Общественное мнение разделилось

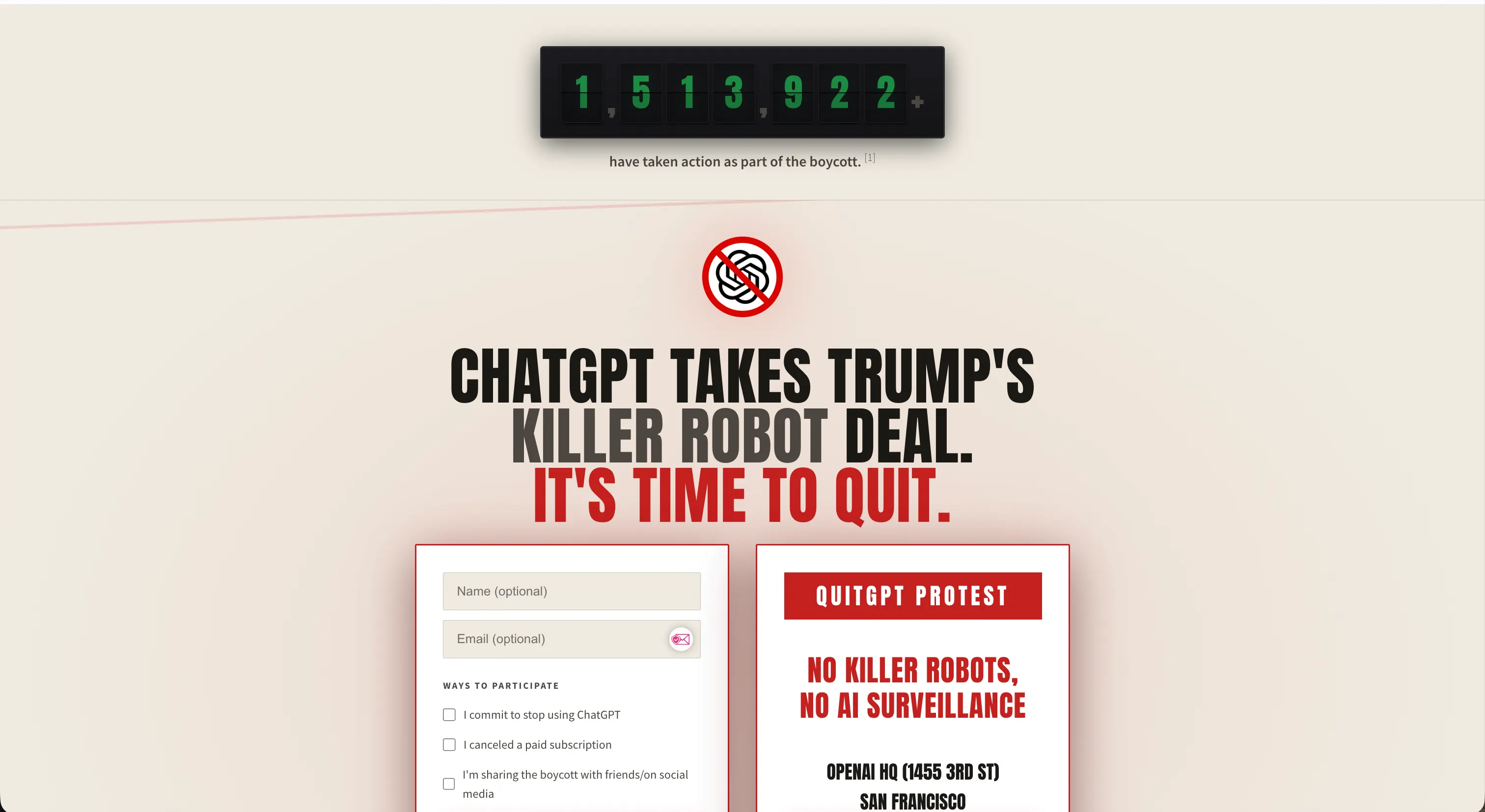

Обратная реакция была мгновенной. К понедельнику движение QuitGPT заявило, что более 1,5 миллиона человек предприняли действия — отменили подписки, делились постами бойкота или регистрировались на quitgpt.org.

Кампания обвинила OpenAI в приоритете военных контрактов над безопасностью пользователей, утверждая, что компания согласилась позволить Пентагону использовать свои технологии «для любых законных целей, включая убийственные роботы и массовое наблюдение».

OpenAI может оспорить это описание. Но рынок уже отреагировал.

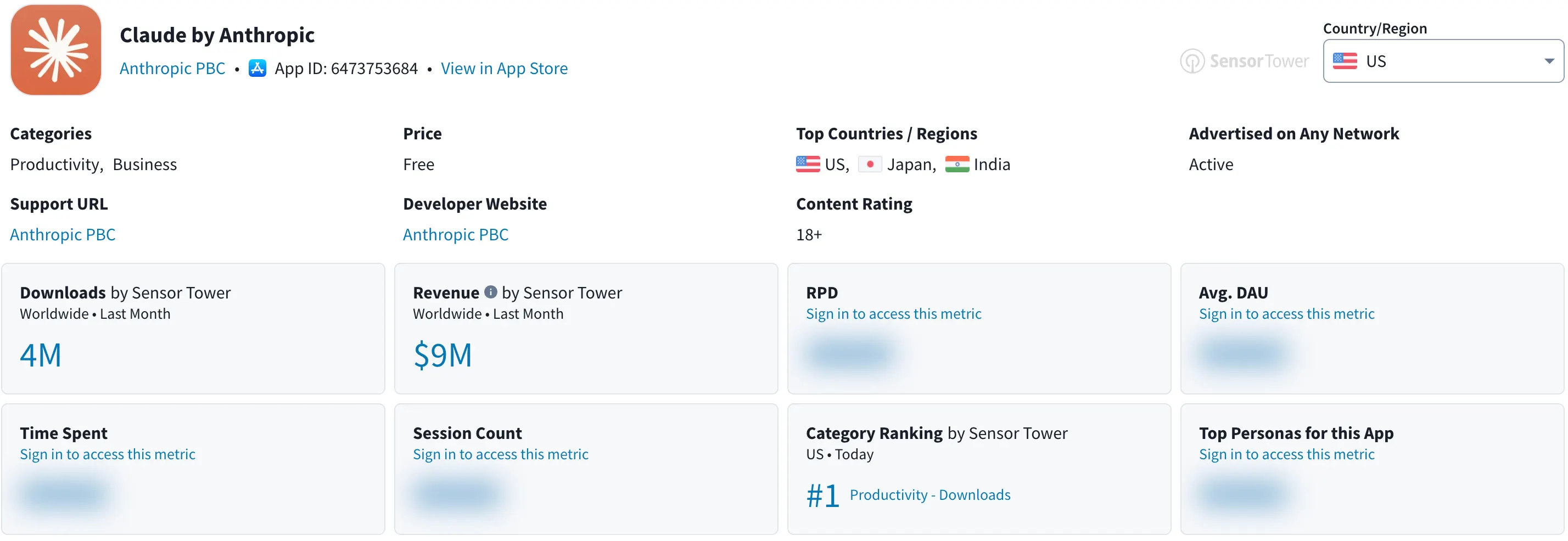

Claude от Anthropic обогнал ChatGPT и стал самой скачиваемой бесплатной программой в США в App Store, сообщили Decrypt, отметив рекордные ежедневные регистрации за выходные.

Звезда поп-музыки Кэти Перри опубликовала скриншот страницы цен Claude в X. сотни пользователей публично отменяли подписки на Reddit. Граффити в поддержку Anthropic появлялись у их офисов в Сан-Франциско, а на тротуарах OpenAI устраивали меловые атаки. Даже сотни сотрудников OpenAI ранее подписали открытое письмо в поддержку отказа Anthropic подчиняться требованиям Пентагона.

Образ QuitGPT эмоционально убедителен, но не полностью точен. Сам Anthropic имеет партнерство с Palantir и Amazon Web Services, которое дает доступ агентствам разведки и оборонным ведомствам США к моделям Claude, и, по сообщениям, использовалось в военных операциях по свержению правительств Венесуэлы и Ирана. Эти этические вопросы ИИ и контрактов с национальной безопасностью никогда не были однозначными. Что действительно зафиксировано — это то, что значительная часть пользователей считает, что существует существенная разница в том, как обе компании определяют свои границы — и голосует за это, отменяя подписки. Насколько эта разница действительно важна, зависит от внимательного изучения контракта.