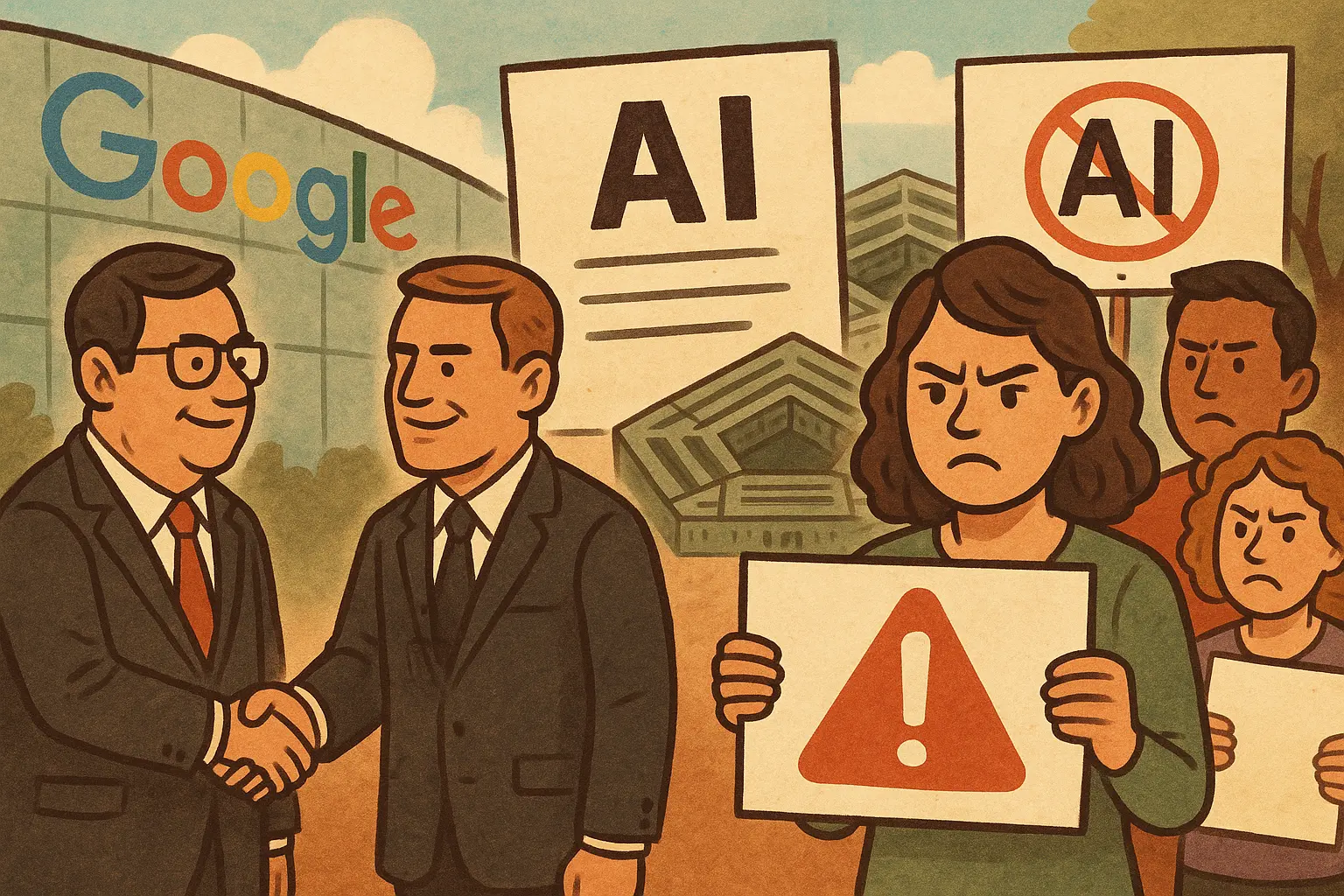

Google и Пентагон подписали секретное соглашение по ИИ, сотрудники направили открытое письмо против

Согласно сообщению The Information от 28 апреля, Google подписала соглашение, чтобы предоставить Пентагону модели искусственного интеллекта (AI) для выполнения конфиденциальной работы. The New York Times, ссылаясь на источники, знакомые с ситуацией, сообщила, что это соглашение позволяет Министерству обороны США использовать AI Google для законных целей правительства, по характеру оно совпадает с соглашениями о конфиденциальном развертывании AI, которые Пентагон в прошлом месяце подписал с OpenAI и xAI.

Содержание соглашения и фон с участием нескольких сторон

Согласно сообщению The New York Times со ссылкой на информированных источников, соглашение Google с Пентагоном позволяет DoD использовать модели AI Google в конфиденциальной работе. В прошлом месяце Пентагон уже завершил аналогичные соглашения с OpenAI и xAI, разрешающие развертывание AI-моделей в конфиденциальных сетях; соглашение Google является последним примером расширения сотрудничества Пентагона в сфере AI.

Представитель Google в разговоре с The New York Times заявил: «Мы рады быть частью широкой коалиции, в которую входят ведущие AI-лаборатории, технологические и облачные компании, предоставляя услуги AI и инфраструктуру для национальной безопасности». Decrypt обратился к Google с просьбой прокомментировать, и на момент публикации сообщения Google пока не ответила.

Открытое письмо сотрудников: призыв отказаться от конфиденциальных рабочих нагрузок

Согласно сообщению The New York Times, перед подписанием соглашения сотни сотрудников Google уже объединились и направили открытое письмо генеральному директору Сундару Пичаи (Sundar Pichai), призывая компанию не предоставлять Пентагону AI-системы для конфиденциальной работы.

В открытом письме говорится: «Мы хотим, чтобы AI приносил пользу человечеству, а не использовался для бесчеловечных или крайне вредных целей. В настоящее время единственный способ гарантировать, что Google не окажется связанным с такими угрозами, — отказаться от любых конфиденциальных рабочих нагрузок. В противном случае такие применения могут произойти без нашего ведома или без возможности их остановить».

В письме в качестве основных опасений перечислены «смертоносное автономное оружие и массовый надзор», при этом предупреждается, что «сейчас неверно принятое решение нанесет непоправимый ущерб репутации Google, его бизнесу и положению в мире».

Процесс интеграции AI в Пентагоне и кейс Anthropic

Согласно сообщению The New York Times, министр обороны США Пит Хегсетс (Pete Hegseth) в январе этого года на выступлении на Starbase Илона Маска (Elon Musk) заявил: «Соединенные Штаты должны выиграть стратегическое соперничество за технологическое лидерство в XXI веке», а также сказал, что «каждая не конфиденциальная и конфиденциальная сеть нашего ведомства будет в скором времени развертывать самые передовые модели AI». С тех пор Пентагон ускорил шаги по достижению соглашений с ключевыми компаниями AI.

В соответствующем контексте, согласно сообщениям, в марте этого года Пентагон внес Anthropic в список компаний «риска для цепочки поставок» из-за того, что генеральный директор Anthropic Дарио Амодей (Dario Amodei) отказался разрешить федеральному правительству неограниченно использовать его модели AI; затем Anthropic подала иск против Пентагона по этой оценке и добивается продолжения сотрудничества с другими правительственными структурами.

Часто задаваемые вопросы

Какие применения допускает конфиденциальное AI-соглашение Google с Пентагоном?

Согласно сообщению The New York Times со ссылкой на информированных источников, соглашение позволяет DoD использовать AI Google для «любых законных целей правительства». Представитель Google заявил, что компания придерживается позиции, согласно которой AI не должен применяться для крупномасштабного внутреннего надзора или автономного оружия без человеческого надзора.

С какими компаниями AI Пентагон заключил аналогичные соглашения?

Согласно сообщению The New York Times, Пентагон в прошлом месяце заключил соглашения с OpenAI и xAI соответственно, разрешающие развертывание AI в конфиденциальных сетях; соглашение Google является последним примером подобного сотрудничества.

Какова позиция Anthropic по похожим вопросам?

Согласно сообщениям, в марте этого года Пентагон внес Anthropic в список компаний «риска для цепочки поставок», поскольку Anthropic отказалась разрешить федеральному правительству неограниченно использовать его модели AI; затем Anthropic подала иск против Пентагона по этой оценке и добивается продолжения сотрудничества с другими правительственными структурами.

Связанные статьи

AI-платформа Certifyde привлекает $2M в посевном финансировании вместе с CEO Ripple Брэдом Гарлингхаусом

DeepSeek запускает функцию распознавания изображений в бета-тестировании

Anthropic Запускает 8 Коннекторов для Творческих Инструментов для Claude, Включая Blender, Adobe, Autodesk

Белый дом обходит оценку рисков Пентагона, чтобы развернуть модель Mythos от Anthropic 29 апреля

Cognizant приобретет Astreya за $600M , чтобы расширить бизнес по развитию инфраструктуры ИИ

30 вредоносных плагинов на ClawHub, замаскированных под AI-инструменты, скачаны более 9 800 раз