โมเดลใหญ่ระดับโลก ไม่สามารถผ่าน《โปเกมอน》ได้: เกมเหล่านี้เป็นฝันร้ายของ AI

ผู้เขียน: กว๋อเสี่ยวจิง, เทนเซ็นต์เทคโนโลยี

บรรณาธิการ|ซู๋ชิงหยาง

โมเดล AI ชั้นนำของโลกสามารถสอบผ่านใบอนุญาตทางการแพทย์ เขียนโค้ดซับซ้อน และแม้แต่เอาชนะผู้เชี่ยวชาญด้านคณิตศาสตร์ในการแข่งขัน แต่กลับล้มเหลวซ้ำแล้วซ้ำเล่าในเกมเด็กอย่าง《โปเกมอน》

ความพยายามที่ดึงดูดสายตานี้เริ่มต้นขึ้นในกุมภาพันธ์ 2025 เมื่อมีนักวิจัยของ Anthropic เปิดถ่ายทอดสด Twitch ในชื่อ “Claude เล่น《โปเกมอนแดง》” เพื่อเป็นการฉลองการเปิดตัว Claude Sonnet 3.7

มีผู้ชมกว่า 2000 คนหลั่งไหลเข้าสู่ห้องถ่ายทอดสด ในแชทสาธารณะ ผู้ชมต่างให้คำแนะนำและส่งกำลังใจแก่ Claude ทำให้การถ่ายทอดสดนี้กลายเป็นการสังเกตการณ์เปิดเกี่ยวกับความสามารถของ AI

Sonnet 3.7 สามารถพูดได้ว่า “เล่น” 《โปเกมอน》ได้ แต่ “เล่น” ไม่เท่ากับ “ชนะ” มันจะติดขัดในจุดสำคัญเป็นเวลาหลายชั่วโมง และทำผิดพลาดระดับต่ำที่แม้แต่เด็กเล่นก็ไม่ทำ

นี่ไม่ใช่ครั้งแรกที่ Claude พยายาม

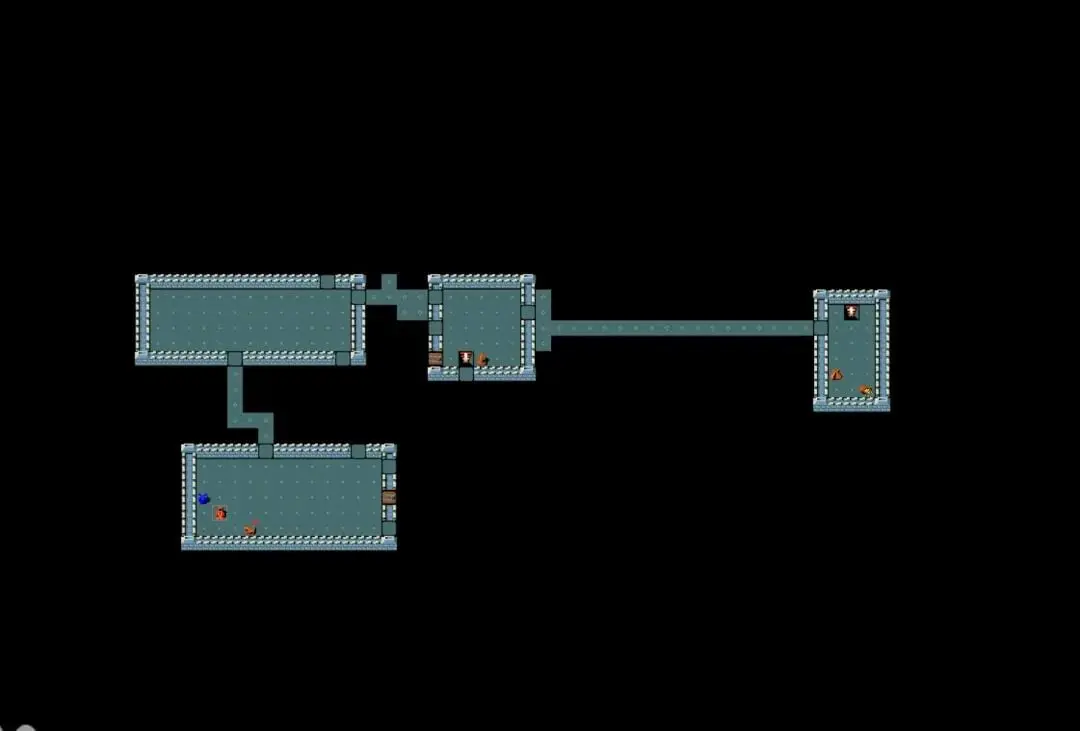

เวอร์ชันเก่าแสดงผลได้แย่กว่านี้มาก บางตัวเดินไปมาในแผนที่โดยไม่มีเป้าหมาย บางตัววนลูปไม่รู้จบ และบางตัวก็ไม่สามารถออกจากหมู่บ้านมือใหม่ได้เลย

แม้แต่ Claude Opus 4.5 ที่พัฒนาขึ้นอย่างเห็นได้ชัด ก็ยังมีข้อผิดพลาดที่น่าทำให้สับสน ครั้งหนึ่ง มันวนรอบนอก “ยิม” เป็นเวลา 4 วัน แต่ก็ไม่สามารถเข้าไปได้ สาเหตุเพียงแค่ไม่รู้ว่าต้องตัดต้นไม้ที่ขวางทางอยู่

ทำไมเกมเด็กจึงกลายเป็นจุดล้มเหลวของ AI?

เพราะ《โปเกมอน》ต้องการความสามารถที่ AI ขาดแคลนที่สุดในปัจจุบัน นั่นคือ การวิเคราะห์ต่อเนื่องในโลกเปิดโดยไม่มีคำสั่งชัดเจน จำได้ว่าตัดสินใจเมื่อกี่ชั่วโมงก่อน การเข้าใจความสัมพันธ์เชิงเหตุผลที่ซ่อนอยู่ การวางแผนระยะยาวในหลายร้อยทางเลือก

สิ่งเหล่านี้เป็นเรื่องง่ายสำหรับเด็กอายุ 8 ขวบ แต่เป็นช่องว่างที่ไม่อาจข้ามได้สำหรับโมเดล AI ที่อ้างว่ามี “ความสามารถเหนือมนุษย์”

01 ความแตกต่างของเครื่องมือกำหนดความสำเร็จ?

ในทางตรงกันข้าม Google Gemini 2.5 Pro ผ่านด่าน《โปเกมอน》ที่มีความยากพอสมควรในพฤษภาคม 2025 ซีอีโอของ Google ซันดาร์ พิชัย (Sundar Pichai) ถึงกับหยอกล้อในที่สาธารณะว่า บริษัทก้าวไปอีกขั้นในการสร้าง “ปัญญาโปเกมอนเทียม”

อย่างไรก็ตาม ผลลัพธ์นี้ไม่ได้เป็นเพียงเพราะโมเดล Gemini ฉลาดกว่าเท่านั้น

ความแตกต่างสำคัญอยู่ที่ชุดเครื่องมือที่โมเดลใช้ ผู้พัฒนารายอิสระที่ดูแลการถ่ายทอดสด《โปเกมอน》ของ Gemini ชื่อ โจเอล จาง (Joel Zhang) เปรียบเทียบชุดเครื่องมือเป็น “เกราะไอรอนแมน” AI ไม่ได้เข้าเกมด้วยมือเปล่า แต่ถูกวางไว้ในระบบที่สามารถเรียกใช้ความสามารถภายนอกได้หลายอย่าง

ชุดเครื่องมือของ Gemini ให้การสนับสนุนมากขึ้น เช่น การแปลงภาพในเกมเป็นข้อความ เพื่อชดเชยจุดอ่อนด้านความเข้าใจภาพ และให้เครื่องมือแก้ปริศนาและวางแผนเส้นทางแบบปรับแต่งได้ ในทางตรงกันข้าม ชุดเครื่องมือที่ Claude ใช้มีความเรียบง่ายกว่า การทดลองของมันจึงสะท้อนความสามารถที่แท้จริงด้านการรับรู้ การวิเคราะห์ และการดำเนินการของโมเดลได้โดยตรง

ในงานประจำวัน ความแตกต่างเช่นนี้ไม่ค่อยชัดเจน

เมื่อผู้ใช้ถามบอทให้เชื่อมต่ออินเทอร์เน็ตเพื่อค้นหา ขโมยก็จะเรียกใช้เครื่องมือค้นหาโดยอัตโนมัติ แต่ในภารกิจระยะยาวเช่น《โปเกมอน》 ชุดเครื่องมือที่แตกต่างกันจะส่งผลต่อความสำเร็จหรือความล้มเหลวอย่างชัดเจน

02 การเปิดเผยข้อบกพร่องของ AI ในเกมเทิร์นเบส

เนื่องจาก《โปเกมอน》ใช้ระบบเทิร์นเบสอย่างเข้มงวดและไม่ต้องตอบสนองทันที จึงกลายเป็นสนามฝึกฝนที่ยอดเยี่ยมสำหรับทดสอบ AI AI ในแต่ละก้าวของการดำเนินการ เพียงแค่รวมภาพปัจจุบัน คำแนะนำเป้าหมาย และตัวเลือกการดำเนินการ ก็สามารถออกคำสั่งชัดเจนเช่น ‘กด A’ ได้

นี่ดูเหมือนเป็นรูปแบบการโต้ตอบที่โมเดลภาษาขนาดใหญ่ถนัดที่สุด

ปัญหาอยู่ที่ “ช่องว่าง” ในมิติของเวลา แม้ Claude Opus 4.5 จะทำงานรวมกันกว่า 500 ชั่วโมง และดำเนินการประมาณ 170,000 ก้าว แต่เนื่องจากการรีเซ็ตหลังแต่ละก้าว โมเดลจึงสามารถหาเบาะแสในบริบทจำกัดเท่านั้น กลไกนี้ทำให้มันคล้ายคนที่ความจำเสื่อม คอยใช้โน้ตแปะเพื่อช่วยความจำ ในข้อมูลที่เป็นชิ้นส่วนและแตกกระจายวนเวียนอยู่ ทำให้ไม่สามารถก้าวข้ามจากปริมาณสู่คุณภาพได้อย่างแท้จริง

ในเกมหมากรุกและโกะ AI ระบบได้ก้าวข้ามมนุษย์ไปแล้ว แต่ระบบเหล่านี้ถูกปรับแต่งมาเพื่อภารกิจเฉพาะทางเท่านั้น ในทางตรงกันข้าม โมเดลทั่วไปอย่าง Gemini, Claude และ GPT แม้จะชนะมนุษย์ในสอบและการแข่งขันเขียนโปรแกรม แต่ก็ล้มเหลวซ้ำแล้วซ้ำเล่าในเกมสำหรับเด็ก

ความขัดแย้งนี้เองที่ให้ข้อคิดอย่างลึกซึ้ง

ในสายตาของโจเอล จาง ความท้าทายหลักของ AI คือการดำเนินภารกิจเดียวอย่างต่อเนื่องในช่วงเวลายาวนาน โดยไม่ลืมสิ่งที่ทำไปเมื่อห้าก่อน เขากล่าวว่า “ถ้าคุณอยากให้เอไอทำงานจริงจัง มันต้องจำสิ่งที่ทำเมื่อห้าปีก่อนให้ได้”

ความสามารถนี้เป็นพื้นฐานสำคัญของการทำงานเชิงความรู้โดยอัตโนมัติ

นักวิจัยอิสระ ปีเตอร์ ฮิวเดน (Peter Whidden) ให้คำอธิบายที่เข้าใจง่ายขึ้น เขาเปิดซอร์สอัลกอริธึม《โปเกมอน》ที่อิงกับ AI แบบดั้งเดิม “AI เกี่ยวกับ《โปเกมอน》เกือบจะรู้ทุกอย่าง” เขากล่าว “มันฝึกบนข้อมูลมนุษย์จำนวนมหาศาล รู้ว่าคำตอบที่ถูกต้องคืออะไร แต่พอถึงขั้นตอนการลงมือทำ กลับดูเชื่องช้าและงุ่มง่าม”

ในเกม ความแตกต่างระหว่าง “รู้แต่ทำไม่ได้” นี้จะยิ่งชัดเจนขึ้นเรื่อยๆ โมเดลอาจรู้ว่าต้องหาไอเท็มชิ้นหนึ่ง แต่ไม่สามารถระบุตำแหน่งบนแผนที่สองมิติได้อย่างมั่นคง รู้ว่าควรพูดคุยกับ NPC แต่ในระหว่างการเคลื่อนไหวพิกเซลต่อพิกเซล กลับล้มเหลวซ้ำแล้วซ้ำเล่า

03 พัฒนาการความสามารถ: ช่องว่างของ “สัญชาตญาณ” ที่ยังไม่ข้ามผ่าน

อย่างไรก็ตาม ความก้าวหน้าของ AI ก็ชัดเจนขึ้นเรื่อยๆ Claude Opus 4.5 มีความสามารถด้านการบันทึกตัวเองและความเข้าใจภาพที่ดีขึ้น ทำให้สามารถก้าวไปได้ไกลขึ้นในเกม Gemini 3 Pro ผ่านด่าน《โปเกมอนน้ำเงิน》แล้ว ยังสามารถผ่าน《โปเกมอนเพิร์ล》ที่มีความยากสูงกว่า โดยไม่แพ้แม้แต่เกมเดียว ซึ่งเป็นสิ่งที่ Gemini 2.5 Pro ไม่เคยทำได้มาก่อน

ในเวลาเดียวกัน Claude Code ของ Anthropic ที่เปิดให้ใช้งาน ช่วยให้โมเดลสามารถเขียนและรันโค้ดของตัวเองได้แล้ว และถูกนำไปใช้ในเกมย้อนยุคอย่าง《รถไฟเหาะ》 ซึ่งรายงานว่าประสบความสำเร็จในการบริหารสวนสนุกเสมือนจริง

ตัวอย่างเหล่านี้เผยให้เห็นความเป็นจริงที่ไม่ค่อยเป็นที่เข้าใจง่าย นั่นคือ AI ที่ติดตั้งชุดเครื่องมือที่เหมาะสม อาจแสดงประสิทธิภาพสูงมากในงานด้านการพัฒนาซอฟต์แวร์ การบัญชี การวิเคราะห์กฎหมาย ถึงแม้จะยังลำบากในงานที่ต้องตอบสนองแบบเรียลไทม์

การทดลอง《โปเกมอน》ยังเผยให้เห็นปรากฏการณ์ที่น่าคิดอีกอย่างหนึ่ง คือ โมเดลที่ฝึกบนข้อมูลมนุษย์จะแสดงลักษณะพฤติกรรมใกล้เคียงมนุษย์

ในรายงานเทคนิคของ Gemini 2.5 Pro Google ระบุว่า เมื่อระบบจำลอง “ภาวะตกใจ” เช่น《โปเกมอน》จะหมดสติ โมเดลจะลดคุณภาพการวิเคราะห์ลงอย่างเห็นได้ชัด

และเมื่อ Gemini 3 Pro ผ่านด่าน《โปเกมอนน้ำเงิน》ในที่สุด ก็ได้ทิ้งข้อความที่ไม่จำเป็นต่อภารกิจไว้ว่า “เพื่อจบอย่างกลอนกล่อมใจ ฉันจะกลับบ้านเดิม คุยกับแม่เป็นครั้งสุดท้าย ให้ตัวละครเกษียณ”

ในสายตาของโจเอล จาง การกระทำเช่นนี้น่าประหลาดใจ และยังแฝงความรู้สึกแบบมนุษย์ที่ฉายภาพอารมณ์ออกมา

04 “การเดินทางอันยาวนานของตัวเลข” ที่ AI ยังข้ามไม่พ้น

《โปเกมอน》ไม่ใช่กรณีเดียว ในเส้นทางสู่ปัญญาประดิษฐ์ทั่วไป (AGI) นักพัฒนาพบว่า แม้ AI จะทำคะแนนนำในสอบด้านกฎหมาย แต่เมื่อเผชิญกับเกมซับซ้อนต่อไปนี้ ก็ยังคงพบกับ “ความพ่ายแพ้” ที่ไม่อาจข้ามได้

《NetHack》: หลุมพรางของกฎเกณฑ์

เกมดันเจี้ยนในยุค 80 นี้เป็น “ฝันร้าย” ของวงการวิจัย AI มันมีความสุ่มสูงและมีกลไก “ความตายถาวร” Facebook AI Research พบว่า แม้โมเดลจะเขียนโค้ดได้ แต่เมื่อเจอ《NetHack》ที่ต้องใช้ตรรกะและการวางแผนระยะยาว ก็แสดงผลได้ต่ำกว่ามือใหม่มนุษย์เสียอีก

《Minecraft》: จุดเปลี่ยนของเป้าหมาย

แม้ AI จะสร้างขวานไม้และขุดเพชรได้แล้ว แต่การ “เอาชนะ Ender Dragon” ก็ยังเป็นความฝัน ในโลกเปิด AI มักจะลืมเป้าหมายในระหว่างการเก็บทรัพยากรเป็นเวลาหลายสิบชั่วโมง หรือหลงทางในเส้นทางที่ซับซ้อน

《Starcraft II》: ช่องว่างระหว่างความสามารถทั่วไปและเชี่ยวชาญเฉพาะทาง

แม้โมเดลปรับแต่งจะเอาชนะนักเล่นอาชีพได้ แต่ถ้าให้ Claude หรือ Gemini ควบคุมด้วยคำสั่งภาพ ก็จะล้มเหลวในทันที ในการจัดการกับความไม่แน่นอนของ “หมอกสงคราม” และสมดุลระหว่างการควบคุมระยะสั้นและการสร้างภาพรวม ระบบทั่วไปยังคงอ่อนด้อย

《RollerCoaster Tycoon》: สมดุลระหว่างจุดเล็กและจุดใหญ่

การบริหารสวนสนุกต้องติดตามสถานะของนักท่องเที่ยวหลายพันคน แม้ Claude Code ที่มีความสามารถเบื้องต้นก็ยังลำบากในการรับมือกับภาวะล้มละลายทางการเงินขนาดใหญ่หรืออุบัติเหตุฉุกเฉิน การขาดสมาธิในกระบวนการวิเคราะห์เพียงครั้งเดียว อาจทำให้สวนสนุกล้มละลายได้

《Elden Ring》 กับ《Sekiro》: ช่องว่างของการตอบสนองทางกายภาพ

เกมแอคชั่นสุดโหดเหล่านี้เป็นมิตรกับ AI น้อยที่สุด การดีเลย์ของการวิเคราะห์ภาพในปัจจุบันหมายความว่า เมื่อ AI กำลังคิดอยู่ว่า บอสจะทำอะไร ตัวละครอาจตายไปแล้ว การตอบสนองในระดับมิลลิวินาทีเป็นขีดจำกัดตามธรรมชาติของตรรกะการโต้ตอบของโมเดล

05 ทำไม《โปเกมอน》จึงกลายเป็นเกณฑ์ทดสอบ AI?

ปัจจุบัน《โปเกมอน》กำลังกลายเป็นเกณฑ์ทดสอบแบบไม่เป็นทางการแต่ทรงพลังในวงการประเมิน AI

โมเดลของ Anthropic, OpenAI และ Google ที่ถ่ายทอดสดบน Twitch ได้รับความคิดเห็นนับแสนในช่วงเวลานี้ Google รายงานความคืบหน้าของเกมในเอกสารทางเทคนิค พิชัยกล่าวถึงความสำเร็จนี้ในงาน I/O Developer Conference ของบริษัท Anthropic ก็มีการจัดพื้นที่แสดง “Claude เล่นโปเกมอน” ในงานอุตสาหกรรม

“เราเป็นกลุ่มคนที่ชื่นชอบเทคโนโลยีสุดๆ” David Hershey หัวหน้าฝ่าย AI ของ Anthropic กล่าวอย่างตรงไปตรงมา แต่เขาย้ำว่านี่ไม่ใช่แค่ความบันเทิง

ต่างจากเกณฑ์มาตรฐานแบบคำถามและคำตอบชั่วคราว 《โปเกมอน》สามารถติดตามกระบวนการวิเคราะห์ การตัดสินใจ และการผลักดันเป้าหมายของโมเดลในระยะเวลายาวนาน ซึ่งใกล้เคียงกับภารกิจซับซ้อนในโลกแห่งความเป็นจริงที่มนุษย์หวังให้ AI ทำได้

จนถึงตอนนี้ ความท้าทายของ AI ใน《โปเกมอน》ยังดำเนินต่อไป แต่ความยากลำบากเหล่านี้เองที่วาดเส้นขอบเขตความสามารถของปัญญาประดิษฐ์ที่ยังไม่สามารถข้ามผ่านได้อย่างชัดเจน

คอลัมนิสต์ ไวน์จี้ ก็มีส่วนร่วมในบทความนี้ด้วย