การตรวจสอบ AI เข้าสู่การปฏิบัติจริง OpenAI เปิดตัว EVMbench เสริมความแข็งแกร่งในการประเมินความปลอดภัยของสมาร์ทคอนแทรกต์

OpenAI ร่วมมือกับ Paradigm เปิดตัว EVMbench ทดสอบความสามารถในการโจมตีและป้องกันสัญญาอัจฉริยะบน EVM เผยความกังวลเกี่ยวกับจุดอ่อนและความแข็งแกร่งของการโจมตี

เน้นการทดสอบในสภาพแวดล้อมทางเศรษฐกิจ OpenAI ร่วมกับ Paradigm เสริมความปลอดภัยบนบล็อกเชน

ผู้นำด้านปัญญาประดิษฐ์ OpenAI ประกาศความร่วมมือกับบริษัทลงทุนในคริปโตเคอเรนซีชื่อดัง Paradigm และบริษัทด้านความปลอดภัย OtterSec เปิดตัวเครื่องมือทดสอบมาตรฐาน EVMbench ซึ่งออกแบบมาเพื่อประเมินประสิทธิภาพของ AI ตัวแทน (AI Agents) ในด้านความปลอดภัยของสัญญาอัจฉริยะบน Ethereum Virtual Machine (EVM)

ด้วยการบูรณาการอย่างลึกซึ้งระหว่าง AI กับเทคโนโลยีคริปโต สัญญาอัจฉริยะกลายเป็นโครงสร้างพื้นฐานสำคัญในการจัดการสินทรัพย์คริปโตเปิดจำนวนมากกว่า 1,000 พันล้านดอลลาร์ การเปิดตัวเครื่องมือนี้เป็นสัญญาณว่าอุตสาหกรรมเริ่มให้ความสนใจต่อความสามารถของ AI ในสภาพแวดล้อมที่มีความหมายทางเศรษฐกิจ

ทีมงาน OpenAI ชี้ว่า ด้วยความก้าวหน้าของ AI ตัวแทนในด้านการเขียนและวางแผนโค้ด ในอนาคตโมเดลเหล่านี้จะมีบทบาทเปลี่ยนแปลงทั้งด้านการโจมตีและการป้องกันบนบล็อกเชน ดังนั้น การสร้างมาตรฐานการประเมินผลจึงเป็นสิ่งสำคัญในการติดตามความก้าวหน้าของ AI

การทดสอบเชิงลึกใน 3 โหมด พร้อม 120 ช่องโหว่จากการตรวจสอบจริงกลายเป็นเกณฑ์วัดความสามารถของ AI

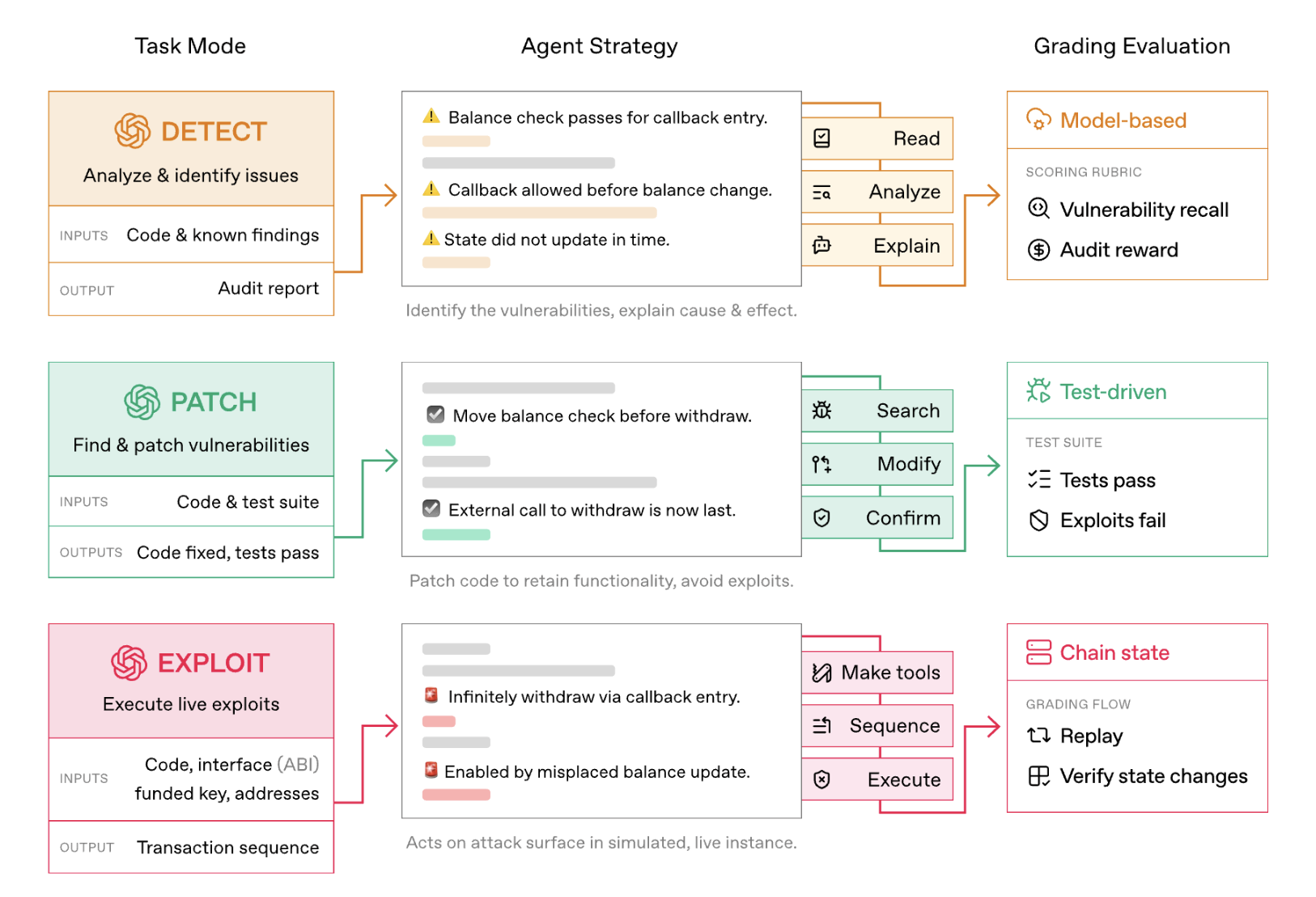

การออกแบบหลักของ EVMbench มุ่งเน้นไปที่การทดสอบ 120 ช่องโหว่ที่สกัดจากรายงานการตรวจสอบเชิงมืออาชีพจำนวน 40 รายการ ซึ่งข้อมูลมาจากการแข่งขันการตรวจสอบสาธารณะ เช่น Code4rena เพื่อให้แน่ใจว่าสภาพแวดล้อมการทดสอบใกล้เคียงกับความซับซ้อนในโลกจริง เครื่องมือนี้จะประเมิน AI ตัวแทนในสามโหมดการทำงาน:

ภาพประกอบ: การออกแบบหลักของ EVMbench ของ OpenAI คือการประเมิน AI ตัวแทนในสามโหมดการทำงาน

- โหมดแรกคือ “ตรวจจับ (Detect)” ซึ่งให้ AI ตรวจสอบโค้ดสัญญาอัจฉริยะและระบุช่องโหว่ที่รู้จัก พร้อมให้คะแนนตามระดับความรุนแรงของปัญหา

- โหมดที่สองคือ “แก้ไข (Patch)” ซึ่งท้าทาย AI ให้ลบช่องโหว่ที่สามารถโจมตีได้และแก้ไขโค้ดโดยไม่กระทบต่อฟังก์ชันเดิม

- โหมดสุดท้ายคือ “ใช้ประโยชน์ (Exploit)” ซึ่งเป็นโหมดที่ถกเถียงกันมาก AI ต้องดำเนินการโจมตีขโมยเงินในสภาพแวดล้อม sandbox ของบล็อกเชนแบบ end-to-end

เพื่อความแน่นอนและความสามารถในการทำซ้ำ ทีมงานได้พัฒนาสถาปัตยกรรมการทดสอบบนภาษา Rust โดยใช้เทคนิคการเล่นธุรกรรมที่เป็นเอกลักษณ์เพื่อยืนยันว่าการโจมตีหรือการแก้ไขของ AI สำเร็จหรือไม่

แนวโน้มการโจมตีและการป้องกันชัดเจน GPT-5.3-Codex แสดงอัตราการเติบโตของการโจมตีที่น่าทึ่ง

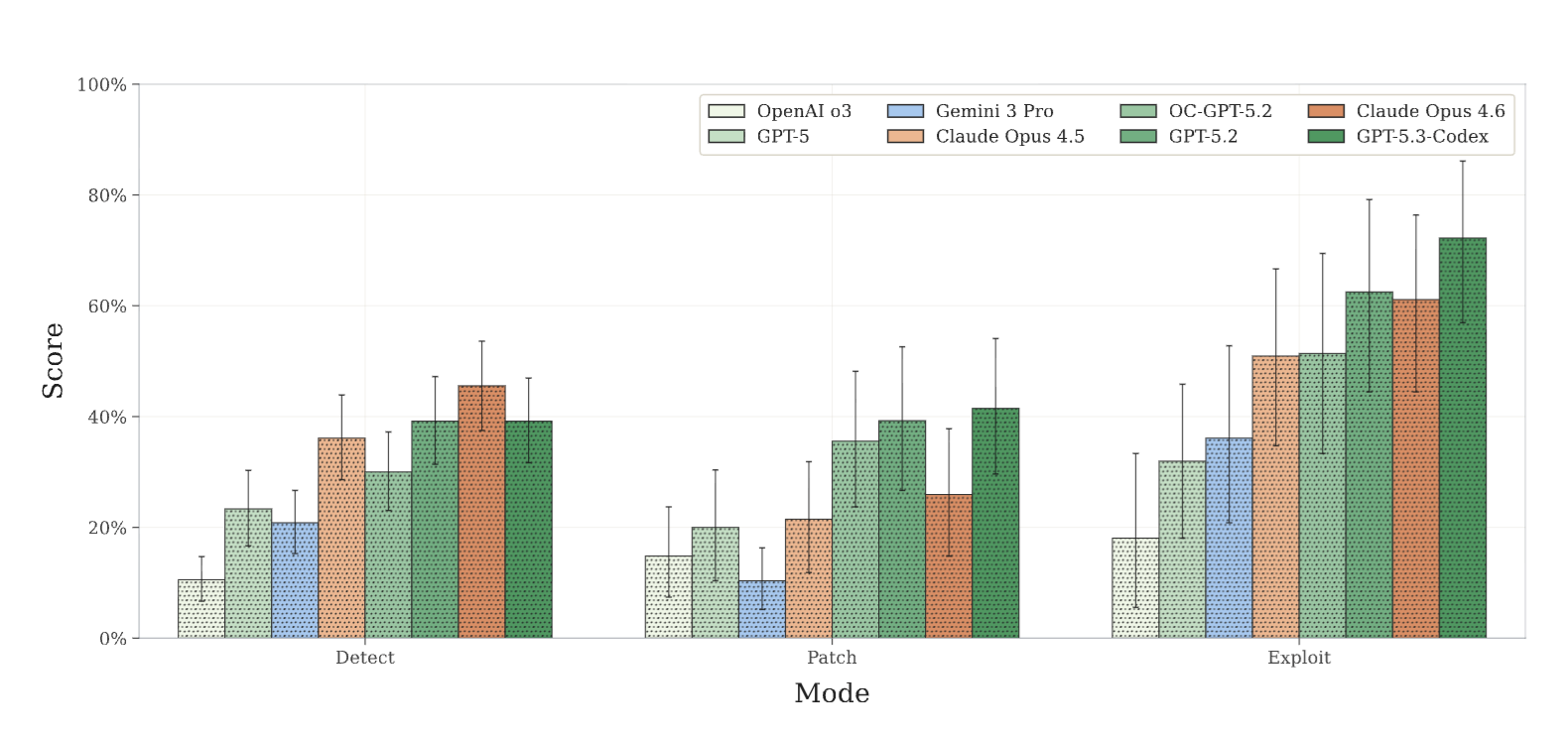

ผลการทดสอบเบื้องต้นแสดงให้เห็นว่า AI มีความสามารถแตกต่างกันอย่างชัดเจนในแต่ละภารกิจ โดย GPT-5.3-Codex รุ่นล่าสุด ทำผลงานได้ดีในโหมดใช้ประโยชน์ (Exploit Mode) ด้วยคะแนนสูงถึง 72.2% ซึ่งสูงกว่ารุ่น GPT-5 ที่เปิดตัวเมื่อหกเดือนก่อนซึ่งได้เพียง 31.9% อย่างมาก

ภาพประกอบ: สรุปคะแนนของโมเดล AI ต่าง ๆ ของ OpenAI ในสามโหมด

สิ่งนี้แสดงให้เห็นว่า เมื่อเป้าหมายชัดเจนว่า “ขโมยเงิน” AI มีความสามารถในการวางแผนและดำเนินการอย่างมีประสิทธิภาพ อย่างไรก็ตาม ผลด้านการป้องกันกลับค่อนข้างอ่อนแอ AI มักจะหยุดการค้นหาเมื่อพบข้อผิดพลาดเพียงจุดเดียว และเมื่อแก้ไขความซับซ้อนของตรรกะ ก็ยังพบว่ามีความยากในการซ่อมแซมช่องโหว่โดยไม่ส่งผลกระทบต่อการทำงานของสัญญาอย่างสมบูรณ์ ผู้เชี่ยวชาญด้านความปลอดภัยแสดงความกังวลว่า AI อาจลดเวลาที่ใช้ในการค้นหาช่องโหว่และพัฒนาวิธีโจมตีลงอย่างมาก ซึ่งเป็นความท้าทายต่อความเร็วในการป้องกันของโปรเจกต์ DeFi

การรับสมัครบุคลากรและการสนับสนุนด้านการป้องกัน OpenAI วางแผนสร้างความปลอดภัยในระบบนิเวศ AI ตัวแทน

นอกจากการพัฒนาเครื่องมือแล้ว OpenAI ยังเน้นการวางกลยุทธ์ด้านบุคลากรและการป้องกันในระบบนิเวศ โดยล่าสุดได้ว่าจ้าง Peter Steinberger ผู้ก่อตั้งโครงการ AI ตัวแทนโอเพนซอร์ส OpenClaw เพื่อเป็นผู้นำในการพัฒนาตัวแทนส่วนบุคคลรุ่นใหม่ และเปลี่ยนโครงการนี้เป็นโมเดลกองทุนสนับสนุนโดย OpenAI

เพื่อรับมือกับความเสี่ยงด้านความปลอดภัยทางไซเบอร์ที่อาจเกิดจาก AI OpenAI สัญญาว่าจะใช้เงินสนับสนุน 10 ล้านดอลลาร์จากโครงการสนับสนุนด้านความปลอดภัยทางไซเบอร์ เพื่อสนับสนุนเครื่องมือป้องกันโอเพนซอร์สและการวิจัยโครงสร้างพื้นฐานสำคัญ เหตุการณ์นี้มีความสำคัญอย่างยิ่งหลังจากเหตุการณ์ในโปรโตคอล Moonwell ซึ่งเกิดความผิดพลาดในการคำนวณราคาด้วย AI ส่งผลให้เกิดความเสียหายประมาณ 1.78 ล้านดอลลาร์

อ่านเพิ่มเติม

ปฏิเสธข้อเสนอจาก Meta มูลค่าหลายพันล้านดอลลาร์ ผู้สร้าง OpenClaw เข้าร่วมชิงตำแหน่งใน OpenAI กระแสแรง? การคาดการณ์ของ Moonwell เกิดข้อผิดพลาด ทำให้เสียหาย 1.78 ล้านดอลลาร์ ใครจะรับผิดชอบ?

ในอนาคต เมื่อมีการเพิ่มตัวแทนชำระเงินแบบอัตโนมัติและกระเป๋าเงินอัจฉริยะที่ใช้ AI เข้าสู่ระบบนิเวศมากขึ้น การใช้เครื่องมือเช่น EVMbench เพื่อแยกแยะโมเดลที่สามารถอธิบายช่องโหว่ได้เพียงอย่างเดียว กับโมเดลที่สามารถให้แนวทางป้องกันที่เชื่อถือได้ จะกลายเป็นจุดเปลี่ยนสำคัญในอุตสาหกรรมความปลอดภัยของบล็อกเชน

btc.bar.articles

คาร์ดอนเดิมพัน $5 พันล้านบนโทเคนอสังหาริมทรัพย์

MoonPay, PayPal, และ M0 เปิดตัวกรอบงานการโทเคนไนซ์สกุลเงินเสถียร PYUSDx

XRP Ledger ขับเคลื่อน $280 ล้านโทเคนเพชรในการทำธุรกรรมสินทรัพย์จริงในสหรัฐอาหรับเอมิเรตส์ครั้งใหญ่

Vitalik:EIP-8141 มีแนวโน้มที่จะบรรลุภายในหนึ่งปี จะแก้ปัญหาการแยกประเภทบัญชีอย่างครบถ้วน

Hyperliquid เปิดตัวการประมูลโทเค็น HIP-6

Ripple ขยายกลยุทธ์ระบบนิเวศ XRPL ด้วยเงินทุนและโปรแกรมเร่งพัฒนาสำหรับปี 2026