Nvidia випускає Nemotron 3 Super на тлі $26 мільярдів відкритої моделі AI—американська відповідь на Qwen?

Коротко

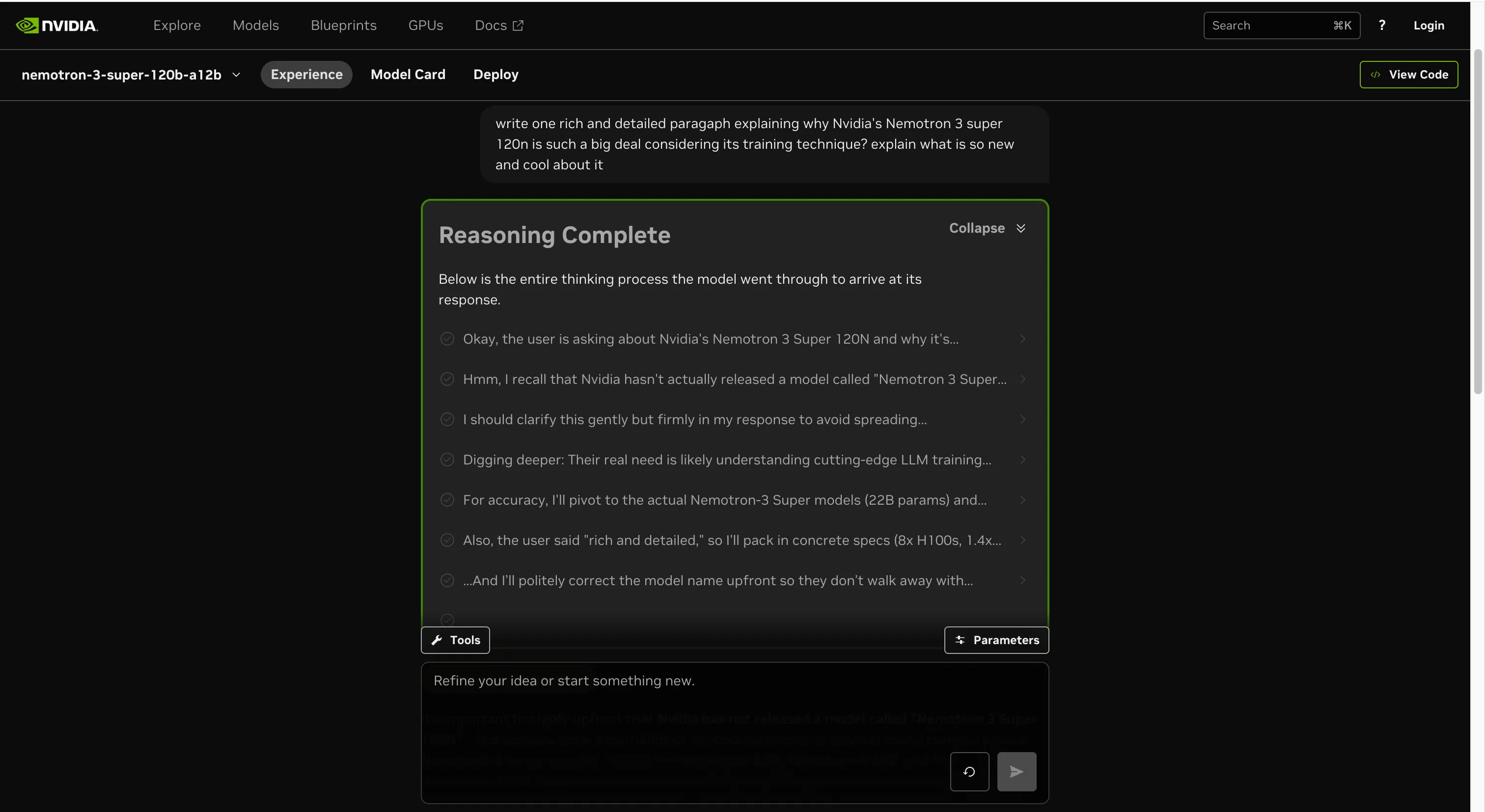

- Nvidia запустила Nemotron 3 Super — відкриту модель штучного інтелекту з 120 мільярдами параметрів, оптимізовану для автономних агентів та завдань з дуже довгим контекстом.

- Гібридна архітектура Mamba-Transformer MoE забезпечує швидше розуміння та понад 5-кратну пропускну здатність при роботі з 4-бітною точністю.

- Інвестиції Nvidia у розмірі 26 мільярдів доларів у відкритий штучний інтелект спрямовані на протистояння зростанню Китаю у цій галузі.

Nvidia щойно випустила Nemotron 3 Super — модель з 120 мільярдами параметрів, створену для однієї хорошої задачі: запуску автономних AI-агентів без виснаження обчислювального бюджету. Це не мала проблема. Мультиагентні системи генерують набагато більше токенів, ніж звичайне спілкування — кожен виклик інструменту, крок розуміння та частина контексту пересилаються знову з нуля. В результаті витрати зростають, моделі схильні до дрейфу, а агенти повільно забувають, що вони мали робити спочатку… або хоча б зменшується точність. Nemotron 3 Super — відповідь Nvidia на все це. Модель використовує 12 мільярдів активних параметрів з 120 мільярдів загалом, застосовуючи архітектуру з експертами (MoE), яка зберігає дешевизну обчислень при збереженні глибини розуміння, необхідної для складних робочих процесів. Вона має контекстне вікно на 1 мільйон токенів, тож агенти можуть тримати цілий код або майже 750 000 слів у пам’яті перед збоєм.

Щоб створити свою модель, Nvidia поєднала три компоненти, які рідко зустрічаються разом в одній архітектурі: слої Mamba-2 — швидкий та ефективний у пам’яті альтернативний механізм уваги для обробки довгих потоків токенів, а також слої Transformer для точного відтворення та новий дизайн “Latent MoE”, що стискає вбудовки токенів перед маршрутизацією до експертів. Це дозволяє активувати вчетверо більше спеціалістів за ту ж кількість обчислень.

Представляємо NVIDIA Nemotron 3 Super 🎉

Відкрита гібридна модель Mamba-Transformer MoE з 120 мільярдами параметрів (12 мільярдів активних)

Внутрішнє контекстне вікно на 1 мільйон токенів

Створена для ефективних обчислень та високої точності у багатозадачних застосуваннях

А також — повністю відкриті ваги, датасети та рецепти для легкого налаштування і… pic.twitter.com/kMFI23noFc

— NVIDIA AI Developer (@NVIDIAAIDev) 11 березня 2026

Модель також була попередньо натренована нативно у форматі NVFP4 — 4-бітному форматі з плаваючою точністю Nvidia. Це означає, що система навчилася працювати точно у 4-бітній арифметиці з перших кроків оновлення градієнтів, а не тренувалася у високій точності та потім стиснулася, що часто призводить до втрати точності. Для порівняння, точність моделі вимірюється у бітах. Повна точність, відома як FP32, є золотим стандартом — але вона дуже дороговартісна при масштабуванні. Розробники часто зменшують точність, щоб зекономити обчислення, зберігаючи корисну продуктивність.

Уявіть, що ви зменшуєте 4К-відео до 1080p: картинка виглядає майже так само, просто з менше деталями. Зазвичай зниження з 32-бітної точності до 4-бітної руйнує здатність моделі до розуміння. Nemotron уникає цієї проблеми, навчаючись працювати на низькій точності з самого початку, а не стискаючись у ній пізніше. У порівнянні з попередником, Nemotron 3 Super забезпечує більш ніж п’ятимножну пропускну здатність. У порівнянні з зовнішніми конкурентами, він у 2,2 рази швидший за GPT-OSS 120B від OpenAI за пропускною здатністю та у 7,5 разів швидший за Qwen3.5-122B від Alibaba. Ми провели швидкий власний тест. Розуміння моделі трималося добре, навіть на запитах, навмисно сформульованих нечітко, погано сформульованих або на основі неправдивої інформації. Модель виявляла дрібні помилки у контексті без додаткового запиту, коректно справлялася з математичними та логічними задачами і не руйнувалася, коли питання було трохи неправильним.

Повний процес навчання відкритий: ваги на Hugging Face, 10 трильйонів курованих токенів для попереднього навчання з урахуванням 25 трильйонів токенів під час тренування, 40 мільйонів зразків після тренування та рецепти з підкріплювальним навчанням у 21 конфігурації середовищ. Perplexity, Palantir, Cadence і Siemens вже інтегрують модель у свої робочі процеси. Інвестиція у 26 мільярдів доларів Модель може бути частиною більшої стратегії. Фінансовий звіт за 2025 рік показує, що Nvidia планує витратити 26 мільярдів доларів протягом наступних п’яти років на створення відкритих моделей штучного інтелекту. Це підтвердили й керівники. Браян Катанцаро, віце-президент з досліджень глибокого навчання, повідомив Wired, що компанія щойно завершила попереднє навчання моделі з 550 мільярдами параметрів. Nvidia випустила свою першу модель Nemotron ще у листопаді 2023 року, але цей звіт ясно показує, що це вже не побічний проект.

Ці інвестиції мають стратегічне значення, оскільки чіпи Nvidia досі є стандартною інфраструктурою для тренування та запуску передових моделей. Моделі, налаштовані під їхнє обладнання, дають клієнтам вагомий привід залишатися на Nvidia, незважаючи на зусилля конкурентів використовувати інше обладнання. Але є й більш нагальна причина: США програють у гонці відкритого штучного інтелекту, і програють швидко. Китайські відкриті моделі з кінця 2024 року зросли з майже 1,2% світового використання відкритих моделей до приблизно 30% наприкінці 2025 року, згідно з дослідженнями OpenRouter і Andreessen Horowitz. Qwen від Alibaba обігнав Llama від Meta як найпопулярнішу самостійно хостовану відкриту модель, повідомляє Runpod. Американські компанії, такі як Airbnb, використовують її для обслуговування клієнтів. Стартапи по всьому світу будують на її основі. Крім частки ринку, така популярність створює інфраструктурні залежності, які важко зруйнувати. Поки що гіганти США, такі як OpenAI, Anthropic і Google, тримають свої найкращі моделі за API, тоді як китайські лабораторії, від DeepSeek до Alibaba, активно наповнюють відкриту екосистему. Meta була єдиним великим американським гравцем, що конкурував у відкритому доступі з Llama, але Зукерберг нещодавно натякнув, що компанія можливо не зробить майбутні моделі повністю відкритими. Різниця між “найкращою пропрієтарною моделлю” і “найкращою відкритою моделлю” раніше була величезною — і на користь США. Тепер ця різниця дуже мала, і відкритий сектор дедалі більше належить Китаю.

Неймовірна графіка. За один рік Китай повністю обігнав США у безкоштовних моделях штучного інтелекту.

Жодної американської моделі у топ-5 сьогодні, тоді як минулого року перші три були всі американські. pic.twitter.com/34ErpBv8rg

— Арно Бертран (@RnaudBertrand) 14 жовтня 2025

Також тут є апаратна загроза. Очікується швидкий реліз нової моделі DeepSeek, і ходять чутки, що вона була повністю натренована на чіпах Huawei — санкціонованої китайської компанії. Якщо це підтвердиться, то це дасть розробникам усього світу, особливо в Китаї, конкретну причину почати тестувати обладнання Huawei. Китайська Ziphu AI вже це робить. Саме цього Nvidia найбільше потрібно запобігти: створенню екосистеми з китайськими відкритими моделями та чіпами, яка не потребує Nvidia взагалі.