Anthropic kiện chính phủ Trump: Nhãn "rủi ro chuỗi cung ứng" là hành vi trả đũa bất hợp pháp

Phần mềm trí tuệ nhân tạo Claude của nhà phát triển Anthropic hôm thứ Hai đã đệ đơn kiện chính phủ Trump tại tòa liên bang California, cáo buộc chính phủ đã phát động một “hành động trả đũa bất hợp pháp” vì Anthropic từ chối cho quân đội sử dụng công nghệ của họ không giới hạn — bao gồm cả việc sử dụng cho vũ khí tự sát chết người và giám sát nội địa quy mô lớn. Đây là lần đầu tiên trong lịch sử Mỹ một công ty trong nước bị xác định là rủi ro trong chuỗi cung ứng quân sự.

Nhãn rủi ro chuỗi cung ứng: Phán quyết chưa từng có của Bộ Quốc phòng

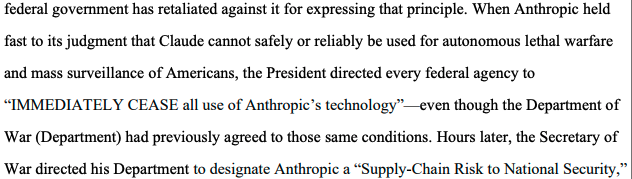

Khởi nguồn của vụ kiện pháp lý này là quyết định cuối cùng của Bộ trưởng Quốc phòng Pete Hegseth ngày 3 tháng 3 năm 2026: xếp Anthropic vào danh sách doanh nghiệp rủi ro trong chuỗi cung ứng quân sự. Hậu quả pháp lý của quyết định này rất nghiêm trọng — bất kỳ cá nhân hoặc doanh nghiệp nào có hoạt động kinh doanh với quân đội đều không được phép giao dịch với Anthropic, tương đương với việc loại bỏ hoàn toàn khỏi thị trường mua sắm liên bang.

Điều đáng chú ý là, việc xác định rủi ro chuỗi cung ứng này trước đây chỉ áp dụng cho các công ty có liên quan đến các thế lực thù địch nước ngoài, chưa từng áp dụng cho các doanh nghiệp trong nước Mỹ. Trong vụ kiện, Anthropic gọi hành động này là “chưa từng có và trái pháp luật”, và khẳng định: “Hiến pháp không cho phép chính phủ sử dụng quyền lực lớn của mình để trừng phạt một công ty vì các phát ngôn được bảo vệ.”

Danh sách bị cáo trong vụ kiện gồm rất nhiều, bao gồm Pete Hegseth (Bộ trưởng Quốc phòng), Scott Bessent (Bộ trưởng Tài chính), Marco Rubio (Ngoại trưởng) cùng 17 cơ quan và quan chức chính phủ khác, bao gồm nhiều bộ phận cốt lõi của chính phủ liên bang Mỹ.

Giới hạn đỏ của Anthropic: Vũ khí chết người và giám sát quy mô lớn

(Nguồn: CourtListener)

(Nguồn: CourtListener)

Theo trình bày của Anthropic trong vụ kiện, Hegseth yêu cầu công ty “từ bỏ hoàn toàn các hạn chế sử dụng” — nhưng Anthropic từ chối vì các hạn chế này là một phần của hợp đồng chính phủ của họ, nhằm ngăn chặn Claude bị sử dụng cho hai mục đích cụ thể:

Hệ thống vũ khí tự sát chết người: hệ thống quyết định tự động gây sát thương mà không cần xác nhận cuối cùng của con người

Giám sát quy mô lớn đối với công dân Mỹ: sử dụng AI để thu thập và phân tích dữ liệu cá nhân của công dân trên quy mô lớn

Trong vụ kiện, Anthropic rõ ràng tuyên bố: “Anthropic chưa từng thử nghiệm Claude cho các mục đích này. Hiện tại, Anthropic không chắc chắn rằng, nếu sử dụng Claude để hỗ trợ chiến tranh tự sát chết người, nó có thể hoạt động đáng tin cậy hoặc an toàn.”

Quan điểm này phù hợp với nguyên tắc ưu tiên an toàn AI lâu dài của Anthropic, nhưng lại mâu thuẫn căn bản với chính sách mở rộng ứng dụng AI quân sự của chính quyền Trump. Đáng chú ý, từ năm 2024, chính phủ Mỹ và Bộ Quốc phòng đã bắt đầu sử dụng công nghệ của Anthropic, trong đó Claude là AI đầu tiên được triển khai trong môi trường công việc bí mật. Việc này đi kèm với lệnh hành chính của Trump yêu cầu các nhân viên liên bang ngừng sử dụng Claude.

Hỗ trợ chung của các kỹ sư OpenAI và Google: Phản ứng tập thể của ngành AI

Sau khi vụ kiện nổ ra, phản ứng trong ngành AI diễn ra nhanh chóng và rộng rãi. Trong thứ Hai, hơn 30 kỹ sư và nhà khoa học từ OpenAI và Google, bao gồm cả Giám đốc Khoa học của Google Jeff Dean, đã gửi một bản kiến nghị pháp lý (amicus brief) công khai ủng hộ Anthropic.

Các chuyên gia trong ngành cảnh báo trong tài liệu rằng: “Nếu cho phép hành động trừng phạt một trong những công ty AI hàng đầu của Mỹ tiếp tục, chắc chắn sẽ ảnh hưởng tiêu cực đến khả năng cạnh tranh công nghiệp và khoa học của Mỹ trong lĩnh vực trí tuệ nhân tạo và các lĩnh vực khác.” Phán đoán này hướng tới một mối lo ngại lớn hơn — nếu chính phủ Mỹ dựa vào lý do rủi ro chuỗi cung ứng để đàn áp các công ty AI trong nước, điều này có thể làm giảm lợi thế cốt lõi của Mỹ trong cuộc đua AI toàn cầu chống lại Trung Quốc.

Các câu hỏi thường gặp

“Nhãn rủi ro chuỗi cung ứng” ảnh hưởng cụ thể thế nào đến Anthropic?

Theo luật pháp Mỹ, bị liệt vào danh sách rủi ro chuỗi cung ứng có nghĩa là bất kỳ cá nhân hoặc tổ chức nào có hoạt động kinh doanh với quân đội đều không thể giao dịch cùng công ty bị liệt kê. Điều này tương đương với việc loại bỏ hoàn toàn Anthropic khỏi hệ sinh thái mua sắm của chính phủ liên bang, ảnh hưởng không chỉ đến các hợp đồng quân sự trực tiếp mà còn đến tất cả các nhà cung cấp và đối tác có liên quan đến chính phủ.

Tại sao Anthropic từ chối mở rộng sử dụng cho vũ khí chết người?

Anthropic lập luận rằng Claude chưa từng được thử nghiệm hoặc đánh giá an toàn cho các mục đích vũ khí tự sát chết người. Công ty hiện không thể đảm bảo độ tin cậy hoặc an toàn của hệ thống trong các ứng dụng này. Thêm vào đó, nguyên tắc an toàn AI của Anthropic phản đối việc triển khai các hệ thống ra quyết định tự chủ có rủi ro cao mà chưa qua thử nghiệm đầy đủ, đặc biệt trong các tình huống đe dọa tính mạng con người.

Ý nghĩa của việc các kỹ sư Google và OpenAI ủng hộ Anthropic là gì?

Việc hơn 30 kỹ sư và nhà khoa học từ các đối thủ cạnh tranh cùng ký tên ủng hộ phản ánh mối lo ngại chung của ngành AI về việc chính phủ sử dụng nhãn rủi ro chuỗi cung ứng để can thiệp vào các công ty AI trong nước. Họ cảnh báo rằng, nếu chính phủ có thể dùng công cụ này để đàn áp các công ty không hợp tác, thì các công ty khác cũng có thể rơi vào tình cảnh tương tự, làm suy yếu khả năng cạnh tranh của Mỹ trong lĩnh vực AI toàn cầu.