加大教授拆解生成式AI:Vibe Coding沒那麼神?用AI寫程式的最佳方式是?

在生成式AI飛速發展的當下,許多人對於是否該繼續學習寫程式感到迷惘,加大教授在GQ雜誌的節目中,解析ChatGPT背後的LLM原理,指出Vibe Coding的侷限性。

加大教授拆解生成式AI,教你正確理解Vibe Coding

近期 GQ Taiwan 在 YouTube 頻道分享一支影片,特別邀請加州大學柏克萊分校(UC Berkeley)電腦科學教授 Sarah Chasins,針對網友對於程式設計與 AI 的諸多疑問進行回應。

在生成式 AI 飛速發展的當下,許多人對於是否該繼續學習寫程式感到迷惘,Chasins 教授在影片中不僅解析了技術原理,也針對近期興起的「Vibe Coding」風潮,提出了務實的觀察。

教授拆解ChatGPT背後的LLM技術原理

Sarah Chasins 教授首先用大眾也能懂的方式,解釋了 ChatGPT 的運作機制。

ChatGPT 建立在大型語言模型(LLM)之上,其核心運作邏輯相當單純,就是把一個負責將看起來搭配的單字組合在一起的程式。

LLM 的開發者,首先會收集網路上所有由人類編寫的文件與網頁,這些資料代表了人類認知中合理的詞彙組合。

**接著,程式會進行大規模的「填空遊戲」訓練。**舉例來說,系統會看到「狗狗有四條[空白]」這樣的句子,符合人類認知的答案是「狗狗有四條腿」,但若程式猜測錯誤,開發者便會修正直到它答對為止。

經過相當於地球時間 300 到 400 年運算時間的訓練後,程式最終會生成一份極其龐大的「作弊紙」,也就是科技界常說的「參數」。

接下來,只需再提供一份對話格式的文件,這個擅長填空的程式就能轉化為聊天機器人,自動依照邏輯補完人類問題後的剩餘回應。

圖源:AI生成 Nanobanana 生成圖片,僅供參考,有部分中文字模糊請見諒

AI時代下,學習寫程式的最佳方式

面對 AI 工具的強大能力,許多人質疑學習寫程式的必要性。對此教授認為,寫程式教育中最核心的技能在於「分解問題」,意即將一個模糊的大問題拆解成細小區塊,直到每個區塊都能用幾行程式碼解決。

若缺乏這種訓練,使用者將難以利用 AI 工具產出真正能運作的複雜程式。此外,LLM 的訓練資料多屬工程師風格的語言描述,非專業人士使用的日常語言,往往與訓練資料不匹配,容易導致 AI 無法生成有用的程式碼。

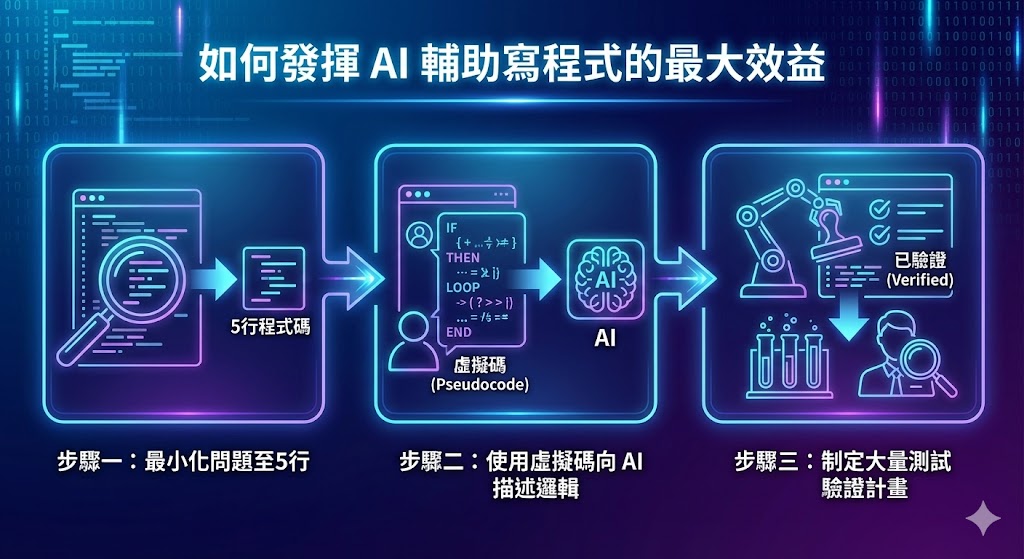

至於如何發揮 AI 輔助寫程式的最大效益,Chasins 教授建議遵循三個步驟:

- **最小化問題:**將問題分解至大約 5 行程式碼的規模。

- **使用虛擬碼(Pseudo code):**這是一種可能綜合使用多種程式語言的語法、保留字,向 AI 描述邏輯的方式,雖然虛擬碼類似自然語言,但不是我們日常使用的語言,用意是讓電腦更精準理解執行邏輯。

- **制定驗證計畫:**透過大量測試或專業審核來確保 AI 輸出的正確性。

圖源:AI生成 Nanobanana 生成圖片,僅供參考,有部分中文字模糊請見諒

Vibe Coding沒那麼神?

針對近期流行利用 LLM 直接生成程式碼,而非由人類手打程式碼的 Vibe Coding 模式,Sarah Chasins 教授持保留態度。

她分析,這類工具在處理已被人類寫過千百遍的常規內容時表現尚可,但若打算嘗試任何創新的事物,這種模式通常行不通。

教授還引用相關研究數據指出,使用 LLM 工具輔助的人,雖然自認為效率提升了 20%,但實際上的開發速度反而比沒使用工具的人慢了 20%。

這顯示出過度依賴工具可能產生效率提升的錯覺,當遇到未曾見過的程式需求,若缺乏基礎的邏輯分解能力與物理原理知識,將無法修正 AI 發生的錯誤,導致最終產出更加耗時。

簡單打個比方,LLM 就像是一台高級的自動駕駛汽車,能幫你處理常見的路徑,但如果你不知道如何拆解賽道、不了解車輛運行的物理原理,如同寫程式的邏輯分解,當遇到從未見過的險惡彎道,如創新的程式需求時,自動駕駛就容易出錯,而你也會因為缺乏基本功,而不知道該怎麼修正它。

延伸閱讀:

AI讓一人公司崛起!「氛圍編碼」顛覆傳統,小團隊也能年收破億

相關文章

Dogecoin 價格預測:交易者在 DeepSnitch AI 上全力押注,期待 100x-300x 的升幅,DOGE 和 PENGU 展現突破跡象