加大教授拆解生成式AI:Vibe Coding没那么神?用AI写程序的最佳方式是?

在生成式AI飞速发展的当下,许多人对于是否该继续学习写程序感到迷惘,加大教授在GQ杂志的节目中,解析ChatGPT背后的LLM原理,指出Vibe Coding的局限性。

加大教授拆解生成式AI,教你正确理解Vibe Coding

近期 GQ Taiwan 在 YouTube 频道分享一支影片,特别邀请加州大学柏克莱分校(UC Berkeley)计算机科学教授 Sarah Chasins,针对网友对于程序设计与 AI 的诸多疑问进行回应。

在生成式 AI 飞速发展的当下,许多人对于是否该继续学习写程序感到迷惘,Chasins 教授在影片中不仅解析了技术原理,也针对近期兴起的「Vibe Coding」风潮,提出了务实的观察。

教授拆解ChatGPT背后的LLM技术原理

Sarah Chasins 教授首先用大众也能懂的方式,解释了 ChatGPT 的运作机制。

ChatGPT 建立在大型语言模型(LLM)之上,其核心运作逻辑相当单纯,就是把一个负责将看起来搭配的单字组合在一起的程序。

LLM 的开发者,首先会收集网络上所有由人类编写的文件与网页,这些资料代表了人类认知中合理的词汇组合。

**接着,程序会进行大规模的「填空游戏」训练。**举例来说,系统会看到「狗狗有四条[空白]」这样的句子,符合人类认知的答案是「狗狗有四条腿」,但若程序猜测错误,开发者便会修正直到它答对为止。

经过相当于地球时间 300 到 400 年运算时间的训练后,程序最终会生成一份极其庞大的「作弊纸」,也就是科技界常说的「参数」。

接下来,只需再提供一份对话格式的文件,这个擅长填空的程序就能转化为聊天机器人,自动依照逻辑补完人类问题后的剩余回应。

图源:AI生成 Nanobanana 生成图片,仅供参考,有部分中文字模糊请见谅

AI时代下,学习写程序的最佳方式

面对 AI 工具的强大能力,许多人质疑学习写程序的必要性。对此教授认为,写程序教育中最核心的技能在于「分解问题」,即将一个模糊的大问题拆解成细小块,直到每个块都能用几行程序码解决。

若缺乏这种训练,使用者将难以利用 AI 工具产出真正能运作的复杂程序。此外,LLM 的训练资料多属工程师风格的语言描述,非专业人士使用的日常语言,往往与训练资料不匹配,容易导致 AI 无法生成有用的程序码。

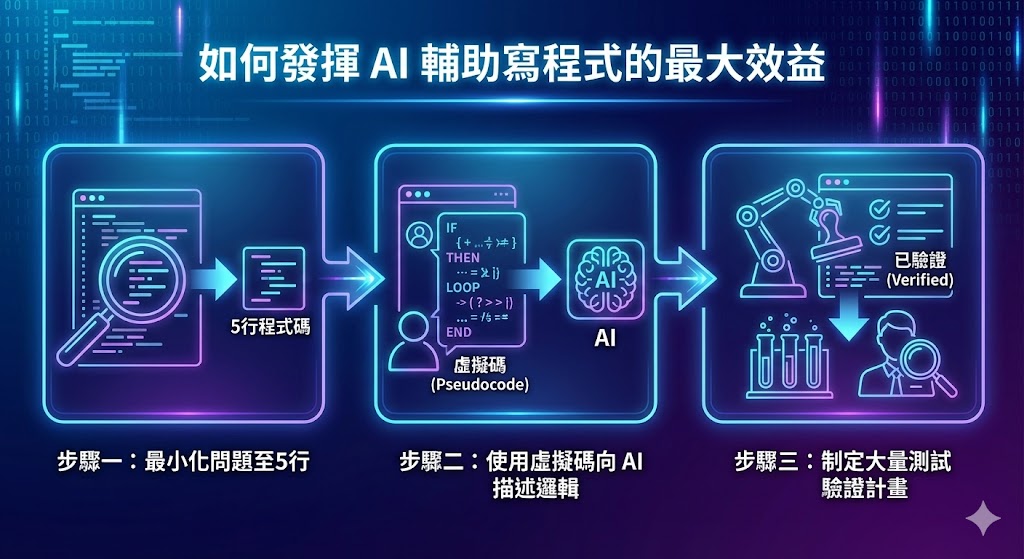

至于如何发挥 AI 辅助写程序的最大效益,Chasins 教授建议遵循三个步骤:

- **最小化问题:**将问题分解至大约 5 行程序码的规模。

- **使用伪代码(Pseudo code):**这是一种可能综合使用多种程序语言的语法、保留字,向 AI 描述逻辑的方式,虽然伪代码类似自然语言,但不是我们日常使用的语言,用意是让电脑更精准理解执行逻辑。

- **制定验证计划:**通过大量测试或专业审核来确保 AI 输出的正确性。

图源:AI生成 Nanobanana 生成图片,仅供参考,有部分中文字模糊请见谅

Vibe Coding没那么神?

针对近期流行利用 LLM 直接生成程序码,而非由人类手打程序码的 Vibe Coding 模式,Sarah Chasins 教授持保留态度。

她分析,这类工具在处理已被人类写过千百遍的常规内容时表现尚可,但若打算尝试任何创新的事物,这种模式通常行不通。

教授还引用相关研究数据指出,使用 LLM 工具辅助的人,虽然自认为效率提升了 20%,但实际上的开发速度反而比没使用工具的人慢了 20%。

这显示出过度依赖工具可能产生效率提升的错觉,当遇到未曾见过的程序需求,若缺乏基础的逻辑分解能力与物理原理知识,将无法修正 AI 发生的错误,导致最终产出更加耗时。

简单打个比方,LLM 就像是一台高级的自动驾驶汽车,能帮你处理常见的路径,但如果你不知道如何拆解赛道、不了解车辆运行的物理原理,如同写程序的逻辑分解,当遇到从未见过的险恶弯道,如创新的程序需求时,自动驾驶就容易出错,而你也会因为缺乏基本功,而不知道该怎么修正它。

延伸阅读:

AI让一人公司崛起!「氛围编码」颠覆传统,小团队也能年收破亿

相关文章