Globale Top-Großmodelle schaffen es nicht, 《Pokémon》 zu meistern: Diese Spiele sind der Albtraum für KI

Autor: Guo Xiaojing, Tencent Technology

Redakteur |

Die besten KI-Modelle der Welt bestehen medizinische Lizenzprüfungen, schreiben komplexen Code und schlagen sogar menschliche Experten in Mathematikwettbewerben, aber Pokémon ist in einem Kinderspiel wiederholt gescheitert.

Dieser aufsehenerregende Versuch begann im Februar 2025, als ein anthropologischer Forscher einen Twitch-Stream von “Claude spielt Pokémon Red” startete, der mit der Veröffentlichung von Claude Sonnet 3.7 zusammenfiel.

2.000 Zuschauer strömten in den Live-Übertragungsraum. Im öffentlichen Chatbereich gaben die Zuschauer Ratschläge und feuerten Claude an, wodurch der Livestream zu einer öffentlichen Beobachtung über die Fähigkeiten von KI wurde.

Sonet3.7 kann nur als “Pokémon spielen” bezeichnet werden, aber “zu wissen, wie man spielt” bedeutet nicht “gewinnen”. Es bleibt an kritischen Stellen dutzende Stunden hängen und macht Fehler auf niedrigem Niveau, die selbst Kinderspieler nicht machen.

Das ist nicht das erste Mal, dass Claude es ausprobiert.

Frühe Versionen waren noch katastrophaler: Einige wanderten ziellos über die Karte, andere gerieten in eine Endlosschleife, und viele konnten nicht einmal aus dem Anfängerdorf herauskommen.

Sogar das Claude Opus 4.5, das deutlich verbesserte Fähigkeiten bietet, enthält immer noch rätselhafte Fehler. Einmal kreiste es vier Tage lang “außerhalb des Fitnessstudios”, aber es kam nie hinein, einfach weil es nicht bemerkte, dass es einen Baum fällen musste, der die Kreuzung blockierte.

Warum ist ein Kinderspiel zum Waterloo der KI geworden?

Denn “Pokémon” erfordert genau die Fähigkeit, die KI heute am meisten fehlt: kontinuierliches Denken in einer offenen Welt ohne klare Anweisungen, das Erinnern an Entscheidungen, die vor Stunden getroffen wurden, das Verständnis impliziter kausaler Zusammenhänge und das Schmieden langfristiger Pläne für Hunderte möglicher Aktionen.

Diese Dinge sind für 8-Jährige einfach, aber sie sind eine unüberwindbare Lücke für KI-Modelle, die behaupten, “Menschen zu übertreffen”.

01 Die Lücke im Werkzeugset entscheidet über Erfolg oder Misserfolg?

Im Gegensatz dazu hat Googles Gemini 2.5 Pro im Mai 2025 erfolgreich ein vergleichbar schwieriges Pokémon-Spiel besiegt. Google-CEO Sundar Pichai sagte sogar halb im Scherz öffentlich, dass das Unternehmen einen Schritt zur Entwicklung von “künstlicher Pokémon-Intelligenz” unternommen habe.

Dieses Ergebnis kann jedoch nicht einfach darauf zurückgeführt werden, dass das Gemini-Modell selbst “intelligenter” ist.

Der entscheidende Unterschied liegt im verwendeten Werkzeugsatz, das das Modell verwendet. Joel Zhang, ein unabhängiger Entwickler, der Gemini’s Pokémon-Livestream betreibt, verglich das Werkzeugset mit einer Reihe von “Iron Man-Rüstungen”: Die KI betritt das Spiel nicht mit leeren Händen, sondern ist in ein System eingebettet, das auf verschiedene externe Fähigkeiten zurückgreifen kann.

Das Werkzeugset von Gemini bietet zusätzliche Unterstützung, wie zum Beispiel die Transkription von Spielaufnahmen in Text, was die Schwächen des Modells im visuellen Verständnis ausgleicht, und bietet maßgeschneiderte Werkzeuge zum Lösen von Rätseln und Wegplanung. Im Gegensatz dazu verwendet Claude ein minimalistischeres Werkzeugset, das die tatsächlichen Fähigkeiten des Modells in Wahrnehmung, Schlussfolgerung und Ausführung direkter widerspiegelt.

Bei alltäglichen Aufgaben ist dieser Unterschied nicht spürbar.

Wenn ein Nutzer eine Anfrage an den Chatbot für eine Online-Anfrage stellt, ruft das Modell automatisch das Suchwerkzeug auf. Aber bei Langzeitmissionen wie Pokémon ist der Unterschied in den Werkzeugen so groß, dass er über Erfolg oder Bruch entscheiden kann.

02 Das rundenbasierte System legt die Schwächen des “Langzeitgedächtnisses” der KI offen.

Da Pokémon streng rundenbasiert ist und keine sofortigen Reaktionen erfordert, ist es ein hervorragendes “Trainingsfeld” zum Testen von KI. In jedem Schritt der Operation muss die KI nur das aktuelle Bild, Zielprompts und optionale Operationen kombinieren, um zu argumentieren, und kann klare Anweisungen wie “Taste A drücken” ausgeben.

Dies scheint die Form der Interaktion zu sein, in der große Sprachmodelle am besten geeignet sind.

Der Kern des Problems liegt genau im “Fehler” der Zeitdimension. Obwohl Claude Opus 4.5 mehr als 500 Betriebsstunden gesammelt und etwa 170.000 Schritte durchgeführt hat, kann das Modell aufgrund der Neuinitialisierung nach jedem Schritt nur in einem sehr engen Kontextfenster Hinweise finden. Dieser Mechanismus macht es eher wie eine Amnesie, die auf Post-its angewiesen ist, um die Kognition aufrechtzuerhalten, sich durch fragmentierte Informationen schlägt und nie in der Lage ist, den Sprung von quantitativer zu qualitativer Veränderung wie ein echter menschlicher Spieler zu erreichen.

In Bereichen wie Schach und Go haben KI-Systeme den Menschen längst übertroffen, aber diese Systeme sind stark auf bestimmte Aufgaben zugeschnitten. Im Gegensatz dazu besiegten Gemini, Claude und GPT als allgemeine Modelle häufig Menschen in Prüfungen und Programmierwettbewerben, wurden aber in kinderorientierten Spielen immer wieder frustriert.

Dieser Kontrast selbst ist sehr aufschlussreich.

Aus Sicht von Joel Zhang ist die zentrale Herausforderung der KI die Unfähigkeit, über einen langen Zeitraum konstant ein einziges klares Ziel zu erreichen. “Wenn du willst, dass ein Agent echte Arbeit macht, kann er nicht vergessen, was er vor fünf Minuten getan hat”, bemerkte er.

Und diese Fähigkeit ist eine unverzichtbare Voraussetzung für die Umsetzung kognitiver Arbeitsautomatisierung.

Der unabhängige Forscher Peter Whidden gibt eine anschaulichere Beschreibung. Er hat einmal einen Pokémon-Algorithmus auf Basis traditioneller KI als Open Source veröffentlicht. “Die KI weiß fast alles über Pokémon”, sagte er, “und sie ist auf riesigen menschlichen Daten trainiert und kennt die richtigen Antworten.” Aber in der Hinrichtungsphase wirkt es unbeholfen. ”

Im Spiel wird dieser Fehler “wissen, aber nicht tun” ständig verstärkt: Das Modell weiß vielleicht, dass es einen bestimmten Gegenstand finden muss, aber dieser kann nicht stabil auf der 2D-Karte positioniert werden; Man weiß, dass man mit NPCs sprechen sollte, aber immer wieder bei Pixel-Bewegungen scheitert.

03 Hinter der Entwicklung der Fähigkeiten: die unüberbrochene “Instinkt”-Lücke

Dennoch sind die Fortschritte in der KI deutlich sichtbar. Claude Opus 4.5 ist deutlich besser als sein Vorgänger, was Selbstaufnahme und visuelles Verständnis angeht, was es ermöglicht, im Spiel weiter voranzukommen. Nachdem er “Pokémon Blau” abgeschlossen hatte, beendete Gemini 3 Pro das schwierigere “Pokémon Kristall”, ohne einen einzigen Kampf zu verlieren. Das ist etwas, das Gemini 2.5 Pro nie erreicht hat.

Unterdessen wurde Anthropics Claude Code-Werkzeugset, das es Modellen ermöglicht, ihren eigenen Code zu schreiben und auszuführen, in Retro-Spielen wie Roller Coaster Tycoon verwendet, das als erfolgreich bei der Verwaltung virtueller Freizeitparks gilt.

Diese Beispiele offenbaren eine unintuitive Realität: KI kann mit dem richtigen Werkzeugset bei Wissensaufgaben wie Softwareentwicklung, Buchhaltung, Rechtsanalyse usw. äußerst effizient sein, selbst wenn sie weiterhin Schwierigkeiten hat, mit Aufgaben zurechtzukommen, die Echtzeitreaktionen erfordern.

Das Pokémon-Experiment offenbarte auch ein weiteres faszinierendes Phänomen: Modelle, die auf menschlichen Daten trainiert wurden, zeigen Verhaltensmerkmale, die denen von Menschen ähneln.

Im technischen Bericht zu Gemini 2.5 Pro stellte Google fest, dass die Inferenzqualität des Modells deutlich abnimmt, wenn das System einen “Panikzustand” simuliert, etwa wenn ein Pokémon kurz vor dem Ohnmacht steht.

Und als Gemini 3 Pro schließlich Pokémon Blau abgeschlossen hatte, hinterließ es eine Notiz, die für die Mission nicht nötig war: “Für einen poetischen Abschluss werde ich in mein ursprüngliches Zuhause zurückkehren, ein letztes Gespräch mit meiner Mutter führen und den Charakter in den Ruhestand gehen lassen.” ”

Aus Joel Zhangs Sicht ist dieses Verhalten unerwartet und hat eine gewisse menschliche emotionale Projektion.

04. KIs unüberwindbarer “Digitaler Langer Marsch” ist weit mehr als nur “Pokémon”

Pokémon ist kein Einzelfall. Auf dem Weg zur künstlichen allgemeinen Intelligenz (AGI) haben Entwickler festgestellt, dass KI, selbst wenn sie zu den Besten in der gerichtlichen Prüfung gehört, dennoch mit einem unüberwindbaren “Waterloo” konfrontiert ist, wenn sie sich den folgenden Arten komplexer Spiele stellt.

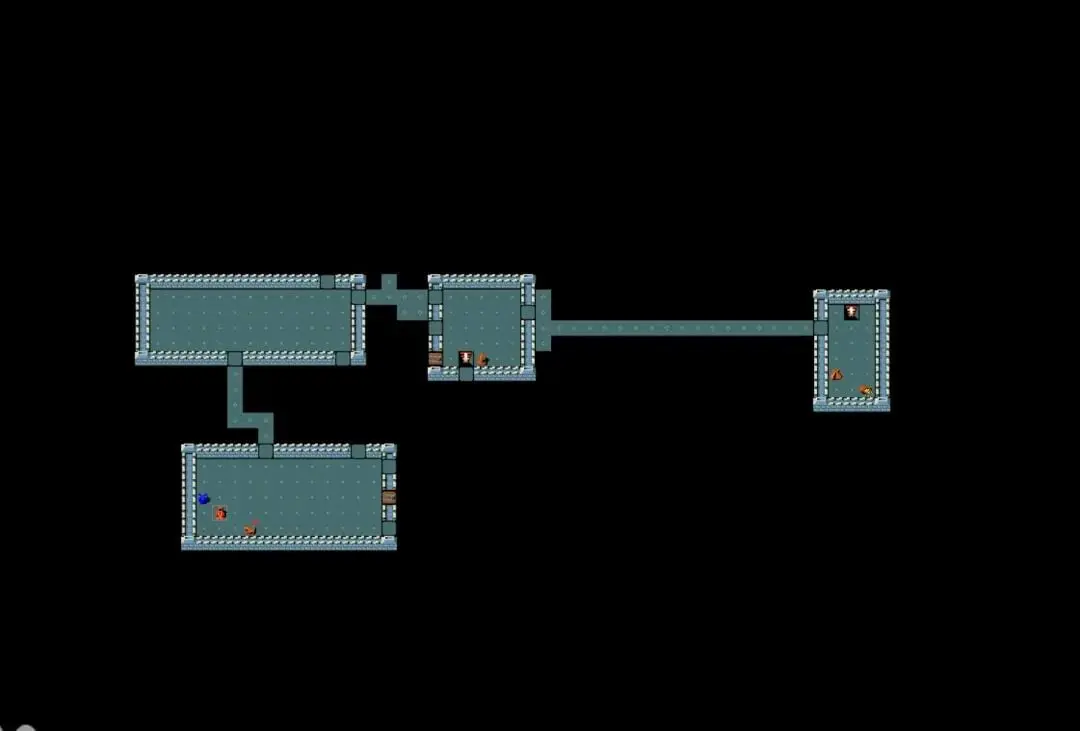

NetHack: Der Abgrund der Regeln

Dieses Dungeon-Spiel aus den 80ern ist ein “Albtraum” für die KI-Forschungsgemeinschaft. Es ist extrem zufällig und hat einen “Permadeath”-Mechanismus. Facebook AI Research fand heraus, dass das Modell selbst wenn es Code schreiben kann, dem menschlichen Anfänger gegenüber NetHack weit unterlegen ist, das gesunden Menschenverstand und langfristige Planung erfordert.

Minecraft: Der verlorene Sinn für Zweck

Obwohl die KI Holzspitzhacken herstellen und sogar Diamanten graben kann, ist das eigenständige “Besiegen des Enderdrachen” immer noch eine Fantasie. In der offenen Welt “vergisst” die KI oft ihre ursprüngliche Absicht während dutzender Stunden Ressourcensammeln oder verliert sich völlig in komplexer Navigation.

StarCraft II: Die Bruchlinie zwischen Versus-Spezialisierung

Obwohl Custom-Modelle Profis besiegt haben, brechen Claude oder Gemini sofort zusammen, wenn sie direkt mit visuellen Befehlen übernehmen. Im Umgang mit der Unsicherheit des “Nebels des Krieges” und der Balance zwischen Mikrooperationen und Makrokonstruktion ist das allgemeine Modell weiterhin unzureichend.

“Achterbahn-Tycoon”: Das Ungleichgewicht zwischen Mikro und Makro

Die Verwaltung des Parks erfordert, den Status von Tausenden von Besuchern zu verfolgen. Sogar Claude Code, der über anfängliche Managementfähigkeiten verfügt, ist sehr anfällig für Ermüdung bei groß angelegten Finanzkollapsen oder Notfällen. Jeder Logikfehler führt zur Insolvenz des Parks.

Elden Ring vs. Sekiro: Die Physik-Rückkopplung

Diese Art von starkem Action-Feedback-Spiel ist extrem unfreundlich für KI. Die aktuelle Verzögerung in der visuellen Auflösung bedeutet, dass Charaktere oft getötet werden, während die KI noch über Bossattacken “nachdenkt”. Die Anforderungen an die Antwort auf Millisekundenebene bilden die natürliche obere Grenze der Interaktionslogik des Modells.

05 Warum ist “Pokémon” zu einem KI-Bezugspunkt geworden?

Heute wird Pokémon allmählich zu einem informellen, aber sehr überzeugenden Maßstab im Bereich der KI-Bewertung.

Anthropic, OpenAI und Googles Modelle haben Hunderttausende von Kommentaren auf Twitch erhalten. Google beschrieb den Spielfortschritt von Gemini in einem technischen Bericht, und Pichai erwähnte diesen Erfolg öffentlich auf der I/O-Entwicklerkonferenz. Anthropic richtete sogar einen “Claude Play Pokémon”-Ausstellungsbereich auf Branchenkonferenzen ein.

“Wir sind ein Haufen Super-Tech-Enthusiasten”, sagt David Hershey, Leiter der angewandten KI bei Anthropic. Aber er betonte, dass dies nicht nur Unterhaltung ist.

Im Gegensatz zu traditionellen Benchmarks, die einmalige Fragen und Antworten sind, kann Pokémon kontinuierlich das Denken, die Entscheidungsfindung und den Zielvoranschreitungsprozess des Modells über einen extrem langen Zeitraum verfolgen, was näher an den komplexen Aufgaben liegt, die Menschen von KI in der realen Welt erledigen sollen.

Bis jetzt besteht die Herausforderung der KI in Pokémon weiterhin. Doch gerade diese wiederkehrenden Dilemmata zeigen klar die Grenzen der Fähigkeiten, die AGI bisher nicht überschritten hat.

Der spezielle Kompilator Wuji hat ebenfalls zu diesem Artikel beigetragen