Anthropic accuse 3 entreprises chinoises de formation par distillation d'IA ! Les internautes critiquent le double standard : vous aussi, vous copiez des contenus protégés par le droit d'auteur

Anthropic accuse trois entreprises chinoises d’IA, DeepSeek, Moonshot AI et Min, d’avoir copié leurs capacités de modèle via la technique de distillation. Cette démarche a été moquée par des internautes comme étant également une violation du droit d’auteur, tout en suscitant un débat aux États-Unis sur l’exportation de puces et la sécurité nationale.

Anthropic accuse 3 laboratoires d’IA chinois de distillation pour l’entraînement, d’extraction des capacités de modèles avancés

Le développeur du chatbot IA Claude, Anthropic, a publiquement accusé que trois laboratoires d’IA chinois, DeepSeek, Moonshot AI et MiniMax, avaient établi plus de 24 000 comptes fictifs pour accéder à plus de 16 millions de données et échanger avec le modèle Claude, utilisant la technique de distillation pour tenter de transférer ses capacités centrales vers leurs propres modèles.

La « distillation» est une technique courante d’entraînement en IA, qui consiste à faire évaluer la qualité des réponses générées par un modèle plus ancien, plus grand ou plus mature, afin que des modèles plus petits et moins coûteux puissent apprendre et transférer les résultats de calcul d’un grand modèle.

Initialement, la distillation était une méthode légitime utilisée dans l’industrie de l’IA pour créer des modèles légers pour les clients, mais des concurrents peuvent aussi utiliser cette méthode pour copier directement les résultats de recherche d’autres laboratoires.

Anthropic indique que, ces trois laboratoires chinois ont utilisé des serveurs proxy pour contourner la détection, et ont massivement extrait les capacités différenciantes de Claude, notamment en inférence proxy, utilisation d’outils et programmation.

Source : X Anthropic accuse 3 laboratoires chinois d’IA de distillation pour l’entraînement, d’extraction des capacités de modèles avancés

Les internautes critiquent le double standard, Anthropic face à une controverse sur le droit d’auteur

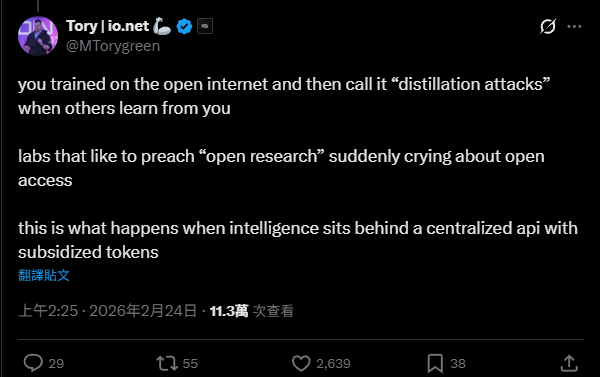

Cependant, après la déclaration d’Anthropic, cela a suscité une moquerie et des doutes massifs de la part des internautes, certains estimant qu’Anthropic adopte une attitude à double standard concernant la formation des modèles.

Tory Green, co-fondateur de la société d’infrastructure IA IO.Net, a publié une critique, soulignant que les entreprises d’IA utilisent des données publiques pour l’entraînement, mais qualifient d’attaque de distillation lorsqu’elles apprennent des autres, alors qu’Anthropic, qui prône l’ouverture de la recherche, se plaint aujourd’hui de l’accès ouvert.

En 2025, Reddit, célèbre forum américain, a officiellement poursuivi Anthropic, l’accusant d’avoir sans autorisation extrait plus de 100 000 posts et commentaires pour affiner le modèle Claude. Reddit accuse Anthropic d’avoir violé ses conditions d’utilisation, et même après avoir annoncé avoir arrêté l’extraction, avoir continué à accéder aux serveurs Reddit plus de 100 000 fois.

De plus, Anthropic fait face à une action collective pour avoir utilisé illégalement 7 millions de livres pour entraîner son modèle Claude, et a accepté en septembre dernier de payer jusqu’à 1,5 milliard de dollars pour un règlement, établissant le plus grand record de règlement pour violation de droits d’auteur aux États-Unis, mais cette somme doit encore être approuvée par le tribunal.

- Article connexe : Le plus grand dédommagement de l’histoire de l’IA ! Formation illégale de Claude avec des livres piratés, règlement de 48 milliards, des écrivains taïwanais aussi indemnisés

OpenAI émet également une alerte similaire concernant DeepSeek

Outre Anthropic, le géant de l’IA OpenAI est aussi confronté à une situation similaire.

Selon une note interne vue la semaine dernière par Reuters, OpenAI a mis en garde les législateurs américains, signalant que DeepSeek cible le développeur de ChatGPT et la principale entreprise d’IA américaine, tentant de copier leurs modèles pour entraîner ses propres algorithmes.

OpenAI a observé des comptes liés à des employés de DeepSeek développant diverses méthodes pour contourner les restrictions d’accès d’OpenAI. En utilisant des routeurs tiers confus et d’autres sources dissimulées, ils accèdent de manière programmatique aux modèles d’IA américains, récupérant les résultats pour la distillation.

Controverse sur la technique de distillation chinoise, en pleine période de relâchement des contrôles à l’exportation de puces américaines

Alors que les géants américains d’IA accusent la Chine de techniques de distillation, les États-Unis traversent une période sensible de débat sur leur politique d’exportation de puces vers la Chine, avec la décision de l’administration Trump en janvier de permettre aux entreprises américaines comme Nvidia d’exporter des puces avancées telles que la H200 vers la Chine.

Les critiques estiment qu’à un moment clé de la compétition mondiale pour la domination de l’IA, assouplir ces restrictions d’exportation pourrait considérablement renforcer la capacité de calcul de l’IA chinoise.

Dmitri Alperovitch, président du Silverado Policy Accelerator, indique que la rapide progression des modèles d’IA chinois est en partie due à la copie de modèles américains avancés via la technique de distillation. Ces preuves renforcent la nécessité pour les États-Unis de refuser la vente de toute puce d’IA à ces entreprises, sous peine d’accroître leur avantage.

Anthropic met en garde que les systèmes d’IA américains construits par des entreprises américaines disposent de mécanismes de sécurité pour empêcher des acteurs étatiques ou non étatiques d’utiliser l’IA pour développer des armes biologiques ou mener des activités malveillantes en cybersécurité. Mais les modèles d’IA construits via la distillation manquent souvent de telles protections.

Anthropic craint que si des laboratoires étrangers d’IA intègrent ces capacités sans restriction dans des systèmes militaires ou de renseignement, cela pourrait permettre à des gouvernements autoritaires d’utiliser l’IA pour des attaques cybernétiques, de la désinformation à grande échelle, et de surveillance massive, augmentant ainsi considérablement les risques pour la sécurité.

Lectures complémentaires :

Des hackers chinois lancent une cyberattaque massive sur l’IA ! Anthropic : la vitesse et l’ampleur des hackers IA dépassent celles des hackers humains