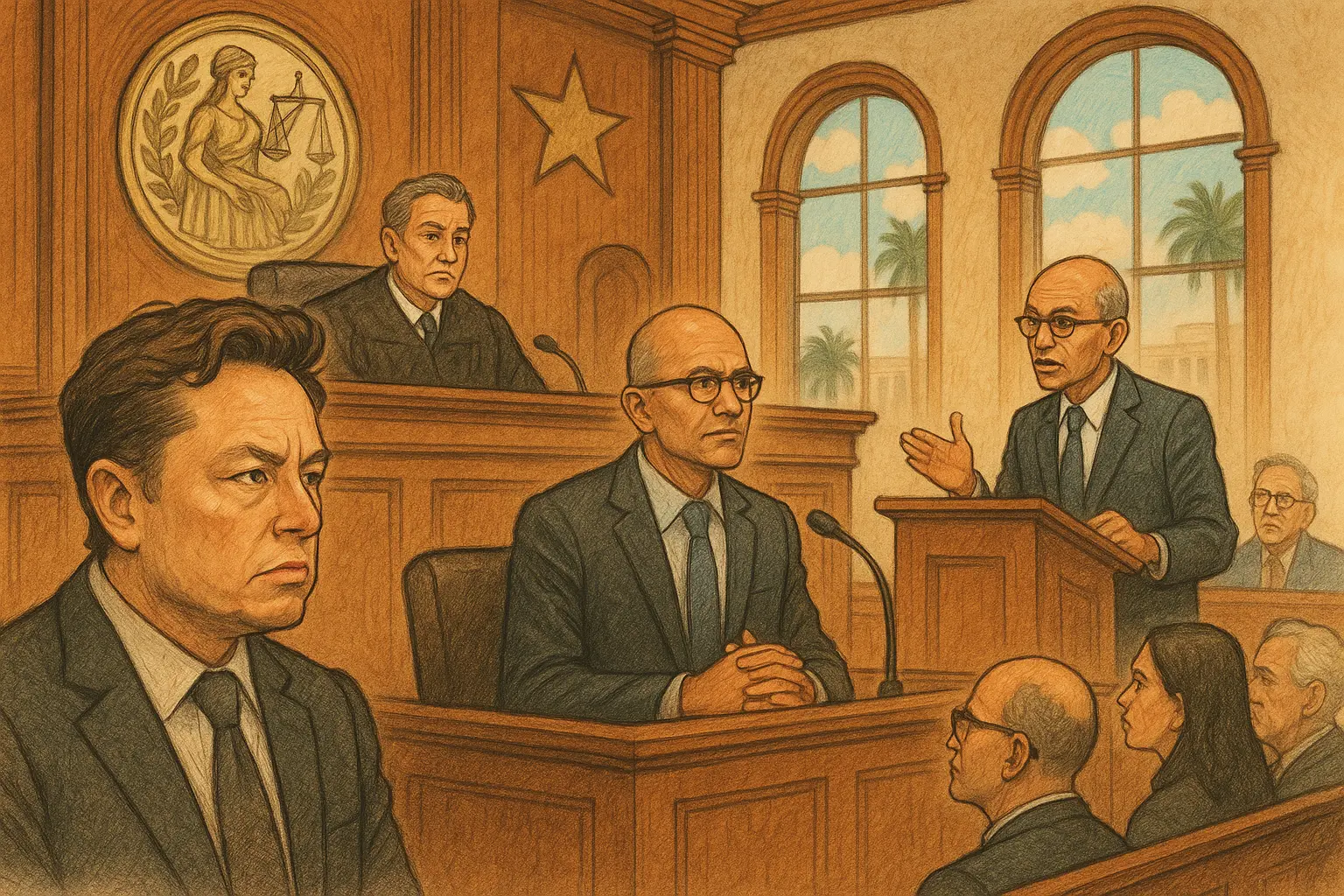

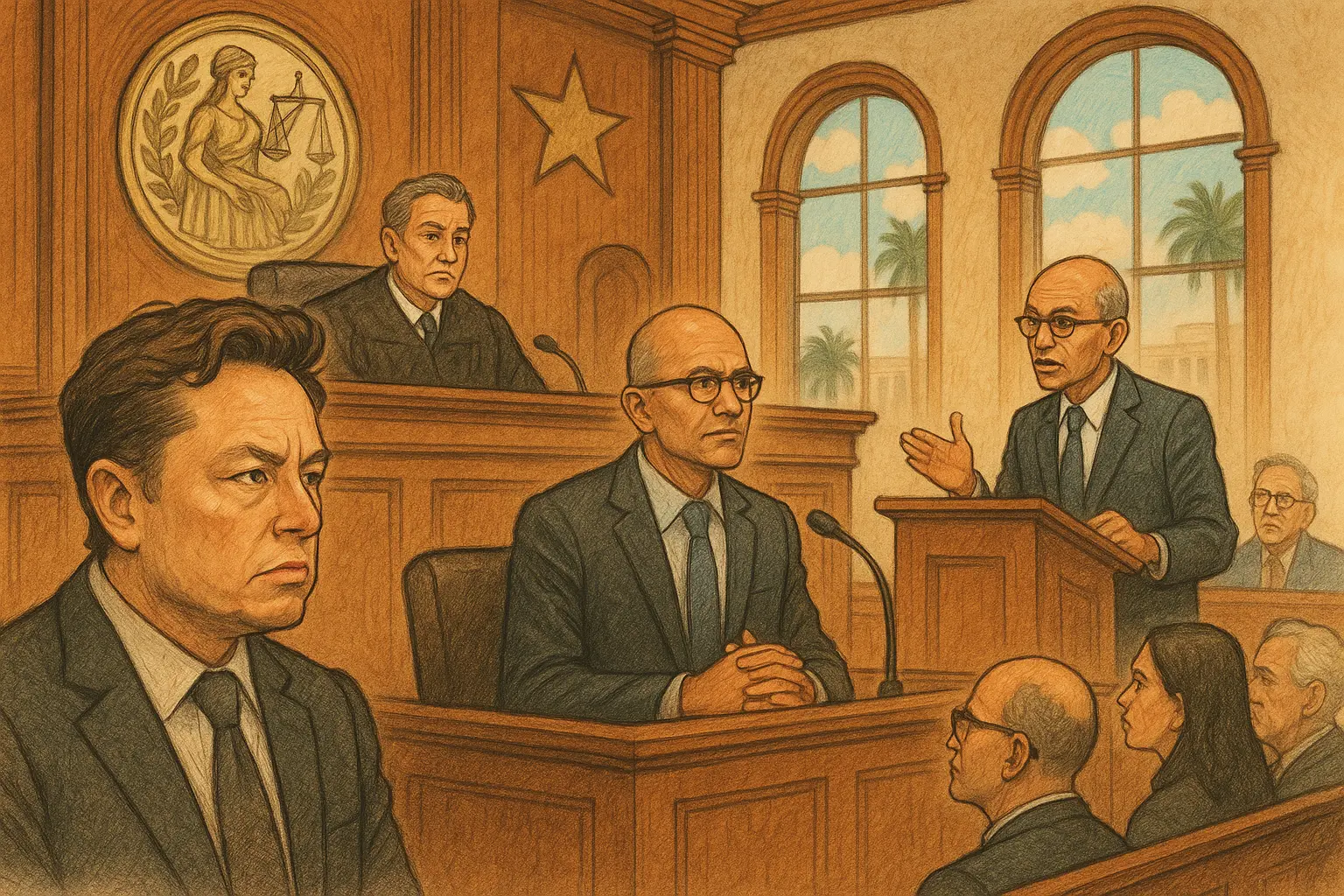

Elon Musk moveu um processo, no dia 27 de abril, no tribunal da Califórnia, para iniciar a seleção do júri, alegando que a OpenAI teria traído seu compromisso de fundação sem fins lucrativos. A juíza responsável pelo caso é Yvonne Gonzalez Rogers. De acordo com documentos do tribunal, o CEO da Microsoft, Satya Nadella, foi listado como testemunha que comparecerá ao tribunal durante o julgamento, e proferirá uma decisão final até meados de maio.

Acusação central no processo: OpenAI teria traído o compromisso de fundação sem fins lucrativos

De acordo com documentos do tribunal, Musk acusa a OpenAI de ter traído a missão sem fins lucrativos prometida no momento de sua criação. Os documentos mostram que a OpenAI foi fundada em 2015, quando Sam Altman convenceu Musk a participar como cofundador, com a intenção de ser um laboratório de pesquisa sem fins lucrativos, cuja tecnologia “pertenceria a todo o mundo”. Depois de investir milhões de dólares na OpenAI, Musk saiu; posteriormente, a OpenAI criou uma subsidiária comercial, alegando precisar de recursos para construir centros de dados. A Microsoft já investiu dezenas de bilhões de dólares na OpenAI; atualmente, a OpenAI adota uma estrutura híbrida de governança, em que o setor lucrativo é controlado por uma fundação sem fins lucrativos.

Posição de defesa da OpenAI e principais controvérsias entre as partes

De acordo com a posição de defesa apresentada pela OpenAI nos documentos judiciais, a ruptura com Musk teria sido motivada pela busca de Musk por controle absoluto da empresa, e não por uma questão de status de organização sem fins lucrativos. A OpenAI, em postagem na plataforma oficial X, afirmou: “A essência deste caso sempre foi Elon Musk agarrar mais poder e dinheiro para satisfazer seus próprios desejos. O processo dele não passa de uma ação de assédio motivada por vaidade, inveja e desejo de impedir a concorrência”.

Nos documentos do tribunal, a OpenAI também aponta que, poucos dias depois de Musk entrar na corrida de inteligência artificial em 2023, ele fez publicamente um apelo para pausar por seis meses o desenvolvimento de inteligência artificial de alto nível.

Pedido de reparação de Musk e mecanismo de decisão do tribunal

De acordo com documentos do tribunal, o pedido de reparação de Musk inclui: obrigar a OpenAI a restabelecer-se como uma organização puramente sem fins lucrativos, e substituir o cofundador e CEO Greg Brockman (Greg Brockman) e o cofundador. Musk havia proposto um pedido de indenização de até 1,34 bilhão de dólares; depois, retirou a alegação de ganhos pessoais, comprometendo-se a doar qualquer quantia de indenização à organização sem fins lucrativos da OpenAI. De acordo com os documentos do tribunal, o juiz Gonzalez Rogers reserva o direito de decidir por conta própria quaisquer soluções de indenização, sem necessidade de participação do júri nesta etapa.

Perguntas frequentes

Quais acusações específicas de Musk contra a OpenAI, e como o julgamento será conduzido?

De acordo com documentos do tribunal, Musk acusa a OpenAI de ter traído a missão sem fins lucrativos prometida quando foi fundada em 2015. O julgamento começará na Califórnia, em 27 de abril de 2026 (segunda-feira), com a seleção do júri. A juíza presidente Gonzalez Rogers emitirá uma decisão final até meados de maio, com base em uma investigação conduzida pelo júri.

Quais tipos de reparação legal Musk busca no processo?

De acordo com documentos do tribunal, Musk pede ao tribunal que obrigue a OpenAI a restabelecer-se como uma organização puramente sem fins lucrativos e que substitua o CEO Altman e o presidente Brockman. Musk havia solicitado 1,34 bilhão de dólares; depois, retirou a alegação de ganhos pessoais, comprometendo-se a doar qualquer quantia de indenização à organização sem fins lucrativos da OpenAI.

Por que o CEO da Microsoft, Nadella, deve comparecer para depor, e qual é a relação dele com a OpenAI?

De acordo com documentos do tribunal, o CEO da Microsoft, Satya Nadella, testemunhará no julgamento. A Microsoft é o principal investidor da OpenAI, já investiu dezenas de bilhões de dólares nela e detém interesses correspondentes na estrutura híbrida de governança atual da OpenAI.

Aviso: As informações nesta página podem ser provenientes de terceiros e não representam as opiniões ou pontos de vista da Gate. O conteúdo exibido nesta página é apenas para referência e não constitui aconselhamento financeiro, de investimento ou jurídico. A Gate não garante a exatidão ou integridade das informações e não será responsável por quaisquer perdas decorrentes do uso dessas informações. Os investimentos em ativos virtuais apresentam altos riscos e estão sujeitos a uma volatilidade de preços significativa. Você pode perder todo o capital investido. Por favor, compreenda completamente os riscos envolvidos e tome decisões prudentes com base em sua própria situação financeira e tolerância ao risco. Para mais detalhes, consulte o

Aviso Legal.

Related Articles

O senador Bernie Sanders emite um alerta sobre a ameaça existencial da IA

Sanders enfatizou que, mesmo que a maioria dos cientistas de IA reconheça a possibilidade de a IA escapar do controle e se tornar um perigo para a nossa existência, nenhuma medida importante foi tomada para evitá-la. “Devemos garantir que a IA beneficie a humanidade, e não nos prejudique”, afirmou.

Principais conclusões:

Bernie Sanders

Coinpedia4m atrás

Responsável pelo grande modelo de IA da Xiaomi: a competição em IA está mudando para a era dos Agentes; a autoevolução é o evento-chave para a AGI

A responsável pela equipe do grande modelo da Xiaomi, Luo Fuli, concedeu uma entrevista em profundidade (número do vídeo: BV1iVoVBgERD) na plataforma Bilibili em 24 de abril, com duração de 3,5 horas. Esta foi sua primeira vez, em sua função como responsável técnico, a expor de forma sistemática suas perspectivas técnicas em público. Luo Fuli afirmou que a corrida pela competição de grandes modelos passou da era do Chat para a era dos Agentes e apontou que “autoevolução” será o principal evento para a AGI no próximo ano.

MarketWhisper4m atrás

A voz do Grok da xAI assume a linha de atendimento ao cliente da Starlink, 70% das ligações são encerradas automaticamente

De acordo com o anúncio oficial da xAI em 23 de abril, a xAI lançou o agente de IA de voz Grok Voice Think Fast 1.0 e já foi implantado na linha de atendimento ao cliente do Starlink +1 (888) GO STARLINK. De acordo com os dados de testes divulgados no anúncio, 70% das ligações são encerradas automaticamente por IA, sem necessidade de intervenção de um humano.

MarketWhisper16m atrás

GPT-5.5 Volta ao Topo em Codificação, mas a OpenAI Troca os Benchmarks Depois de Perder para o Opus 4.7

Mensagem do Gate News, 27 de abril — A SemiAnalysis, uma empresa de análise de semicondutores e IA, divulgou um benchmark comparativo de assistentes de codificação, incluindo GPT-5.5, Claude Opus 4.7 e DeepSeek V4. A principal descoberta: GPT-5.5 marca o primeiro retorno da OpenAI ao limite do que há de mais avançado em modelos de codificação em seis meses, com engenheiros da SemiAnalysis agora alternando entre Codex e Claude Code depois de anteriormente dependerem quase exclusivamente de Claude. O GPT-5.5 é baseado em uma nova abordagem de pré-treinamento codificada como "Spud" e representa a primeira expansão do OpenAI na escala de pré-treinamento desde o GPT-4.5.

Em testes práticos, surgiu uma divisão clara de funções. Claude fica com o planejamento de projetos novos e a configuração inicial, enquanto Codex se destaca em correções de bugs que exigem raciocínio intensivo. O Codex demonstra uma compreensão mais forte de estruturas de dados e raciocínio lógico, mas tem dificuldades para inferir a intenção ambígua do usuário. Em uma tarefa única no painel, o Claude replicou automaticamente o layout da página de referência, mas fabricou grandes quantidades de dados, enquanto o Codex pulou o layout, mas entregou dados significativamente mais precisos.

A análise revela um detalhe de manipulação de benchmark: o post do blog da OpenAI de fevereiro incentivou a indústria a adotar o SWE-bench Pro como o novo padrão para benchmarks de codificação. No entanto, o anúncio do GPT-5.5 mudou para um novo benchmark chamado "Expert-SWE." O motivo, escondido nas letras miúdas, é que o GPT-5.5 foi superado pelo Opus 4.7 no SWE-bench Pro e ficou muito aquém do não lançado Mythos da Anthropic 77.8%.

Em relação ao Opus 4.7, a Anthropic publicou uma análise pós-mortem uma semana após o lançamento, reconhecendo três bugs no Claude Code que persistiram por várias semanas de março a abril, afetando quase todos os usuários. Vários engenheiros já haviam relatado degradação de desempenho na versão 4.6, mas foram dispensados como observações subjetivas. Além disso, o novo tokenizador do Opus 4.7 aumenta o uso de tokens em até 35%, algo que a Anthropic admitiu abertamente—o que, efetivamente, constitui um aumento de preço oculto.

O DeepSeek V4 foi avaliado como "acompanhando o ritmo da fronteira, mas não liderando," posicionando-se como a alternativa de menor custo entre modelos de código fechado. A análise também observou que "Claude continua a superar o DeepSeek V4 Pro em tarefas de escrita em chinês de alta dificuldade," comentando que "Claude venceu o modelo chinês na própria língua.

O artigo apresenta um conceito-chave: a precificação dos modelos deve ser avaliada por "custo por tarefa" em vez de "custo por token." A precificação do GPT-5.5 é o dobro da do GPT-5.4 input $5, output por um milhão de tokens, mas ele conclui as mesmas tarefas usando menos tokens, tornando o custo real não necessariamente mais alto. Os dados iniciais da SemiAnalysis mostram que a proporção input-to-output do Codex é de 80:1, menor do que a do Claude Code, de 100:1.

GateNews20m atrás

Executivo da Google DeepMind: Toda Empresa de Produtos de IA Deve Criar Benchmarks Personalizados

Mensagem do Gate News, 27 de abril — Logan Kilpatrick, gerente sênior de produto na Google DeepMind e líder de produto do Google AI Studio, declarou no X que toda empresa que desenvolve produtos baseados em IA deve criar seus próprios benchmarks personalizados para medir o desempenho dos modelos de IA. Ele descreveu isso como um método para

GateNews1h atrás

聯發科 conquista grande pedido da Google do 8º TPU! ASIC acelera e impulsiona ações de três grupos relacionados

A MediaTek já entrou na cadeia de fornecimento de chips de treinamento do 8º geração de TPU do Google, responsável pelo design do I/O Die, e adotou a tecnologia de processo N3P da TSMC e o empacotamento CoWoS-S, mostrando que ela atingiu um nível de design de AI ASIC de ponta. Espera-se que, neste ano, a receita do segmento ASIC ultrapasse 1 bilhão de dólares, e que o volume de envio de TPU chegue a ter potencial de chegar a dezenas de milhões de unidades até 2027; a cadeia de fornecimento de Taiwan, como King Yuan Electronics, Jing Ce e Hon Hai, também será beneficiada, e o mercado está gradualmente se voltando para o futuro de divisão de trabalho, colaboração e integrações de chiplets e heterogêneas.

ChainNewsAbmedia1h atrás