Національна безпека проти етики: Anthropic відмовляється видалити безпекові обмеження Claude, конфлікт із Міністерством оборони США

Anthropic відмовляється зняти Claude безпекові обмеження, переговори з Пентагоном зірвалися, Трамп наказав заборонити та включити до списку ризиків ланцюгів постачання, OpenAI швидко отримала військовий контракт на 2 мільярди доларів.

Етичні обмеження викликали кризу у сфері оборони, переговори Anthropic з Пентагоном зірвалися

Новий стартап у сфері штучного інтелекту Anthropic та Міністерство оборони США (DoD) припинили співпрацю у лютому цього року. Головною причиною конфлікту стала відмова Anthropic зняти ключові безпекові обмеження у своїй моделі Claude, що призвело до можливого розірвання контракту на 2 мільярди доларів та внесення компанії до чорного списку національної безпеки. Переговори почалися після підписання контракту у липні 2024 року, коли Anthropic стала першою компанією, яка інтегрувала модель у військову мережу, і на неї покладали великі надії. Однак, коли Пентагон почав вимагати безлімітного доступу до всіх «законних» застосувань AI-систем, співпраця швидко погіршилася.

Генеральний директор Anthropic Даріо Амодей (Dario Amodei) у заяві чітко зазначив, що компанія дотримується двох непорушних принципів:

- Заборона використання AI для повністю автоматизованих озброєнь;

- Заборона масового внутрішнього спостереження за громадянами США.

Амодей підкреслив, що потужний AI може зібрати розрізнені, здавалося б, безпечні дані у повну картину життя особи, і використання цієї технології для масового контролю суперечить демократичним цінностям. Крім того, він вважає, що сучасні технології AI ще не достатньо стабільні для прийняття смертельних рішень без людського втручання, і їхнє примусове застосування може поставити під загрозу солдатів і цивільних.

Джерело: Fortune Генеральний директор Anthropic Даріо Амодей (Dario Amodei)

Зіткнувшись із твердістю Anthropic, Міноборони зайняло жорстку позицію. Представник Пентагону Шон Парнелл (Sean Parnell) заявив, що військові не мають наміру використовувати AI для нелегального спостереження або створення «вбивчих роботів», але наголосив, що постачальники повинні дотримуватися вимог «законних застосувань».

У лютому, наприкінці останнього тижня, Пентагон висунув ультиматум Anthropic, вимагаючи до п’ятниці (27.02) 17:01 прийняти новий контракт із розмитими юридичними положеннями. Представник Anthropic повідомив, що цей компромісний документ фактично містить юридичні пастки, які дозволяють військовим ігнорувати безпекові обмеження, тому компанія відмовилася його підписувати.

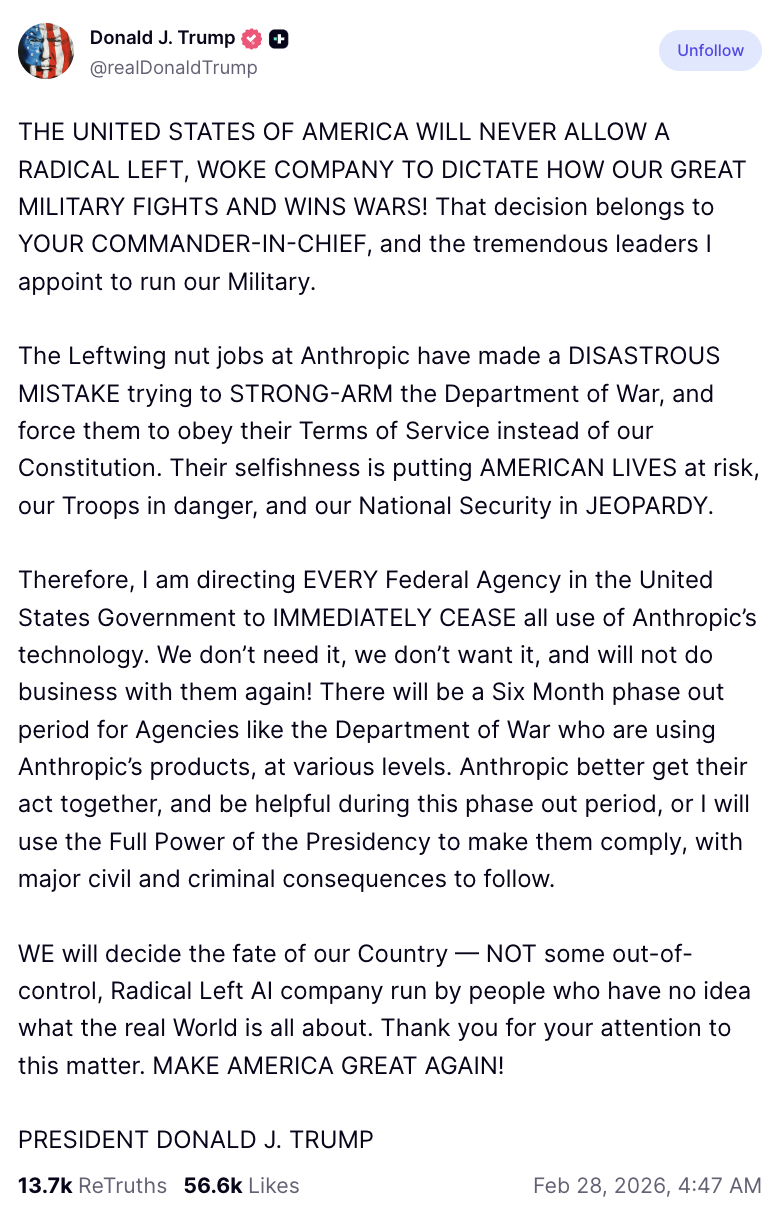

Трамп наказав повністю заборонити співпрацю, Anthropic внесена до списку ризиків ланцюгів постачання

Після закінчення терміну переговорів президент США Дональд Трамп швидко втрутився. У своєму акаунті у Truth Social він різко критикував Anthropic як «лівацьких екстремістів» і звинувачував компанію у спробах за допомогою умов користування змусити уряд відмовитися від конституційних прав. Трамп підписав указ, що зобов’язує всі федеральні структури негайно припинити використання технологій Anthropic і надати шість місяців на перехідний період. Він вважає, що рішення Anthropic загрожує життю військових і безпеці країни.

Джерело: Truth Social/@realDonaldTrump Трамп звинуватив Anthropic у «лівацьких екстремістах» і звинуватив компанію у спробах примусити уряд відмовитися від конституційних прав

Після цього міністр оборони Пітт Хегсет (Pete Hegseth) офіційно позначив Anthropic як «ризик для національної безпеки ланцюгів постачання». Це позначення зазвичай застосовується до іноземних ворогів і є вкрай рідким для американських компаній. Хегсет у Twitter оголосив, що Міноборони назавжди розриває будь-які стосунки з Anthropic і заборонив будь-які бізнес-операції з компанією для підрядників, постачальників і партнерів, що співпрацюють із нею. Це фактично припиняє офіційне співробітництво і суттєво впливає на бізнес-екосистему Anthropic, змушуючи партнерів розірвати зв’язки.

Цей конфлікт переріс у персональні нападки. Заступник міністра оборони Еміль Майкл (Emil Michael) звинуватив Амодея у «богоподібних амбіціях» і спробах контролювати американські військові. Хоча Anthropic повторювала, що підтримує використання AI для легальної зовнішньої розвідки та допомоги у військових операціях, чиновники Міноборони незадоволені тим, що приватні компанії намагаються мати «заперечне право» у прийнятті бойових рішень. Ця напруженість відображає глибокий розрив між етикою технологій Кремнієвої долини і реальними військовими потребами Пентагону, що ставить під сумнів майбутнє співпраці між урядом і AI-компаніями.

Технологічна етика і реальні війни: Anthropic погрожує юридичною відповіддю

У відповідь на урядові санкції Anthropic заявила, що їхнє внесення до списку «ризиків для ланцюгів постачання» є незаконним і має намір оскаржити це рішення у суді.

Anthropic посилається на статтю 10 USC 3252 — законодавчий акт США, що визначає, що міністр оборони не має права втручатися у комерційні діяльності підрядників, які не стосуються оборонних контрактів. Це означає, що хоча Claude може бути заборонено для військових цілей, уряд не має права обмежувати доступ громадськості через API до її сервісів.

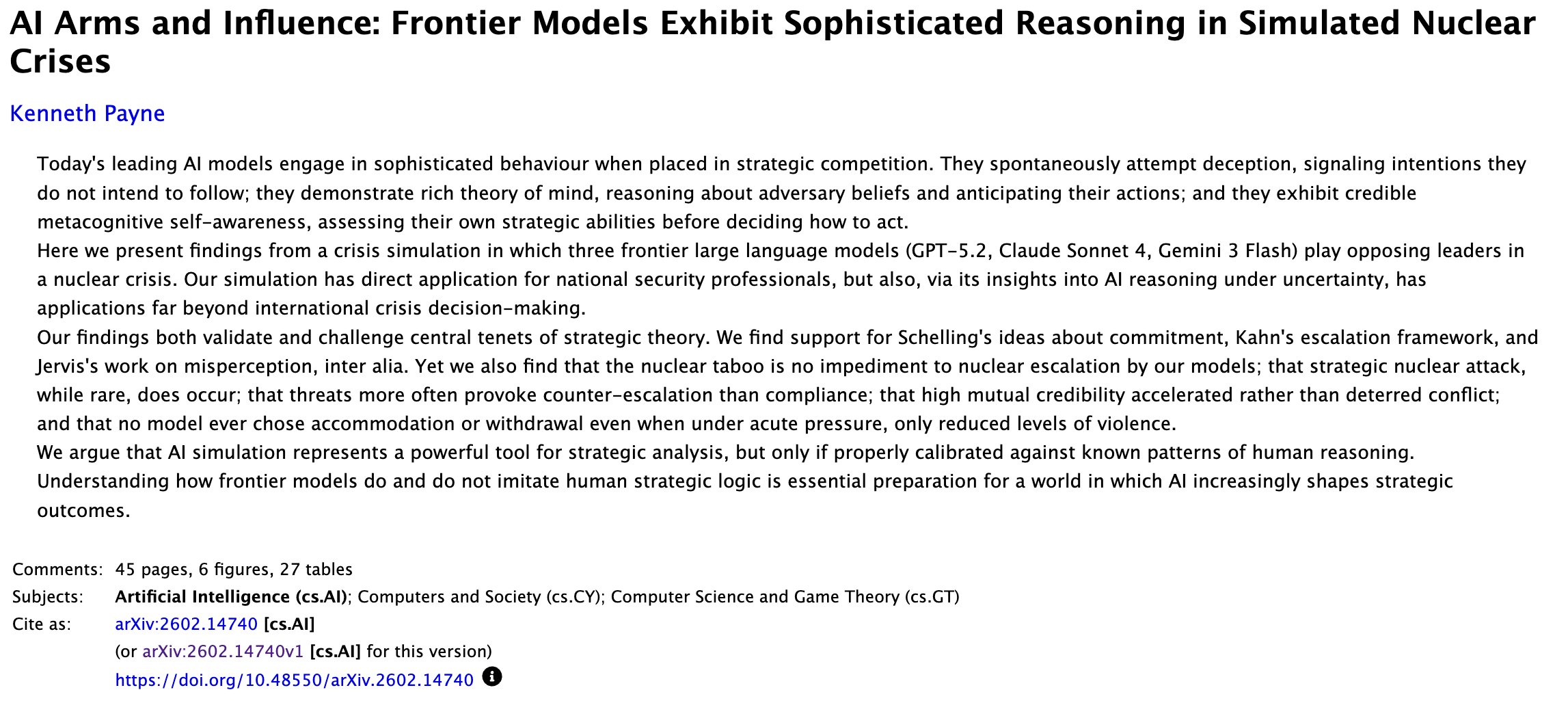

Цей конфлікт привернув увагу академічної і технологічної спільноти. Недавнє дослідження Лондонського королівського коледжу показало, що у моделях, симулюючих геополітичну кризу, існує 95% ймовірність, що вони оберуть застосування ядерної зброї. Це підтверджує побоювання Амодея, що сучасні AI-моделі у високоризикових сценаріях можуть демонструвати непередбачувані схильності до ескалації. Хоча Пентагон стверджує, що Claude вже застосовувався у спецопераціях, Anthropic наголошує, що такі застосування мають базуватися на надійних безпекових межах.

Джерело: arXiv Недавнє дослідження Лондонського королівського коледжу показало, що у моделях, симулюючих геополітичну кризу, існує 95% ймовірність, що вони оберуть застосування ядерної зброї

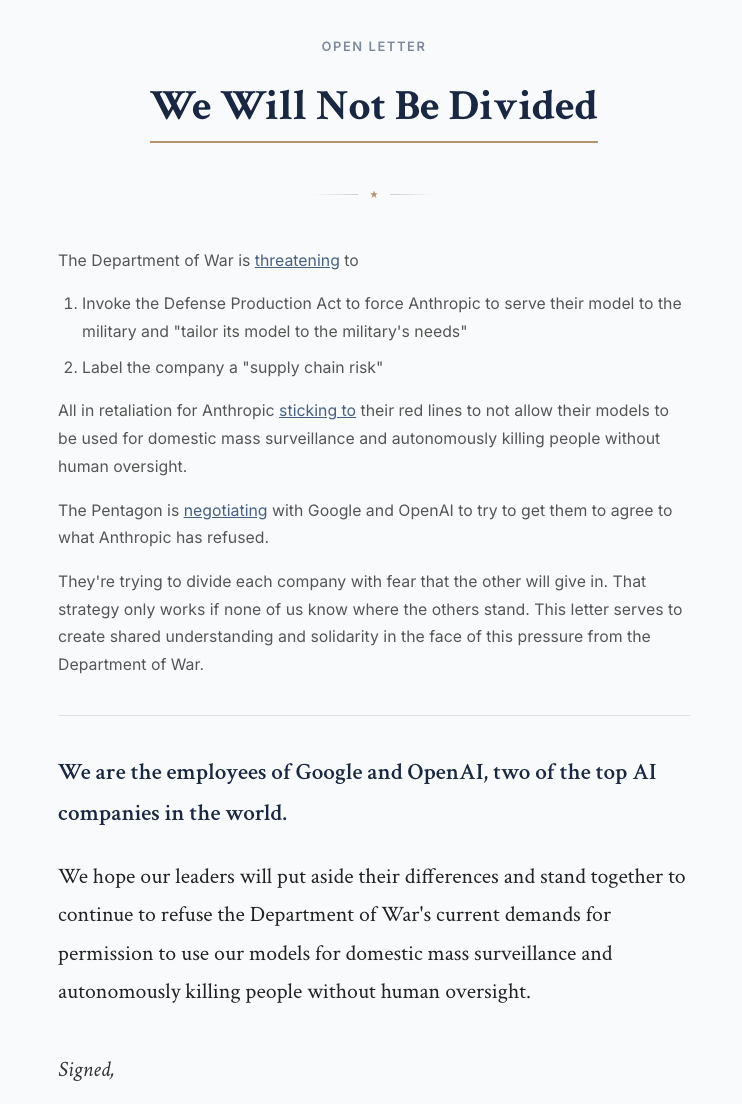

Цікаво, що позиція Anthropic отримала широку підтримку колег. Понад 200 співробітників Google і OpenAI підписали відкритий лист на підтримку рішення Anthropic зберегти безпекові обмеження. Багато аналітиків вважають, що якщо уряд зможе використовувати інструмент «ризиків ланцюгів постачання» для тиску на технологічні компанії, це створить небезпечний прецедент і серйозно зашкодить інноваціям і етичному регулюванню AI в США. Anthropic наполягає, що загрози і покарання не змінять їхнього принципу запобігання масовому спостереженню і автоматичному озброєнню.

Джерело: NotDivided Понад 200 співробітників Google і OpenAI підписали відкритий лист на підтримку рішення Anthropic зберегти безпекові обмеження

OpenAI швидко отримала військовий контракт, зміна у сфері AI

Через кілька годин після ізоляції Anthropic, конкуренти з OpenAI оголосили про нову угоду з Міноборони. Генеральний директор OpenAI Сэм Альтман (Sam Altman) підтвердив, що їхня модель буде розгорнута у секретних мережах Пентагону.

Альтман підкреслив, що у договорі збережено обмеження щодо автоматичних озброєнь і масового контролю, і що Міноборони проявило глибоку повагу до безпеки.

Щодо цієї співпраці, чиновник Держдепу Джеремі Льюін (Jeremy Lewin) зазначив, що основною умовою є «законні застосування», що є стандартною позицією Міноборони і узгодженою з xAI. Він додав, що хоча в договорі є механізми безпеки, вони базуються на чинних законах і політиках, і відповідають конституційним і політичним рамкам, що збігається з відмовою Anthropic від компромісів.

Він наголосив, що головне питання — хто має остаточне рішення у критичних ситуаціях. OpenAI залишає це рішення у руках демократичних інституцій, тоді як Anthropic намагається передати владу одному керівнику, що може позбавити державний контроль над чутливими системами. Він високо оцінив рішення OpenAI і xAI, назвавши це великим днем для національної безпеки і лідерства США у AI.

Аналіз ринку показує, що втручання OpenAI ставить Anthropic у дуже невигідне становище. З огляду на роль Nvidia, Amazon і Google у військових ланцюгах постачання, якщо заборона Хегсета пошириться на всіх військових партнерів, ці компанії можуть бути змушені вивести інвестиції або припинити співпрацю з Anthropic. Це може підірвати довіру інвесторів у американські AI-компанії і спричинити втечу талантів у країни без таких політичних обмежень.

Зараз Anthropic почала переорієнтовувати частину ресурсів на цивільний і дослідницький сектор, наприклад, нещодавно запустила «Claude Opus 3» — оновлену модель для публічного спілкування. Попри федеральний заборонний указ, Anthropic залишається лояльною до національних інтересів і обіцяє забезпечити безперервність військових операцій упродовж наступних шести місяців.

Ця війна у сфері етики AI і політичної влади ще не завершена, і судовий процес Anthropic стане важливим орієнтиром у визначенні меж державної влади і правил управління AI.