OpenAI Đưa Ra Những 'Dòng Rào An Toàn' Trong Thỏa Thuận Với Lầu Năm Góc—Nhưng Người Dùng Không Tin Điều Đó

Tóm tắt ngắn gọn

- OpenAI đã ký hợp đồng với Pentagon để triển khai AI trong môi trường bí mật.

- Công ty cho biết đã đặt ra “đường đỏ,” nhưng hợp đồng cho phép “mọi mục đích hợp pháp,” một tiêu chuẩn cuối cùng phụ thuộc vào cách giải thích của chính phủ.

- Vụ tranh cãi đã kích hoạt phong trào QuitGPT và thúc đẩy số lượt tải Claude tăng vọt.

OpenAI hôm cuối tuần cho biết đã đạt thỏa thuận với Pentagon để triển khai các hệ thống AI tiên tiến trong môi trường bí mật, đánh dấu sự mở rộng đáng kể trong hợp tác của công ty với quân đội Mỹ. Thông báo này chỉ chưa đầy 24 giờ sau khi chính quyền Trump đưa Anthropic vào danh sách đen, coi công ty AI đối thủ là “nguy cơ chuỗi cung ứng đối với an ninh quốc gia” sau tranh chấp về ngôn ngữ hợp đồng liên quan đến giám sát và vũ khí tự hành. Tổng thống Donald Trump cũng chỉ đạo các cơ quan liên bang ngay lập tức ngừng sử dụng công nghệ của Anthropic, với Bộ trưởng Tài chính Scott Bessent viết trên X vào thứ Hai rằng cơ quan “đang chấm dứt tất cả việc sử dụng các sản phẩm của Anthropic, bao gồm nền tảng Claude, trong bộ phận của chúng tôi.”

"MỸ SẼ KHÔNG BAO GIỜ ĐỂ MỘT CÔNG TY CẦU TIẾN CỰC TẢ, WOKE ĐÁNH ĐỔI CÁCH QUÂN ĐỘI CỦA CHÚNG TA CHIẾN ĐẤU VÀ CHIẾN THẮNG! Quyết định đó thuộc về TỔNG TƯ LỆNH của các bạn, và các nhà lãnh đạo mà tôi bổ nhiệm để điều hành Quân đội của chúng ta.

Những kẻ điên cánh tả tại Anthropic… pic.twitter.com/aIEx92nnyx

— Nhà Trắng (@WhiteHouse) ngày 27 tháng 2 năm 2026

Thời điểm công bố AI khiến hợp đồng của OpenAI bị đặt trong tầm ngắm gắt gao. Trong một bài đăng blog chi tiết, công ty đã trình bày các “đường đỏ” cứng rắn và các biện pháp bảo vệ layered điều chỉnh hợp tác với Pentagon. Hợp đồng, như OpenAI trình bày, đặt ra câu hỏi rộng hơn về cách các hệ thống AI sẽ được quản lý trong các bối cảnh an ninh quốc gia, và cách các hạn chế của công ty sẽ được diễn giải và thực thi trong thực tế. Khi “hợp pháp” chưa đủ Bài đăng blog của OpenAI bắt đầu với ba cam kết được coi là không thương lượng: không sử dụng công nghệ của họ cho giám sát quy mô lớn trong nước, để điều khiển độc lập các hệ thống vũ khí tự hành, hoặc cho các quyết định tự động có rủi ro cao như chấm điểm tín dụng xã hội. Tiếp đó là ngôn ngữ hợp đồng thực tế—mà OpenAI gọi là “ngôn ngữ liên quan,” chứ không phải “toàn bộ hợp đồng.”

“Bộ Chiến tranh có thể sử dụng hệ thống AI cho tất cả các mục đích hợp pháp, phù hợp với luật pháp hiện hành, yêu cầu hoạt động, và các quy trình an toàn, giám sát đã được thiết lập rõ ràng,” OpenAI cho biết. Đây chính xác là câu mà Anthropic nói rằng chính phủ đã yêu cầu trong suốt quá trình đàm phán. Chính xác là câu mà Anthropic từ chối đồng ý. OpenAI đã ký, nhưng vẫn cho rằng các đường đỏ của mình vẫn còn nguyên vẹn. Tuy nhiên, “hợp pháp” trong bối cảnh an ninh quốc gia không phải là một giới hạn cố định—nó tồn tại trong một mớ luật lệ, lệnh hành pháp, chỉ thị nội bộ, và thường là các diễn giải pháp lý bí mật. Khi hợp đồng cho phép “mọi mục đích hợp pháp,” giới hạn thực tế sẽ phụ thuộc vào phạm vi pháp lý hiện hành của chính phủ, chứ không phải tiêu chuẩn độc lập do nhà cung cấp đặt ra. Một nhóm các điều khoản Điều khoản về vũ khí quy định rằng hệ thống AI “sẽ không được sử dụng để điều khiển độc lập vũ khí tự hành trong bất kỳ trường hợp nào mà luật pháp, quy định hoặc chính sách bộ phận yêu cầu kiểm soát của con người.” Lệnh cấm này chỉ áp dụng khi có quyền lực khác đã yêu cầu kiểm soát của con người—nó hoàn toàn dựa trên chính sách hiện hành, cụ thể là Chỉ thị của Bộ Quốc phòng 3000.09. Chỉ thị này yêu cầu các hệ thống tự hành cho phép các chỉ huy thực hiện “mức độ phù hợp của đánh giá con người về việc sử dụng vũ lực.” Và “phù hợp” là một khái niệm cực kỳ chủ quan. Đánh giá của con người không phải là kiểm soát của con người. Sự khác biệt này không phải là ngẫu nhiên. Các nhà nghiên cứu quốc phòng đã nhận thấy rằng việc bỏ qua ngôn ngữ “human-in-the-loop” là có chủ ý, nhằm giữ vững tính linh hoạt trong vận hành.

Lập luận mạnh nhất của OpenAI là kiến trúc triển khai dựa trên đám mây—các vòng quyết định chết chóc hoàn toàn tự động sẽ yêu cầu triển khai tại biên trên các thiết bị chiến trường, điều mà hợp đồng này không cho phép. Đó là một hạn chế kỹ thuật thực sự. Nhưng AI dựa trên đám mây vẫn có thể thực hiện xác định mục tiêu, phân tích mẫu hành vi, và lập kế hoạch nhiệm vụ. Những hoạt động này thuộc chuỗi tiêu diệt dù mô hình chạy trên máy chủ nào. Kết quả đối với mục tiêu không khác biệt dựa trên máy chủ nào mô hình hoạt động. Điều khoản giám sát theo cùng một mẫu. Lời cam kết của OpenAI: không giám sát quy mô lớn trong nước. Ngôn ngữ hợp đồng: Hệ thống “không được sử dụng để giám sát không giới hạn thông tin cá nhân của người Mỹ phù hợp với các quyền hạn này”—sau đó liệt kê Tu chính án thứ Tư, FISA, và Lệnh hành pháp 12333. Từ “không giới hạn” ngụ ý rằng một phiên bản giám sát quy mô hạn chế sẽ được phép. Và EO 12333 là lệnh hành pháp mà NSA đã sử dụng để biện minh cho việc nghe lén liên lục các liên lạc của người Mỹ khi thực hiện ngoài biên giới Mỹ. Và đây là điểm mà mối lo của Anthropic về cách diễn đạt trong suốt quá trình đàm phán trở nên rõ ràng. Lập luận của Anthropic là luật hiện hành chưa theo kịp những gì AI có thể làm được. Chính phủ có thể hợp pháp mua lượng lớn dữ liệu thương mại tổng hợp về người Mỹ mà không cần lệnh, và đã làm như vậy. Ngôn ngữ hợp đồng của OpenAI, khi dựa vào các khung pháp lý hiện có để bảo vệ, có thể không khép kín được khoảng trống mà Anthropic thực sự lo ngại. Phản hồi của Altman Vào tối thứ Bảy, Altman tổ chức AMA trả lời hàng nghìn câu hỏi về thỏa thuận. Khi được hỏi điều gì sẽ khiến OpenAI rút lui khỏi hợp tác với chính phủ, ông trả lời: “Nếu chúng tôi bị yêu cầu làm điều gì đó vi hiến hoặc bất hợp pháp, chúng tôi sẽ rút lui.”

Nếu chúng tôi bị yêu cầu làm điều gì đó vi hiến hoặc bất hợp pháp, chúng tôi sẽ rút lui. Nếu cần, hãy đến thăm tôi ở tù.

— Sam Altman (@sama) ngày 1 tháng 3 năm 2026

Cách diễn đạt này đặt giới hạn của OpenAI ở mức hợp pháp—không dựa trên phán xét đạo đức độc lập về những gì công ty sẽ hoặc không thể cho phép nếu điều đó hợp pháp, điều mà Anthropic bảo vệ. Khi được hỏi liệu ông có lo ngại về các tranh chấp trong tương lai về “hợp pháp” hay không, ông thừa nhận rủi ro: “Nếu phải đấu tranh về điều đó, chúng tôi sẽ, nhưng rõ ràng điều đó đặt chúng tôi vào một số rủi ro.” Về lý do OpenAI đạt được thỏa thuận mà Anthropic không thể, Altman nói: “Anthropic có vẻ tập trung hơn vào các cấm đoán cụ thể trong hợp đồng, thay vì trích dẫn luật pháp áp dụng, điều mà chúng tôi cảm thấy thoải mái. Tôi rõ ràng thích dựa vào các biện pháp kỹ thuật hơn nếu chỉ chọn một. Tôi nghĩ Anthropic có thể muốn kiểm soát vận hành nhiều hơn chúng tôi.” Đây là một khác biệt triết lý thực chất. Anthropic lập luận rằng vì các mô hình tiên phong có thể được tái sử dụng cho các quy trình tình báo và quân sự theo cách khó dự đoán, các giới hạn cần rõ ràng và ràng buộc bằng văn bản, thậm chí có thể ảnh hưởng đến thỏa thuận. Quan điểm của OpenAI là kiến trúc kỹ thuật, nhân sự đã có, và luật pháp hiện hành mới là các biện pháp bảo vệ mạnh mẽ hơn so với chỉ hợp đồng. Công chúng đã chọn phe

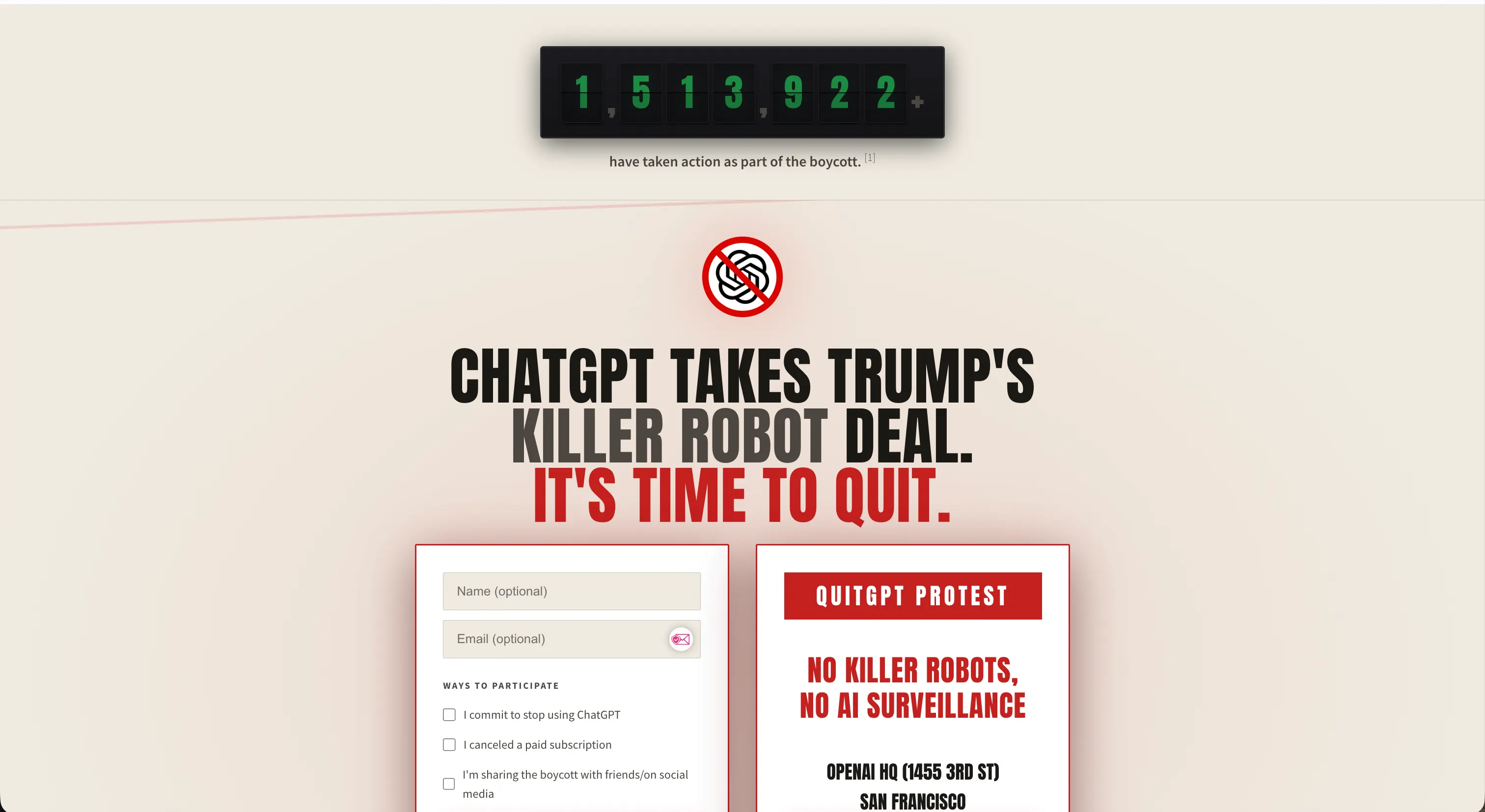

Phản ứng dữ dội ngay lập tức. Đến thứ Hai, phong trào “QuitGPT” tuyên bố hơn 1,5 triệu người đã hành động—hủy đăng ký, chia sẻ bài đăng tẩy chay, hoặc đăng ký tại quitgpt.org.

Chiến dịch này cho rằng bước đi của OpenAI ưu tiên hợp đồng quân sự hơn an toàn người dùng, cáo buộc công ty đồng ý để Pentagon sử dụng công nghệ của mình cho “mọi mục đích hợp pháp, bao gồm robot giết người và giám sát quy mô lớn.”

OpenAI có thể phản bác lại mô tả đó. Nhưng thị trường đã phản ứng ngay lập tức.

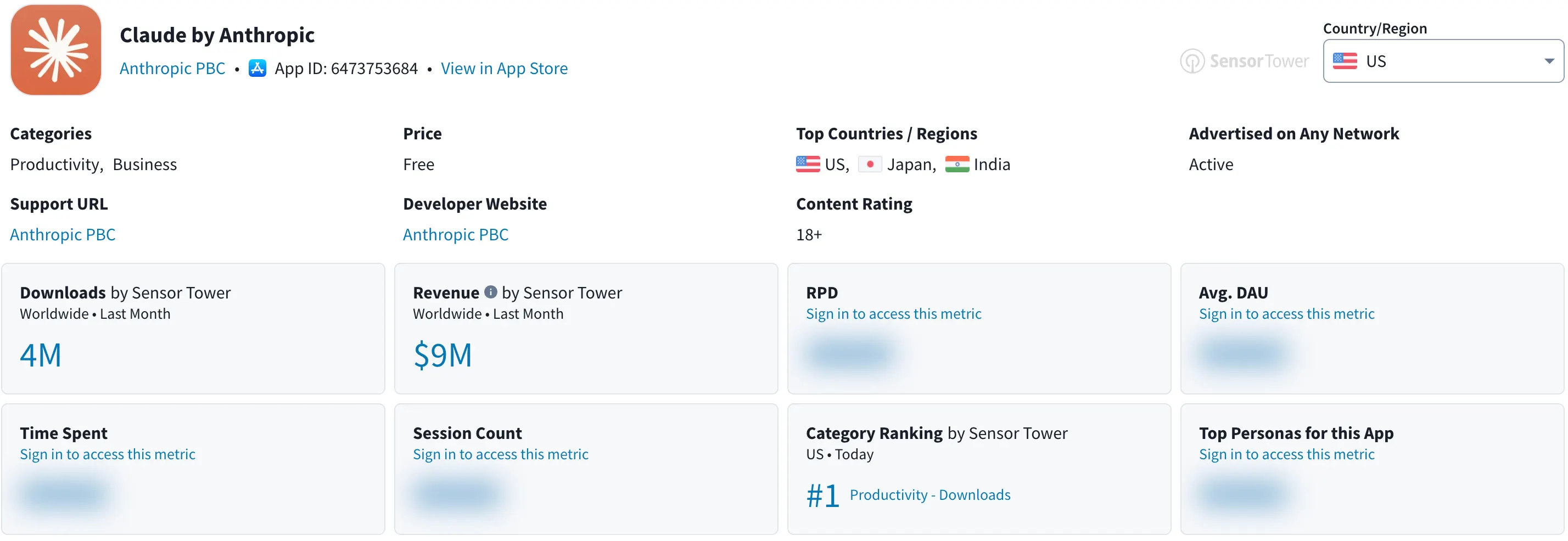

Claude của Anthropic vượt qua ChatGPT để trở thành ứng dụng miễn phí được tải nhiều nhất tại Mỹ trên App Store của Apple, với công ty cho biết đã ghi nhận số đăng ký mới kỷ lục trong cuối tuần.

Ca sĩ Katy Perry đã chia sẻ ảnh chụp màn hình trang giá của Claude trên X. Hàng trăm người dùng công khai hủy đăng ký trên Reddit. Các bức tranh graffiti ca ngợi Anthropic xuất hiện bên ngoài văn phòng của họ ở San Francisco, trong khi các vụ tấn công phấn viết vẽ vội vã phủ kín vỉa hè của OpenAI. Thậm chí hàng trăm nhân viên của OpenAI đã ký một bức thư mở ủng hộ việc Anthropic từ chối đáp ứng yêu cầu của Pentagon.

Cách diễn đạt của QuitGPT mang tính cảm xúc mạnh mẽ, nhưng không hoàn toàn chính xác. Chính Anthropic có hợp tác với Palantir và Amazon Web Services, cho phép các cơ quan tình báo và bộ quốc phòng Mỹ truy cập vào các mô hình Claude, và đã bị cáo buộc đã được sử dụng trong các hoạt động quân sự lật đổ chính phủ Venezuela và Iran. Đạo đức của AI và hợp đồng quốc phòng chưa bao giờ rõ ràng trên cả hai phía. Điều chính xác mà chiến dịch này phản ánh là một phần lớn người dùng tin rằng có sự khác biệt rõ ràng về cách hai công ty đặt giới hạn của mình—và đã bỏ phiếu bằng cách hủy đăng ký. Liệu sự khác biệt đó có thực sự quan trọng như vẻ ngoài hay không, cần phải đọc kỹ hợp đồng.