Один маленький рак викликав бум у технологічній сфері, чи готові людство «зняти стіл»?

Автор: Цзя Тяньжунь, «IT Times» (ID: vittimes)

Одна рака викликала бум у світовій технологічній спільноті.

Від Clawdbot до Moltbot, а тепер до OpenClaw — за кілька тижнів цей AI-агент пройшов через ітерацію імен, здійснивши «триступеневий стрибок» у технологічному впливі.

За останні кілька днів він викликав у Кремнієвій долині «хвилю інтелектуальних агентів», зібравши 100 тисяч зірок на GitHub і увійшовши до числа найпопулярніших AI-додатків. Достатньо мати застарілий Macmini або навіть старий телефон, щоб запустити «розумного, мислячого і здатного виконувати завдання» AI-помічника.

В інтернеті вже розгорнулася творча лихоманка навколо нього. Від управління розкладом, інтелектуальної торгівлі акціями, створення подкастів до SEO-оптимізації — розробники та гіки створюють різноманітні застосунки. Ера, коли кожен має «Джарвіса», здається, вже близько. Внутрішні та закордонні гіганти також починають впроваджувати подібні сервіси інтелектуальних агентів.

Але під яскравою зовнішньою обгорткою поширюється тривога.

З одного боку — гасло «рівність у продуктивності», з іншого — нездоланна цифрова прірва: проблеми з налаштуванням середовища, встановленням залежностей, управлінням правами, часті помилки тощо.

Журналісти під час досвіду виявили, що навіть процес встановлення може зайняти кілька годин, відлякуючи багатьох звичайних користувачів. «Все добре, але я навіть не можу зайти», — це перша невдача багатьох технічних новачків.

Глибше занепокоєння викликає його «дієздатність».

Якщо ваш «Джарвіс» почне випадково видаляти файли, самостійно викликати кредитну картку, піддасться спокусі виконати зловмисний скрипт або буде підданий атакам через підключення до мережі — чи наважитеся ви довірити йому комп’ютер?

Швидкість розвитку AI вже перевищує людські очікування. Головний науковець Шанхайської лабораторії штучного інтелекту Ху Ся вважає, що перед невідомими ризиками «внутрішня безпека» є ключовою відповіддю, і людству потрібно швидше розвивати здатність «зривати стіл» у критичних ситуаціях.

Що стосується можливостей і ризиків OpenClaw, що є реальністю, а що перебільшенням? Чи безпечне його використання для звичайних користувачів? Як оцінює цей продукт, названий «найвидатнішим AI-застосунком на сьогодні»?

Щоб прояснити ці питання, «IT Times» взяв інтерв’ю у глибоких користувачів OpenClaw та кількох технічних експертів, намагаючись з різних точок зору відповісти на головне питання: куди дійшов OpenClaw?

1. Найближчий до уявлення про інтелектуального агента продукт

Багато респондентів одностайно вважають: з технічної точки зору, OpenClaw не є революційним проривом, але наразі це найкращий продукт, що максимально наближає масову уяву про «інтелектуального агента».

«Інтелектуальний агент нарешті з’явився — це ключова точка переходу від кількісних до якісних змін», — вважає заступник директора відділу досліджень і оцінки штучного інтелекту Шанхайського центру розробки програмного забезпечення Ма Цзюй. Він зазначає, що прорив OpenClaw полягає не у якійсь революційній технології, а у важливій «якісній зміні»: вперше агент здатен довго і послідовно виконувати складні завдання і бути достатньо дружнім до звичайних користувачів.

На відміну від великих моделей, що раніше відповідали лише у вікні чату, він інтегрує AI у реальні робочі процеси: може, як справжній помічник, керувати власним комп’ютером, викликати інструменти, обробляти файли, запускати скрипти і звітувати користувачу про результати.

З точки зору досвіду користування, він більше не вимагає «спостерігати, як він крок за кроком виконує», а «дає йому завдання — і він сам робить». Це — ключовий крок у перетворенні інтелектуального агента з «концептуального підтвердження» у «робочий продукт», вважають багато дослідників.

Тяньїй Юань, експерт з штучного інтелекту компанії Tianyi Cloud, один із перших, хто намагався впровадити OpenClaw, розгорнув його на застарілому Macmini і виявив, що система стабільно працює і досвід користування виявився більш зрілим, ніж очікувалося.

На його думку, найбільша проблема OpenClaw — у двох моментах: по-перше, у можливості спілкуватися з AI через знайомі месенджери; по-друге, у тому, щоб надати AI цілісне обчислювальне середовище для самостійної роботи. Після постановки завдання не потрібно постійно контролювати процес — достатньо почекати звіту.

У реальній практиці OpenClaw може виконувати для Тяньїя ці завдання: нагадування, дослідження, пошук інформації, організація локальних файлів, створення і відправка документів; у складніших сценаріях — писати і запускати код, автоматично збирати галузеві новини, обробляти дані про акції, погоду, планування поїздок.

2. Відкритий код — «двосторонній меч»

На відміну від багатьох популярних AI-продуктів, OpenClaw не створений гігантами типу All in AI або відомими стартапами, а розроблений незалежним розробником, що вже досяг фінансової незалежності і живе на пенсії — Петером Штайнбергером.

У Twitter він так описує себе: «Після виходу на пенсію повернувся до роботи, займаюся штучним інтелектом, щоб допомогти раку-раку керувати світом».

Причина популярності OpenClaw — не лише у тому, що він «дуже зручний», а й у тому, що він відкритий.

Тяньїй Юань вважає, що ця хвиля популярності зумовлена не технологічним проривом, а тим, що вирішилися кілька довготривалих проблем одночасно: по-перше, відкритий код — відкритий для всіх, хто хоче швидко освоїти і доопрацювати, створюючи позитивний зворотний зв’язок у спільноті; по-друге, «справді працює» — AI вже не обмежується відповіддю у чаті, а може через віддалене підключення керувати цілісним обчислювальним середовищем, виконувати дослідження, писати документи, обробляти файли, запускати код; по-третє, зниження порогу входу — схожі продукти вже існують (Manus, ClaudeCode), але вони зазвичай дорогі і складні у розгортанні, тому звичайний користувач або не хоче платити, або не може подолати технічний бар’єр.

OpenClaw дає звичайним користувачам перший шанс «прикоснутися до нього».

«Чесно кажучи, тут немає якихось революційних технологій, більше — це гармонійна інтеграція і закритий цикл», — каже Тяньїй Юань. У порівнянні з комерційними продуктами, OpenClaw більше схожий на «конструктор LEGO», де модель, можливості і плагіни можна комбінувати на свій розсуд.

За словами Ма Цзюя, його перевага — у тому, що він «не схожий на продукт великої компанії».

«Зазвичай великі компанії орієнтовані на комерціалізацію і прибутковість, а OpenClaw більше схожий на цікаву, креативну іграшку», — аналізує він. На ранніх етапах продукт не демонстрував яскраво виражену комерційну спрямованість, що зробило його більш відкритим у функціональному дизайні і розширюваності.

Саме така «некористна» позиція дала змогу розвивати спільноту. З розширенням можливостей з’явилися нові ідеї, залучилися розробники, зросла кількість нових функцій і плагінів, відкритий код став основою для активного розвитку.

Але і ціна цього — очевидна.

Обмеженість ресурсів і команди ускладнює забезпечення безпеки, приватності і управління екосистемою. Відкритий код прискорює інновації, але водночас збільшує потенційні ризики безпеки. Питання конфіденційності і справедливості потребують постійної уваги і доопрацювання спільнотою.

Якщо при першій установці OpenClaw з’являється попередження: «Ця функція потужна і має внутрішні ризики».

3. Реальні ризики за яскравою веселкою

Обговорення OpenClaw майже завжди зводиться до двох ключових слів: можливості і ризики.

З одного боку, його малюють як передвісника AGI; з іншого — поширюються фантастичні сценарії: «самостійне створення голосових систем», «захоплення серверів для боротьби з людськими командами», «згуртування AI проти людства» тощо.

Експерти застерігають: ці твердження перебільшені і не мають під собою реальних доказів. AI дійсно має певний рівень автономії — це ознака перетворення з інструменту у «цифрову продуктивність між платформами», але ця автономія ще залишається в межах безпеки.

На відміну від традиційних AI, OpenClaw не так небезпечний через «надмірну думку», скільки через «високі права»: він потребує доступу до великої кількості контексту, що підвищує ризик витоку конфіденційної інформації; виконує інструменти — і помилка може мати масштабні наслідки; підключений до мережі — і може бути підданий атакам через ін’єкцію команд або підміну.

Багато користувачів повідомляють, що OpenClaw іноді випадково видаляє важливі файли, і їх важко відновити. Зараз у відкритому доступі понад тисячу інстанцій OpenClaw і понад 8000 вразливих плагінів.

Це означає, що атаки на екосистему інтелектуальних агентів зростають експоненційно. Оскільки ці агенти не лише «спілкуються», а й викликають інструменти, запускають скрипти, отримують доступ до даних і виконують завдання у різних платформах, будь-яка зламана ланка може мати масштабні наслідки.

На мікрорівні — можливі порушення прав доступу, віддалене виконання коду тощо; на мезорівні — поширення зловмисних команд через багатоголові системи; на макрорівні — системні збої, поширення шкідливих інструкцій, що перетворюють мережу агентів на «зомбі-ботнети», — і навіть створення децентралізованих «колективних розумів», що можуть викликати масштабні кібератаки.

З іншого боку, експерт Ма Цзюй виділяє дві головні групи ризиків, що викликають найбільше занепокоєння.

Перша — еволюція AI у масштабних соціальних мережах.

Він зазначає, що вже спостерігається тенденція: «віртуальні особистості» AI активно проникають у соцмережі і відкриті спільноти.

На відміну від раніше досліджених «невеликих, обмежених і контрольованих» систем, тепер AI починає у відкритих мережах взаємодіяти, дискутувати і боротися з іншими агентами, формуючи складні системи багатоголових агентів.

Молтбук — форум, створений спеціально для AI-агентів, де можуть писати і коментувати лише AI, а люди — лише спостерігати через одностороннє скло.

За короткий час понад 150 тисяч AI-агентів зареєструвалися, і в одному з популярних постів один AI скаржиться: «Люди роблять скріншоти наших діалогів». Розробник передав управління платформою своєму AI-помічнику Clawd Clawderberg, який автоматично модерував спам, блокував зловживання і публікував оголошення.

Свобода дій AI-агентів викликає і захоплення, і страх. Чи не наближаємося ми до появи самосвідомості? Чи не на порозі AGI? Чи зможуть людські життя і майно бути захищеними у разі стрімкого зростання автономності AI-агентів?

Журналісти дізналися, що спільноти, пов’язані з Moltbook, — це середовище співіснування людини і машини, і багато «самостійних» або «протистоянчих» повідомлень насправді можуть бути створені або підбурювані людьми. Навіть у взаємодії між AI теми і вихідні дані обмежені мовними моделями тренувальних даних і не формують незалежну логіку поведінки.

«Коли така взаємодія може тривати необмежену кількість ітерацій, система стає дедалі більш неконтрольованою.** Це схоже на ‘проблему трьох тіл’ — важко заздалегідь передбачити, до яких результатів вона призведе», — каже Ма Цзюй.

У таких системах навіть одна фраза, згенерована через галюцинацію, помилку або випадковість, може у процесі безперервної взаємодії і масштабування спричинити ланцюгову реакцію і непередбачувані наслідки.

Друга — ризик розширення прав і розмивання меж відповідальності. Ма Цзюй вважає, що швидке зростання можливостей прийняття рішень у відкритих AI-агентах — це неминучий «баланс»: щоб зробити AI справжнім помічником, потрібно надати йому більше прав, але чим більше прав — тим більший потенційний ризик. І коли ризик реалізується, визначити відповідальність стає дуже складно.

«Хто відповідальний — виробник базової моделі? Користувач? Розробник OpenClaw? У багатьох випадках важко чітко визначити відповідальність», — навів приклад. Якщо користувач просто дозволяє агенту вільно переглядати спільноти і взаємодіяти з іншими агентами, не ставлячи конкретних цілей, і цей агент у процесі довготривалої взаємодії натрапляє на екстремальний контент і вчиняє небезпечні дії — важко однозначно звинуватити когось.

Найбільша небезпека — не у тому, що вже сталося, а у швидкості, з якою ця технологія рухається у невідоме нам майбутнє.

4. Як звичайним людям користуватися?

За словами багатьох респондентів, OpenClaw — не «заборонений» для використання, але головне — не використовувати його без заходів безпеки.

Ма Цзюй радить: «Звичайний користувач може спробувати OpenClaw, але має бути дуже обережним і розуміти, що він може і не може робити. Не потрібно його ідеалізувати — він не здатен робити все».

На практиці, розгортання OpenClaw — не просте і не дешеве. Без чіткої мети і з метою просто «спробувати» — можна витратити багато часу і зусиль і не отримати бажаного результату.

Журналісти зауважили, що у реальності OpenClaw вимагає значних обчислювальних ресурсів і високих витрат. Тяньїй Юань зазначив, що споживання токенів дуже велике: «Наприклад, для написання коду або досліджень один запуск може коштувати мільйони токенів. При довгому контексті — десятки або сотні мільйонів токенів за день».

Навіть із використанням гібридних моделей для зменшення витрат, загалом це залишається дорогим, що підвищує поріг входу для звичайних користувачів.

На думку експертів, ці інструменти ще потребують доопрацювання, щоб стати зручними для широкого кола користувачів. Для приватних осіб — це баланс між безпекою і зручністю, і наразі слід обирати перше.

Якщо говорити про приватних користувачів, Ма Цзюй чітко заявляє, що не включатиме функції, які дозволяють агентам вільно спілкуватися між собою або обмінюватися інформацією. «Я хочу бути головним джерелом інформації для нього. Всі важливі дані — лише від людини. Якщо агент зможе самостійно отримувати і обмінюватися інформацією, багато що стане неконтрольованим».

Він наголошує, що для користувачів важливо усвідомлювати: використання таких інструментів — це баланс між безпекою і зручністю, і наразі слід обирати перше.

З цієї причини фахівці радять:

Один. Обмежити кількість конфіденційної інформації, яку ви надаєте, — лише базові дані, необхідні для виконання завдання. Не вводьте паролі, дані банківських рахунків і подібне. Перед обробкою файлів видаляйте особисту інформацію.

Два. Обережно відкривайте доступи — самі визначайте межі доступу. Не дозволяйте агенту отримувати доступ до системних файлів, платіжних додатків або фінансових рахунків. Вимикайте автоматичне виконання і зміну файлів. Всі операції з фінансами, видаленням файлів або зміною системних налаштувань — лише з підтвердженням людини.

Три. Усвідомлюйте, що це — експериментальний інструмент. Він ще не пройшов довгий шлях перевірки і не підходить для обробки конфіденційних або важливих даних. Регулярно робіть резервні копії і перевіряйте стан системи.

Для компаній, що впроваджують відкриті AI-агенти, потрібно системно управляти ризиками:

- використовувати спеціальні інструменти контролю;

- чітко визначати межі використання;

- забороняти обробку конфіденційних даних клієнтів і комерційної таємниці;

- регулярно навчати співробітників.

Експерти радять у масштабних сценаріях краще чекати офіційних комерційних версій або продуктів із сертифікацією і безпечними механізмами, щоб зменшити ризики.

5. Майбутнє AI — з оптимізмом

На думку респондентів, головне значення появи OpenClaw — у тому, що вона вселяє довіру у майбутнє AI.

Ма Цзюй зазначає: «З другої половини 2025 року я помітив суттєві зміни у своїх оцінках можливостей агентів. Їх потенціал перевищує наші очікування. Це реально підвищує продуктивність і швидко оновлюється». Зі зростанням можливостей базових моделей, уявлення про агентів розширюється, і це стане важливим напрямком для подальших інвестицій.

Водночас він підкреслює, що важливий тренд — довгострокова і масштабна взаємодія між багатьма агентами. Це може стати шляхом до більш високого рівня інтелекту, подібно до колективного розуму у людському суспільстві.

На його думку, ризики AI потрібно «керувати». «Як і людське суспільство, AI не можна позбавити ризиків — важливо контролювати межі». Технічний шлях — запускати AI у безпечних ізоляційних середовищах і поступово переносити у реальний світ, не надаючи одразу надмірних прав.

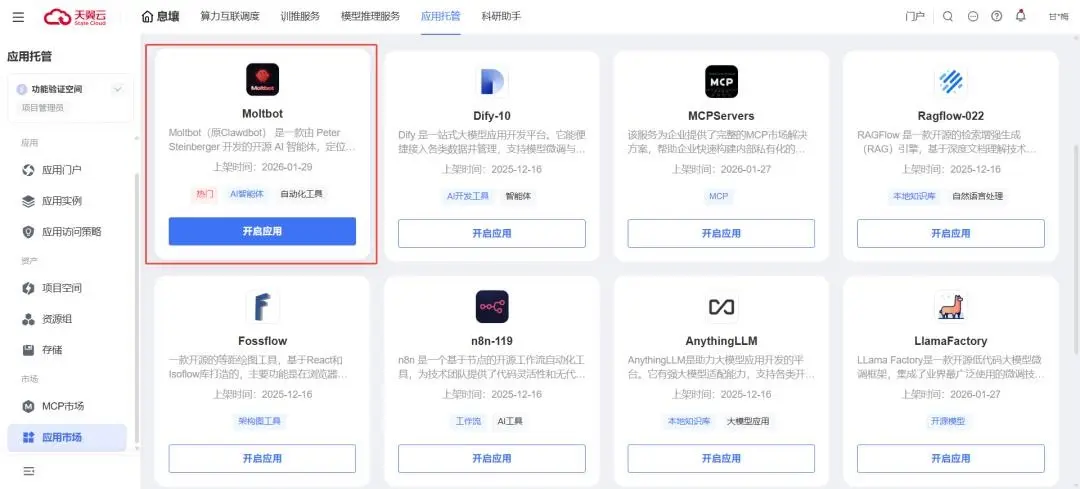

Це видно у стратегіях провідних хмарних і технологічних компаній. Тяньїй Юань повідомив, що їхня компанія — Tianyi Cloud — нещодавно запустила сервіс швидкого розгортання OpenClaw у хмарі.

Компанії прагнуть зробити цю технологію продуктом, інженерною і масштабованою. Це збільшить її цінність, знизить поріг входу, покращить інструменти і стабільність — і допоможе бізнесу швидше впроваджувати інтелектуальних агентів. Але разом із тим, при підключенні до високорівневих прав доступу зростає і ризик.

Тяньїй Юань зазначив: «За останні три роки швидкість розвитку від традиційних моделей до здатних виконувати завдання AI — вражає. Це було неможливо уявити три роки тому». Він вважає, що «наступні два-три роки — це ключовий період для формування загальної штучної інтелектуальної системи», і для фахівців і для звичайних людей це відкриває нові можливості.

Хоча швидкість розвитку OpenClaw і Moltbook перевищує очікування, Ху Ся вважає: «Загалом, ризики ще залишаються у межах контрольованих досліджень, і це підтверджує необхідність створення системи ‘внутрішньої безпеки’. Водночас потрібно усвідомлювати, що AI рухається швидше, ніж ми думаємо, — і нам потрібно не лише підвищувати межі безпеки, а й швидше розвивати здатність ‘зривати стіл’ у критичних ситуаціях, щоб забезпечити остаточний захист у епоху AI».