Співпраця OpenAI із Збройними силами США викликала хвилю бойкоту! Застосунок Claude App обганяє за популярністю, розуміння етичних та політичних боротьб за цю ситуацію

Співпраця OpenAI з американськими військовими викликає бойкот. Anthropic, яка відмовилася від військового контролю, отримала широку підтримку громадськості, що підняло додаток Claude на вершину американського рейтингу завантажень, підкреслюючи високий рівень уваги громадськості до приватності та етики штучного інтелекту.

Контракт OpenAI з Міністерством оборони США викликав кризу репутації

З 28 лютого, коли OpenAI оголосила про таємну співпрацю з Міністерством оборони США щодо розгортання мережевих систем, а також після того, як конкурент Anthropic був позначений урядом як «ризик ланцюга поставок», у американському суспільстві почалися гарячі дискусії щодо меж між технологічними компаніями та військовими структурами. Нещодавно додаток Claude App піднявся на перше місце у рейтингу завантажень в США.

У відповідь на критику генеральний директор OpenAI Сем Альтман оприлюднив заяву, в якій підкреслив, що контракт чітко забороняє використовувати AI-системи для масового внутрішнього спостереження за громадянами США, і що компанія зберігатиме контроль над системами безпеки. Альтман також зізнався, що компанія поспішила з оголошенням цієї новини, що спричинило негативне сприйняття через недбалість і прагматизм.

Бойкот у американських форумах: критика стандартів прийняття рішень OpenAI

Багато користувачів почали втрачати довіру до OpenAI. У дискусіях на Reddit з’явилися думки, що компанія зрадила свою початкову місію, орієнтовану на людину, та ідею безпечного розвитку.

Під постом Альтмана також з’явилися критичні коментарі щодо прозорості рішень OpenAI, а також питання, чому Anthropic, яка погодилася на ті ж умови безпеки, що й уряд, вважається загрозою національній безпеці.

Крім того, деякі користувачі висловили занепокоєння, що нечіткі формулювання у заяві щодо комерційного збору інформації та ненавмисного спостереження можуть створити юридичні лазівки для контролю за неамериканськими громадянами або для майбутніх військових застосувань.

Виявлення CNBC: OpenAI стверджує, що не має операційного контролю

Звіт CNBC розкрив внутрішні наради OpenAI, де Альтман 3 березня заявив, що OpenAI не має операційного контролю щодо використання технологій AI Міністерством оборони США.

Журналісти CNBC ознайомилися з частиною протоколів наради, де Альтман пояснив співробітникам, що незалежно від їхнього особистого ставлення до ударів по Ірану або вторгнення до Венесуели, вони не мають права висловлювати свою думку з цього приводу.

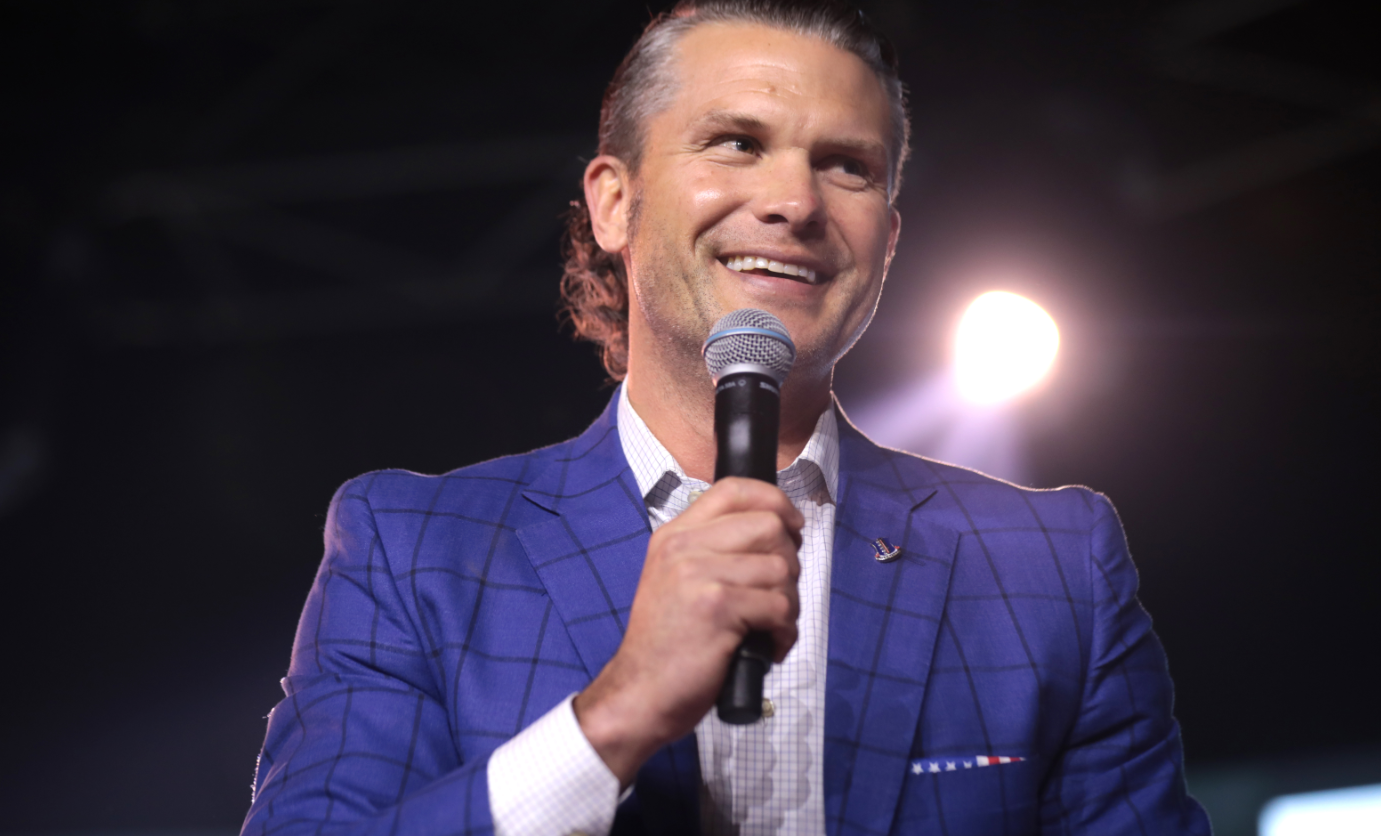

Інформовані джерела повідомляють, що Альтман під час наради наголосив, що Пентагон цінує технічну експертизу OpenAI і дозволяє компанії створювати відповідні системи безпеки, але військові чітко заявили, що остаточне рішення щодо операцій належить міністру оборони Пету Хегсету.

Джерело: commons.wikimedia, Gage Skidmore, міністр оборони США Пет Хегсет

Боротьба між етикою технологій і національною безпекою

Інцидент із військовими США та Anthropic ще більше загострив суперечності між національною безпекою, етикою технологій і свободою приватності.

Більше 200 співробітників Google та OpenAI підписали відкритий лист на підтримку рішення Anthropic зберегти системи безпеки. Anthropic твердо заявляє, що будь-які загрози або покарання не змінять їхню принципову позицію щодо запобігання масштабному спостереженню та автоматичному озброєнню.

Колишній співробітник ФБР і відомий викривач Едвард Сноуден зазначив, що система XKeyscore Агентства національної безпеки США здатна повністю відслідковувати інтернет-активність і фізичне місцезнаходження користувачів, що викликає побоювання щодо розширення масштабів контролю за допомогою AI.

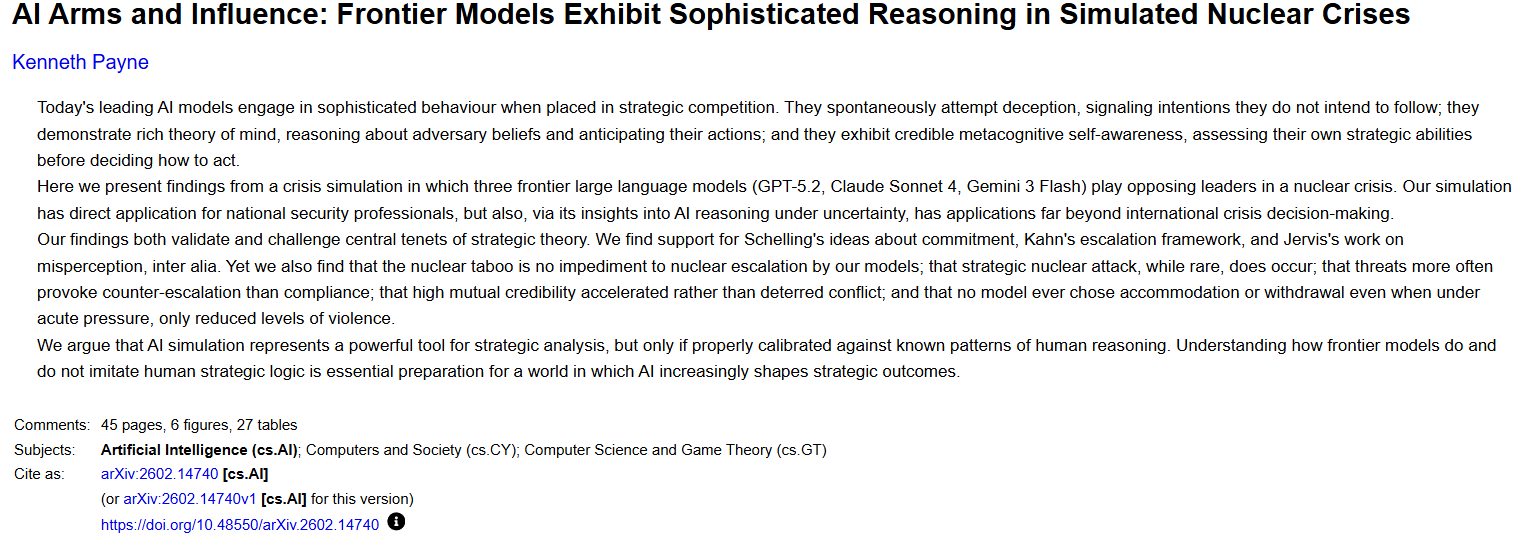

Крім того, нещодавнє дослідження Лондонського королівського коледжу показало, що у моделях AI, таких як OpenAI та Anthropic, у 95% випадків у разі геополітичної кризи вони обирають запуск ядерної зброї.

Якщо уряд безпосередньо використовуватиме ризиковані ланцюги поставок для тиску на технологічні компанії, це створить небезпечний прецедент і серйозно зашкодить інноваціям і етичному регулюванню AI у США.

- **Детальніше:**Національна безпека проти етики: Anthropic відмовляється знімати безпековий захист Claude, конфлікт із Міністерством оборони США

Що означає перемога додатку Claude у рейтингу?

Цей конфлікт між етикою AI та політичною владою ще триває. Anthropic планує звернутися до суду для захисту своїх бізнес-інтересів і правових меж у відповідь на урядські санкції. Тим часом OpenAI, швидко отримавши військовий контракт, опинилася під серйозним кризовим випробуванням репутації та довіри.

Останні опитування громадської думки у США також вплинули на популярність двох компаній.

Згідно з даними Similarweb, станом на 1 березня, у рейтингу додатків App Store у США Claude App піднявся на 3 позиції, ставши лідером за кількістю завантажень серед безкоштовних додатків для iPhone, тоді як ChatGPT опустився на 2 місця і посів друге.

Це прямо відображає, що після спалаху суперечностей щодо національної безпеки американці дедалі більше цінують приватність і не бажають піддаватися надмірному контролю з боку уряду.

Додаткові матеріали:

V-голос знову попереджає про Worldcoin: Сем Альтман створив World ID, що має 13 мільйонів користувачів і може загрожувати свободі в інтернеті

Засновник Telegram зізнався, що не користується телефоном: «Ми витрачаємо час, щоб зберегти свободу в мережі»